Clear Sky Science · es

Una interfaz neuronal flexible multirregión para decodificar estados conductuales en ratones en libertad

Escuchando la rutina diaria del cerebro

Actividades cotidianas como descansar, deambular o coger un aperitivo parecen sencillas, pero emergen de millones de neuronas disparando de forma coordinada en lo profundo del cerebro. Este estudio muestra cómo un nuevo sistema de sensores flexibles, combinado con inteligencia artificial moderna, puede “escuchar” muchas regiones cerebrales a la vez en ratones libres y determinar de forma fiable qué está haciendo el animal. A largo plazo, esta tecnología podría ayudar a los científicos a entender los trastornos cerebrales y a construir mejores interfaces cerebro‑computadora que funcionen fuera del laboratorio.

Una ventana blanda a un cerebro muy activo

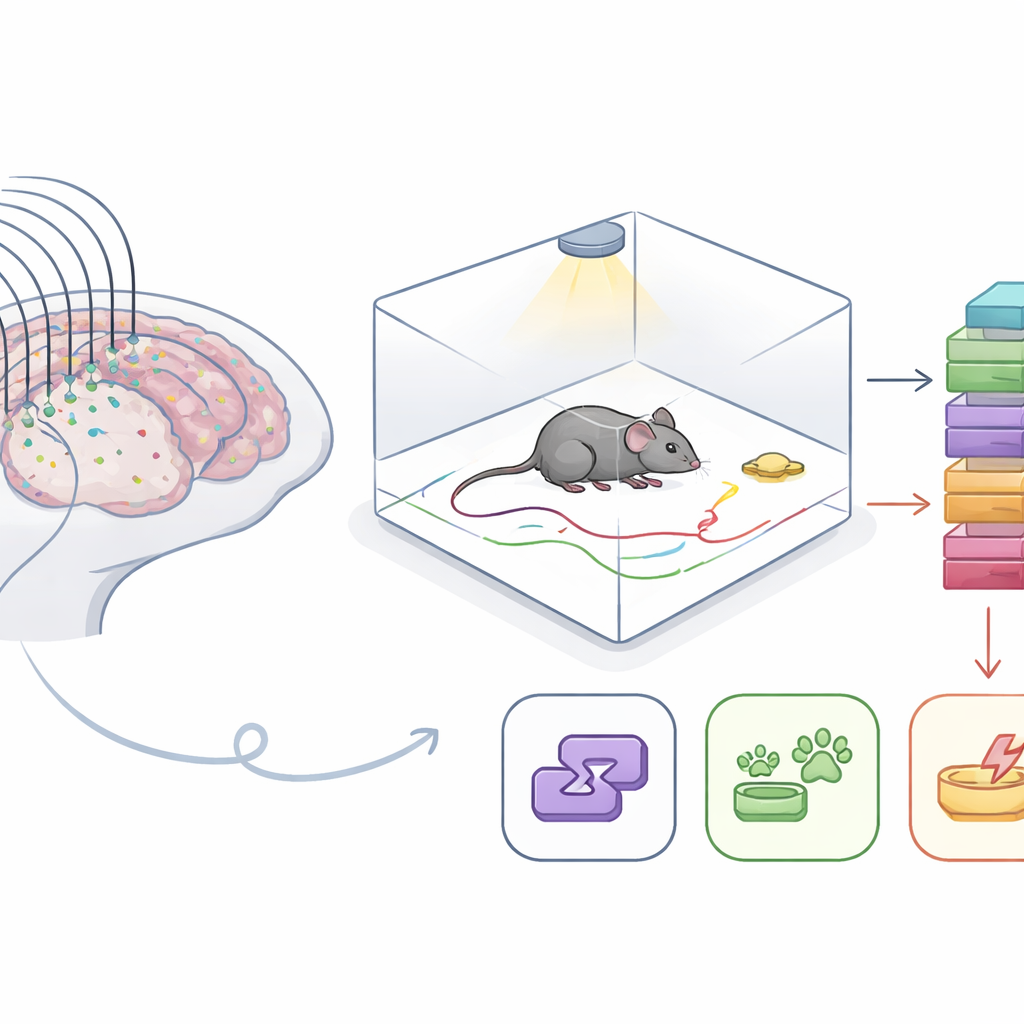

Las sondas cerebrales tradicionales son rígidas y suelen registrar en una sola área, lo que puede irritar el tejido y perder la visión general de cómo cooperan distintas regiones. El equipo diseñó una sonda flexible multirregión que resuelve ambos problemas. Cada sonda lleva ocho brazos delgados, o astas, alineados con pequeñas almohadillas de oro para registro. Curvas en forma de omega incorporadas en cada asta permiten que la estructura se estire y flexione con el cerebro blando, de modo que puede alcanzar áreas distantes sin romperse ni tirar del tejido. Pruebas en geles «fantasma» y en ratones vivos mostraron que el dispositivo puede abarcar más de un centímetro de tejido cerebral y mantener sus propiedades eléctricas estables durante semanas, incluso mientras los animales se mueven de forma natural.

Siguiendo a los ratones mientras descansan, vagan y comen

Para conectar la actividad cerebral con el comportamiento real, los investigadores construyeron una caja transparente donde los ratones podían moverse libremente, con material de cama en el suelo, comida en una esquina fija y una luz capaz de emitir destellos breves. Cámaras aéreas rastreaban las posiciones de cabeza y cola, mientras la nueva sonda registraba señales cerebrales de baja frecuencia de hasta ocho regiones, incluidos centros de movimiento, tacto, memoria y visión. El equipo se centró en cuatro estados fácilmente reconocibles: descanso, deambulación por la caja, alimentación en el punto de comida y respuesta a un destello rítmico de luz. Etiquetando cuidadosamente el comportamiento a partir de los videos y emparejándolo con los registros cerebrales, montaron un conjunto de datos rico que abarca aproximadamente una semana de actividad entre cuatro ratones.

Enseñar a una IA a leer patrones cerebrales

Las señales cerebrales cambian rápidamente en el tiempo y entre regiones, por lo que el grupo recurrió a un modelo de aprendizaje profundo para encontrar patrones que el ojo humano no distingue fácilmente. Su modelo personalizado “L‑Conformer” combina dos ideas: una parte busca formas de corto alcance en la señal, mientras otra parte de «atención» sigue cómo se relacionan los patrones a lo largo de períodos más largos. Al deslizar una ventana temporal sobre los registros, el modelo aprende a vincular cada fragmento de cuatro segundos de actividad cerebral con uno de los cuatro estados conductuales. Los investigadores probaron muchas longitudes de ventana y encontraron que cuatro segundos ofrecían el mejor equilibrio entre capturar comportamientos sostenidos y evitar mezclas de estados diferentes, alcanzando casi un 89% de precisión. Modelos competidores tomados de trabajos recientes sobre interfaces cerebro‑computadora no rindieron igual en este exigente conjunto de datos naturalista.

Muchas regiones superan a una sola

Una pregunta clave era si era mejor concentrar muchos electrodos en una región «favorita» o repartirlos por todo el cerebro. Cuando el modelo se entrenó con señales de una región a la vez, el rendimiento varió mucho y a menudo fue modesto. Combinar las ocho regiones aumentó la precisión media hasta casi el 88%. El equipo hizo luego comparaciones justas manteniendo el número total de canales igual mientras cambiaba su ubicación. Con solo unos pocos canales, concentrarlos en una región funcionó algo mejor. Pero una vez que se incluyeron señales de cinco o más regiones, la disposición distribuida se adelantó claramente y siguió mejorando, mientras que la configuración de una sola región alcanzó un techo. Esto sugiere que estados cotidianos como descansar, deambular y alimentarse son fenómenos de gran escala en todo el cerebro, no producto de ningún «centro» aislado.

Decodificación estable a lo largo de días y distintos ratones

Para cualquier uso clínico o asistencial futuro, un decodificador debe seguir funcionando más allá de una sola sesión de registro o individuo. Por ello los investigadores preguntaron si su modelo podía manejar días nuevos y animales distintos sin reentrenamiento constante. Cuando se entrenó con varios días de datos de un ratón y luego se probó en días posteriores, la precisión subió hasta alrededor del 85%, próxima al rendimiento del mismo día, incluso sin reajustar el modelo. En una prueba más exigente, entrenaron el sistema con datos de tres ratones y lo evaluaron en un cuarto. De forma notable, el modelo todavía pudo adivinar el estado conductual de ese animal con cerca del 70% de precisión desde el primer uso, y un ajuste sencillo con algunos datos del nuevo ratón elevó la precisión por encima del 80%.

Qué implica esto para futuras interfaces cerebrales

En pocas palabras, el estudio demuestra que una «red de escucha» blanda y multirregión combinada con un potente algoritmo de aprendizaje puede decodificar con alta fiabilidad lo que hace un ratón en libertad durante semanas y entre distintos animales. Para el público general, la idea clave es que estados cerebrales como descansar, explorar y comer están escritos en patrones a gran escala distribuidos por todo el cerebro, y que la electrónica flexible y la IA pueden leer este código distribuido sin dañar el tejido ni empezar de cero cada día. A largo plazo, enfoques similares podrían ayudar a monitorizar estados internos en trastornos cerebrales, guiar terapias y apoyar interfaces cerebro‑computadora que funcionen en entornos más naturales y cotidianos.

Cita: Tian, Y., Li, G., Su, H. et al. A multi-region flexible neural interface for behavioral state decoding in freely moving mice. Microsyst Nanoeng 12, 154 (2026). https://doi.org/10.1038/s41378-026-01258-5

Palabras clave: interfaz cerebro‑computadora, decodificación neuronal, electrodos flexibles, estado conductual, aprendizaje profundo