Clear Sky Science · de

Ein flexibles mehrregioniges neuronales Interface zur Decodierung des Verhaltenszustands bei frei beweglichen Mäusen

Dem Gehirn bei seiner täglichen Routine zuhören

Alltägliche Aktivitäten wie Ausruhen, Umherwandern oder einen Snack greifen zu können, wirkt mühelos, entsteht aber durch Millionen von Nervenzellen, die gemeinsam tief im Gehirn aktiv sind. Diese Studie zeigt, wie ein neues flexibles Sensornetz in Kombination mit moderner künstlicher Intelligenz viele Hirnregionen gleichzeitig bei frei beweglichen Mäusen „abhören“ und zuverlässig erkennen kann, was das Tier gerade tut. Langfristig könnte solche Technologie Wissenschaftlern helfen, Gehirnerkrankungen besser zu verstehen und robustere Gehirn‑Computer‑Schnittstellen zu entwickeln, die außerhalb des Labors funktionieren.

Ein weiches Fenster in ein geschäftiges Gehirn

Traditionelle Hirnsonden sind steif und erfassen meist nur eine einzelne Region; das kann Gewebe reizen und das größere Bild darüber verfehlen, wie verschiedene Bereiche zusammenarbeiten. Das Team entwickelte eine flexible Mehrregionssonde, die beide Probleme adressiert. Jede Sonde trägt acht dünne Arme, sogenannte Shanks, bestückt mit winzigen Goldaufnahmen. Durchdachte Omega‑förmige Kurven in jedem Shank lassen die Struktur mit dem weichen Gehirn dehnen und biegen, sodass entfernte Bereiche erreicht werden können, ohne zu brechen oder das Gewebe zu ziehen. Tests in Gel‑„Phantom“‑Gehirnen und an lebenden Mäusen zeigten, dass das Gerät mehr als einen Zentimeter Gehirn überspannen kann und seine elektrischen Eigenschaften über Wochen stabil hält, selbst wenn sich die Tiere natürlich bewegen.

Mäuse verfolgen beim Ruhen, Umherstreifen und Fressen

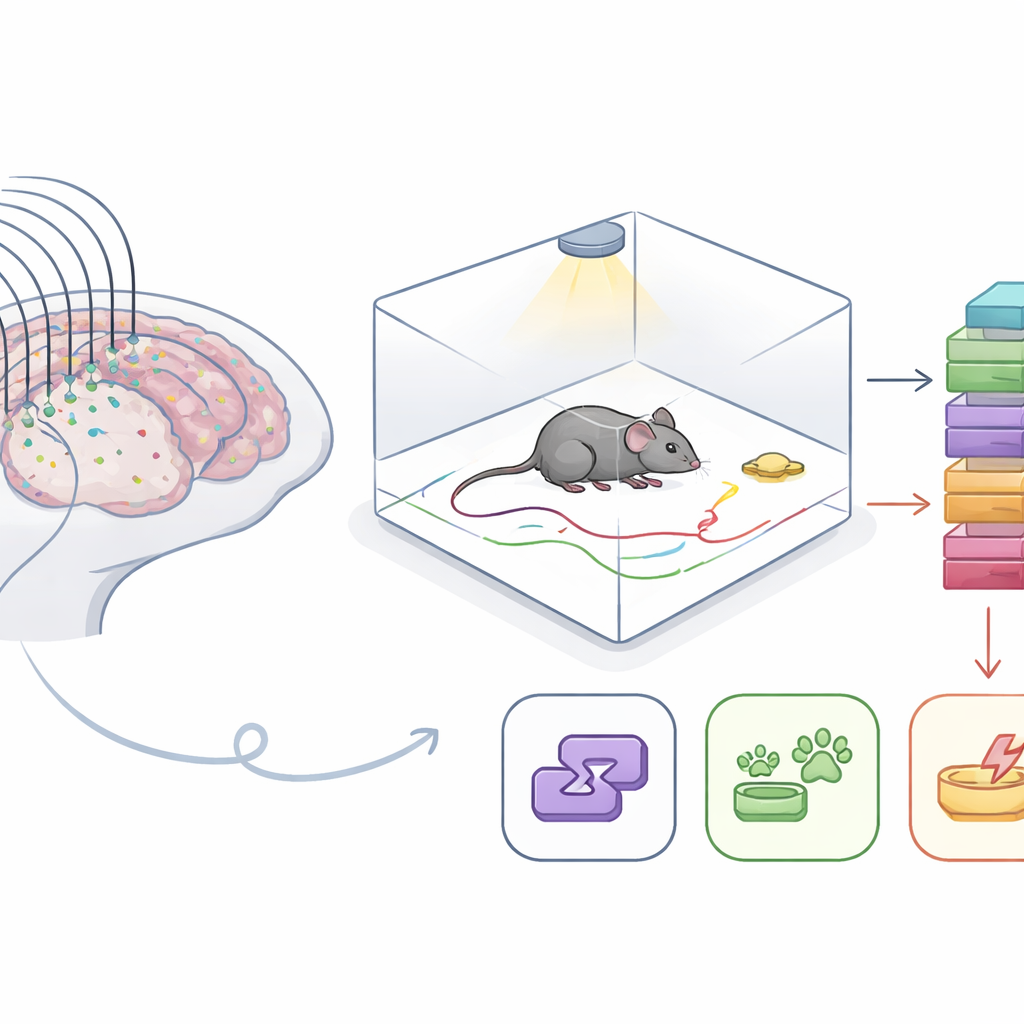

Um Gehirnaktivität mit echtem Verhalten zu verknüpfen, bauten die Forscher eine durchsichtige Box, in der sich Mäuse frei bewegen konnten, mit Einstreu auf dem Boden, Futter in einer festen Ecke und einer Leuchte, die kurze Blitze abgeben konnte. Kameras von oben verfolgten Kopf‑ und Schwanzpositionen, während die neue Sonde niederfrequente Hirnsignale aus bis zu acht Regionen aufzeichnete, darunter Bewegungs‑, Tastsinn‑, Speicher‑ und Sehzentren. Das Team konzentrierte sich auf vier leicht erkennbare Zustände: Ruhen, Herumstreifen in der Box, Fressen am Futterplatz und die Reaktion auf einen rhythmischen Lichtblitz. Durch sorgfältiges Labeln des Verhaltens aus den Videos und Abgleichen mit den Hirnaufzeichnungen entstand ein reichhaltiger Datensatz, der etwa eine Woche aktiver Zeit über vier Mäuse hinweg abdeckt.

Eine KI darin schulen, Hirnmuster zu lesen

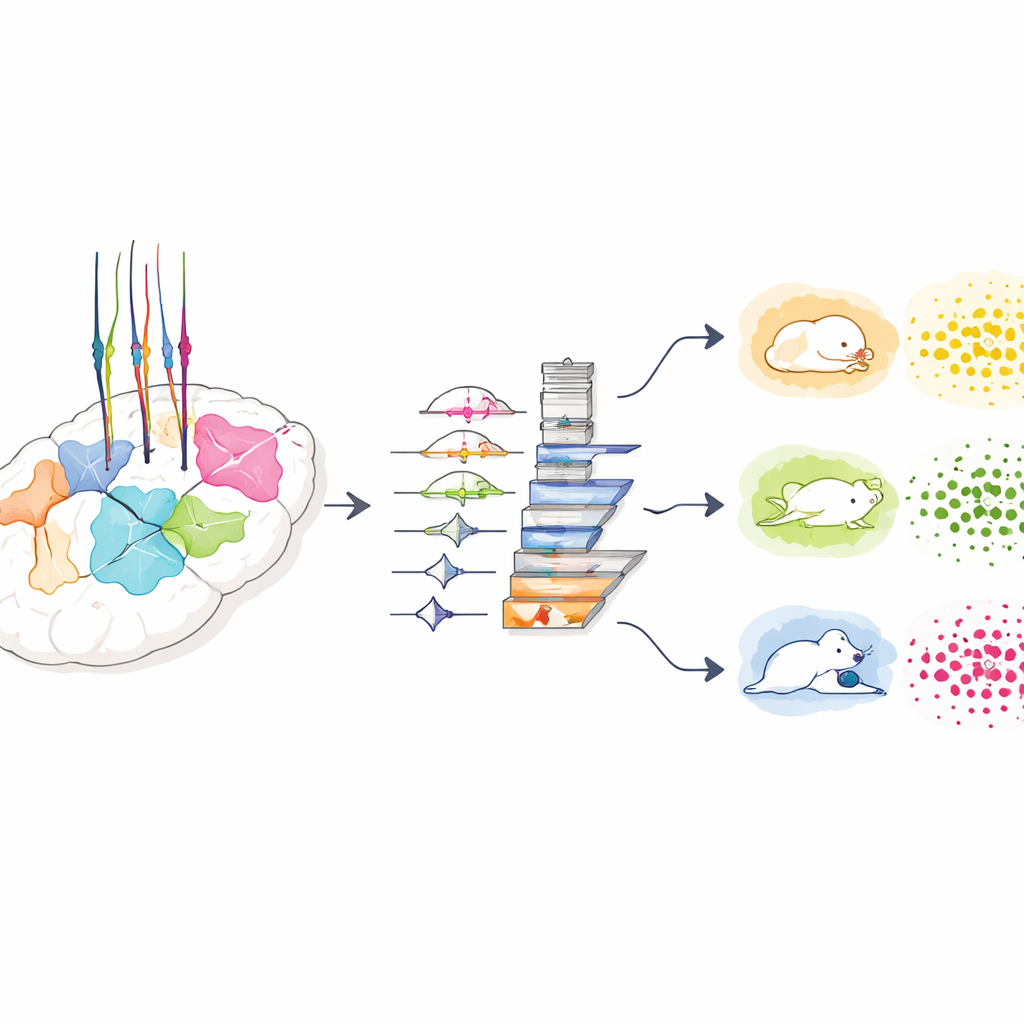

Hirnsignale verändern sich schnell über Zeit und zwischen Regionen, daher wandte sich die Gruppe einem Deep‑Learning‑Modell zu, um Muster zu finden, die für Menschen schwer erkennbar sind. Ihr maßgeschneidertes „L‑Conformer“-Modell kombiniert zwei Ansätze: ein Teil sucht nach kurzreichweitigen Formen im Signal, während ein anderer „Attention“-Teil verfolgt, wie Muster sich über längere Zeiträume verknüpfen. Indem das Modell ein Zeitfenster über die Aufzeichnungen schiebt, lernt es, jeden viersekündigen Ausschnitt der Hirnaktivität einem der vier Verhaltenszustände zuzuordnen. Die Forscher testeten viele Fensterlängen und fanden, dass vier Sekunden den besten Kompromiss zwischen Erfassen anhaltenden Verhaltens und Vermeiden von Zustandsmischungen bieten; die erzielte Genauigkeit lag bei knapp 89 %. Konkurrenzmodelle aus jüngerer Gehirn‑Computer‑Schnittstellen‑Forschung erreichten auf diesem anspruchsvollen, naturalistischen Datensatz nicht die gleiche Leistung.

Viele Hirnregionen schlagen eine einzige

Eine zentrale Frage war, ob es besser ist, viele Elektroden in einer einzigen „Lieblings“region zu konzentrieren oder sie über das Gehirn zu verteilen. Wurde das Modell mit Signalen jeweils nur aus einer Region trainiert, schwankte die Leistung stark und war oft mäßig. Die Kombination aller acht Regionen steigerte die durchschnittliche Genauigkeit auf nahezu 88 %. Das Team führte dann faire Direktvergleiche durch, indem es die Gesamtzahl der Kanäle konstant hielt und nur deren Platzierung veränderte. Bei nur wenigen Kanälen war die Konzentration auf eine Region leicht vorteilhaft. Sobald jedoch Signale aus fünf oder mehr Regionen einbezogen wurden, lag das verteilte Layout deutlich vorn und verbesserte sich weiter, während das Ein‑Region‑Design an eine Decke stieß. Das deutet darauf hin, dass Alltagszustände wie Ruhen, Umherstreifen und Fressen echte großräumige Gehirnphänomene sind und nicht das Produkt eines einzelnen „Zentrums“.

Stabile Decodierung über Tage und verschiedene Mäuse

Für künftige klinische oder assistive Anwendungen muss ein Decoder über eine einzelne Aufzeichnungssitzung oder ein Individuum hinaus zuverlässig arbeiten. Die Forscher prüften daher, ob ihr Modell neue Tage und neue Tiere ohne ständiges Nachtrainieren bewältigen kann. Wurde es mit Daten mehrerer Tage von einer Maus trainiert und dann an späteren Tagen getestet, stieg die Genauigkeit auf etwa 85 %, nahe an der Performance am selben Tag, selbst ohne Neukalibrierung. In einem härteren Test trainierten sie das System mit drei Mäusen und evaluierten es an einer vierten. Bemerkenswerterweise konnte das Modell den Verhaltenszustand dieser Maus immer noch mit rund 70 % Genauigkeit vorhersagen, und eine einfache Feinabstimmung mit einigen Daten der neuen Maus erhöhte die Genauigkeit auf über 80 %.

Was das für künftige Gehirn‑Interfaces bedeutet

Kurz gesagt zeigt die Studie, dass ein weiches, mehrregioniges „Abhörnetz“ in Kombination mit einem leistungsfähigen Lernalgorithmus sehr zuverlässig decodieren kann, was eine frei bewegliche Maus tut — über Wochen hinweg und zwischen verschiedenen Tieren. Für Nicht‑Experten ist die Kernidee, dass Hirnzustände wie Ruhen, Erkunden und Fressen in großflächigen Mustern über das Gehirn verteilt sind und dass flexible Elektronik und KI diesen verteilten Code lesen können, ohne das Gewebe zu schädigen oder jeden Tag neu beginnen zu müssen. Langfristig könnten ähnliche Ansätze helfen, innere Zustände bei Gehirnerkrankungen zu überwachen, Therapien zu steuern und Gehirn‑Computer‑Schnittstellen zu unterstützen, die in natürlicheren, alltäglichen Umgebungen funktionieren.

Zitation: Tian, Y., Li, G., Su, H. et al. A multi-region flexible neural interface for behavioral state decoding in freely moving mice. Microsyst Nanoeng 12, 154 (2026). https://doi.org/10.1038/s41378-026-01258-5

Schlüsselwörter: Gehirn-Computer-Schnittstelle, neurale Dekodierung, flexible Elektroden, Verhaltenszustand, Deep Learning