Clear Sky Science · it

Un’interfaccia neurale flessibile multiregione per il decodificare gli stati comportamentali in topi in libertà

Ascoltare la routine quotidiana del cervello

Attività di tutti i giorni come riposare, vagare o prendere uno spuntino sembrano semplici, ma emergono da milioni di cellule nervose che si attivano insieme nelle profondità del cervello. Questo studio mostra come un nuovo sistema di sensori flessibili, abbinato all’intelligenza artificiale moderna, possa “ascoltare” più regioni cerebrali contemporaneamente in topi liberi di muoversi e riconoscere con affidabilità cosa sta facendo l’animale. A lungo termine, questa tecnologia potrebbe aiutare gli scienziati a comprendere i disturbi cerebrali e a costruire interfacce cervello‑computer più efficaci fuori dal laboratorio.

Una finestra morbida su un cervello occupato

I tradizionali sensori cerebrali sono rigidi e di solito registrano in una sola area, il che può irritare i tessuti e perdere il quadro più ampio di come le diverse regioni collaborino. Il team ha progettato una sonda flessibile multiregione che risolve entrambi i problemi. Ogni sonda porta otto bracci sottili, o shank, rivestiti di piccole pad di registrazione in oro. Curve intelligenti a forma di omega integrate in ciascuno shank permettono alla struttura di allungarsi e flettersi con il cervello morbido, così da raggiungere aree distanti senza rompersi o tirare sui tessuti. Test in cervelli finti di gel e in topi vivi hanno dimostrato che il dispositivo può coprire più di un centimetro di tessuto cerebrale e mantenere stabili le proprietà elettriche per settimane, anche mentre gli animali si muovono naturalmente.

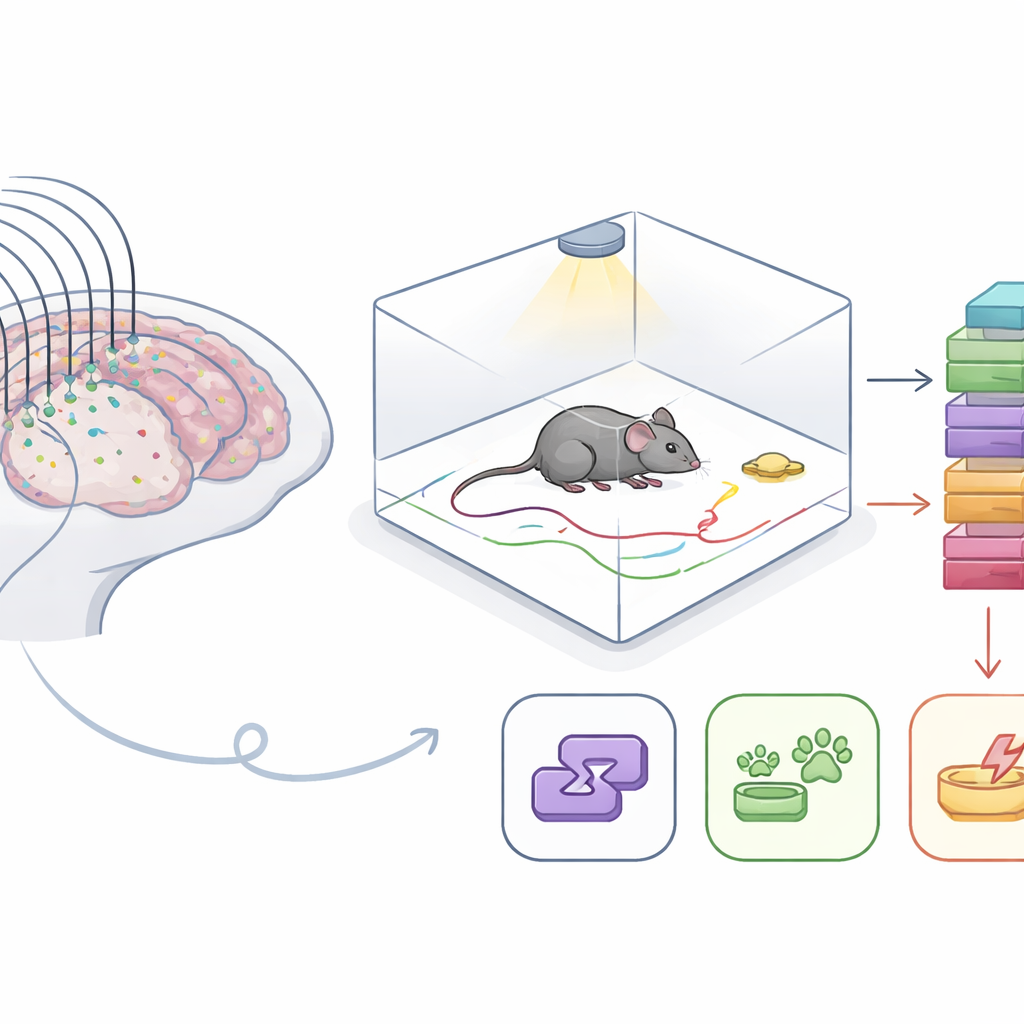

Seguire i topi mentre riposano, esplorano e si alimentano

Per collegare l’attività cerebrale al comportamento reale, i ricercatori hanno costruito una scatola trasparente in cui i topi potevano muoversi liberamente, con lettiera sul pavimento, cibo in un angolo fisso e una luce in grado di emettere lampi brevi. Telecamere dall’alto tracciavano la posizione di testa e coda, mentre la nuova sonda registrava segnali cerebrali a bassa frequenza fino a otto regioni, tra cui centri del movimento, del tatto, della memoria e della visione. Il team si è concentrato su quattro stati facilmente riconoscibili: riposo, esplorazione della scatola, alimentazione nel punto del cibo e risposta a un lampeggio ritmico di luce. Etichettando con cura il comportamento dai video e abbinandolo alle registrazioni cerebrali, hanno assemblato un ricco dataset che copre circa una settimana di attività distribuita su quattro topi.

Insegnare a un’IA a leggere i modelli cerebrali

I segnali cerebrali cambiano rapidamente nel tempo e tra regioni, così il gruppo si è rivolto a un modello di deep learning per trovare schemi che l’occhio umano fatica a vedere. Il loro modello personalizzato “L‑Conformer” combina due idee: una parte cerca forme a corto raggio nel segnale, mentre un’altra parte di “attenzione” traccia come i pattern si relazionano su scale temporali più lunghe. Scorrendo una finestra temporale sulle registrazioni, il modello impara ad associare ogni frammento di quattro secondi di attività cerebrale a uno dei quattro stati comportamentali. I ricercatori hanno testato molte lunghezze di finestra e hanno scoperto che quattro secondi trovano il miglior equilibrio tra catturare comportamenti sostenuti ed evitare mescolanze di stati diversi, raggiungendo quasi l’89% di accuratezza. Modelli concorrenti tratti da lavori recenti su interfacce cervello‑computer non hanno performato altrettanto bene su questo dataset naturale e impegnativo.

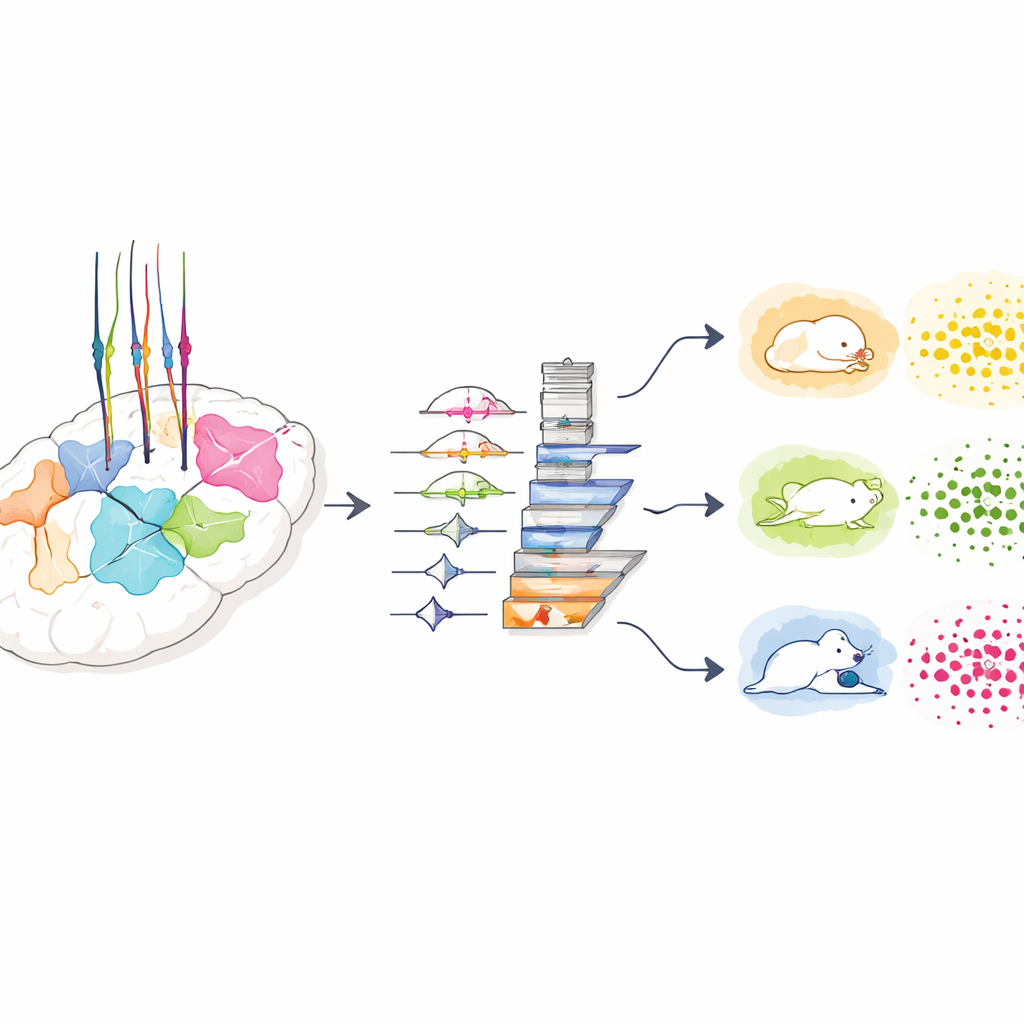

Molte regioni cerebrali battono una sola

Una domanda centrale era se sia meglio concentrare molti elettrodi in una singola regione “preferita” o distribuirli nel cervello. Quando il modello è stato addestrato sui segnali di una sola area alla volta, le prestazioni variavano molto ed erano spesso modeste. Combinare tutte le otto regioni ha aumentato l’accuratezza media fino a quasi l’88%. Il team ha quindi effettuato confronti diretti mantenendo lo stesso numero totale di canali ma cambiandone la collocazione. Con pochi canali, concentrarli in una regione funzionava leggermente meglio. Ma una volta incluse le segnali da cinque o più regioni, la distribuzione risultava chiaramente superiore e continuava a migliorare, mentre la configurazione monoregionale raggiungeva un limite. Questo suggerisce che stati quotidiani come riposare, esplorare e nutrirsi siano fenomeni realmente a scala cerebrale, non il risultato di un singolo “centro”.

Decodifica stabile attraverso giorni e topi diversi

Per qualsiasi uso clinico o assistivo futuro, un decodificatore deve funzionare oltre una singola sessione di registrazione o individuo. I ricercatori hanno quindi verificato se il loro modello potesse gestire nuovi giorni e nuovi animali senza un continuo riaddestramento. Quando addestrato su diversi giorni di dati di un topo e poi testato su giorni successivi, l’accuratezza è salita a circa l’85%, vicino alla performance dello stesso giorno, anche senza ritoccare il modello. In una prova più difficile, hanno addestrato il sistema su tre topi e lo hanno valutato su un quarto. Sorprendentemente, il modello riusciva comunque a indovinare lo stato comportamentale di quell’animale con circa il 70% di accuratezza subito, e un semplice fine‑tuning con alcuni dati del nuovo topo ha portato l’accuratezza oltre l’80%.

Cosa significa per le future interfacce cerebrali

In sintesi, lo studio dimostra che una “rete di ascolto” morbida, multiregione, combinata con un potente algoritmo di apprendimento, può decodificare con alta affidabilità cosa fa un topo libero di muoversi per settimane e attraverso animali diversi. Per i non esperti, l’idea chiave è che stati cerebrali come riposo, esplorazione e alimentazione sono scritti in pattern su larga scala distribuiti nel cervello, e che l’elettronica flessibile e l’IA possono leggere questo codice distribuito senza danneggiare i tessuti o ricominciare da zero ogni giorno. A lungo termine, approcci simili potrebbero aiutare a monitorare stati interni nei disturbi cerebrali, guidare terapie e supportare interfacce cervello‑computer che funzionino in contesti più naturali e quotidiani.

Citazione: Tian, Y., Li, G., Su, H. et al. A multi-region flexible neural interface for behavioral state decoding in freely moving mice. Microsyst Nanoeng 12, 154 (2026). https://doi.org/10.1038/s41378-026-01258-5

Parole chiave: interfaccia cervello-computer, decodifica neurale, elettrodi flessibili, stato comportamentale, deep learning