Clear Sky Science · it

Maggiore accuratezza nell’imaging 3D con sensori curvi: un approccio basato su simulazioni

Visione digitale più nitida per la scansione 3D di tutti i giorni

Dal riconoscimento facciale sui telefoni ai robot di fabbrica che controllano le dimensioni di un pezzo d’auto, molti sistemi oggi si affidano a telecamere capaci di misurare la forma tridimensionale degli oggetti reali. Eppure le fotocamere nella maggior parte degli scanner 3D continuano a usare un’idea vecchia di un secolo: un sensore elettronico piatto posto dietro a una lente. Questo articolo esplora una soluzione apparentemente semplice — curvare quel sensore in una lieve arcatura — e mostra, tramite dettagliate simulazioni al computer, che può rendere le misure 3D sensibilmente più nitide e affidabili senza aggiungere ottiche costose o ingombranti.

Perché gli “occhi” piatti faticano a vedere nitidamente

In una fotocamera o in uno scanner 3D tipico, la luce riflessa da un oggetto attraversa una lente e arriva su un sensore piatto composto da milioni di piccoli pixel. Il problema è che le lenti portano naturalmente la luce a fuoco su una superficie curva, non su una piattaforma piana. Al centro dell’immagine questo disallineamento è piccolo, quindi i dettagli appaiono nitidi. Verso i bordi, però, la messa a fuoco devia, causando sfocatura e sottili distorsioni della forma che sono particolarmente dannose quando l’obiettivo è misurare distanze o dimensioni con alta precisione. Gli ingegneri possono contrastare questo effetto impilando più lenti per costringere la luce su un sensore piatto, ma ciò rende il sistema più complesso, pesante e costoso.

Prendendo in prestito un trucco dagli occhi viventi

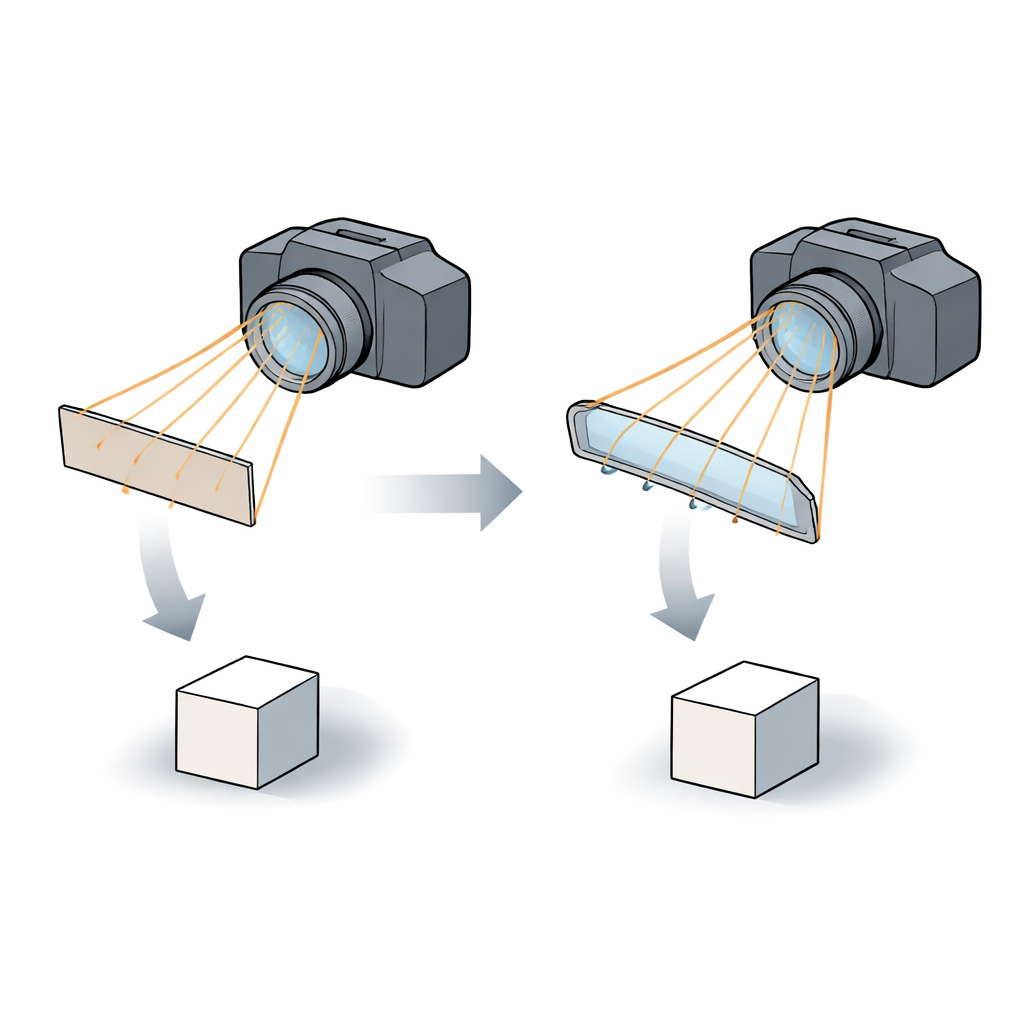

Occhi umani e animali risolvono il problema in modo diverso: la retina sensibile alla luce è curva, seguendo da vicino il modo in cui la lente mette a fuoco la luce. Ispirandosi a questo, gli autori hanno simulato sistemi di fotocamere in cui il sensore elettronico piatto è sostituito da uno curvo modellato per seguire la superficie focale naturale della lente. Hanno esaminato sia una configurazione semplice a tre lenti sia un progetto multi-lente più complesso simile a quelli usati nelle fotocamere commerciali. In ogni caso hanno confrontato come sensori piatti e curvi gestiscono imperfezioni comuni dell’immagine, come sfocatura, allungamento e sbiadimento dei dettagli lontano dal centro.

Trasformare un’immagine curva in numeri utilizzabili

Curvare il sensore introduce una nuova sfida: la maggior parte degli strumenti software usati per convertire immagini di fotocamere in misure 3D precise assume che il sensore sia piatto. Per affrontare questo, i ricercatori hanno messo a punto un escamotage matematico. Trattano il sensore curvo come una sottile fetta di sfera e calcolano come ogni punto su quella superficie si proietterebbe su un piano immaginario piatto. Una volta che quei punti sono “srotolati” in questo modo, i metodi standard di calibrazione della fotocamera — originariamente pensati per sensori piani — possono essere riutilizzati senza cambiamenti sostanziali. Questa mappatura sferica permette al gruppo di stimare con che precisione il sistema con sensore curvo potrebbe ricostruire dimensioni e posizioni nel mondo reale.

Mettere alla prova sensori curvi e piatti

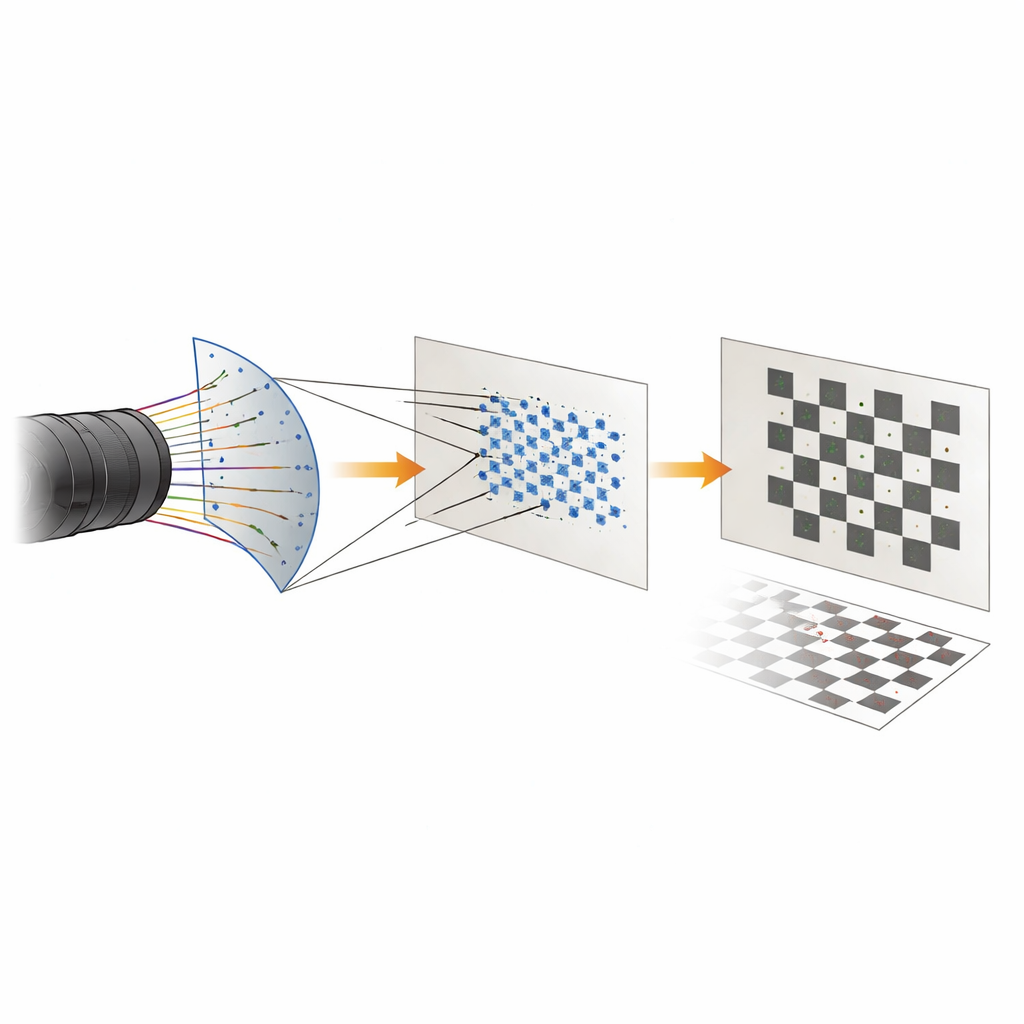

Usando una combinazione di software specializzato per il progetto ottico e uno strumento di calibrazione virtuale, gli autori hanno generato immagini realistiche di un motivo a scacchiera, simile a quelli usati nelle fabbriche di fotocamere. Hanno quindi eseguito la stessa procedura di misura sia su sensori piatti sia su sensori curvi. Per il sensore piatto, gli errori medi di distanza nella ricostruzione della geometria del motivo erano circa l’1,41 percento. Con il sensore curvo, quegli errori sono scesi allo 0,78 percento — una riduzione di circa il 45 percento. Il miglioramento si è mantenuto attraverso diversi progetti di lente, lunghezze focali e curvature del sensore, suggerendo che il beneficio deriva principalmente dalla forma del sensore piuttosto che da un fine adattamento delle ottiche.

Cosa significa questo per le fotocamere future

Per un non specialista, il messaggio principale è semplice: se curviamo la “pellicola” della fotocamera per adattarla al modo in cui le lenti focalizzano davvero la luce, possiamo ottenere bordi più nitidi e misure 3D più affidabili senza ricorrere ad assemblaggi in vetro complessi. Sebbene lo studio si basi su simulazioni più che su prototipi fisici, indica che i sensori curvi potrebbero rendere gli scanner 3D futuri, i sistemi di ispezione e forse anche le fotocamere consumer sia più accurati sia potenzialmente più economici. Man mano che le tecniche di produzione per i rivelatori elettronici curvi matureranno, questo approccio incentrato sul sensore potrebbe contribuire a colmare il divario tra le fotocamere artificiali e i sistemi visivi finemente ottimizzati che si trovano in natura.

Citazione: Emam, S.M., Daliri, H., Foorginejad, A. et al. Enhanced 3D imaging accuracy using curved sensors: a simulation-based approach. Sci Rep 16, 13004 (2026). https://doi.org/10.1038/s41598-026-48047-8

Parole chiave: Imaging 3D, sensore d’immagine curvo, calibrazione della fotocamera, aberrazione ottica, visione artificiale