Clear Sky Science · it

Migliorare la valutazione automatica della scrittura IELTS con LLAMA-3 adattato M-LoRA e apprendimento per rinforzo PPO guidato dal feedback umano

Perché un Aiuto per i Saggi Più Intelligente Conta

Per milioni di persone ogni anno, l’esame IELTS può aprire porte per studiare, lavorare o immigrare all’estero. Tuttavia molti candidati faticano soprattutto nella sezione di scrittura, dove ottenere un feedback chiaro e affidabile è difficile e pagare tutor umani può essere costoso. Questo articolo esplora un nuovo modo di usare l’intelligenza artificiale non solo per valutare i saggi IELTS, ma anche per fornire suggerimenti dettagliati e simili a quelli umani che aiutino gli scrittori a migliorare concretamente, rimanendo strettamente allineati al modo di giudicare degli esaminatori reali.

La Sfida di Valutare la Scrittura

Valutare la qualità di un saggio è più complesso che controllare l’ortografia o contare le parole. Gli esaminatori umani osservano quanto bene lo scrittore risponde alla traccia, quanto chiare sono l’organizzazione delle idee, la ricchezza e la correttezza del vocabolario e la correttezza e varietà della grammatica. I sistemi di valutazione automatica esistenti spesso funzionano bene solo su insiemi ristretti e fissi di domande e possono “dimenticare” come giudicare tipi di saggi precedenti quando esposti a nuovi. I grandi modelli linguistici come GPT-4 hanno mostrato potenziale, ma se usati direttamente faticano ancora a eguagliare i punteggi umani e tendono a fornire feedback generici e uniformi.

Costruire un Ricco Dataset di Scrittura IELTS

Per superare questi limiti, gli autori hanno prima creato un nuovo dataset privato di 5.088 saggi reali del Task 2 della scrittura IELTS scritti da studenti cinesi. Ogni saggio era corredato di punteggi forniti da insegnanti esperti di IELTS sulle quattro criteri ufficiali: Task Response, Coherence and Cohesion, Lexical Resource e Grammatical Range and Accuracy. Importante, gli insegnanti hanno anche fornito feedback di dettaglio che indicavano problemi come idee poco chiare, collegamenti goffi tra frasi o lessico debole, oltre a riscritture suggerite. Questa annotazione ricca va ben oltre i dataset pubblici tipici e costituisce la base per l’addestramento e la valutazione del nuovo sistema.

Un Allenatore di Scrittura Intelligente in Tre Fasi

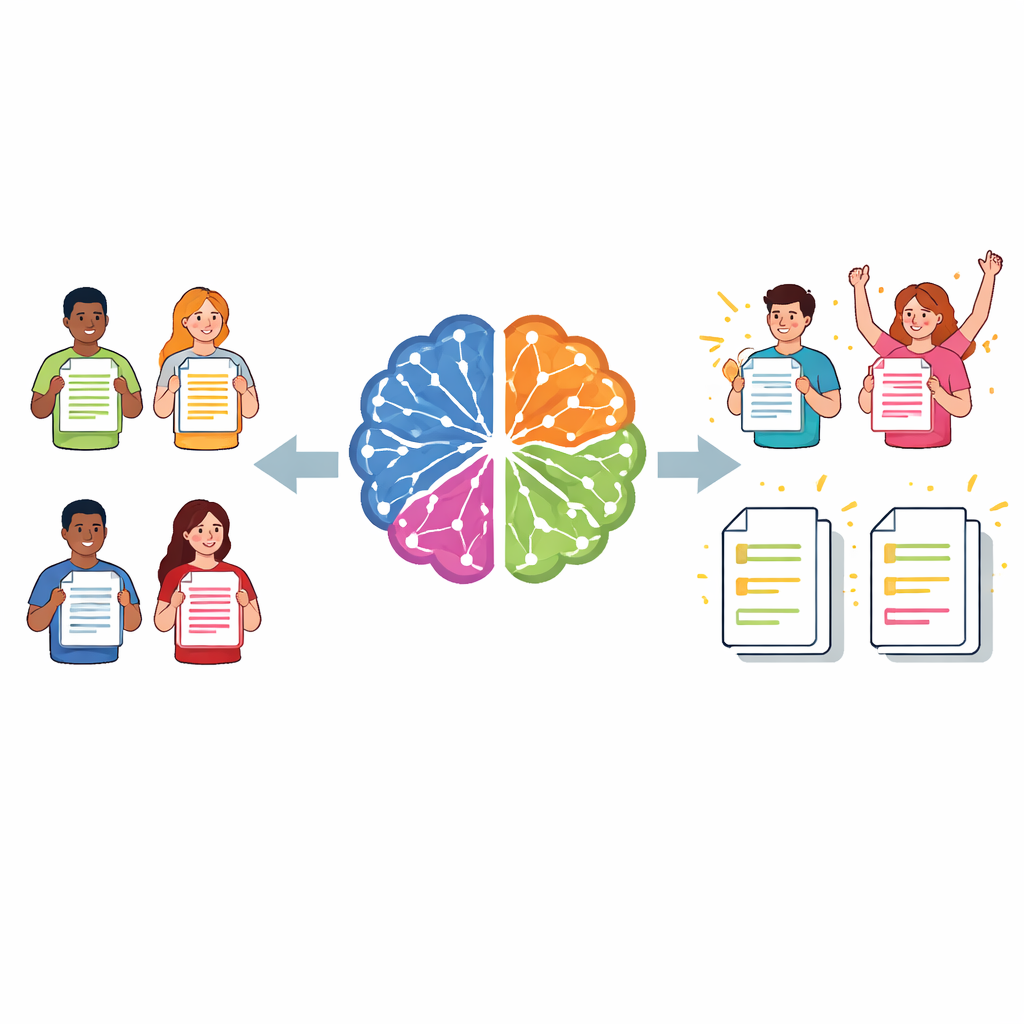

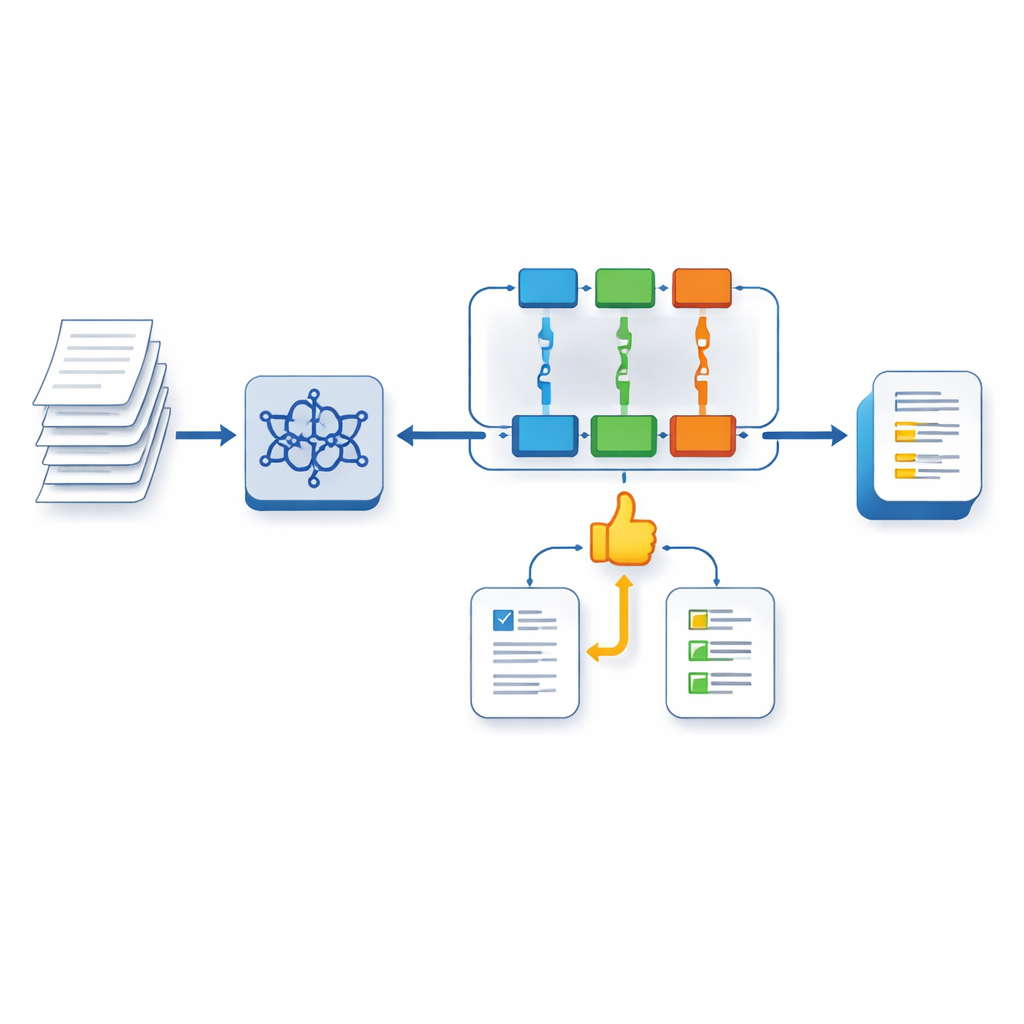

Il sistema proposto è costruito su LLaMA‑3, un moderno grande modello linguistico, migliorato usando un metodo di adattamento leggero chiamato Multi‑task LoRA. Nella prima fase, il modello viene addestrato a gestire più compiti contemporaneamente: per ogni saggio, prevede un punteggio per ciascuno dei quattro criteri IELTS e genera commenti mirati per ogni area. “Teste” separate si concentrano su ciascuna caratteristica, pur condividendo una comprensione comune del testo, il che aiuta il modello a evitare il consueto “catastrophic forgetting” quando affronta molti prompt diversi.

Insegnare all’IA a Valutare il Buon Feedback

Nella seconda fase, gli autori addestrano un modello di ricompensa separato che impara a giudicare la qualità del feedback confrontando i commenti generati dal modello con quelli scritti dagli insegnanti. Questo modello di ricompensa funge da sostituto degli esaminatori umani durante l’addestramento. Nella terza fase, il sistema principale viene ulteriormente raffinato usando un metodo di apprendimento per rinforzo noto come PPO. Qui il modello genera feedback, il modello di ricompensa valuta quanto quel feedback si allinea alle preferenze degli esperti, e il sistema adatta il proprio comportamento per avvicinarsi, attraverso molti cicli, a risposte di qualità superiore e più simili a quelle degli esaminatori.

Cosa Significano i Risultati per Studenti e Insegnanti

Nei test, il nuovo sistema ha raggiunto un accordo con i punteggi umani maggiore rispetto ad alternative potenti, incluso GPT‑4 con vari prompt, e ha prodotto feedback che misure automatiche e giudici umani hanno ritenuto più vicini ai commenti degli esperti. Sebbene i guadagni numerici in accuratezza della valutazione siano modesti, la forza reale del sistema risiede nel fornire consigli dettagliati, basati sulla rubrica e personalizzati, che somigliano a quanto scriverebbe un insegnante esperto. Per i candidati IELTS, questo approccio indica una strada verso un supporto alla scrittura accessibile e sempre disponibile che fa più che assegnare un punteggio: spiega il perché e come migliorare la volta successiva.

Citazione: Xu, W., Kassim, M.S.S. & Mahmud, R. Enhancing IELTS writing automated scoring with M-LoRA fine-tuned LLAMA-3 and human feedback-driven PPO reinforcement learning. Sci Rep 16, 10865 (2026). https://doi.org/10.1038/s41598-026-43318-w

Parole chiave: valutazione automatica dei saggi, scrittura IELTS, grandi modelli linguistici, feedback educativo, apprendimento per rinforzo