Clear Sky Science · fr

Améliorer le scoring automatisé de l’écriture IELTS avec LLAMA-3 affiné par M-LoRA et apprentissage par renforcement PPO guidé par retour humain

Pourquoi une aide plus intelligente pour les essais est importante

Pour des millions de personnes chaque année, l’examen IELTS peut ouvrir des portes pour étudier, travailler ou immigrer à l’étranger. Pourtant, de nombreux candidats rencontrent le plus de difficultés dans la partie écrite, où obtenir des retours clairs et fiables est difficile et où faire appel à des tuteurs humains peut être coûteux. Cet article explore une nouvelle façon d’utiliser l’intelligence artificielle non seulement pour noter les essais IELTS, mais aussi pour fournir des suggestions détaillées, proches de celles d’un humain, qui aident réellement les auteurs à s’améliorer, tout en restant étroitement alignées sur la façon dont les examinateurs réels évaluent.

Le défi de juger une production écrite

Évaluer la qualité d’un essai est plus compliqué que vérifier l’orthographe ou compter les mots. Les examinateurs humains regardent dans quelle mesure l’auteur répond à la question, la clarté de l’organisation des idées, la richesse et la précision du vocabulaire, ainsi que la correction et la variété grammaticale. Les systèmes de notation automatisée existants fonctionnent souvent bien uniquement sur des ensembles de questions étroits et fixes et peuvent « oublier » comment juger des types d’essais antérieurs lorsqu’ils sont exposés à de nouveaux. Les grands modèles de langage comme GPT‑4 ont montré des signes prometteurs, mais lorsqu’ils sont utilisés directement, ils peinent encore à égaler les notes humaines et tendent à fournir des retours génériques et standardisés.

Constituer un riche jeu de données d’écriture IELTS

Pour dépasser ces limites, les auteurs ont d’abord constitué un nouveau jeu de données privé de 5 088 essais réels de la tâche 2 de l’écriture IELTS rédigés par des apprenants chinois. Chaque essai était accompagné de notes de professeurs expérimentés d’IELTS sur les quatre critères officiels : Task Response, Coherence and Cohesion, Lexical Resource et Grammatical Range and Accuracy. Fait important, les enseignants ont également fourni des retours détaillés pointant des problèmes tels que des idées peu claires, des enchaînements maladroits entre phrases ou un vocabulaire faible, ainsi que des propositions de réécriture. Cette annotation riche va bien au‑delà des jeux de données publics habituels et sert de fondation pour l’entraînement et l’évaluation du nouveau système.

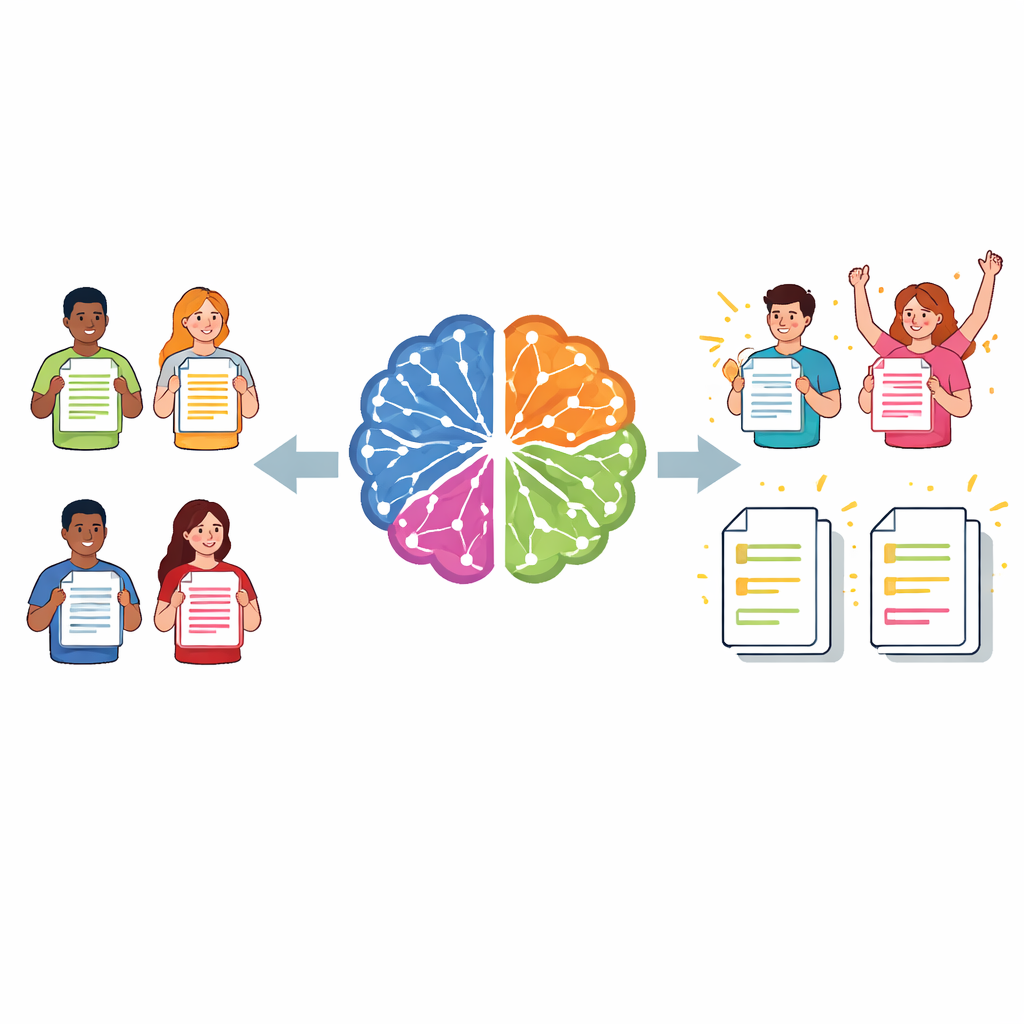

Un coach d’écriture intelligent en trois étapes

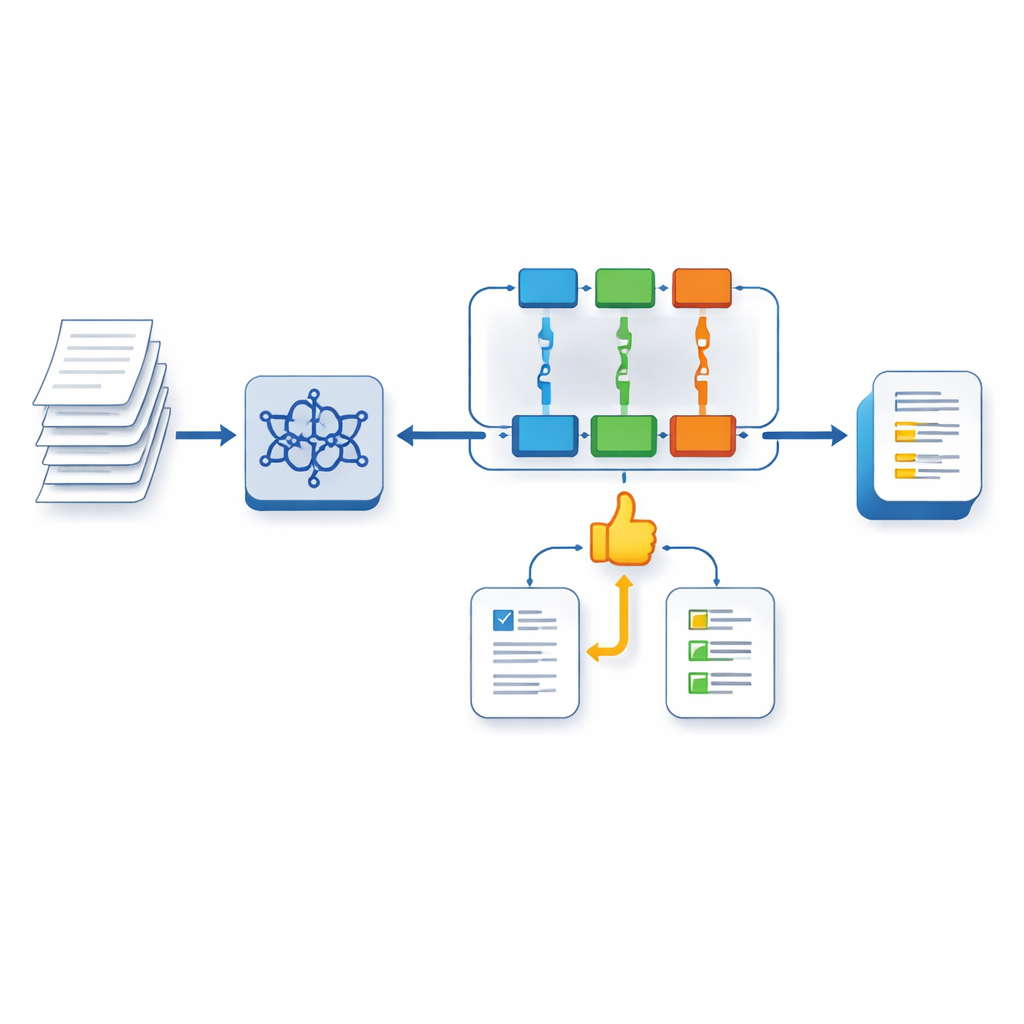

Le système proposé repose sur LLaMA‑3, un grand modèle de langage moderne, amélioré par une méthode d’ajustement légère appelée Multi‑task LoRA. Dans la première étape, le modèle est entraîné à traiter plusieurs tâches à la fois : pour un essai donné, il prédit une note (band score) pour chacun des quatre critères IELTS et génère des commentaires ciblés pour chaque domaine. Des « têtes » séparées se concentrent sur chaque trait, tout en partageant une compréhension commune du texte, ce qui aide le modèle à éviter le phénomène habituel d’« oubli catastrophique » lorsqu’il est confronté à de nombreuses consignes différentes.

Apprendre à l’IA à valoriser de bons retours

Dans la deuxième étape, les auteurs entraînent un modèle de récompense séparé qui apprend à juger la qualité même des retours en comparant les commentaires générés par le modèle avec ceux rédigés par des enseignants. Ce modèle de récompense joue le rôle d’un substitut aux examinateurs humains pendant l’entraînement. Dans la troisième étape, le système principal est affiné davantage en utilisant une méthode d’apprentissage par renforcement connue sous le nom de PPO. Le modèle génère des retours, le modèle de récompense évalue dans quelle mesure ces retours s’alignent sur les préférences des experts, et le système ajuste son comportement pour tendre, au fil de nombreux cycles, vers des réponses de meilleure qualité et plus proches de celles d’un examinateur.

Ce que signifient les résultats pour les apprenants et les enseignants

Lors des tests, le nouveau système a obtenu une meilleure concordance avec les notes humaines que des alternatives puissantes, y compris GPT‑4 sollicité de diverses façons, et a produit des retours que des mesures automatiques et des juges humains ont jugés plus proches des commentaires d’experts. Bien que les gains numériques en précision de notation soient modestes, la véritable force du système réside dans la fourniture de conseils détaillés, fondés sur une grille d’évaluation et personnalisés, qui ressemblent à ce qu’un enseignant compétent pourrait écrire. Pour les candidats à l’IELTS, cette approche ouvre la voie à un soutien à l’écriture abordable et disponible en permanence qui fait plus que donner un band score : elle explique pourquoi et comment s’améliorer la fois suivante.

Citation: Xu, W., Kassim, M.S.S. & Mahmud, R. Enhancing IELTS writing automated scoring with M-LoRA fine-tuned LLAMA-3 and human feedback-driven PPO reinforcement learning. Sci Rep 16, 10865 (2026). https://doi.org/10.1038/s41598-026-43318-w

Mots-clés: notation automatisée d’essais, écriture IELTS, grands modèles de langage, retour pédagogique, apprentissage par renforcement