Clear Sky Science · de

Verbesserung der automatisierten Bewertung des IELTS-Schreibens mit M-LoRA-feinabgestimmtem LLAMA-3 und durch menschliches Feedback gesteuertem PPO-Verstärkungslernen

Warum klügere Hilfe bei Aufsätzen wichtig ist

Für Millionen von Menschen eröffnet die IELTS-Prüfung jährlich Möglichkeiten zum Studium, Arbeiten oder zur Auswanderung ins Ausland. Viele Prüflinge haben jedoch am meisten Schwierigkeiten mit dem Schreibteil, in dem es schwer ist, klares und verlässliches Feedback zu bekommen, und Nachhilfe durch Menschen kostspielig sein kann. Diese Arbeit untersucht einen neuen Ansatz, künstliche Intelligenz nicht nur zur Bewertung von IELTS-Aufsätzen einzusetzen, sondern auch detaillierte, menschenähnliche Vorschläge zu liefern, die Schreibenden tatsächlich helfen, sich zu verbessern, und dabei eng an dem Denken echter Prüfer ausgerichtet bleiben.

Die Herausforderung der Beurteilung von Schreiben

Die Bewertung der Qualität eines Aufsatzes ist komplizierter als die Überprüfung von Rechtschreibung oder Wortzählung. Menschliche Prüfer schauen darauf, wie gut der Schreibende die Frage beantwortet, wie klar die Ideen organisiert sind, wie reich und genau der Wortschatz ist und wie korrekt und variantenreich die Grammatik erscheint. Bestehende automatisierte Bewertungssysteme funktionieren oft nur bei engen, festen Aufgabenstellungen gut und können „vergessen“, wie frühere Aufsatztypen zu beurteilen sind, wenn sie mit neuen konfrontiert werden. Große Sprachmodelle wie GPT‑4 haben Potenzial gezeigt, schlagen sich aber bei direkter Nutzung noch schwer, menschliche Bewertungen zu erreichen und tendieren dazu, generisches, einheitliches Feedback zu geben.

Aufbau eines umfassenden IELTS-Schreibdatensatzes

Um diese Grenzen zu überwinden, erstellten die Autoren zunächst einen privaten Datensatz mit 5.088 echten IELTS Writing Task 2-Aufsätzen chinesischer Lernender. Jeder Aufsatz wurde von erfahrenen IELTS-Lehrkräften nach den vier offiziellen Kriterien bewertet: Task Response, Coherence and Cohesion, Lexical Resource sowie Grammatical Range and Accuracy. Wichtig ist, dass die Lehrkräfte auch feingliedriges Feedback lieferten, das Probleme wie unklare Ideen, ungeschickte Verknüpfungen zwischen Sätzen oder schwachen Wortschatz benannte, sowie Vorschläge für Umschreibungen. Diese reichhaltige Annotation geht weit über typische öffentliche Datensätze hinaus und bildet die Grundlage für das Training und die Evaluation des neuen Systems.

Ein dreistufiger intelligenter Schreibcoach

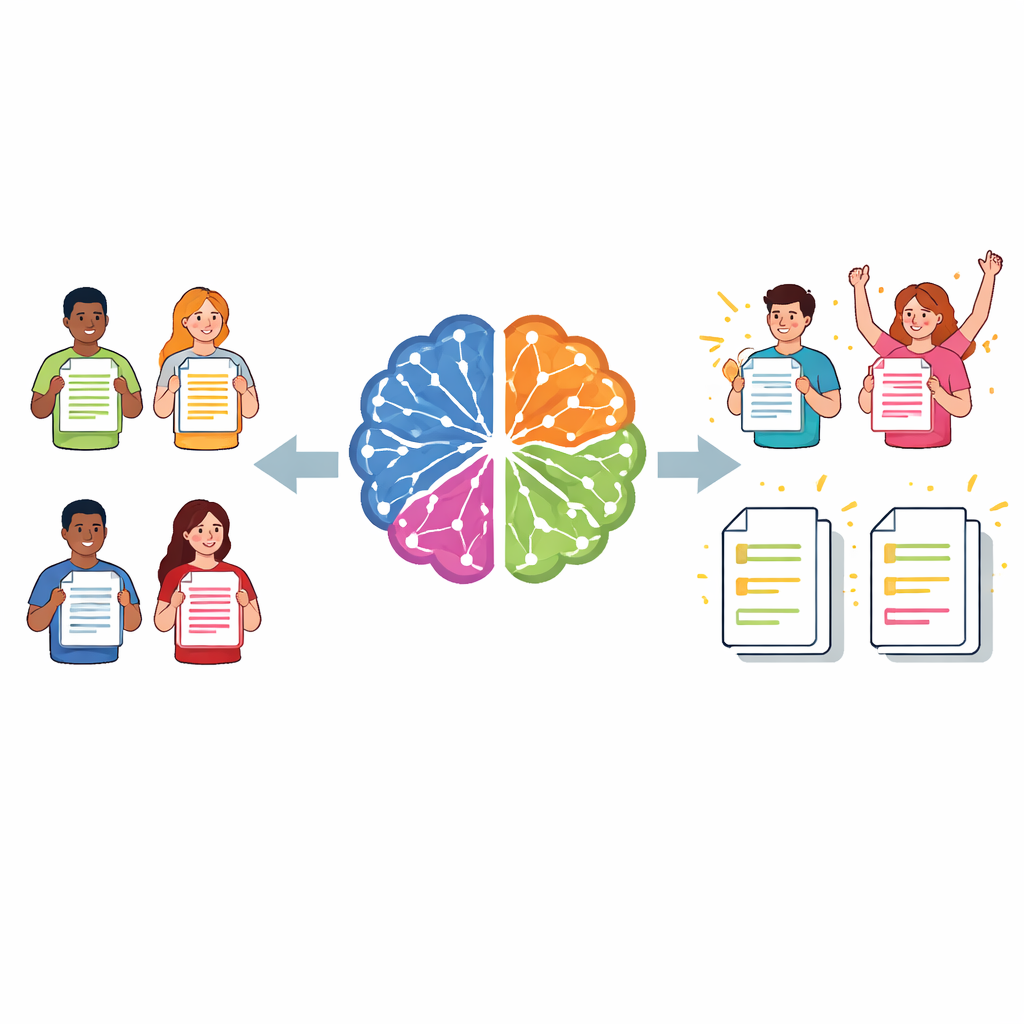

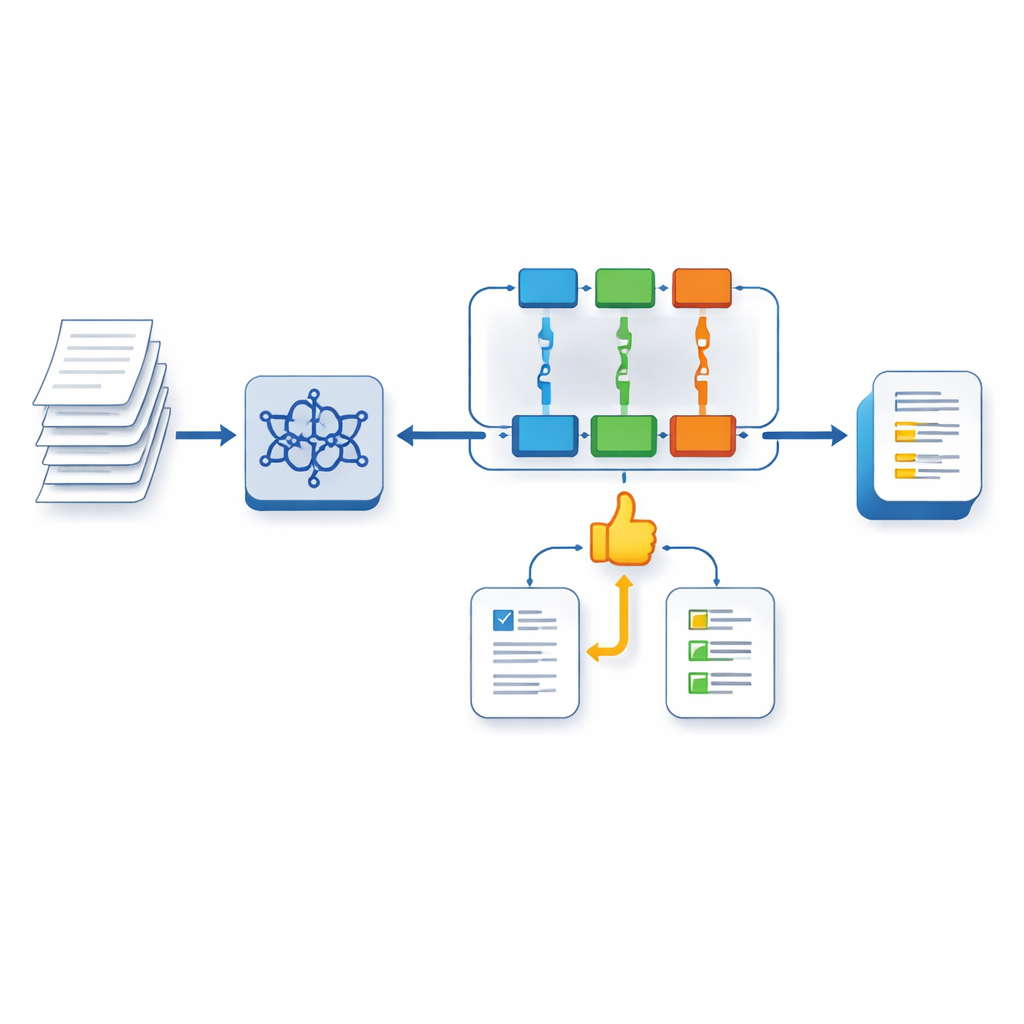

Das vorgeschlagene System basiert auf LLaMA‑3, einem modernen großen Sprachmodell, und wird mit einer leichten Feinabstimmungsmethode namens Multi‑task LoRA erweitert. Im ersten Schritt wird das Modell so trainiert, mehrere Aufgaben gleichzeitig zu bewältigen: Für einen gegebenen Aufsatz sagt es eine Bandwertung für jedes der vier IELTS-Kriterien voraus und erzeugt gezielte Kommentare für jeden Bereich. Getrennte „Köpfe“ konzentrieren sich auf jede Eigenschaft, während sie ein gemeinsames Textverständnis teilen, was dem Modell hilft, das übliche „katastrophale Vergessen“ bei vielen verschiedenen Aufforderungen zu vermeiden.

Dem KI beibringen, gutes Feedback zu schätzen

Im zweiten Schritt trainieren die Autoren ein separates Belohnungsmodell, das lernt, die Qualität von Feedback selbst zu beurteilen, indem es modellgenerierte Kommentare mit lehrerproduzierten vergleicht. Dieses Belohnungsmodell fungiert während des Trainings als Stellvertreter für menschliche Prüfer. Im dritten Schritt wird das Hauptsystem mithilfe einer als PPO bekannten Verstärkungslern-Methode weiter verfeinert. Dabei erzeugt das Modell Feedback, das Belohnungsmodell bewertet, wie gut dieses Feedback mit Expertenpräferenzen übereinstimmt, und das System passt sein Verhalten über viele Zyklen an, um qualitativ hochwertigere, prüferähnlichere Antworten zu liefern.

Was die Ergebnisse für Lernende und Lehrende bedeuten

Bei Tests erreichte das neue System eine höhere Übereinstimmung mit menschlichen Bewertungen als leistungsstarke Alternativen, einschließlich verschiedentlich gesteuerter GPT‑4-Ausgaben, und produzierte Feedback, das automatische Metriken und menschliche Bewerter als näher an Expertenkommentaren einschätzten. Während die numerischen Verbesserungen in der Bewertungsgenauigkeit moderat sind, liegt die eigentliche Stärke des Systems in der Bereitstellung detaillierter, rubrikbasierter und personalisierter Ratschläge, die dem ähneln, was eine erfahrene Lehrkraft schreiben würde. Für IELTS-Kandidaten deutet dieser Ansatz auf erschwingliche, jederzeit verfügbare Schreibunterstützung hin, die mehr leistet als eine Bandwertung — sie erklärt warum und wie man es beim nächsten Mal besser machen kann.

Zitation: Xu, W., Kassim, M.S.S. & Mahmud, R. Enhancing IELTS writing automated scoring with M-LoRA fine-tuned LLAMA-3 and human feedback-driven PPO reinforcement learning. Sci Rep 16, 10865 (2026). https://doi.org/10.1038/s41598-026-43318-w

Schlüsselwörter: automatisierte Aufsatzbewertung, IELTS Schreiben, große Sprachmodelle, pädagogisches Feedback, Verstärkungslernen