Clear Sky Science · es

TransSiamUNet: transformador que potencia un Siamese-U-Net para una detección de cambios precisa en imágenes satelitales

Observar la evolución de la Tierra desde arriba

Cada día, flotas de satélites fotografían silenciosamente nuestro planeta, capturando nuevas carreteras, edificios, inundaciones, incendios y bosques que se reducen. Convertir ese aluvión de píxeles en mapas claros y confiables de lo que ha cambiado sobre el terreno es crucial para planificadores urbanos, equipos de respuesta a desastres y científicos ambientales, pero también resulta sorprendentemente difícil. Este artículo presenta TransSiamUNet, un sistema de inteligencia artificial diseñado para rastrear pares de imágenes satelitales y resaltar con precisión lo que realmente ha cambiado, mientras ignora distracciones como nubes, sombras y cambios en la iluminación.

Por qué es tan difícil encontrar cambios reales

A primera vista, detectar cambios entre dos imágenes parece tan simple como restar una imagen de la otra. Los métodos tradicionales hacen justamente eso: comparan la luminosidad, toman razones de colores o miden la distancia entre valores de píxeles. Estos enfoques son rápidos y fáciles de implementar, pero son fácilmente engañados. Diferencias en la iluminación, la neblina, el ruido del sensor o un ligero desalineamiento pueden parecer cambios genuinos, mientras que desplazamientos pequeños pero importantes —como una casa nueva o una carretera estrecha— pueden abarcar solo unos pocos píxeles y pasar completamente desapercibidos. A medida que las imágenes satelitales se enriquecen, con muchas bandas espectrales y grandes extensiones, estas herramientas antiguas tienen dificultades para separar transformaciones significativas del ruido de fondo.

El aprendizaje profundo entra en escena

En los últimos años, el aprendizaje profundo ha transformado la teledetección al permitir que los ordenadores aprendan patrones directamente a partir de datos en lugar de depender de fórmulas diseñadas a mano. Redes neuronales convolucionales y pares "siameses" de redes se han entrenado para comparar dos imágenes del mismo lugar tomadas en distintos momentos. Arquitecturas como U-Net pueden convertir esas características aprendidas en mapas detallados que marcan cada píxel como "cambiado" o "sin cambiar". Más recientemente, los modelos transformadores —desarrollados originalmente para lenguaje— se han adaptado a imágenes, donde sobresalen capturando relaciones a larga distancia a través de una escena, por ejemplo cómo se relacionan edificios o campos distantes entre sí. Sin embargo, cada familia de modelos tiene debilidades: las redes siameses pueden perder la visión global, los transformadores puros pueden difuminar detalles finos, y muchos híbridos combinan partes sin explotar completamente sus fortalezas en conjunto.

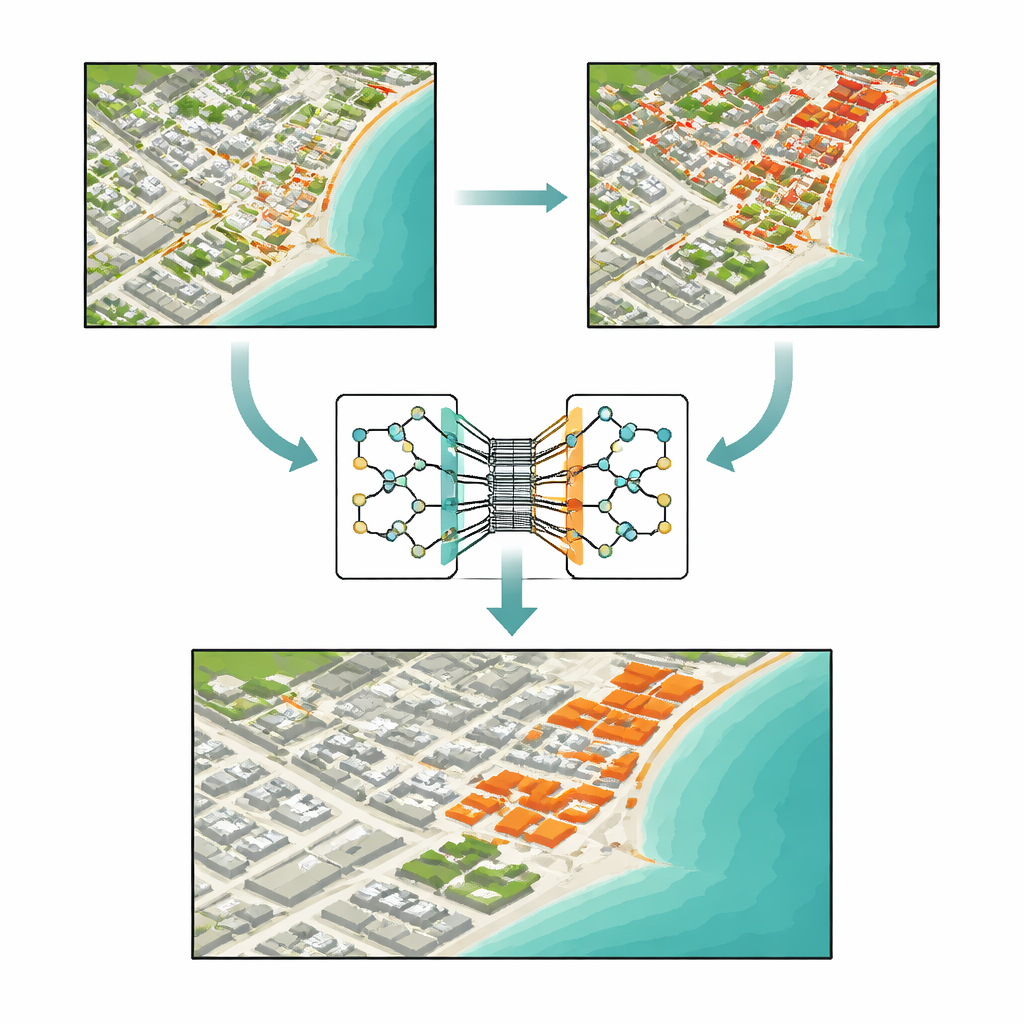

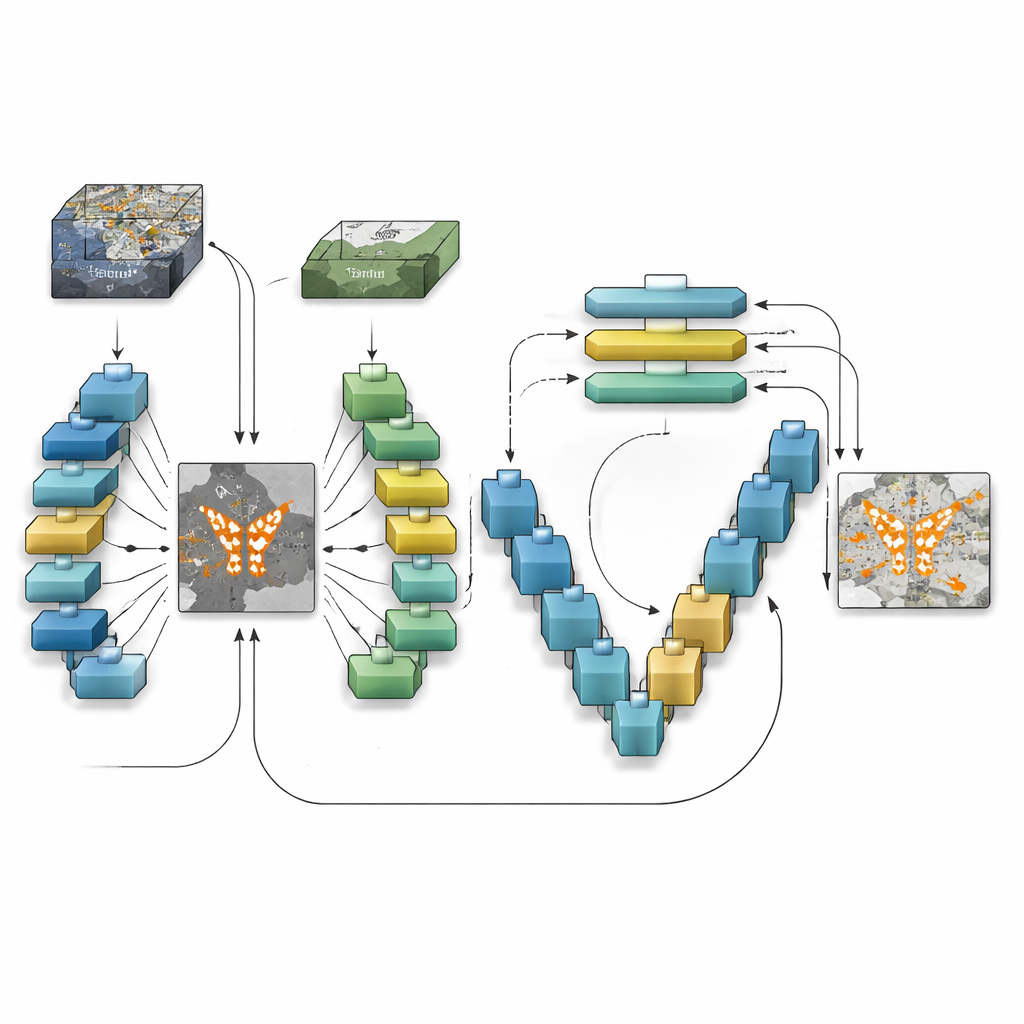

Cómo el nuevo modelo detecta el cambio

TransSiamUNet fue diseñado para combinar las mejores cualidades de estas ideas en un único sistema coordinado. Comienza con un codificador siamés: dos ramas neuronales idénticas que procesan las imágenes de "antes" y "después" de la misma manera, asegurando que las diferencias no sean causadas por el propio modelo. Sus salidas se restan para producir un "mapa de diferencias" focalizado que enfatiza dónde la escena podría haber cambiado. En lugar de alimentar las imágenes crudas en un transformador, los autores envían únicamente este mapa de diferencias a un bloque Vision Transformer. Esto anima al transformador a dedicar su atención a las estructuras que realmente están cambiando en lugar del fondo estático, ayudándole a entender cómo se relacionan regiones cambiadas distantes a lo largo de toda la imagen.

Volver a acercarse al nivel de píxel

Una vez que el transformador ha construido una comprensión global de los cambios candidatos, TransSiamUNet transmite esta información a un decodificador en forma de U. Este decodificador aumenta gradualmente la resolución de las características comprimidas hasta alcanzar la resolución completa, mientras incorpora detalles finos de capas anteriores mediante conexiones de salto. En efecto, el modelo combina una vista gran angular de toda la escena con contornos locales y nítidos de carreteras, edificios y campos. Los autores también experimentan con pasos de limpieza sencillos, como filtros morfológicos y suavizado probabilístico, para ordenar los límites de las áreas detectadas. Pruebas cuidadosas en tres conjuntos de referencia que abarcan diferentes ciudades, resoluciones y usos del suelo muestran que la combinación completa —codificador siamés, cuello de botella con transformador y decodificador tipo U-Net— supera a versiones que carecen de cualquiera de estas partes.

Demostrar que funciona en ciudades reales

Usando un conjunto de datos estándar llamado OSCD, junto con dos grandes colecciones centradas en cambios de edificios en Texas y Nueva Zelanda, los autores comparan TransSiamUNet frente a métodos tradicionales y de vanguardia en aprendizaje profundo. Bajo condiciones idénticas de entrenamiento y evaluación, el nuevo modelo alcanza una precisión de alrededor del 94% en OSCD, superando a competidores potentes que incluyen redes puramente convolucionales, sistemas basados en transformadores y modelos secuenciales más recientes. Estudios de caso detallados de Beirut —una ciudad en rápido crecimiento— y Valencia —una ciudad en gran medida estable— ilustran que el modelo puede tanto resaltar construcción intensa como informar con confianza "sin cambios" cuando el paisaje se mantiene estable. Experimentos de ablación, en los que se eliminan o alteran componentes, muestran que el rendimiento cae drásticamente sin el diseño siamés, el transformador o el decodificador multiescala, confirmando que su interacción —no solo el tamaño del modelo— impulsa las mejoras.

Qué significa esto para la vida en tierra

Para no especialistas, el resultado clave es que ahora disponemos de una forma más fiable de convertir imágenes satelitales en bruto en mapas de cambio precisos a nivel de píxel. TransSiamUNet puede detectar nuevos edificios, espacios verdes que desaparecen y la huella de inundaciones u otros desastres con mayor confianza y menos falsas alarmas que muchos sistemas anteriores. Eso lo convierte en una herramienta prometedora para agencias y organizaciones que necesitan información oportuna y confiable sobre cómo crecen las ciudades, cómo evoluciona la infraestructura y cómo responde el medio ambiente al estrés climático. A medida que las constelaciones satelitales se expanden y los archivos de imágenes se profundizan, enfoques como este —que combinan detalle local con contexto global— serán fundamentales para mantener una imagen clara y actualizada de nuestro planeta cambiante.

Cita: Ali, F., Labib, S.S., Mahmoud, A. et al. TransSiamUNet based transformer-augmented Siamese-U-Net for precise change detection in satellite imagery. Sci Rep 16, 11689 (2026). https://doi.org/10.1038/s41598-026-43164-w

Palabras clave: detección de cambios satelitales, IA en teledetección, monitoreo del crecimiento urbano, modelos de aprendizaje profundo, transformadores visuales