Clear Sky Science · de

Prototyp‑orientierter kontrastiver Mean‑Teacher für unüberwachte domänenadaptive Objekterkennung

Computern beibringen, Objekte an neuen Orten zu erkennen

Moderne KI‑Systeme können Autos, Menschen und Verkehrsschilder in Fotos mit beeindruckender Genauigkeit finden – bis sich die Szenerie ändert. Ein Detektor, der auf sonnigen Stadtstraßen trainiert wurde, kann bei Nebel, nachts oder in stilisierter Kunst versagen. Dieses Papier stellt eine neue Methode vor, den „Lehrer“ in solchen Systemen so zu „unterrichten“, dass sie sich ohne neue, von Menschen gezeichnete Boxen an neue Bedingungen anpassen können.

Warum Objektdetektoren bei veränderten Bedingungen Probleme haben

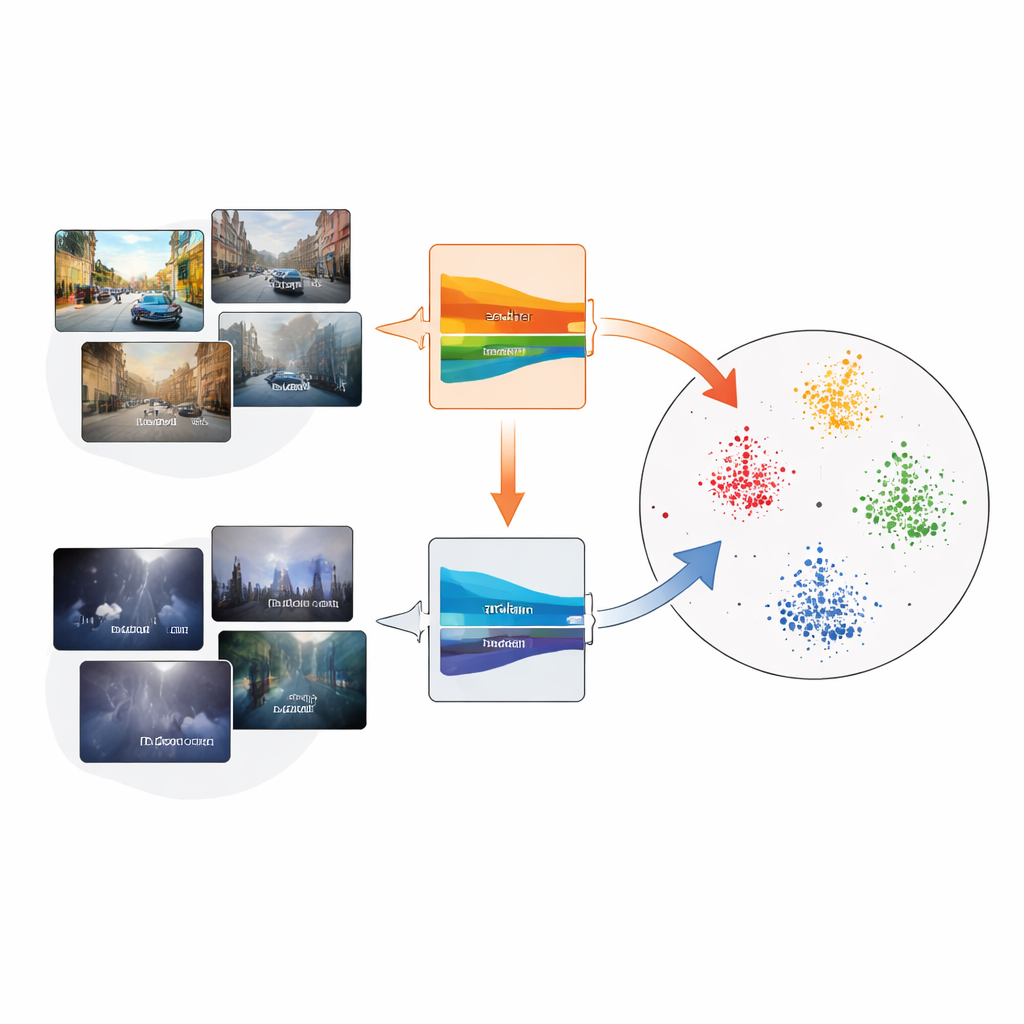

Objekterkennung beruht auf großen Sammlungen gelabelter Bilder, in denen jedes Auto, jeder Bus oder jedes Fahrrad sorgfältig umrahmt ist. In der Praxis stimmen Kamerabedingungen jedoch selten genau mit denen des Trainings überein. Verschiedene Wetter‑ oder Lichtverhältnisse oder unterschiedliche Kameratypen verändern das Aussehen von Objekten – ein Phänomen, das als Domänenverschiebung bekannt ist. In solchen Fällen können Detektoren, die in einer Domäne wie klaren Tagesverkehrsszenen trainiert wurden, in einer anderen, etwa nebligen Autobahnen oder nächtlichen Fahrten, stark fehlgehen. Neue Labels für jede Bedingung zu sammeln ist teuer, daher suchen Forscher nach Methoden, die Detektoren nur mit unlabeleten Daten aus der neuen Domäne anpassen.

Ein selbstlernendes System mit eingebautem Führer

Eine verbreitete Strategie lässt das Modell sich selbst unterrichten. Ein „Teacher“‑Netzwerk, das als geglättete Version eines „Student“‑Netzes gebaut ist, sagt Boxen in unlabeled Zielbildern voraus; diese Vorhersagen, sogenannte Pseudo‑Labels, trainieren dann den Student. Im Laufe der Zeit verbessert sich der Student und der Teacher wird als gleitendes Mittel der Gewichte des Students aktualisiert. Wenn frühe Pseudo‑Labels jedoch falsch sind – zum Beispiel weil Objekte bei dichtem Nebel fehlen – können sich Fehler verstärken. Die Autoren zeigen, dass sich drei Ideen kombinieren lassen, um dieses Selbsttraining zu stabilisieren: ein Mean‑Teacher‑Setup, kontrastives Lernen (das verwandte Merkmale zusammenzieht und andere auseinanderdrängt) und kompakte „Prototypen“, die jede Objektkategorie zusammenfassen.

Prototypen als Wegweiser im Merkmalsraum

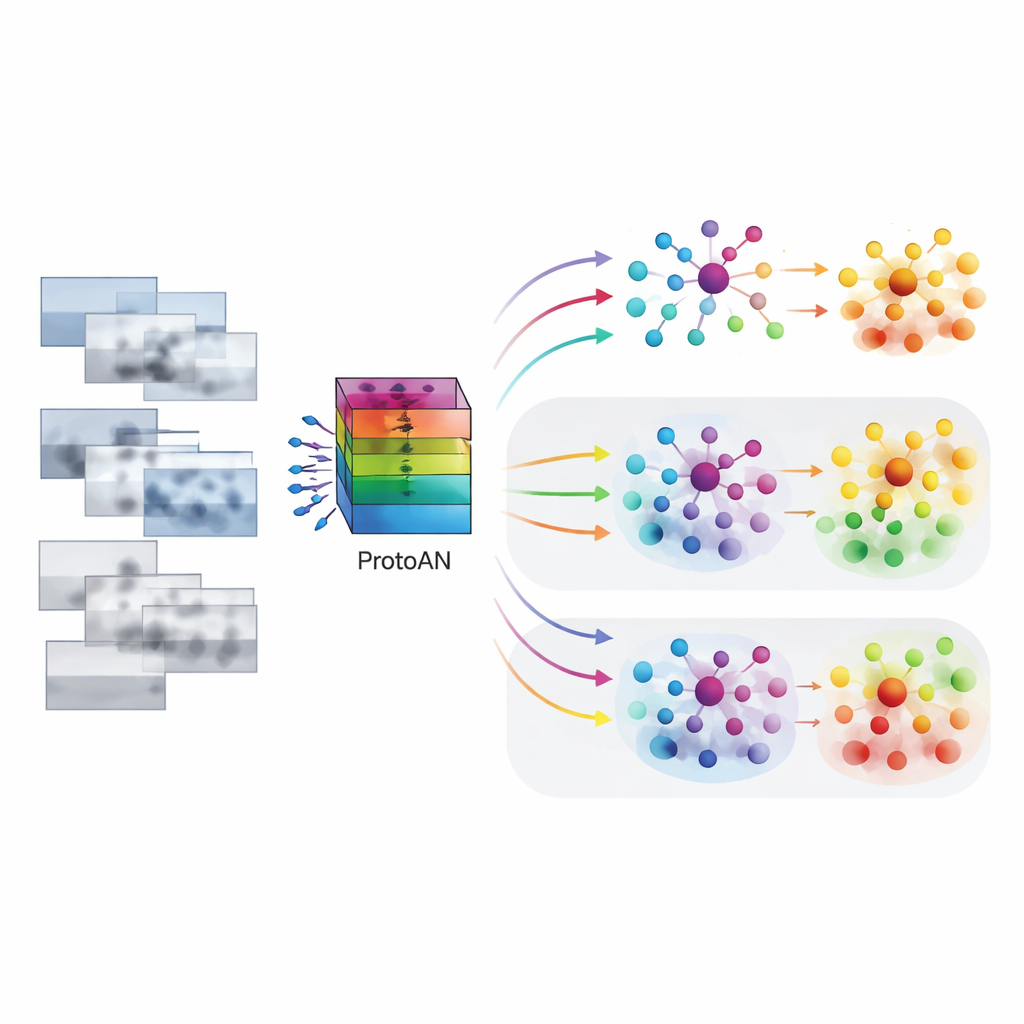

Der Kern des vorgeschlagenen PoCoMT‑Frameworks ist das Prototype Alignment Network, oder ProtoAN. Anstatt jedes Objekt mit jedem anderen zu vergleichen, lernt ProtoAN eine kleine Menge repräsentativer Punkte – Prototypen – für jede Kategorie, etwa Auto oder Fußgänger. Aus Bildregionen extrahierte Merkmale werden in einen speziellen Raum abgebildet, in dem Beispiele derselben Kategorie aus verschiedenen Domänen um ihren gemeinsamen Prototypen versammeln, während unterschiedliche Kategorien auseinandergehalten werden. Ein kontrastiver Verlust fördert dieses Clustering sowohl innerhalb einer einzelnen Domäne als auch zwischen Quell‑ und Ziel‑Domänen. Entscheidend ist, dass dieser Mechanismus sogar den Hintergrund als eigene Kategorie behandelt, was dem System hilft, echte Objekte von Störfaktoren zu unterscheiden.

Besserer Umgang mit unlabeled Daten

PoCoMT verbessert die Pseudo‑Labels des Teachers auf zwei Wegen. Erstens drängt ein Ziel der „Informationsmaximierung“ die Vorhersagen auf Zielbildern dazu, sowohl für jedes Objekt zuversichtlich als auch über Kategorien hinweg vielfältig zu sein, wodurch das triviale Verhalten vermieden wird, alles als dieselbe Klasse zu kennzeichnen. Zweitens verfeinert ProtoAN Pseudo‑Labels, indem Merkmale mit Prototypen verglichen werden, anstatt sich auf rohe Vorhersagen zu verlassen. Wenn die vorhergesagte Klasse einer Region nicht mit dem nächsten Prototyp übereinstimmt, kann das Label angepasst werden. Das macht das System toleranter gegenüber Rauschen: Selbst wenn die Autoren viele Pseudo‑Labels während des Trainings absichtlich verfälschten, degradierte PoCoMT weniger stark als konkurrierende Methoden.

Stärkere Detektoren für schwierige reale Szenen

Getestet auf einer breiten Palette von Benchmarks – darunter klare‑zu‑nebligen Straßen, synthetisch‑zu‑realen Verkehr, Tag‑zu‑Dämmerungsfahrten und realistische‑zu‑künstlerische Bilder – übertraf PoCoMT konsequent bestehende unüberwachte Domänenanpassungs‑Techniken, oft um mehrere Prozentpunkte in der Erkennungsgenauigkeit. In einigen Fällen übertraf es sogar Modelle, die direkt auf gelabelten Zieldaten trainiert wurden, dank seiner Fähigkeit, sowohl gelabelte Quellbilder als auch reichlich unlabeled Zielbilder zu nutzen. Für Nicht‑Spezialisten ist die Botschaft klar: Indem ein Objektdetektor seine eigenen inneren „Wegweiser“ für jede Kategorie organisiert und sorgfältig steuert, wie Teacher und Student Informationen austauschen, macht dieser Ansatz KI‑Visionsysteme robuster, wenn die Welt anders aussieht als die Trainingsdaten.

Zitation: Cao, Q., Tao, J., Dan, Y. et al. Prototype-oriented contrastive mean-teacher for unsupervised domain adaptive object detection. Sci Rep 16, 10869 (2026). https://doi.org/10.1038/s41598-026-44991-7

Schlüsselwörter: unüberwachte Domänenanpassung, Objekterkennung, Selbsttraining, kontrastives Lernen, Prototyp‑Lernen