Clear Sky Science · de

Synthetische, datengetriebene Deep Learning-Methoden für kennzeichnungsfreie autonome Rasterkraftmikroskopie

Die winzige Welt sehen ohne menschliche Augen

Unsere Fähigkeit, neue Materialien zu entwickeln, Geräte für saubere Energie zu untersuchen oder lebende Zellen zu erforschen, hängt oft davon ab, Strukturen zu sehen, die tausendmal kleiner sind als ein menschliches Haar. Rasterkraftmikroskope (AFMs) können diese winzigen Landschaften in 3D abbilden, doch heute sind sie noch stark auf Experten angewiesen, die entscheiden müssen, wo man hinschaut und wie die Bilder zu interpretieren sind. Dieser Artikel stellt SimuScan vor, eine Methode, mit der man Computern beibringt, AFMs zu steuern und nanoskalige Merkmale zu erkennen, indem man sie mit lebensecht simulierten Bildern statt mit mühsam beschrifteten experimentellen Daten trainiert.

Warum die nanoskalige Bildgebung heute ins Stocken gerät

AFMs sind zu zentralen Werkzeugen in der Materialwissenschaft, der Energieforschung und der Biologie geworden, weil sie Oberflächen mit Nanometerpräzision ertasten können. Dennoch sind sie langsam, erfassen jeweils nur kleine Bereiche und erfordern viele Entscheidungen eines versierten Anwenders: wo zu scannen ist, welche Einstellungen zu wählen sind und welche winzigen Formen wichtig sind. Anders als optische oder Elektronenmikroskope, die große Übersichtsaufnahmen liefern können, bauen AFMs Flächen Zeile für Zeile auf. Dazu gedeihen moderne Methoden der künstlichen Intelligenz auf enormen, beschrifteten Bildsammlungen wie für Alltagsfotos — solche Datensätze existieren für AFM-Bilder schlicht nicht. Jedes AFM-Bild wird von feinen Instrumenteneigenheiten beeinflusst — Rauschen, Verzerrungen und die Form der Sonde — sodass generische Computer-Vision-Tools, die auf gewöhnlichen Bildern trainiert wurden, bei direkter Anwendung oft versagen.

Ein Mikroskop mit erfundenen Bildern lehren

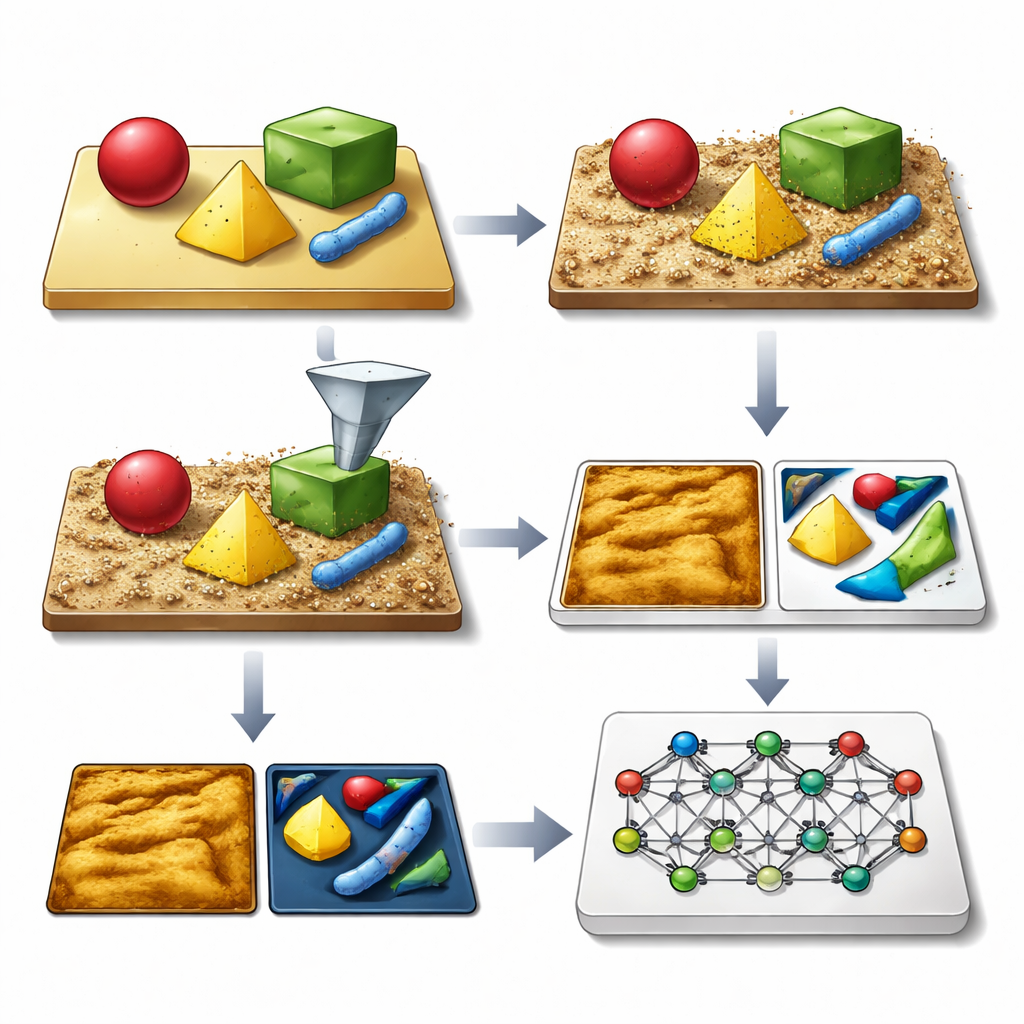

Die zentrale Idee der Autoren ist, umfangreiche Bibliotheken synthetischer AFM-Bilder zu erzeugen, die dem Realen in Aussehen und Verhalten sehr nahekommen, einschließlich aller typischen Unvollkommenheiten. Das SimuScan-Framework beginnt damit, die Formen zu definieren, die auf einer Probe erscheinen könnten: einfache Blöcke und Stäbe, filigrane DNA-Assemblies oder ganze Bakterienzellen. Diese Formen können aus mathematischen Beschreibungen, CAD-Dateien oder sogar 3D-Oberflächen gewonnen werden, die aus einigen realen AFM-Bildern extrahiert wurden. SimuScan platziert diese Objekte dann auf simulierten Substraten, die Stufen, Rauheiten, periodische Muster und zufällige Partikel enthalten können, und schafft so realistische, vorverzerrte Landschaften. Schließlich werden diese Oberflächen durch ein detailliertes Vorwärtsmodell des Mikroskops geführt, das die Effekte einer endlichen Spitzenform, Feedback-Glitches, zeilenweise Korrekturen und elektronische Störungen hinzufügt. Das Ergebnis ist ein Bild, das sehr genau das nachahmt, was ein AFM messen würde, gepaart mit einer exakten „Ground-Truth“-Karte der Umrisse jedes Objekts.

Von simulierten Pixeln zu verlässlicher KI

Da jedes synthetische Bild perfekte Beschriftungen für jedes Merkmal und jeden Pixel enthält, kann SimuScan moderne Deep-Learning-Modelle mit dem reichen Trainingsmaterial versorgen, das ihnen in der nanoskaligen Bildgebung normalerweise fehlt. Das Team testete mehrere gängige Architekturen — YOLOv8 für schnelle Objekterkennung, U-Net für detaillierte Konturen und Mask R-CNN für instanzspezifische Masken — und verwendete dafür mehr als 5.000 synthetische Bilder pro Aufgabe. Bemerkenswerterweise schnitten Modelle, die ausschließlich auf diesen künstlichen Datensätzen trainiert wurden, auch bei der Auswertung an realen AFM-Bildern von gefertigten Nanostrukturen und Bakterien, die von Experten mühsam annotiert worden waren, gut ab. Erkennungsmetriken und Segmentierungsgenauigkeit waren über verschiedene Formen und Zelltypen hinweg hoch, was zeigt, dass die simulierten Bilder das wesentliche Erscheinungsbild dieser winzigen Strukturen und ihrer typischen Bildgebungsartefakte erfasst hatten.

Das Mikroskop entscheiden lassen, wohin es schauen soll

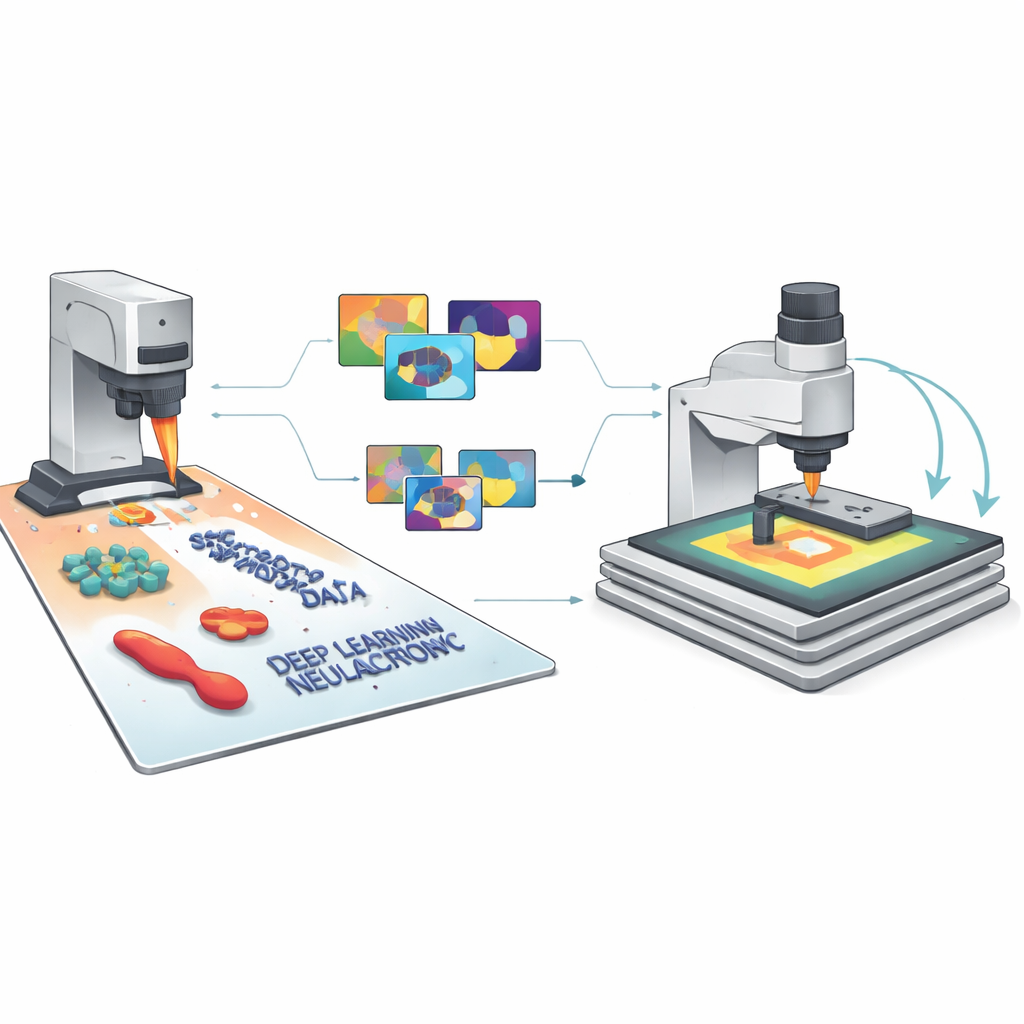

Die Forschenden schlossen dann den Kreis zwischen Simulation, KI und dem physischen Instrument. In ihrem semi-autonomen Arbeitsablauf nimmt das AFM zunächst einen niedrig aufgelösten Übersichts-Scan über ein relativ großes Gebiet auf. Ein mit SimuScan-Daten trainiertes Modell analysiert dieses Bild in Echtzeit, findet interessante Strukturen — etwa bestimmte bakterielle Formen oder spezifische nanofabrikationsbedingte Muster — und wählt vielversprechende Regionen für vergrößerte, hochaufgelöste Scans aus. Das Mikroskop bewegt sich automatisch, scannt erneut und wiederholt diesen Zyklus über die Probe, gesteuert von einfachen, nutzerdefinierten Regeln wie der gewünschten Anzahl an Objekten oder der abzudeckenden Gesamtfläche. Mit diesem Ansatz konnte das System autonom Hunderte einzelner Bakterien finden und abbilden und dann Variationen in Größe und Form innerhalb einer Population messen — etwas, das von Hand unvertretbar zeitaufwendig wäre.

Ein neuer Weg zu intelligenteren Mikroskopen

Für Nicht-Spezialisten lautet die Kernbotschaft, dass SimuScan zeigt, wie „imaginäre, aber realistische“ Daten Mikroskope zu selbstfahrenden Instrumenten machen können. Indem sowohl die winzigen Objekte auf einer Oberfläche als auch die Eigenheiten der AFM-Bildgebung simuliert werden, beseitigen die Autoren die Notwendigkeit großer, manuell beschrifteter Trainingsdatensätze und ermöglichen es allgemeinen KI-Modellen, gut auf realen Experimenten zu funktionieren. Das öffnet AFM-Studien, die größere Bereiche erkunden, viel mehr Objekte analysieren und ihr Verhalten in Echtzeit anpassen können — wodurch nanoskalige Charakterisierung schneller, reproduzierbarer und für Nicht-Experten zugänglicher wird. Langfristig könnten ähnliche Strategien mit synthetischen Daten dazu beitragen, autonome, entdeckungsgetriebene Betriebsweisen auf viele andere Arten wissenschaftlicher Instrumente zu übertragen.

Zitation: Millan-Solsona, R., Checa, M., Brown, S.R. et al. Synthetic data-driven deep learning for label-free autonomous atomic force microscopy. Nat Commun 17, 3886 (2026). https://doi.org/10.1038/s41467-026-70421-3

Schlüsselwörter: Rasterkraftmikroskopie, synthetische Daten, Deep Learning, autonome Mikroskopie, Nanostrukturabbildung