Clear Sky Science · zh

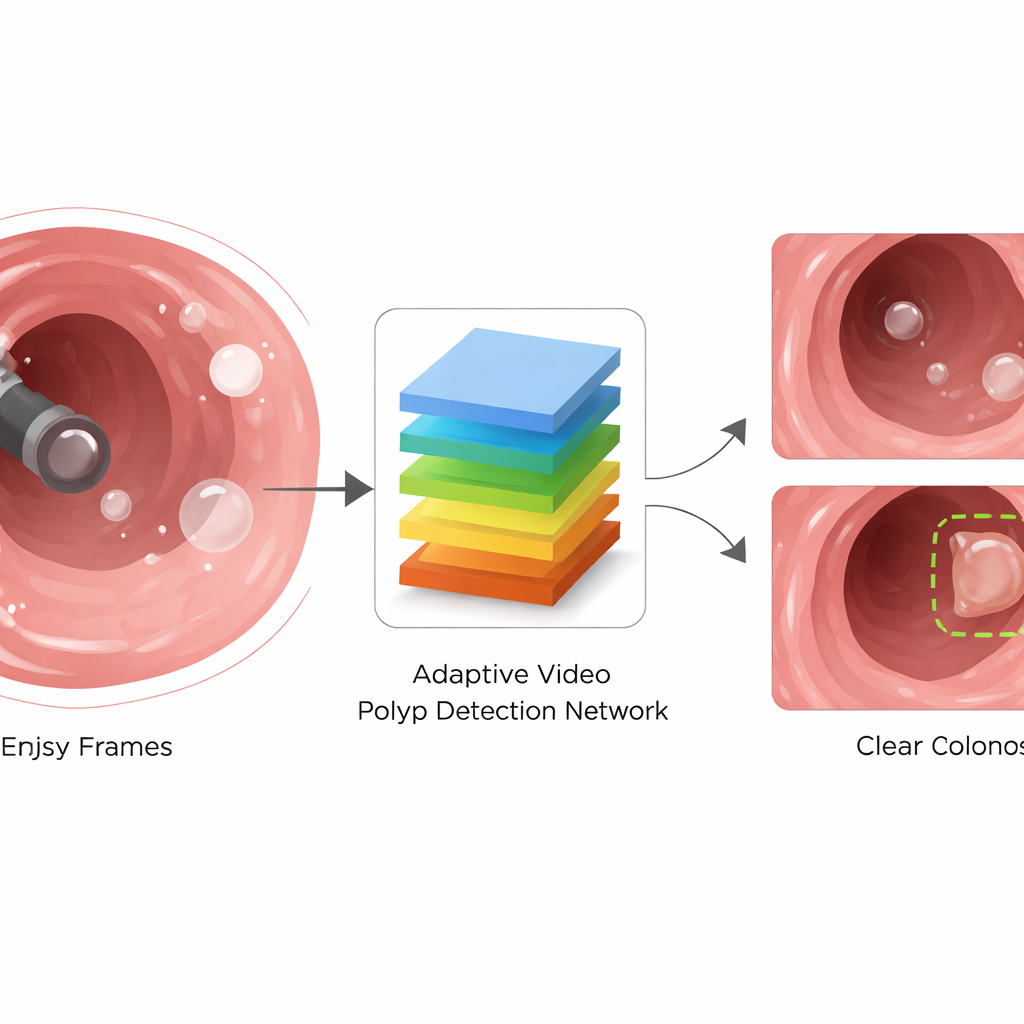

AVPDN:在动态结肠镜帧中学习运动鲁棒与尺度自适应的息肉检测表征

为何发现微小病变至关重要

大多数结直肠癌始于肠道黏膜上的小型增生物,即息肉。医生在结肠镜检查过程中试图找到并切除这些息肉,以防其发展为危险病变。现代内镜视频能够完整记录检查过程,但摄像头移动迅速,画面常常模糊或有反光,且息肉可能非常小、难以辨认。本文提出了一种新的计算机系统,能够从真实结肠镜视频的视觉混乱中学习识别信息,帮助医生在实时条件下更准确地发现更多息肉。

移动摄像头带来的挑战

结肠镜检查不同于拍摄静态照片——更像是在体内进行一个摇晃、近距离的探索。随着镜头推进,摄像机会抖动和旋转,肠壁收缩,液体和气泡在镜头前翻滚。这些运动造成运动模糊、强烈的白色反光,以及同一结构在相邻帧中尺寸突变。小息肉与周围的黏膜褶皱可能几乎无法区分,而且可能短暂被气泡或眩光遮挡。大多数现有的计算机视觉系统最初为自然照片或常规视频设计,那里的摄像头更稳定、目标更易与背景分离,因此在这种极端场景下表现欠佳。

一种更智能的结肠镜视频读取方式

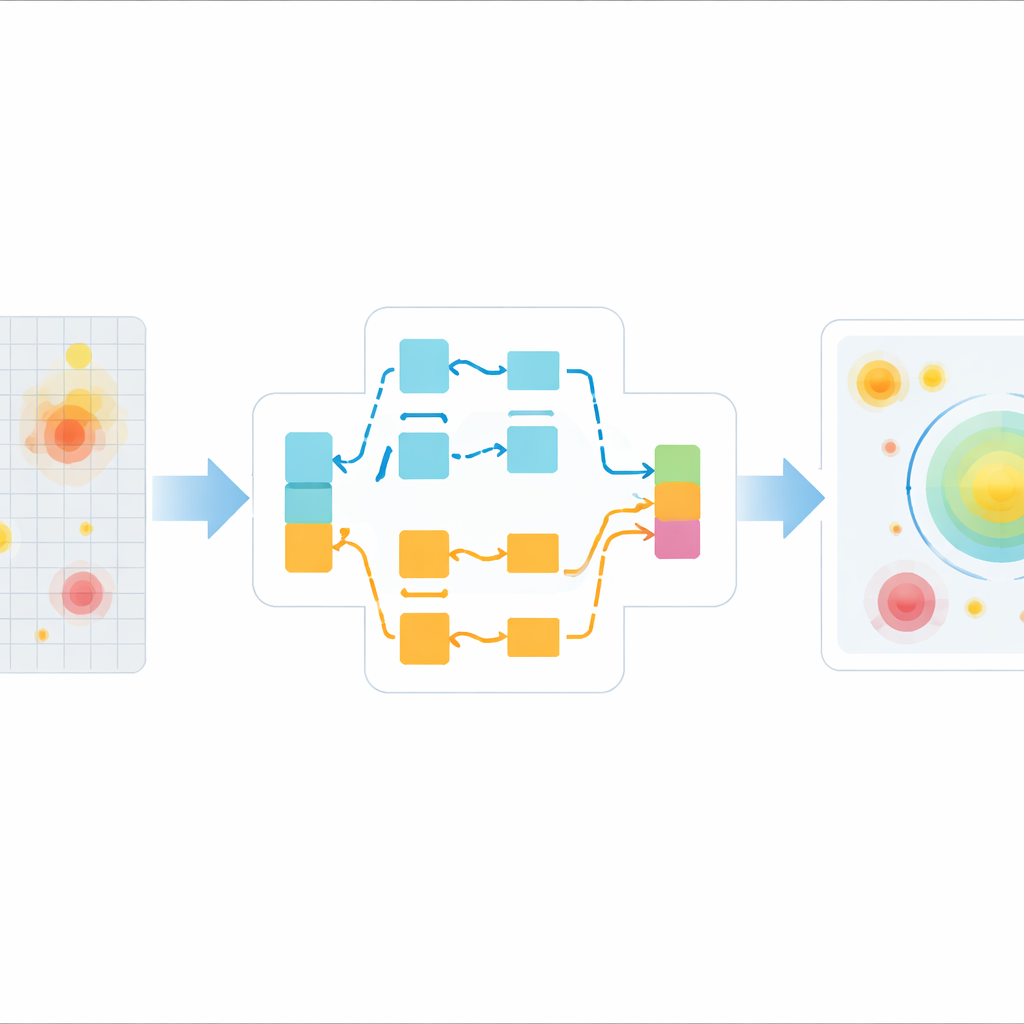

为应对这些问题,作者提出了自适应视频息肉检测网络(Adaptive Video Polyp Detection Network,AVPDN)。AVPDN 的核心是将每帧视频视作图像,先通过标准特征提取器捕捉边缘、纹理和颜色。但它并不止步于此,而是增加了一个专为结肠镜设计的“增强”阶段。该阶段由可重复的模块构成,用以清理噪声信号、强化真正的息肉样式,并跟踪多种尺度的息肉。重要的是,该方法按帧工作,无需分析长时间的视频序列,从而保证了系统在实时应用中的速度。

在保留重要线索的同时过滤噪声

第一个关键构件称为自适应特征交互与增强(Adaptive Feature Interaction and Augmentation)。通俗地说,它同时以两种不同方式观察图像特征。一个分支关注图像的全局关联,有助于理解整体场景并不漏掉远处的息肉线索。另一分支更具选择性:对显示出弱或不一致模式的图像区域(如模糊与眩光)进行强烈抑制。系统随后学习在每帧应当多大程度地信任每个分支,并自适应地融合它们。一个巧妙的“通道混洗”步骤在不同特征组之间混合信息,促使网络发现更丰富的纹理与形状组合,从而将真实息肉与无害褶皱或斑点区分开来。

在多种尺度上识别息肉

第二个关键模块称为尺度感知的上下文整合(Scale-Aware Context Integration)。当摄像头距离较远时,息肉可能非常小;当镜头靠近时,它们又会显著变大,因此系统必须在广泛的尺度范围内工作。该模块同时通过多种“虚拟镜头”观察场景——有些聚焦细节,有些捕捉更宽阔的邻域。通过使用扩张滤波器以在不损失分辨率的情况下覆盖更远的视觉范围,模块既收集局部细节又获取广域上下文。随后将这些视角融合,使网络能够稳健地突出那些夹在褶皱间的微小息肉,以及在视野中占主导的大型病变,即便摄像头移动迅速也能如此。

系统的性能如何

研究者在两个大型公开结肠镜视频数据集中测试了 AVPDN,这些数据集包含来自许多患者的数万帧影像,息肉在形状、大小和外观上各异。他们将该方法与广泛使用的目标检测器及若干专门的息肉系统进行了比较。在所有关键指标上——息肉被正确发现的频率、避免误报的能力,以及系统在这两者之间的平衡——AVPDN 均稳定领先。相比强大的现代基线方法,其主要准确度指标提升了数个百分点,同时在当前图形硬件上仍能实现实时运行。仔细的内部消融实验表明,这两个新模块各自对性能提升都有明显贡献。

这对患者意味着什么

简单来说,这项工作表明可以训练出一种 AI 系统,能够透过结肠镜视频中的模糊、反光和快速尺度变化识别息肉的典型模式。通过在网络内部清理与重新加权视觉信息,而不是依赖额外传感器或更慢的长时段视频分析,AVPDN 在减少漏检和误报方面均有改进。如果将此类技术集成到临床工具中,它可以作为手术过程中的第二双眼,帮助医生更早、更可靠地发现微小病变,从而降低危险息肉被遗漏的风险。

引用: Chen, Z., Lu, S. AVPDN: learning motion-robust and scale-adaptive representations for polyp detection in dynamic colonoscopy frames. Sci Rep 16, 11591 (2026). https://doi.org/10.1038/s41598-026-42286-5

关键词: 结肠镜检查, 息肉检测, 医学影像人工智能, 视频分析, 结直肠癌筛查