Clear Sky Science · de

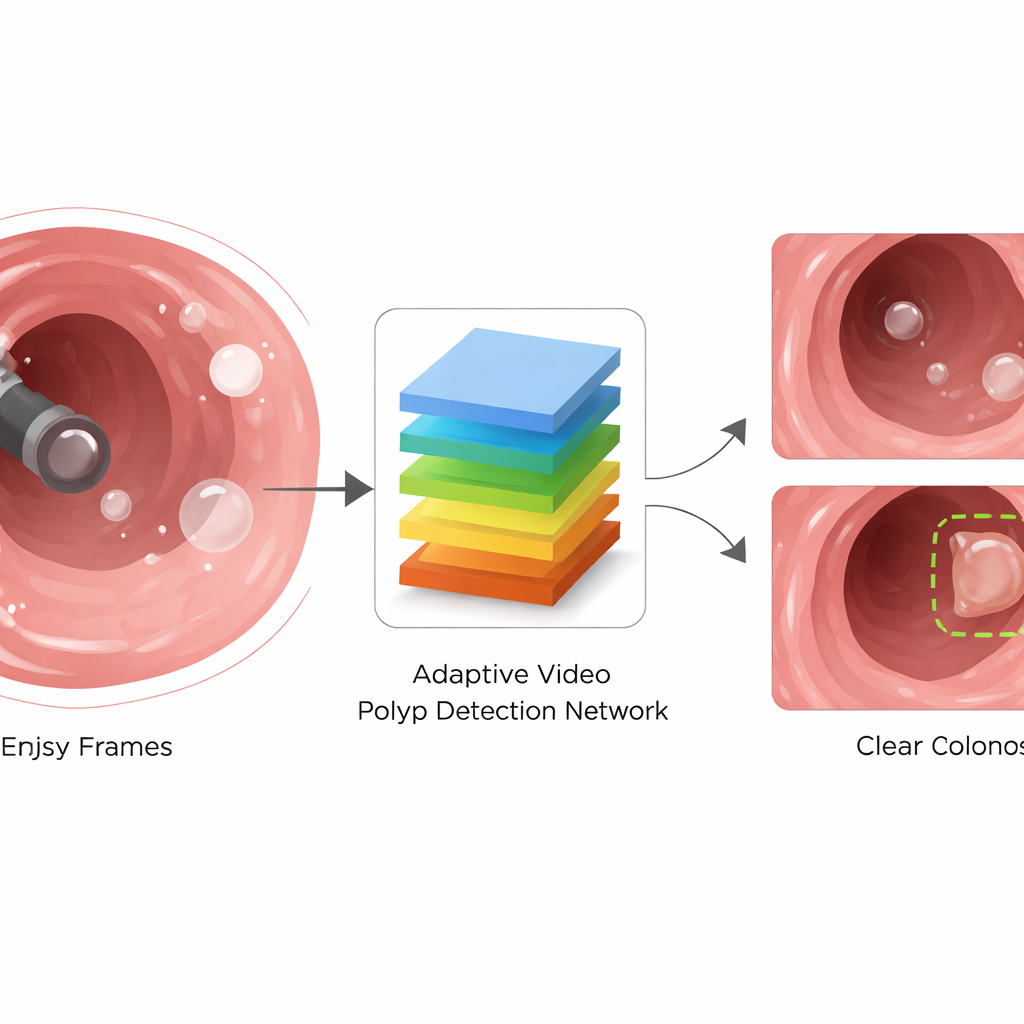

AVPDN: Erlernen bewegungsrobuster und skalenadaptiver Repräsentationen zur Polypenerkennung in dynamischen Koloskopie‑Frames

Warum das Finden winziger Wucherungen wichtig ist

Die meisten kolorektalen Tumore beginnen als kleine Wucherungen, sogenannte Polypen, an der Darmschleimhaut. Bei einer Koloskopie versuchen Ärztinnen und Ärzte, diese Polypen zu erkennen und zu entfernen, bevor sie gefährlich werden. Moderne Videoendoskope zeichnen alles auf, aber die Kamera bewegt sich schnell, das Bild ist oft verwischt oder glänzt, und Polypen können winzig und schwer zu sehen sein. Diese Arbeit stellt ein neues computergestütztes System vor, das lernt, sich durch das visuelle Chaos realer Koloskopievideos hindurchzusehen und Ärztinnen und Ärzten in Echtzeit dabei zu helfen, mehr Polypen zuverlässig zu finden.

Die Herausforderung einer bewegten Kamera

Koloskopie ist nicht wie das Fotografieren eines stillen Motivs – eher wie das Filmen einer wackeligen Nahaufnahme im Körper. Während das Gerät vorrückt, wackelt und rotiert die Kamera, die Darmwand kontrahiert, und Flüssigkeiten sowie Luftblasen wirbeln vor dem Objektiv herum. Diese Bewegungen erzeugen Bewegungsunschärfe, helle Reflexionen und plötzliche Änderungen in der scheinbaren Größe derselben Struktur von einem Frame zum nächsten. Kleine Polypen können fast identisch mit umgebenden Schleimhautfalten wirken und kurzzeitig hinter Blasen oder Blendungen verschwinden. Die meisten existierenden Computer‑Vision‑Systeme sind ursprünglich für natürliche Fotos oder normale Videos entwickelt worden, in denen die Kamera stabiler ist und Objekte leichter vom Hintergrund trennbar sind – daher haben sie in diesem extremen Umfeld Probleme.

Eine intelligentere Methode zur Auswertung von Koloskopievideos

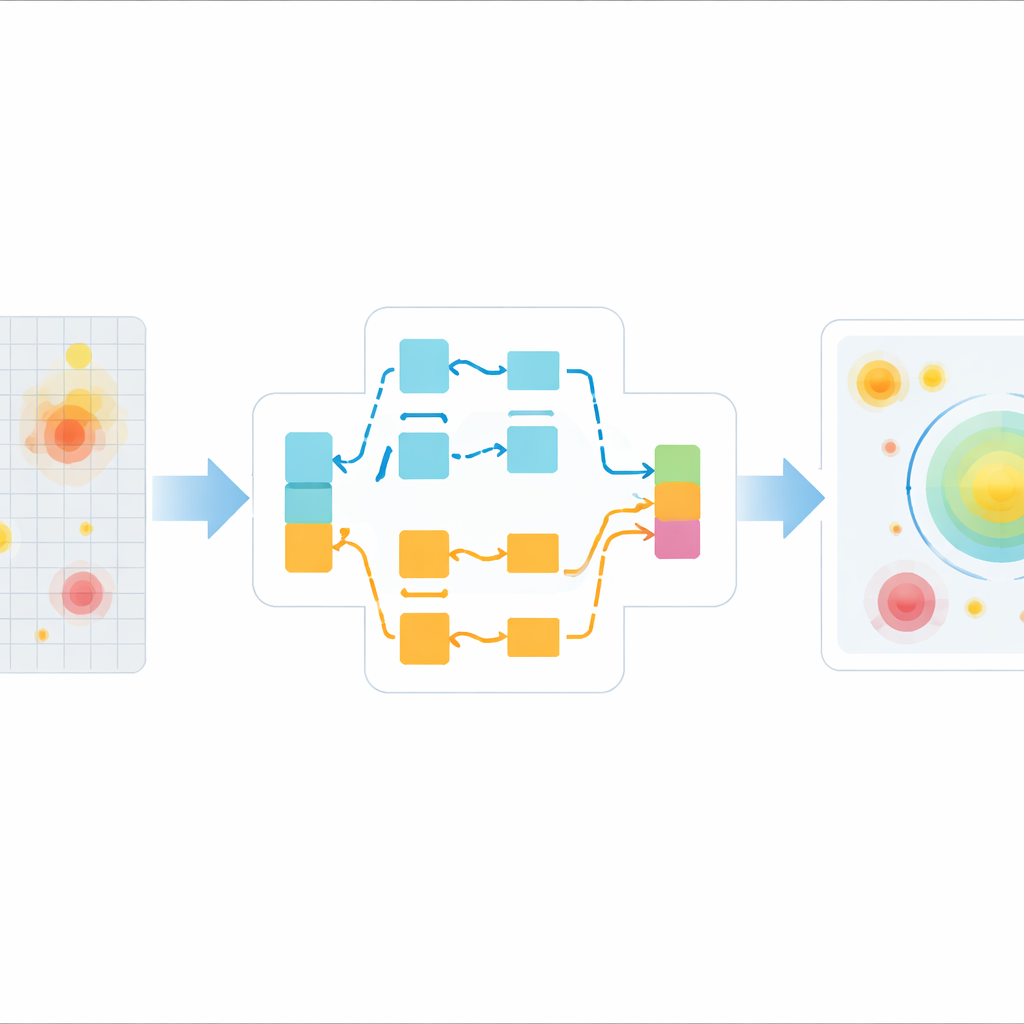

Um mit diesen Problemen zurechtzukommen, schlagen die Autoren das Adaptive Video Polyp Detection Network (AVPDN) vor. Kernstück von AVPDN ist, dass jeder Videoframe wie ein Bild behandelt und durch einen standardmäßigen Feature‑Extractor geleitet wird, der Kanten, Texturen und Farben erfasst. Statt hier aufzuhören, fügt das System jedoch eine spezielle „Enhancement“-Stufe hinzu, die gezielt für die Koloskopie entwickelt wurde. Diese Stufe besteht aus wiederholbaren Blöcken, die rauschende Signale bereinigen, wirklich polypartige Muster verstärken und Polypen in vielen verschiedenen Größen verfolgen. Wichtig ist, dass die Methode Frame für Frame arbeitet, ohne lange Videosequenzen über die Zeit analysieren zu müssen, was das System schnell genug für den Echtzeiteinsatz macht.

Rauschen filtern und wichtige Hinweise bewahren

Der erste zentrale Baustein heißt Adaptive Feature Interaction and Augmentation. Einfach ausgedrückt betrachtet er die Bildmerkmale gleichzeitig auf zwei verschiedene Weisen. Ein Zweig berücksichtigt weite Zusammenhänge über das gesamte Bild hinweg, wodurch das System die Gesamtszene besser einordnen und entfernte Hinweise auf einen Polypen nicht übersehen kann. Der andere Zweig ist selektiver: Er dämpft aggressiv Bildregionen mit schwachen oder inkonsistenten Mustern, wie Unschärfe und Blendung. Das System lernt dann für jeden Frame, wie viel Vertrauen es jedem Zweig schenkt, und mischt diese adaptiv. Ein geschickter „Channel‑Shuffle“-Schritt vermischt Informationen zwischen verschiedenen Gruppen von Merkmalen und regt das Netzwerk dazu an, reichere Kombinationen aus Textur und Form zu entdecken, die echte Polypen von harmlosen Falten und Flecken unterscheiden.

Polypen in vielen Größen erkennen

Der zweite zentrale Block heißt Scale‑Aware Context Integration. Polypen können sehr klein wirken, wenn die Kamera weiter entfernt ist, und deutlich größer, wenn das Endoskop nah herankommt; das System muss deshalb über ein weites Größenspektrum funktionieren. Dieses Modul betrachtet die Szene gleichzeitig durch mehrere „virtuelle Linsen“ – einige fokussieren feine Details, andere erfassen ein weiteres Umfeld. Durch den Einsatz dilatierter Filter, die weiterreichende Zusammenhänge aufnehmen, ohne Auflösung zu verlieren, sammelt das Modul sowohl lokale Details als auch breiteren Kontext. Anschließend kombiniert es diese Perspektiven, sodass das Netzwerk zuverlässig winzige Polypen zwischen Falten ebenso hervorheben kann wie größere Läsionen, die das Sichtfeld dominieren, selbst wenn sich die Kamera schnell bewegt.

Wie gut das System abschneidet

Die Forscher testeten AVPDN an zwei großen öffentlichen Sammlungen von Koloskopievideos, die zehntausende Frames von vielen Patientinnen und Patienten enthalten, mit Polypen unterschiedlicher Form, Größe und Erscheinung. Sie verglichen ihre Methode mit weit verbreiteten Objektdetektoren und mehreren spezialisierten Polypensystemen. In allen wichtigen Messgrößen – wie oft Polypen korrekt gefunden werden, wie häufig Fehlalarme vermieden werden und wie gut das System diese beiden Ziele ausbalanciert – schnitt AVPDN durchgehend am besten ab. Es verbesserte den Hauptgenauigkeitswert um einige Prozentsatzpunkte gegenüber starken modernen Baselines, während es weiterhin schnell genug für Echtzeitanwendungen auf aktueller Grafikhardware lief. Sorgfältige interne Tests zeigten, dass jeder der beiden neuen Module merklich zu diesem Vorsprung beitrug.

Was das für Patientinnen und Patienten bedeutet

Kurz gesagt zeigt diese Arbeit, dass ein KI‑System darauf trainiert werden kann, Blur, Blendung und schnelle Größenänderungen zu übersehen, die Koloskopievideos so schwierig machen, und sich stattdessen auf die charakteristischen Muster von Polypen einzustellen. Indem visuelle Informationen im Netzwerk bereinigt und neu gewichtet werden, statt auf zusätzliche Sensoren oder langsamere Videoanalyse zu bauen, erkennt AVPDN mehr Polypen mit weniger Fehlverschmähungen und Fehlalarmen. Wenn diese Technologie in klinische Werkzeuge integriert wird, könnte sie während Eingriffen als zweite Augenpaar dienen, Ärztinnen und Ärzten helfen, subtile Wucherungen früher und verlässlicher zu bemerken und letztlich das Risiko reduzieren, dass ein gefährlicher Polyp unbeachtet bleibt.

Zitation: Chen, Z., Lu, S. AVPDN: learning motion-robust and scale-adaptive representations for polyp detection in dynamic colonoscopy frames. Sci Rep 16, 11591 (2026). https://doi.org/10.1038/s41598-026-42286-5

Schlüsselwörter: Koloskopie, Polypenerkennung, KI in der medizinischen Bildgebung, Videoanalyse, Screening auf kolorektales Karzinom