Clear Sky Science · sv

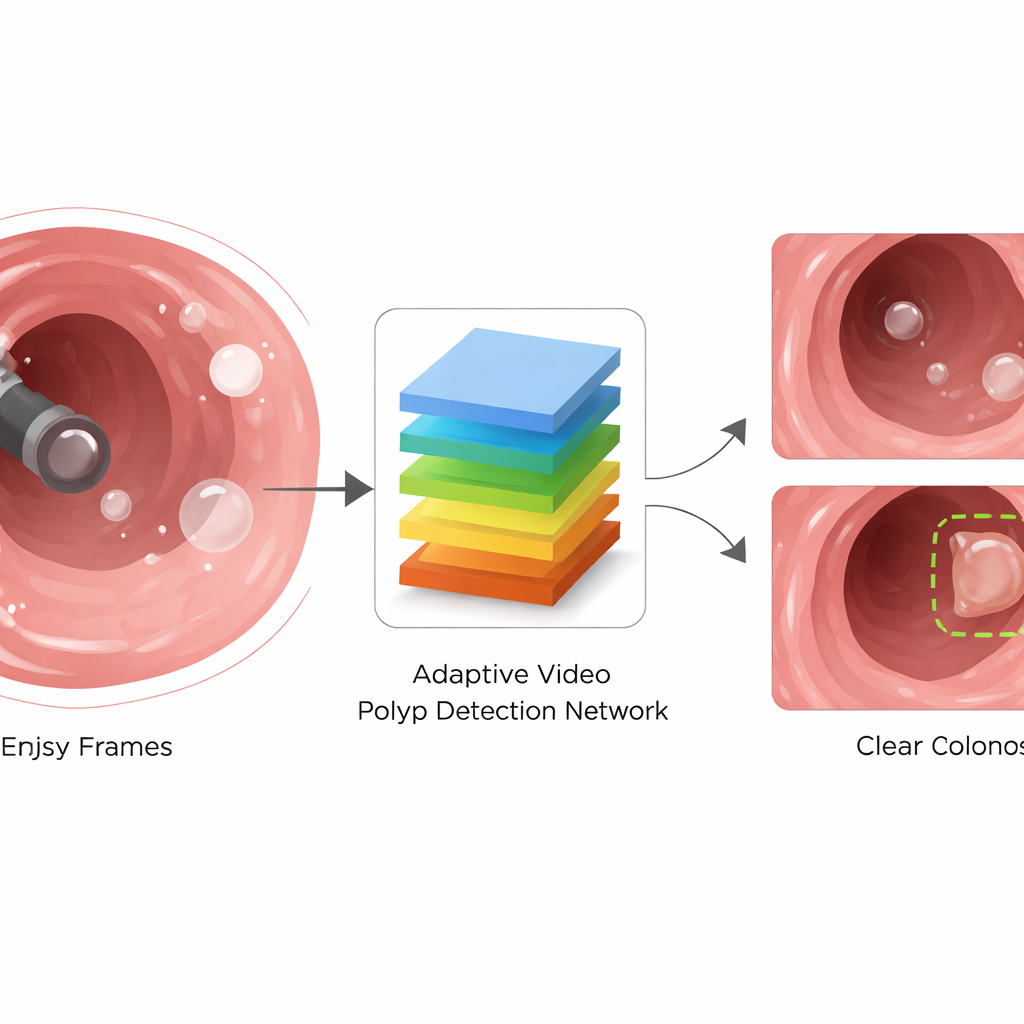

AVPDN: lära sig rörelse‑robusta och skal‑anpassade representationer för polypdetektion i dynamiska koloskopiramfilmer

Varför det spelar roll att hitta små tillväxter

De flesta kolorektala cancerformer börjar som små tillväxter, kallade polyper, på tarmens slemhinna. Under en koloskopi försöker läkare upptäcka och avlägsna dessa polyper innan de blir farliga. Moderna videoskop registrerar allt, men kameran rör sig snabbt, bilden är ofta suddig eller blank av reflexer, och polyper kan vara mycket små och svåra att se. Denna artikel presenterar ett nytt datorsystem som lär sig se genom det visuella kaoset i verkliga koloskopivideor och hjälper läkare att hitta fler polyper korrekt och i realtid.

Utmaningen med en rörlig kamera

Koloskopi liknar inte att ta ett stillfoto—det är mer som att filma en skakig, närgången undersökning inuti kroppen. När skopet förs fram skakar och roterar kameran, tarmväggen drar ihop sig och vätskor och luftbubblor virvlar framför linsen. Dessa rörelser skapar rörelseoskärpa, starka vita reflexer och plötsliga förändringar i hur stora samma strukturer ser ut mellan ramar. Små polyper kan se nästan identiska ut med omgivande veck i vävnaden och kan kortvarigt försvinna bakom bubblor eller blänk. De flesta befintliga datorseendesystem byggdes ursprungligen för naturliga foton eller vanliga videor, där kameran är stadigare och objekt lättare att skilja från bakgrunden, så de får problem i denna extrema miljö.

Ett smartare sätt att tolka koloskopivideo

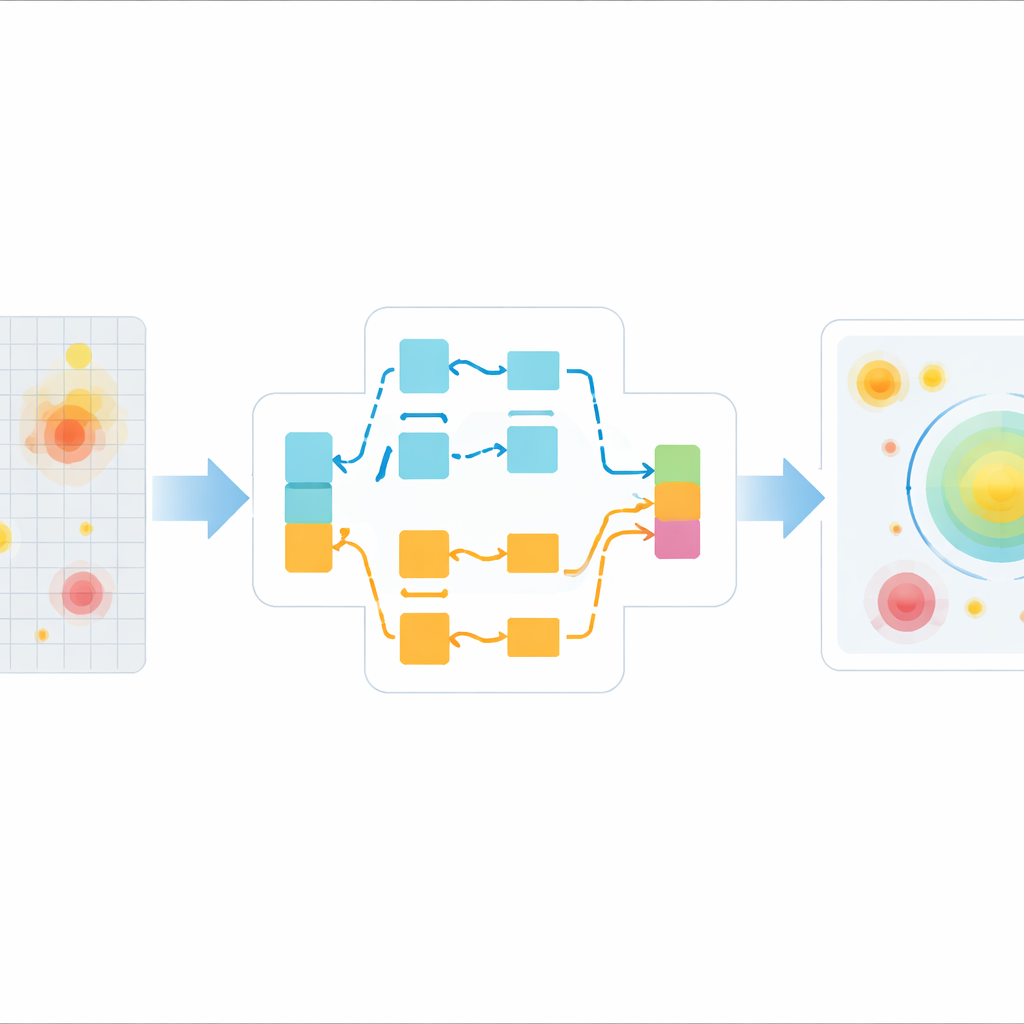

För att hantera dessa problem föreslår författarna Adaptive Video Polyp Detection Network (AVPDN). I grunden tar AVPDN varje videoram som en bild och för den genom en standardfunktionsextraktör som fångar kanter, texturer och färger. Men i stället för att stanna där lägger systemet till ett specialiserat "förbättringsskede" som är utformat särskilt för koloskopi. Detta skede byggs av upprepningsbara block som rengör brusiga signaler, förstärker verkligt polyp‑liknande mönster och håller reda på polyper i många olika storlekar. Viktigt är att metoden arbetar ram för ram utan att behöva analysera långa videosekvenser över tid, vilket håller systemet tillräckligt snabbt för realtidsanvändning.

Filtrera bort brus utan att tappa viktiga ledtrådar

Den första centrala byggstenen kallas Adaptive Feature Interaction and Augmentation. Enkelt uttryckt betraktar den bildfunktionerna på två olika sätt samtidigt. En gren beaktar breda samband över hela bilden, vilket hjälper den att förstå helheten och inte missa avlägsna tecken på en polyp. Den andra grenen är mer selektiv: den nedtonar aggressivt delar av bilden som visar svaga eller inkonsekventa mönster, till exempel oskärpa och blänk. Systemet lär sig sedan hur mycket det ska lita på varje gren för varje ram och blandar dem adaptivt. Ett smart "kanalschuffle"‑steg blandar information mellan olika grupper av funktioner och uppmuntrar nätverket att upptäcka rikare kombinationer av textur och form som skiljer verkliga polyper från ofarliga veck och fläckar.

Se polyper i många storlekar

Den andra viktiga komponenten kallas Scale‑Aware Context Integration. Polyper kan vara mycket små när kameran är längre bort och mycket större när skopet närmar sig, så systemet måste fungera över ett brett storleksintervall. Denna modul betraktar scenen genom flera "virtuella linser" samtidigt—vissa fokuserar på fina detaljer medan andra fångar ett bredare omgivningsområde. Genom att använda dilaterade filter som når längre utan att förlora upplösning samlar modulen både lokal detalj och vid kontext. Den kombinerar sedan dessa vyer så att nätverket kan pålitligt framhäva små polyper inbäddade mellan veck liksom större lesioner som dominerar fältet, även när kameran rör sig snabbt.

Hur väl systemet presterar

Forskarna testade AVPDN på två stora publika samlingar av koloskopivideor som innehåller tiotusentals ramar från många patienter, med polyper av varierande form, storlek och utseende. De jämförde sin metod mot välanvända objektidentifierare och flera specialiserade polypsystem. Över alla nyckelmått—hur ofta polyper hittas korrekt, hur ofta falsklarm undviks och hur väl systemet balanserar dessa två mål—kom AVPDN konsekvent ut i topp. Det förbättrade huvudpoängen för noggrannhet med ett par procentenheter jämfört med starka moderna baslinjer, samtidigt som det fortfarande kördes snabbt nog för realtidsanvändning på aktuell grafikhårdvara. Noggranna interna tester visade att vardera av de två nya modulerna bidrog märkbart till denna fördel.

Vad detta betyder för patienter

Enkelt uttryckt visar detta arbete att ett AI‑system kan tränas att se förbi oskärpa, blänk och snabba storleksförändringar som gör koloskopivideo så svårtolkad, och att anpassa sig till polypers karakteristiska mönster. Genom att rengöra och omviktning av visuell information inne i nätverket i stället för att förlita sig på extra sensorer eller långsammare videoanalys upptäcker AVPDN fler polyper med färre missade och färre falsklarm. Om det integreras i kliniska verktyg kan sådan teknik fungera som ett andra öga under ingrepp, hjälpa läkare att upptäcka subtila tillväxter tidigare och mer tillförlitligt och i slutändan minska risken att en farlig polyp lämnas kvar.

Citering: Chen, Z., Lu, S. AVPDN: learning motion-robust and scale-adaptive representations for polyp detection in dynamic colonoscopy frames. Sci Rep 16, 11591 (2026). https://doi.org/10.1038/s41598-026-42286-5

Nyckelord: koloskopi, polypdetektion, medicinsk bildbehandlings‑AI, videoanalys, screening för kolorektal cancer