Clear Sky Science · sv

Utvärdering av litterär översättning av stora språkmodeller: en mångdimensionell kvalitetsbedömning av Shen Congwens Border Town

Varför denna studie är viktig för läsare och författare

När verktyg som ChatGPT och andra stora språkmodeller blir en del av vardagen börjar människor ställa en enkel fråga: kan dessa system verkligen ersätta mänskliga översättare, särskilt för älskade romaner? Denna studie granskar den frågan noggrant genom att undersöka hur flera ledande AI-modeller översätter en klassisk kinesisk bok, Shen Congwens Border Town, till engelska och jämför deras arbete med en ansedd mänsklig översättning.

En byberättelse möter artificiell intelligens

Border Town är berömd för sin milda skildring av landsbygdsliv i sydvästra Kina, sitt poetiska språk och sitt täta nät av lokala sedvänjor och föreställningar. Dessa drag gör den till ett idealiskt testfall: varje översättare måste återge inte bara vem som gjorde vad, utan också känslan av dimma över flodbåtarna, folkmusikens rytm och tyngden av traditionella värderingar. Författarna valde romanens två första kapitel och samlade fem engelska versioner: fyra producerade av stora språkmodeller (GPT-4, GPT-4o, Gemini och det kinesiska systemet WXYY 4.0 Turbo) och en av den mänsklige forskaröversättaren Jeffrey Kinkley, vars 2009-version är vida uppskattad för sin känslighet inför stil och kultur.

Hur översättningarna bedömdes

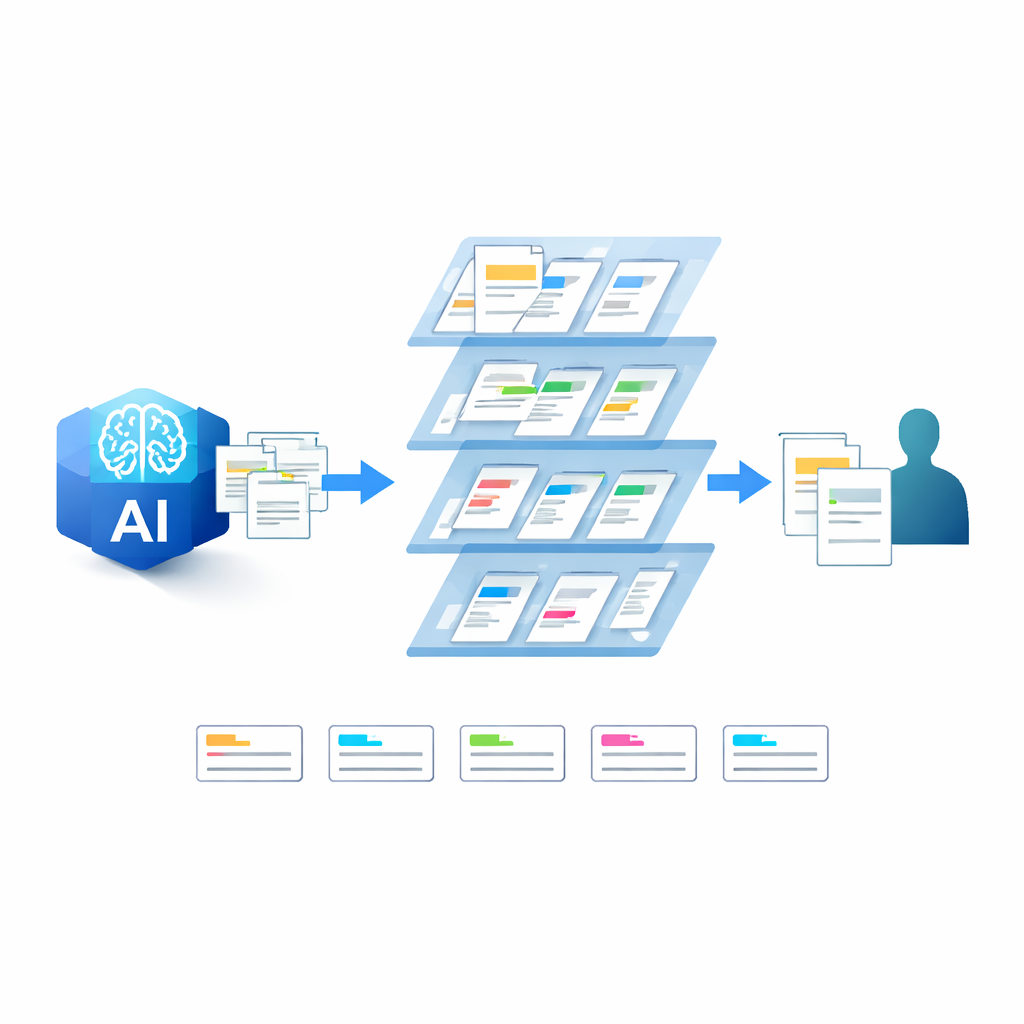

För att gå bortom magkänslor om vad som "låter rätt" använde forskarna en detaljerad ram kallad Multidimensional Quality Metrics. Istället för att bara kontrollera om formuleringen stämmer med originalet sorterar denna metod fel i typer och bedömer hur allvarliga de är. Teamet fokuserade på tre stora frågor: Är betydelsen korrekt? Håller versionen fast vid författarens ton och berättarstil? Och hanterar den kulturella detaljer på ett sätt som är begripligt för läsare utan att utplåna deras ursprungliga smak? Med detta i åtanke jämförde två tränade annotatörer varje mening i den kinesiska texten med varje översättning och markerade fem huvudsakliga feltyper: felöversättning, utelämning, överöversättning (att lägga till onödigt material), kulturell felöversättning och bredare diskursiva problem som skadar berättelsens flyt.

Vart maskinerna snubblar

Resultaten visar tydliga mönster. Alla fyra AI-systemen producerade flytande engelska, men de snavade ofta över avgörande nyanser. Felöversättning var det vanligaste problemet överlag: till exempel blev gamla kopparmynt till ett modernare klingande "cash", vilket tyst ändrade byns historiska känsla. Gemini utelämnade mest material och hoppade ibland över beskrivande fraser som hjälper till att binda samman karaktärer eller bygga atmosfär. GPT-4 lade oftare till extra dömande språk, och förvandlade en diskret antydan till romans till en fullblown "affär", vilket förändrar hur läsare ser karaktärerna. Kulturella referenser visade sig vara särskilt sköra: vardagsföremål kopplade till ritualliv, som rökelse och ljus, eller namnet på en legendarisk hjälte, plattades ofta till, moderniserades eller hanterades alltför bokstavligt. På nivån av hela stycken omarrangerade vissa modeller subtilt vem som stod i centrum för en metafor eller scen, vilket försvagade nyckelrelationer, såsom det känslomässiga bandet mellan den unga flickan Cuicui och hennes morfar.

En närmare titt på relativa styrkor

Inte alla system presterade lika. GPT-4o, en nyare och mer optimerad modell, gjorde konsekvent färre misstag än GPT-4 i nästan alla kategorier, vilket tyder på att noggrann fininställning kan spela större roll än enbart modellstorlek. Den utelämnade mindre innehåll och felöversatte färre fraser, och tenderade att behålla berättelsen mer intakt över meningarna. Gemini, däremot, visade sin största svaghet i att lämna saker ute, särskilt i partier rika på bildspråk och kulturella antydningar. WXYY 4.0 Turbo, trots att den tränats i en kinesisk kontext, överträffade inte tydligt sina utländska motsvarigheter i kulturtyngda stycken; den behandlade fortfarande vissa historiska och rituella termer som om de vore vanliga moderna objekt. Över alla dessa maskinversioner var den mänskliga översättningen fortfarande den mest pålitliga när det gällde att väva samman mening, stämning och kultur.

Vad detta innebär för framtidens läsning i översättning

För vardagliga uppgifter och okomplicerade texter erbjuder stora språkmodeller redan imponerande hjälp. Men denna studie visar att när det gäller litterära verk som Border Town saknar de fortfarande viktiga lager av mening och känsla. Den bäst presterande modellen, GPT-4o, kommer närmare än andra men behöver fortfarande mänsklig tillsyn, särskilt där kultur och berättelsestruktur är i fokus. Författarna hävdar att bättre prompts, mer fokuserad träning och systematisk mänsklig efterredigering är avgörande om AI ska stödja snarare än ersätta litterära översättare. För läsare är budskapet tydligt: maskinellt utdata kan vara ett användbart utkast eller hjälpmedel, men en romans fulla emotionella och kulturella liv beror fortfarande på mänsklig konstnärlighet.

Citering: Yang, W., Yang, M. Evaluating literary translation by large language models: a multidimensional quality assessment of Shen Congwen’s Border Town. Humanit Soc Sci Commun 13, 628 (2026). https://doi.org/10.1057/s41599-026-06868-y

Nyckelord: litterär översättning, stora språkmodeller, maskinöversättningskvalitet, kinesisk litteratur, kulturell nyans