Clear Sky Science · it

Valutare la traduzione letteraria con grandi modelli linguistici: una valutazione multidimensionale della qualità di Confine di Shen Congwen

Perché questo studio è importante per lettori e scrittori

Man mano che strumenti come ChatGPT e altri grandi modelli linguistici entrano nella vita quotidiana, si pone una domanda semplice: questi sistemi possono davvero sostituire i traduttori umani, soprattutto per romanzi amati? Questo studio esamina da vicino la questione analizzando come diversi modelli di IA di primo piano traducono in inglese un classico della letteratura cinese, Confine di Shen Congwen, e confrontando il loro lavoro con una traduzione umana stimata.

Una storia di villaggio incontra l’intelligenza artificiale

Confine è famoso per il ritratto delicato della vita rurale nel sud-ovest della Cina, il linguaggio poetico e la fitta trama di usanze e credenze locali. Queste caratteristiche lo rendono un caso di prova ideale: ogni traduttore deve restituire non solo chi ha fatto cosa, ma la sensazione della nebbia sulle barche del fiume, il ritmo delle canzoni popolari e il peso dei valori tradizionali. Gli autori hanno selezionato i primi due capitoli del romanzo e raccolto cinque versioni in inglese: quattro prodotte da grandi modelli linguistici (GPT-4, GPT-4o, Gemini e il sistema cinese WXYY 4.0 Turbo) e una del traduttore-scienziato umano Jeffrey Kinkley, la cui versione del 2009 è ampiamente lodata per la sensibilità verso stile e cultura.

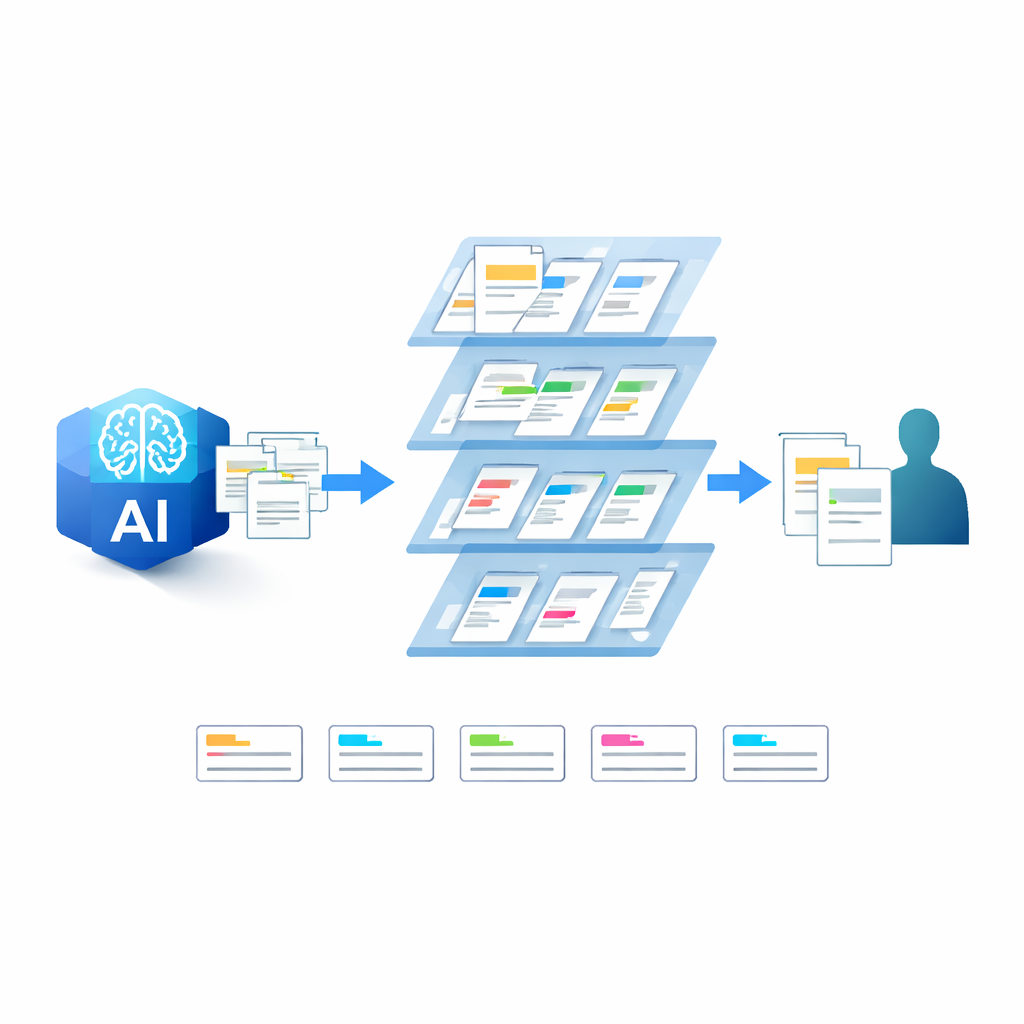

Come sono state giudicate le traduzioni

Per andare oltre le impressioni su ciò che “suona giusto”, i ricercatori hanno adottato un quadro di riferimento dettagliato chiamato Multidimensional Quality Metrics. Invece di verificare soltanto se la formulazione corrisponde all’originale, questo approccio classifica gli errori per tipo e valuta la loro gravità. Il team si è concentrato su tre grandi questioni: il significato è accurato? La versione mantiene il tono e lo stile narrativo dell’autore? E tratta i dettagli culturali in modo comprensibile per i lettori senza cancellarne il sapore originale? Con questi obiettivi, due annotatori formati hanno confrontato ogni frase del testo cinese con ciascuna traduzione, segnalando cinque principali tipi di errore: traduzione errata, omissione, sovratraduzione (aggiunta di materiale non necessario), errata resa culturale e problemi a livello di discorso più ampi che danneggiano il flusso della storia.

Dove le macchine inciampano

I risultati mostrano schemi chiari. Tutti e quattro i sistemi di IA hanno prodotto un inglese fluente, ma spesso hanno sbagliato su sfumature cruciali. La traduzione errata è stato il problema più comune in assoluto: per esempio, vecchie monete di rame sono diventate un moderno “cash”, cambiando discretamente la sensazione storica del villaggio. Gemini ha eliminato più materiale rispetto agli altri, a volte saltando frasi descrittive che aiutano a collegare i personaggi o a creare atmosfera. GPT-4 ha aggiunto più spesso linguaggio giudicante in eccesso, trasformando un accenno discreto di romanticismo in un vero e proprio “affare”, ciò che modifica il modo in cui i lettori percepiscono i personaggi. I riferimenti culturali si sono rivelati particolarmente fragili: oggetti quotidiani legati alla vita rituale, come incenso e candele, o il nome di un eroe leggendario, sono stati spesso appiattiti, modernizzati o trattati troppo letteralmente. A livello di paragrafi, alcuni modelli hanno sottilmente riorganizzato chi è centrale in una metafora o in una scena, indebolendo relazioni chiave, come il legame emotivo tra la giovane Cuicui e suo nonno.

Uno sguardo più attento ai punti di forza relativi

Non tutti i sistemi hanno funzionato allo stesso modo. GPT-4o, un modello più recente e più ottimizzato, ha commesso sistematicamente meno errori rispetto a GPT-4 in quasi tutte le categorie, suggerendo che un’attenta messa a punto può contare più della sola dimensione del modello. Ha omesso meno contenuti, tradotto meno frasi in modo errato e tendeva a mantenere la storia più integra tra le frasi. Gemini, al contrario, ha mostrato la sua maggiore debolezza nelle omissioni, specialmente nei passaggi ricchi di immagini e indizi culturali. WXYY 4.0 Turbo, nonostante sia stato addestrato in un contesto cinese, non ha sorpassato in modo netto i suoi omologhi stranieri nei brani carichi di cultura; ha comunque trattato alcuni termini storici e rituali come se fossero oggetti moderni ordinari. Tra tutte queste versioni automatiche, la traduzione umana è rimasta la più affidabile nell’intrecciare significato, tono e cultura.

Cosa significa per il futuro della lettura in traduzione

Per compiti quotidiani e testi lineari, i grandi modelli linguistici offrono già un aiuto impressionante. Ma questo studio mostra che, nel caso di opere letterarie come Confine, continuano a perdere strati vitali di senso e sentimento. Il modello con le prestazioni migliori, GPT-4o, si avvicina più degli altri ma richiede comunque supervisione umana, soprattutto dove sono in gioco cultura e struttura narrativa. Gli autori sostengono che prompt migliori, un addestramento più mirato e una post-edizione umana sistematica siano essenziali se l’IA deve supportare, e non sostituire, i traduttori letterari. Per i lettori il messaggio è chiaro: l’output delle macchine può essere una bozza utile o un aiuto, ma la vita emotiva e culturale completa di un romanzo dipende ancora dall’arte umana.

Citazione: Yang, W., Yang, M. Evaluating literary translation by large language models: a multidimensional quality assessment of Shen Congwen’s Border Town. Humanit Soc Sci Commun 13, 628 (2026). https://doi.org/10.1057/s41599-026-06868-y

Parole chiave: traduzione letteraria, grandi modelli linguistici, qualità della traduzione automatica, letteratura cinese, sfumature culturali