Clear Sky Science · pt

Avaliação da tradução literária por grandes modelos de linguagem: uma avaliação multidimensional da qualidade de A Cidade da Fronteira, de Shen Congwen

Por que este estudo importa para leitores e escritores

À medida que ferramentas como o ChatGPT e outros grandes modelos de linguagem passam a fazer parte da vida cotidiana, as pessoas começam a fazer uma pergunta simples: esses sistemas podem realmente substituir tradutores humanos, especialmente em romances queridos? Este estudo examina atentamente essa questão ao analisar como vários modelos de IA líderes traduzem um clássico chinês, A Cidade da Fronteira, de Shen Congwen, para o inglês, e ao comparar seu trabalho com uma tradução humana respeitada.

Uma história de vila encontra a inteligência artificial

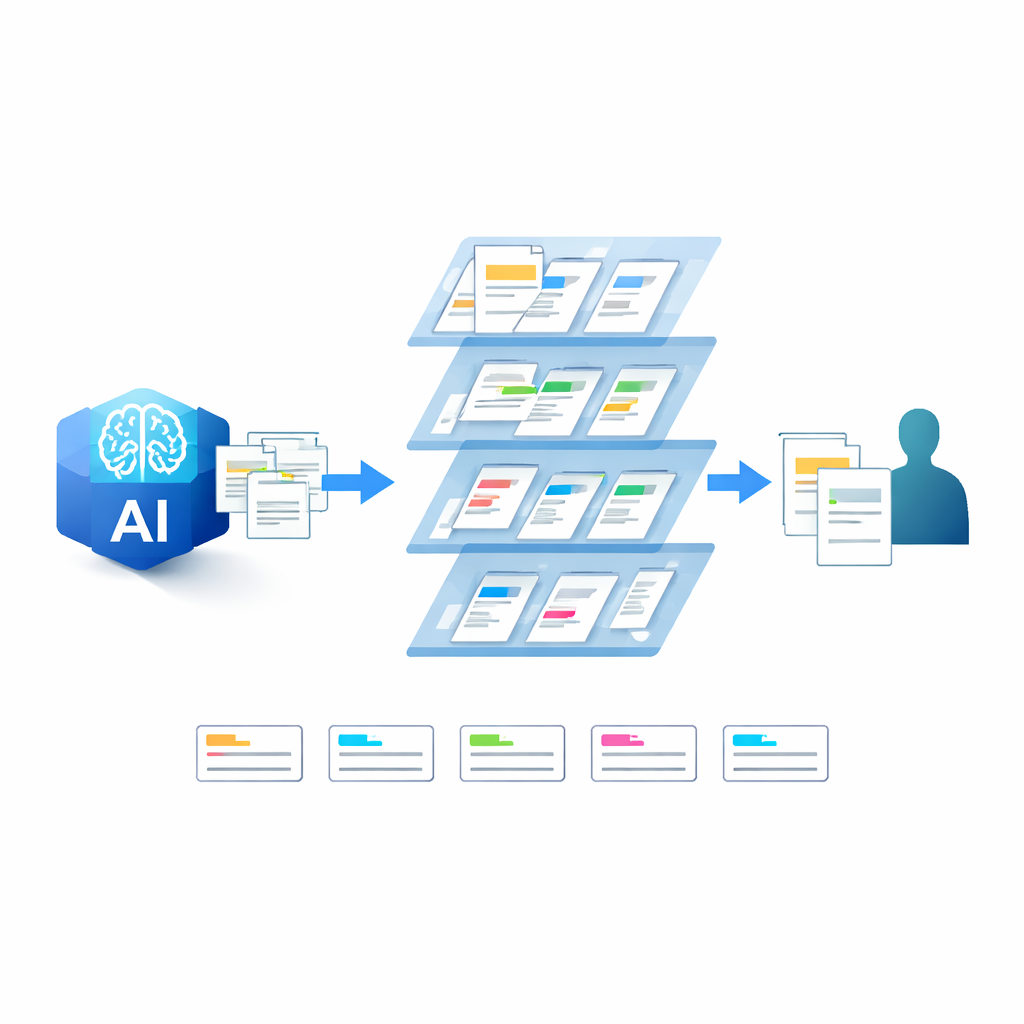

A Cidade da Fronteira é famosa por seu retrato delicado da vida rural no sudoeste da China, sua linguagem poética e sua densa teia de costumes e crenças locais. Essas características a tornam um caso de teste ideal: qualquer tradutor precisa captar não apenas quem fez o quê, mas a sensação da névoa sobre os barcos do rio, o ritmo das canções folclóricas e o peso dos valores tradicionais. Os autores selecionaram os dois primeiros capítulos do romance e reuniram cinco versões em inglês: quatro produzidas por grandes modelos de linguagem (GPT-4, GPT-4o, Gemini e o sistema chinês WXYY 4.0 Turbo) e uma pelo tradutor-especialista humano Jeffrey Kinkley, cuja versão de 2009 é amplamente elogiada por sua sensibilidade ao estilo e à cultura.

Como as traduções foram avaliadas

Para ir além das impressões intuitivas sobre o que “soa certo”, os pesquisadores usaram uma estrutura detalhada chamada Métricas de Qualidade Multidimensionais. Em vez de apenas verificar se a formulação corresponde ao original, essa abordagem classifica erros por tipo e avalia sua gravidade. A equipe concentrou-se em três grandes questões: o significado é preciso? A versão mantém a tonalidade e o estilo narrativo do autor? E ela trata detalhes culturais de forma que faça sentido para os leitores sem apagar seu sabor original? Com isso em mente, dois anotadores treinados compararam cada sentença do texto chinês com cada tradução, assinalando cinco tipos principais de erro: tradução incorreta, omissão, over-translation (adição de material desnecessário), tradução cultural equivocada e problemas mais amplos em nível de discurso que prejudicam o andamento da história.

Onde as máquinas tropeçam

Os resultados mostram padrões claros. Todos os quatro sistemas de IA produziram inglês fluente, mas frequentemente falharam em nuances cruciais. A tradução incorreta foi o problema mais comum em todos os casos: por exemplo, moedas antigas de cobre viraram “dinheiro” com sonoridade moderna, mudando silenciosamente a sensação histórica da vila. O Gemini eliminou mais conteúdo, às vezes pulando frases descritivas que ajudam a conectar personagens ou construir a atmosfera. O GPT-4 adicionou com mais frequência linguagem julgadora extra, transformando uma sugestão discreta de romance em um verdadeiro “caso”, o que altera a maneira como os leitores veem os personagens. Referências culturais revelaram-se particularmente frágeis: objetos cotidianos ligados à vida ritual, como incenso e velas, ou o nome de um herói lendário, foram frequentemente achatados, modernizados ou tratados de forma literal demais. No nível de parágrafos inteiros, alguns modelos rearranjaram sutilmente quem era central em uma metáfora ou cena, enfraquecendo relacionamentos-chave, como o vínculo emocional entre a jovem Cuicui e seu avô.

Um olhar mais atento sobre forças relativas

Nem todos os sistemas se saíram igualmente. O GPT-4o, um modelo mais novo e otimizado, cometeu consistentemente menos erros que o GPT-4 em quase todas as categorias, sugerindo que o ajuste fino pode importar mais do que o mero tamanho do modelo. Ele omitiu menos conteúdo e traduziu menos frases incorretamente, e tendia a manter a integridade da história ao longo das sentenças. O Gemini, em contraste, mostrou sua maior fraqueza em deixar coisas de fora, especialmente em trechos densos em imagens e pistas culturais. O WXYY 4.0 Turbo, apesar de ter sido treinado em um contexto chinês, não superou claramente seus equivalentes estrangeiros em passagens com forte carga cultural; ainda tratou alguns termos históricos e rituais como se fossem objetos modernos e comuns. Em todas essas versões de máquina, a tradução humana permaneceu a mais confiável em entrelaçar significado, humor e cultura.

O que isso significa para o futuro da leitura em tradução

Para tarefas cotidianas e textos diretos, os grandes modelos de linguagem já oferecem ajuda impressionante. Mas este estudo mostra que, no que diz respeito a obras literárias como A Cidade da Fronteira, eles ainda deixam de captar camadas vitais de sentido e sentimento. O modelo com melhor desempenho, o GPT-4o, chega mais perto que os demais, mas ainda requer supervisão humana, especialmente onde cultura e estrutura narrativa estão em jogo. Os autores argumentam que melhores prompts, treinamento mais focado e pós-edição humana sistemática são essenciais se a IA deve apoiar, e não substituir, tradutores literários. Para os leitores, a mensagem é clara: a produção de máquina pode ser um rascunho ou auxílio útil, mas a vida emocional e cultural plena de um romance ainda depende da arte humana.

Citação: Yang, W., Yang, M. Evaluating literary translation by large language models: a multidimensional quality assessment of Shen Congwen’s Border Town. Humanit Soc Sci Commun 13, 628 (2026). https://doi.org/10.1057/s41599-026-06868-y

Palavras-chave: tradução literária, grandes modelos de linguagem, qualidade de tradução automática, literatura chinesa, nuance cultural