Clear Sky Science · es

Evaluación de la traducción literaria por grandes modelos de lenguaje: una valoración multidimensional de la calidad de Border Town de Shen Congwen

Por qué este estudio importa para lectores y escritores

A medida que herramientas como ChatGPT y otros grandes modelos de lenguaje se integran en la vida cotidiana, la gente empieza a plantearse una pregunta simple: ¿pueden estos sistemas realmente sustituir a los traductores humanos, especialmente en novelas queridas? Este estudio aborda de cerca esa cuestión examinando cómo varios modelos de IA de vanguardia traducen al inglés un libro clásico chino, Border Town de Shen Congwen, y comparando su trabajo con una traducción humana respetada.

Una historia de pueblo frente a la inteligencia artificial

Border Town es famosa por su retrato delicado de la vida rural en el suroeste de China, su lenguaje poético y su densa red de costumbres y creencias locales. Estas características la convierten en un caso de prueba ideal: cualquier traductor debe captar no solo quién hizo qué, sino la sensación de niebla sobre los botes del río, el ritmo de las canciones populares y el peso de los valores tradicionales. Los autores seleccionaron los dos primeros capítulos de la novela y reunieron cinco versiones en inglés: cuatro producidas por grandes modelos de lenguaje (GPT-4, GPT-4o, Gemini y el sistema chino WXYY 4.0 Turbo) y una por el traductor académico humano Jeffrey Kinkley, cuya versión de 2009 es ampliamente elogiada por su sensibilidad estilística y cultural.

Criterios de evaluación de las traducciones

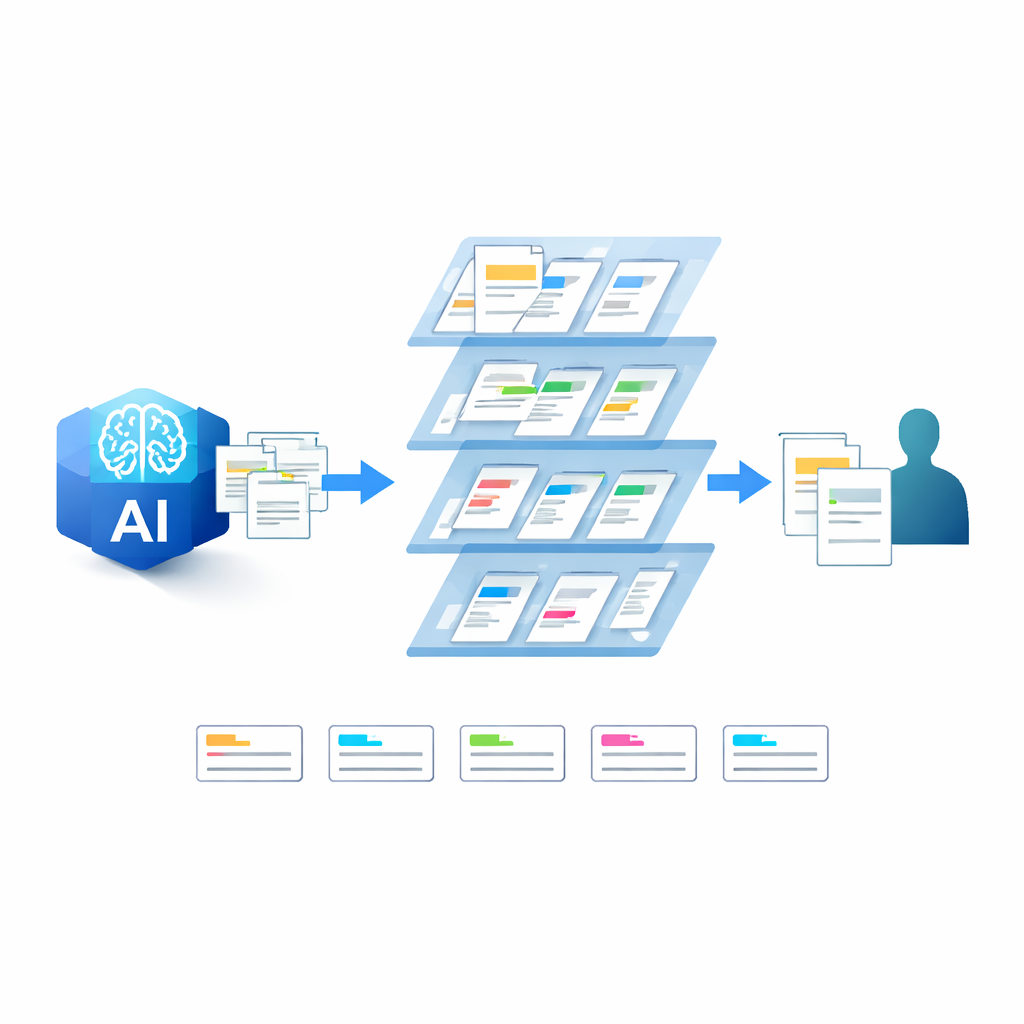

Para ir más allá de las impresiones sobre lo que “suena bien”, los investigadores emplearon un marco detallado llamado Multidimensional Quality Metrics. En lugar de limitarse a comprobar si la redacción coincide con el original, este enfoque clasifica los errores por tipo y valora su gravedad. El equipo se centró en tres grandes preguntas: ¿es precisa la significación? ¿mantiene la versión el tono y el estilo narrativo del autor? ¿y maneja los detalles culturales de forma que tengan sentido para los lectores sin borrar su sabor original? Con esto en mente, dos anotadores entrenados compararon cada frase del texto chino con cada traducción, señalando cinco tipos principales de error: mistraducción, omisión, sobretraducción (añadir material innecesario), mistraducción cultural y problemas a nivel de discurso más amplio que dañan el flujo de la historia.

Dónde tropiezan las máquinas

Los resultados muestran patrones claros. Los cuatro sistemas de IA produjeron inglés fluido, pero con frecuencia fallaron en matices cruciales. La mistraducción fue el problema más común en todos los casos: por ejemplo, antiguas monedas de cobre se convirtieron en un moderno “cash”, cambiando silenciosamente la sensación histórica del pueblo. Gemini fue el que más material dejó fuera, a veces omitiendo frases descriptivas que ayudan a vincular a los personajes o a construir la atmósfera. GPT-4 añadió con más frecuencia lenguaje adicional valorativo, convirtiendo un sutil indicio de romance en un “affair” contundente, lo que modifica la percepción de los lectores sobre los personajes. Las referencias culturales resultaron particularmente frágiles: objetos cotidianos ligados a la vida ritual, como incienso y velas, o el nombre de un héroe legendario, se aplanaron, modernizaron o trataron demasiado literalmente con frecuencia. A nivel de párrafos enteros, algunos modelos reorganizaron sutilmente quién era el centro de una metáfora o escena, debilitando relaciones clave, como el vínculo emocional entre la joven Cuicui y su abuelo.

Una mirada más cercana a las fortalezas relativas

No todos los sistemas rindieron por igual. GPT-4o, un modelo más nuevo y optimizado, cometió sistemáticamente menos errores que GPT-4 en casi todas las categorías, lo que sugiere que un ajuste cuidadoso puede importar más que el mero tamaño del modelo. Omitió menos contenido y mistradujo menos frases, y tendió a mantener la integridad de la historia entre oraciones. Gemini, en cambio, mostró su mayor debilidad en dejar cosas fuera, especialmente en pasajes densos en imágenes y pistas culturales. WXYY 4.0 Turbo, a pesar de haber sido entrenado en un contexto chino, no superó claramente a sus homólogos extranjeros en pasajes cargados de cultura; seguía tratando algunos términos históricos y rituales como si fueran objetos modernos ordinarios. En todas estas versiones automáticas, la traducción humana siguió siendo la más fiable a la hora de entrelazar significado, atmósfera y cultura.

Lo que esto significa para el futuro de la lectura en traducción

Para tareas cotidianas y textos sencillos, los grandes modelos de lenguaje ya ofrecen una ayuda impresionante. Pero este estudio muestra que, en obras literarias como Border Town, todavía pierden capas vitales de sentido y sentimiento. El modelo de mejor rendimiento, GPT-4o, se acerca más que los demás, pero aún necesita supervisión humana, especialmente en lo relativo a la cultura y la estructura narrativa. Los autores sostienen que mejores indicaciones, un entrenamiento más focalizado y una postedición humana sistemática son esenciales si la IA debe apoyar, y no reemplazar, a los traductores literarios. Para los lectores, el mensaje es claro: la salida de la máquina puede ser un borrador o una ayuda útil, pero la vida emocional y cultural plena de una novela sigue dependiendo del arte humano.

Cita: Yang, W., Yang, M. Evaluating literary translation by large language models: a multidimensional quality assessment of Shen Congwen’s Border Town. Humanit Soc Sci Commun 13, 628 (2026). https://doi.org/10.1057/s41599-026-06868-y

Palabras clave: traducción literaria, grandes modelos de lenguaje, calidad de la traducción automática, literatura china, matices culturales