Clear Sky Science · nl

Literaire vertaling door grote taalmodellen evalueren: een multidimensionele kwaliteitsbeoordeling van Shen Congwen’s Border Town

Waarom deze studie van belang is voor lezers en schrijvers

Naarmate tools als ChatGPT en andere grote taalmodellen deel gaan uitmaken van het dagelijks leven, rijst een eenvoudige vraag: kunnen deze systemen menselijke vertalers echt vervangen, zeker voor geliefde romans? Deze studie onderzoekt die vraag nauwgezet door te bekijken hoe meerdere toonaangevende AI‑modellen een klassiek Chinees boek, Shen Congwen’s Border Town, in het Engels vertalen en hun werk te vergelijken met een gerespecteerde menselijke vertaling.

Een dorpsverhaal ontmoet kunstmatige intelligentie

Border Town staat bekend om zijn zachte portret van het landelijke leven in zuidwest-China, zijn poëtische taal en het dichte web van lokale gebruiken en overtuigingen. Deze eigenschappen maken het tot een ideale testcase: iedere vertaler moet niet alleen vastleggen wie wat deed, maar ook het gevoel van mist boven rivierbootjes, het ritme van volksliederen en het gewicht van traditionele waarden. De auteurs kozen de eerste twee hoofdstukken van de roman en verzamelden vijf Engelse versies: vier geproduceerd door grote taalmodellen (GPT-4, GPT-4o, Gemini en het Chinese systeem WXYY 4.0 Turbo) en één door de menselijke scholar‑vertaler Jeffrey Kinkley, wiens versie uit 2009 breed geprezen wordt om haar gevoeligheid voor stijl en cultuur.

Hoe de vertalingen werden beoordeeld

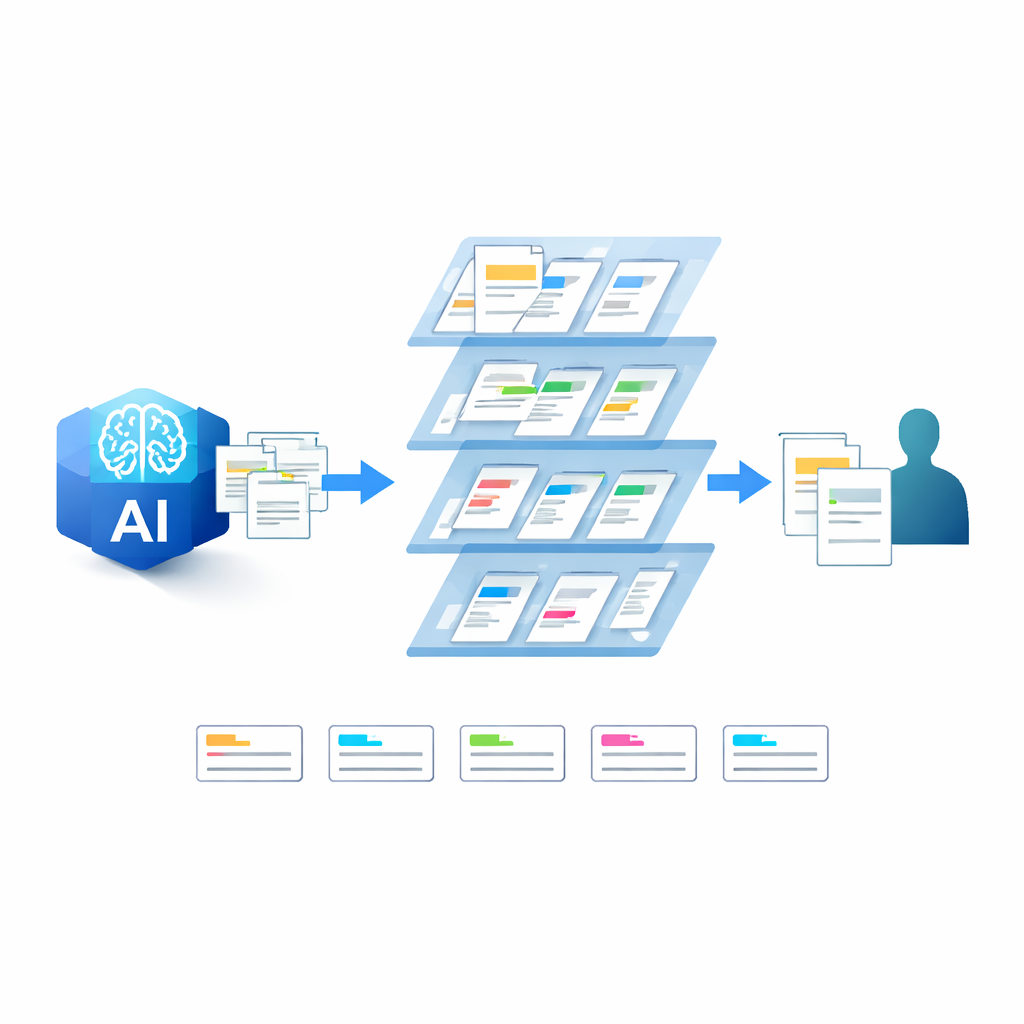

Om verder te gaan dan onderbuikgevoelens over wat “goed klinkt”, gebruikten de onderzoekers een gedetailleerd kader genaamd Multidimensional Quality Metrics. In plaats van alleen te controleren of de bewoording overeenkomt met het origineel, sorteert deze aanpak fouten naar typen en beoordeelt hoe ernstig ze zijn. Het team richtte zich op drie grote vragen: Is de betekenis nauwkeurig? Blijft de versie trouw aan de toon en vertelstijl van de auteur? En behandelt ze culturele details op een manier die voor lezers begrijpelijk is zonder hun oorspronkelijke smaak te wissen? Met deze vragen in het achterhoofd vergeleken twee getrainde annotatoren elke zin van de Chinese tekst met elke vertaling, en markeerden vijf hoofdtypen fouten: foutieve vertaling, weglating, oververtaling (het toevoegen van onnodig materiaal), culturele misvertaling en bredere discoursniveauproblemen die de stroom van het verhaal schaden.

Waar de machines struikelen

De resultaten tonen duidelijke patronen. Alle vier AI-systemen produceerden vloeiend Engels, maar ze struikelden vaak over cruciale nuances. Foute vertaling was het meest voorkomende probleem: bijvoorbeeld, oude koperen munten werden modern klinkend “cash”, waardoor het historische gevoel van het dorp stilletjes veranderde. Gemini liet het meeste materiaal vallen en sloeg soms beschrijvende zinnen over die helpen personages met elkaar te verbinden of sfeer op te bouwen. GPT-4 voegde het vaakst extra oordelende taal toe, waardoor een subtiele hint van romantiek uitgroeide tot een volwaardige “affaire”, wat de manier waarop lezers de personages zien verandert. Culturele verwijzingen bleken bijzonder kwetsbaar: alledaagse voorwerpen die verbonden zijn met ritueel leven, zoals wierook en kaarsen, of de naam van een legendarische held, werden vaak afgevlakt, gemoderniseerd of te letterlijk behandeld. Op het niveau van hele alinea’s herschikten sommige modellen subtiel wie centraal stond in een metafoor of scène, waardoor sleutelrelaties verzwakten, zoals de emotionele band tussen het jonge meisje Cuicui en haar grootvader.

Een nadere blik op relatieve sterktes

Niet alle systemen presteerden gelijk. GPT-4o, een nieuwer en meer geoptimaliseerd model, maakte consequent minder fouten dan GPT-4 in bijna elke categorie, wat suggereert dat zorgvuldige afstemming meer kan uitmaken dan louter modelgrootte. Het liet minder inhoud weg en vertaalde minder frasen verkeerd, en het hield doorgaans het verhaal beter intact over zinnen heen. Gemini toonde daarentegen zijn grootste zwakte in het weglaten van passages, vooral in gedeelten die rijk zijn aan beeldspraak en culturele aanwijzingen. WXYY 4.0 Turbo, ondanks dat het in een Chinese context getraind is, overtrof zijn buitenlandse tegenhangers niet duidelijk bij cultuurrijke passages; het behandelde sommige historische en rituele termen nog steeds alsof het gewone moderne objecten waren. Over al deze machineversies heen bleef de menselijke vertaling het betrouwbaarst in het samenweven van betekenis, sfeer en cultuur.

Wat dit betekent voor de toekomst van lezen in vertaling

Voor alledaagse taken en eenvoudige teksten bieden grote taalmodellen al indrukwekkende hulp. Maar deze studie laat zien dat wanneer het om literaire werken zoals Border Town gaat, ze nog steeds essentiële lagen van betekenis en gevoel missen. Het best presterende model, GPT-4o, komt dichterbij dan de anderen maar heeft nog steeds menselijke supervisie nodig, zeker waar cultuur en verhaallijnstructuur spelen. De auteurs betogen dat betere prompts, meer gerichte training en systematische menselijke nabehandeling essentieel zijn als AI vertalers wil ondersteunen in plaats van vervangen. Voor lezers is de boodschap helder: machine-uitvoer kan een nuttig concept of hulpmiddel zijn, maar het volledige emotionele en culturele leven van een roman hangt nog steeds af van menselijke vakmanschap.

Bronvermelding: Yang, W., Yang, M. Evaluating literary translation by large language models: a multidimensional quality assessment of Shen Congwen’s Border Town. Humanit Soc Sci Commun 13, 628 (2026). https://doi.org/10.1057/s41599-026-06868-y

Trefwoorden: literaire vertaling, grote taalmodellen, kwaliteit van machinevertaling, Chinese literatuur, culturele nuance