Clear Sky Science · fr

Évaluer la traduction littéraire par de grands modèles de langue : une évaluation multidimensionnelle de la qualité de Border Town de Shen Congwen

Pourquoi cette étude compte pour les lecteurs et les écrivains

Alors que des outils comme ChatGPT et d’autres grands modèles de langue entrent dans la vie quotidienne, une question simple se pose de plus en plus : ces systèmes peuvent-ils vraiment remplacer les traducteurs humains, en particulier pour des romans chéris ? Cette étude examine en détail cette question en analysant comment plusieurs modèles d’IA de premier plan traduisent un ouvrage chinois classique, Border Town de Shen Congwen, en anglais, et en comparant leurs versions à une traduction humaine reconnue.

Un récit villageois confronté à l’intelligence artificielle

Border Town est célèbre pour son portrait délicat de la vie rurale dans le sud‑ouest de la Chine, son langage poétique et son réseau dense de coutumes et de croyances locales. Ces caractéristiques en font un cas d’essai idéal : tout traducteur doit saisir non seulement qui a fait quoi, mais aussi la sensation de brume au‑dessus des bateaux sur la rivière, le rythme des chants populaires et le poids des valeurs traditionnelles. Les auteurs ont choisi les deux premiers chapitres du roman et rassemblé cinq versions anglaises : quatre produites par des grands modèles de langue (GPT‑4, GPT‑4o, Gemini et le système chinois WXYY 4.0 Turbo) et une par le traducteur‑chercheur humain Jeffrey Kinkley, dont la version de 2009 est largement saluée pour sa sensibilité au style et à la culture.

Comment les traductions ont été évaluées

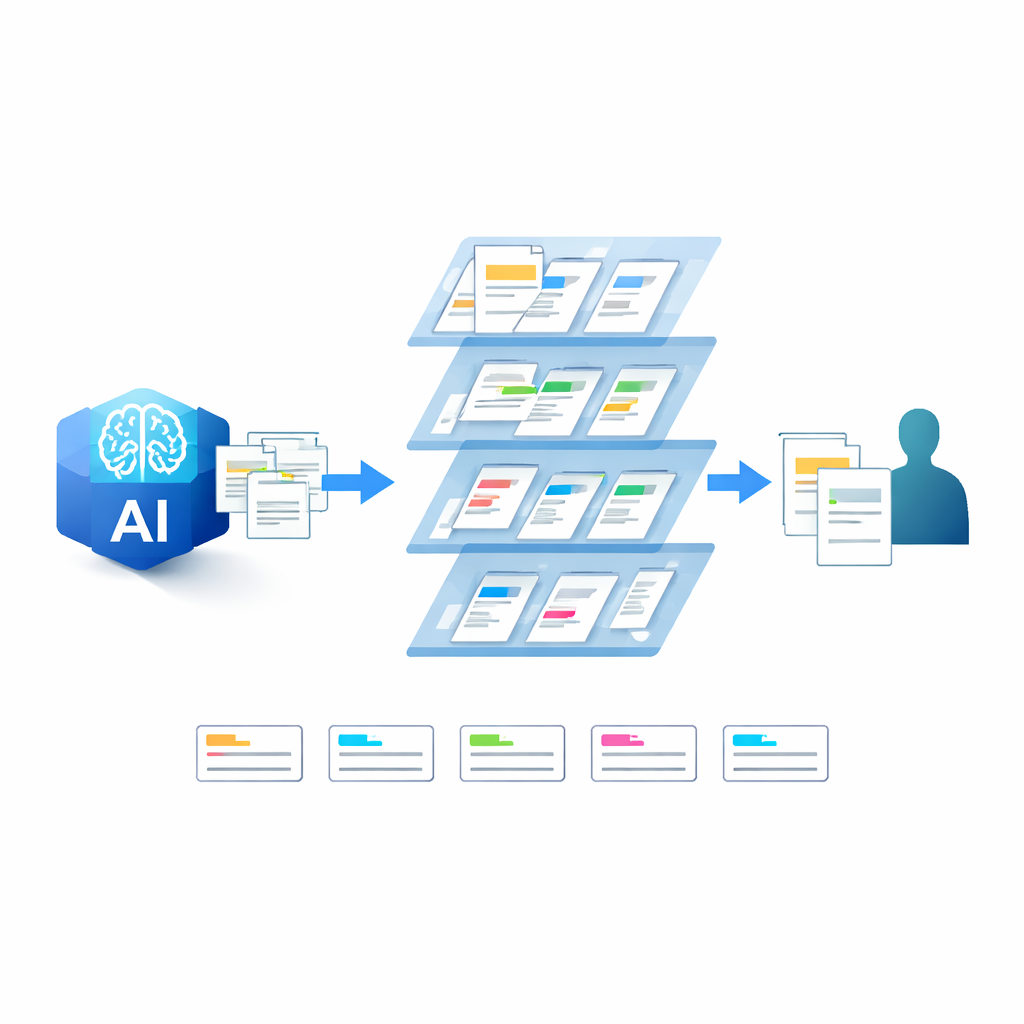

Pour dépasser les impressions intuitives sur ce qui « sonne juste », les chercheurs ont utilisé un cadre détaillé appelé Multidimensional Quality Metrics. Plutôt que de vérifier uniquement si le libellé correspond à l’original, cette approche classe les erreurs par type et évalue leur gravité. L’équipe s’est concentrée sur trois grandes questions : le sens est‑il précis ? La version respecte‑t‑elle le ton et le style narratif de l’auteur ? Et gère‑t‑elle les éléments culturels de manière compréhensible pour les lecteurs sans effacer leur saveur d’origine ? Avec ces critères, deux annotateurs formés ont comparé chaque phrase du texte chinois à chaque traduction, signalant cinq types d’erreurs principaux : mauvaise traduction, omission, surtraduction (ajout de matériel inutile), mauvaise traduction culturelle et problèmes discursifs plus larges qui nuisent au déroulement de l’histoire.

Où les machines trébuchent

Les résultats montrent des schémas clairs. Les quatre systèmes d’IA ont produit un anglais fluide, mais ils ont souvent manqué des nuances cruciales. La mauvaise traduction a été le problème le plus fréquent : par exemple, de vieilles pièces de cuivre sont devenues un « cash » au son moderne, modifiant discrètement la sensation historique du village. Gemini a été celui qui a le plus omis de matériel, sautant parfois des phrases descriptives qui aident à lier les personnages ou à installer l’atmosphère. GPT‑4 a souvent ajouté un langage jugeant en excès, transformant un indice discret de romance en un « affaire » complet, ce qui change la perception des personnages par les lecteurs. Les références culturelles se sont révélées particulièrement fragiles : des objets du quotidien liés à la vie rituelle, comme l’encens et les bougies, ou le nom d’un héros légendaire, ont été fréquemment aplatis, modernisés ou pris trop littéralement. Au niveau des paragraphes entiers, certains modèles ont subtilement réarrangé qui était central dans une métaphore ou une scène, affaiblissant des relations clés, comme le lien émotionnel entre la jeune Cuicui et son grand‑père.

Un examen des forces relatives

Tous les systèmes ne se valent pas. GPT‑4o, un modèle plus récent et mieux optimisé, a systématiquement commis moins d’erreurs que GPT‑4 dans presque toutes les catégories, ce qui suggère qu’un réglage soigné peut compter davantage que la seule taille du modèle. Il a moins omis de contenu et mal traduit moins de phrases, et il a eu tendance à préserver davantage l’intégrité de l’histoire entre les phrases. Gemini, en revanche, a montré sa plus grande faiblesse dans les omissions, surtout dans les passages riches en images et en indices culturels. WXYY 4.0 Turbo, malgré un entraînement en contexte chinois, n’a pas clairement dépassé ses homologues étrangers sur les passages fortement culturels ; il a encore traité certains termes historiques et rituels comme s’il s’agissait d’objets modernes ordinaires. Parmi toutes ces versions machine, la traduction humaine est restée la plus fiable pour tisser ensemble sens, ambiance et culture.

Ce que cela signifie pour l’avenir de la lecture en traduction

Pour les tâches quotidiennes et les textes simples, les grands modèles de langue offrent déjà une aide impressionnante. Mais cette étude montre que, pour des œuvres littéraires comme Border Town, ils manquent encore des couches vitales de sens et de sensation. Le modèle le plus performant, GPT‑4o, se rapproche davantage que les autres mais nécessite toujours une supervision humaine, en particulier là où la culture et la structure narrative sont en jeu. Les auteurs soutiennent que de meilleurs prompts, un entraînement plus ciblé et une post‑édition humaine systématique sont essentiels si l’IA doit soutenir, plutôt que remplacer, les traducteurs littéraires. Pour les lecteurs, le message est clair : la production machine peut être un brouillon utile ou une aide, mais la vie émotionnelle et culturelle complète d’un roman dépend toujours de l’art humain.

Citation: Yang, W., Yang, M. Evaluating literary translation by large language models: a multidimensional quality assessment of Shen Congwen’s Border Town. Humanit Soc Sci Commun 13, 628 (2026). https://doi.org/10.1057/s41599-026-06868-y

Mots-clés: traduction littéraire, grands modèles de langue, qualité de la traduction automatique, littérature chinoise, nuance culturelle