Clear Sky Science · sv

Diagnostisk noggrannhet hos multimodala stora språkmodeller vid differentiering av epileptiska och funktionella anfall i smartphoneinspelade videor

Varför din telefonvideo kan hjälpa till att diagnosticera ett anfall

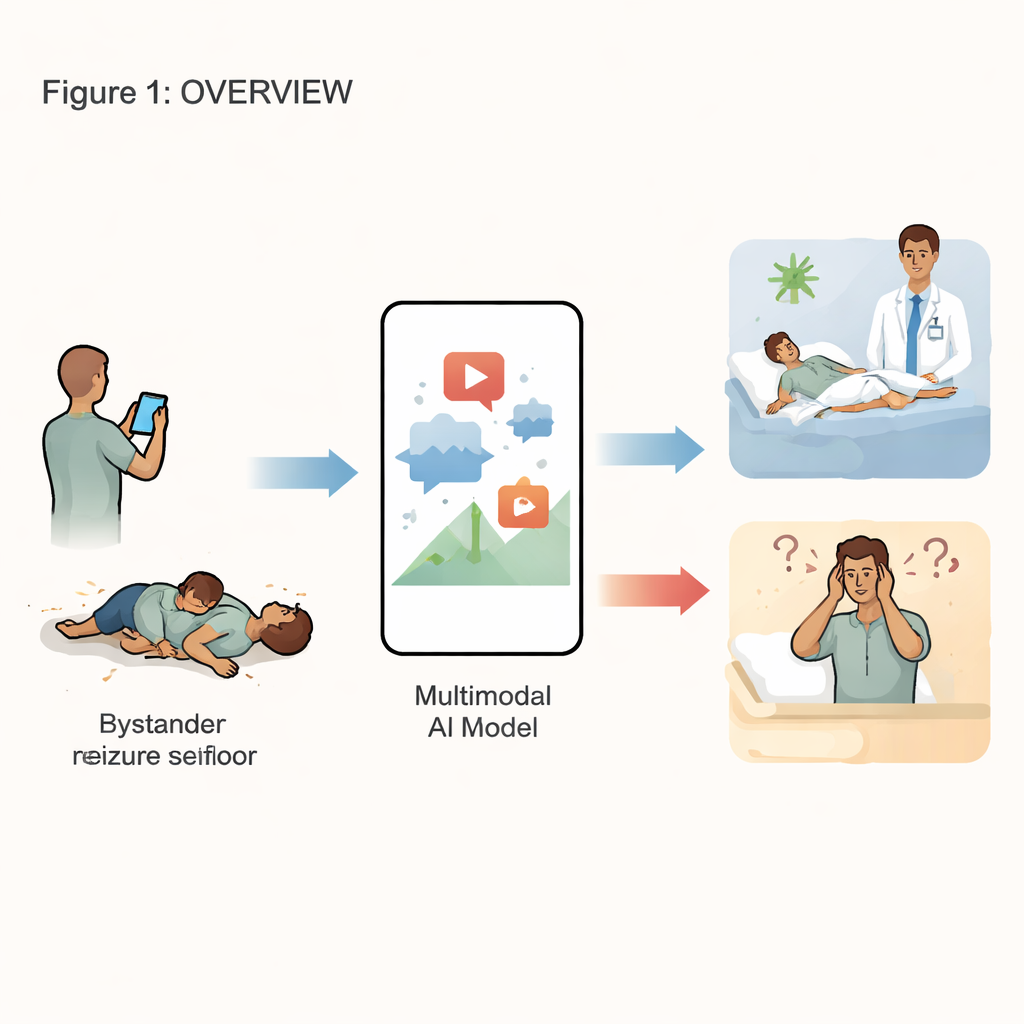

När någon plötsligt kollapsar eller börjar skaka tar åskådare nu ofta upp en smartphone och börjar filma. Dessa videor kan vara livsviktiga ledtrådar som hjälper läkare att avgöra om händelsen var ett epileptiskt anfall eller en liknande episod som kallas funktionellt anfall. Men experter inom neurologi är en bristvara, och väntan på att en specialist ska granska videor kan fördröja behandling. Denna studie undersöker om modern artificiell intelligens, specifikt multimodala stora språkmodeller, kan titta på dessa vardagliga mobilklipp och själva skilja åt typerna.

Två typer av likartade nödsituationer

Epileptiska och funktionella anfall kan se lika ut för ett otränat öga, men de har mycket olika orsaker och behandlingar. Epileptiska anfall beror på onormal elektrisk aktivitet i hjärnan och behandlas vanligen med medicin eller kirurgi. Funktionella anfall, däremot, drivs inte av sådana hjärnimpulser; de är verkliga och plågsamma händelser som har sina rötter i komplexa hjärna–sinnes‑interaktioner och kräver annan vård, ofta med inriktning på psykologiskt stöd. Eftersom händelserna är korta och skrämmande har familjer svårt att beskriva dem korrekt. Videoinspelningar tagna i stunden ger en mer trogen bild, men att granska dem beror fortfarande på tillgång till kunniga epilepsispecialister.

Att sätta allmän AI på prov

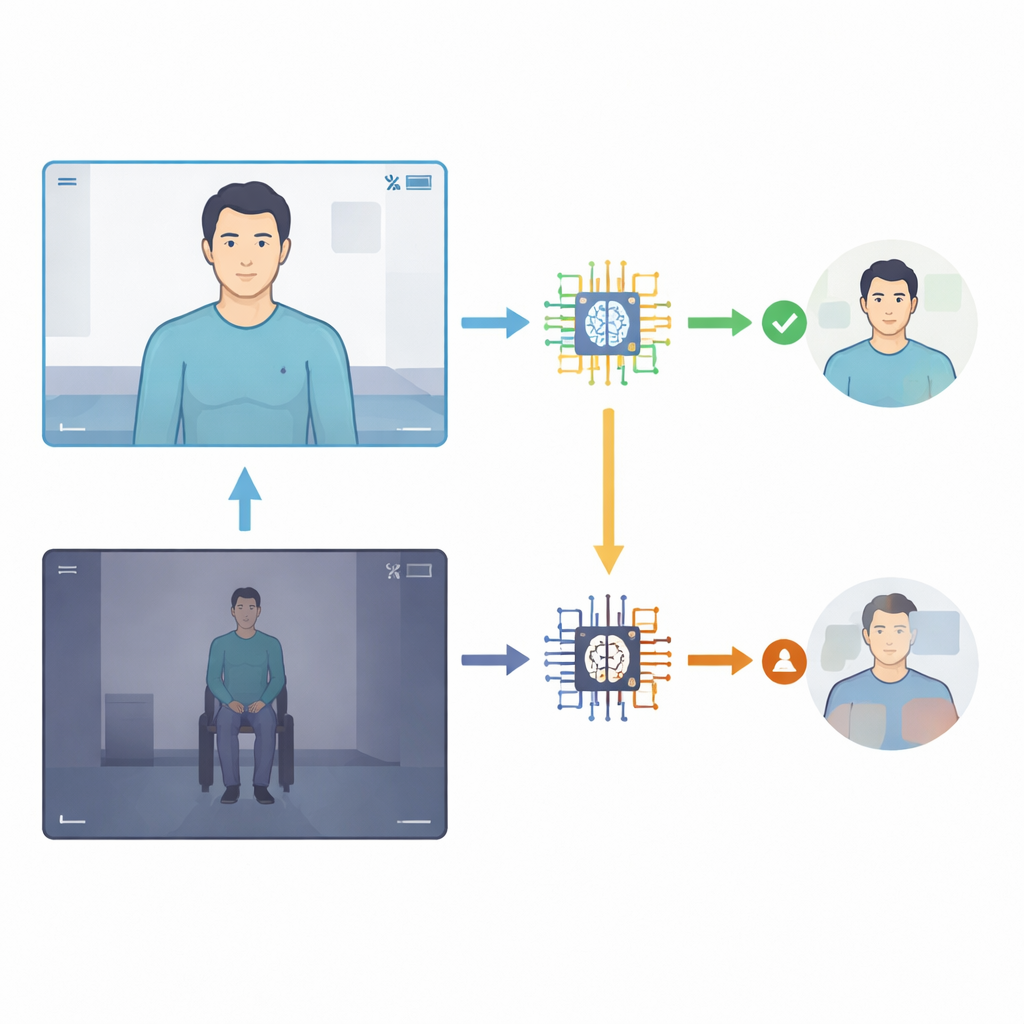

Forskarna vid ett större epilepticenter samlade 24 smartphonevideor från 15 vuxna vars händelser noggrant diagnostiserats med sjukhusets video‑EEG‑övervakning, referensmetoden som spelar in både hjärnvågor och beteende. Nitton klipp visade epileptiska anfall och fem visade funktionella anfall. De matade sedan varje video, utan någon bakgrundsmedicinsk information, till fyra versioner av en familj av allmänna AI‑system (Gemini 1.5 Pro, 2.0 Flash, 2.5 Flash och 2.5 Pro). Varje modell fick en enkel fråga: var händelsen epileptisk eller funktionell? AI:n ombads också ange hur säker den var på en skala från 1 till 10. Teamet jämförde AI:s svar med sjukhusets diagnoser och beräknade standardmått som noggrannhet, känslighet (hur ofta epileptiska anfall upptäcktes korrekt) och specificitet (hur ofta funktionella anfall korrekt uteslöts).

Vad AI:n hade rätt — och fel — om

Nyare versioner av AI gjorde bättre ifrån sig än äldre, men ingen kom i närheten av att ersätta en specialist. Den övergripande diagnostiska noggrannheten steg från ungefär en tredjedel rätt i den tidigaste modellen till strax över hälften rätt i de två senaste modellerna. Den senaste systemet, Gemini 2.5 Pro, var mest balanserat: det upptäckte lite mer än hälften av de epileptiska anfallen och avvisade korrekt de flesta, men inte alla, funktionella anfall. Tidigare versioner var extremt försiktiga: de felaktigt klassade nästan aldrig funktionella anfall, men missade den stora majoriteten av de epileptiska. Viktigt är att en naiv strategi att enkelt döpa varje händelse till ”epileptisk” skulle ha gett en högre rå noggrannhet än någon modell — men helt misslyckats med att skilja mellan de två tillstånden, vilket understryker hur utmanande uppgiften är.

Varför videodetaljer spelar så stor roll

Studien visade också att videons kvalitet och inramning starkt påverkade AI‑prestanda. När inspelningarna var tydliga, väl belysta och fokuserade på överkroppen eller ansiktet var de nyaste modellerna korrekta i ungefär 80–90 procent av fallen inom den delmängden. När hela kroppen visades på avstånd eller belysningen var dålig sjönk noggrannheten kraftigt, ibland till nära noll. Anfallstypen gjorde också skillnad: tidiga AI‑versioner misslyckades i princip med subtilare, icke‑skakande händelser, medan senare versioner var något bättre balanserade mellan uppenbar skakning och mindre dramatiska episoder. Men över alla modeller förblev förtroendesiffrorna höga oavsett om svaret var rätt eller fel, vilket innebär att AI ofta var ”säkert fel” — en oroande egenskap om kliniker eller patienter skulle förlita sig på dessa bedömningar.

Vad detta betyder för patienter och läkare

För närvarande är budskapet tydligt: allmän AI kan upptäcka mönster i anfallsvideor och blir långsamt bättre, men den är långt ifrån pålitlig som ett fristående diagnostiskt verktyg. Systemen missar fortfarande många epileptiska anfall, har svårt med subtila händelser och vet ännu inte när de kan ha fel. Författarna hävdar att framtida versioner behöver träning på mycket större samlingar av högkvalitativa, expertmärka medicinska videor, bättre sätt att uttrycka osäkerhet och tätare integration med patienters sjukhistorier och hjärnvågsinspelningar. Istället för att ersätta neurologer är det mer troligt att dessa verktyg blir en del av en bredare, människoorienterad ansats där smartphones, specialister och omsorgsfullt utformad AI samarbetar för att snabba upp och förfina anfallsdiagnostik.

Citering: Patel, A., Vallamchetla, S.K., Safa, A. et al. Diagnostic accuracy of multimodal large language models in differentiating epileptic from functional seizures in smartphone recorded videos. Sci Rep 16, 11719 (2026). https://doi.org/10.1038/s41598-026-46333-z

Nyckelord: epilepsi, anfallsvideor, artificiell intelligens, stora språkmodeller, medicinsk diagnos