Clear Sky Science · pt

Precisão diagnóstica de modelos de linguagem multimodais em diferenciar crises epilépticas de crises funcionais em vídeos gravados por smartphones

Por que o vídeo do seu celular pode ajudar a diagnosticar uma crise

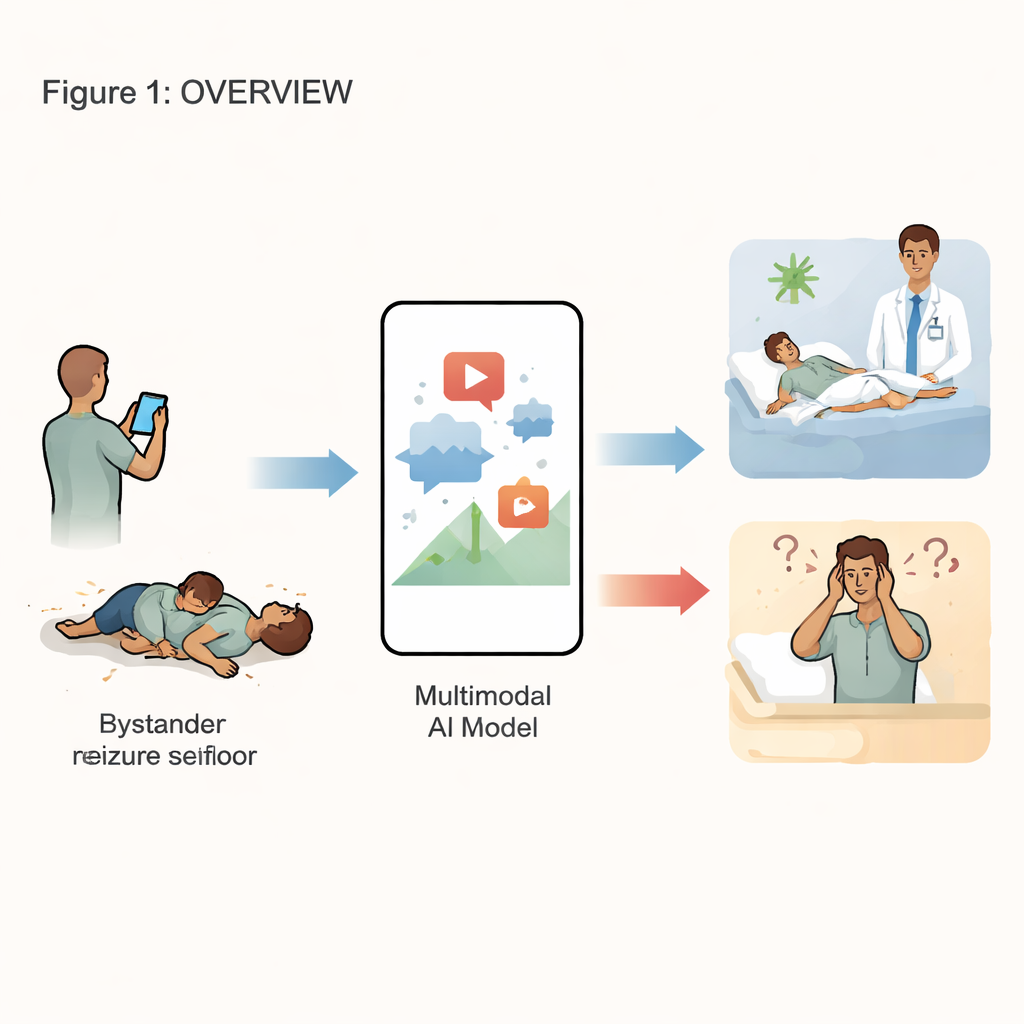

Quando alguém desaba de repente ou começa a tremer, testemunhas agora costumam fazer a mesma coisa: tirar o smartphone e apertar gravar. Esses vídeos podem fornecer pistas que salvam vidas, ajudando os médicos a decidir se o evento foi uma crise epiléptica ou um episódio semelhante chamado crise funcional. Mas há poucos neurologistas especialistas, e esperar que um especialista reveja os vídeos pode atrasar o tratamento. Este estudo pergunta se a inteligência artificial moderna, especificamente modelos de linguagem multimodais, pode assistir a esses clipes cotidianos e distinguir os tipos de evento por conta própria.

Dois tipos de emergências semelhantes

Crises epilépticas e crises funcionais podem parecer semelhantes para um olho não treinado, mas têm causas e tratamentos muito diferentes. Crises epilépticas surgem de atividade elétrica anormal no cérebro e costumam ser tratadas com medicamentos ou cirurgia. Crises funcionais, por outro lado, não são desencadeadas por essas descargas cerebrais; são eventos reais e angustiantes enraizados em interações complexas entre cérebro e mente, que exigem cuidados diferentes, frequentemente envolvendo suporte psicológico. Como os episódios são breves e assustadores, famílias têm dificuldade em descrevê‑los com precisão. Gravações de vídeo feitas no momento oferecem um retrato mais fiel, mas a revisão ainda depende do acesso a especialistas em epilepsia qualificados.

Colocando a IA de uso geral à prova

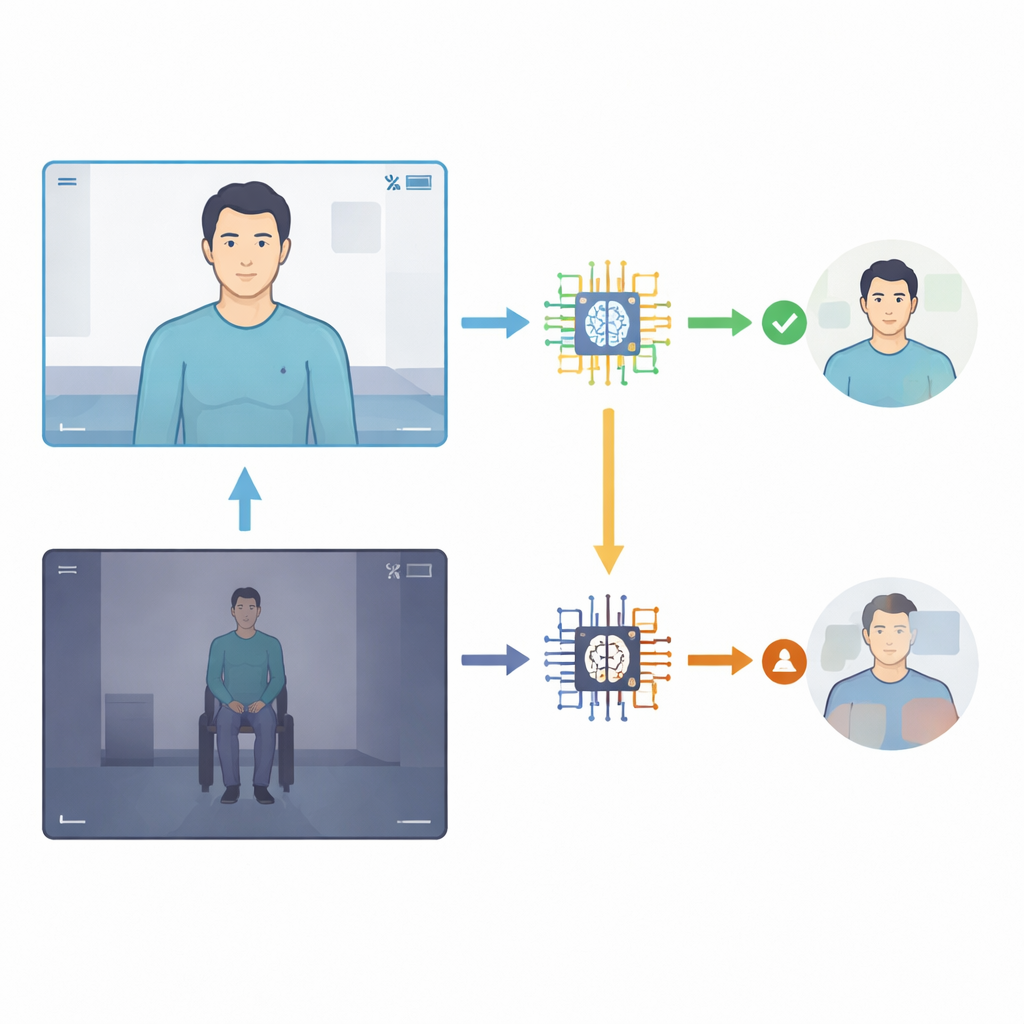

Os pesquisadores de um grande centro de epilepsia coletaram 24 vídeos de smartphone de 15 adultos cujos eventos tinham sido cuidadosamente diagnosticados usando monitoramento hospitalar por vídeo‑EEG, o padrão ouro que registra tanto as ondas cerebrais quanto o comportamento. Dezenove clipes mostravam crises epilépticas e cinco mostravam crises funcionais. Em seguida, eles submeteram cada vídeo, sem qualquer informação médica de fundo, a quatro versões de uma família de sistemas de IA de uso geral (Gemini 1.5 Pro, 2.0 Flash, 2.5 Flash e 2.5 Pro). Cada modelo recebeu uma pergunta simples: o evento foi epiléptico ou funcional? A IA também teve que informar quão confiante estava em uma escala de 1 a 10. A equipe comparou as respostas da IA com os diagnósticos hospitalares e calculou medidas padrão, como acurácia, sensibilidade (com que frequência crises epilépticas foram corretamente identificadas) e especificidade (com que frequência crises funcionais foram corretamente descartadas).

O que a IA acertou — e errou

As versões mais novas da IA foram melhores que as antigas, mas nenhuma chegou perto de substituir um especialista. A acurácia diagnóstica geral subiu de cerca de um terço de acerto no modelo mais antigo para pouco mais da metade de acerto nos dois modelos mais recentes. O sistema mais recente, Gemini 2.5 Pro, foi o mais equilibrado: detectou um pouco mais da metade das crises epilépticas e rejeitou corretamente a maioria, mas não todas, das crises funcionais. Versões anteriores foram extremamente cautelosas: quase nunca rotulavam erradamente crises funcionais, mas perderam a grande maioria das epilépticas. Importante: uma estratégia ingênua de simplesmente rotular todo evento como “epiléptico” teria produzido uma acurácia bruta maior do que qualquer modelo — embora falhasse completamente em distinguir entre as duas condições, o que ressalta o quão desafiadora é essa tarefa.

Por que os detalhes do vídeo importam tanto

O estudo também revelou que a qualidade e o enquadramento do vídeo influenciaram fortemente o desempenho da IA. Quando as gravações eram nítidas, bem iluminadas e focadas na parte superior do corpo ou no rosto, os modelos mais novos acertaram em cerca de 80–90% dos casos dentro desse subconjunto. Quando o corpo inteiro aparecia de longe ou a iluminação era ruim, a acurácia caiu acentuadamente, às vezes chegando perto de zero. O tipo de crise também fez diferença: versões iniciais da IA praticamente falharam em eventos mais sutis, sem tremores, enquanto versões posteriores foram um pouco mais equilibradas entre episódios óbvios de tremor e eventos menos dramáticos. Ainda assim, em todos os modelos, as pontuações de confiança permaneceram altas quer a resposta estivesse certa ou errada, o que significa que a IA frequentemente estava “confidentemente errada” — uma característica preocupante se clínicos ou pacientes viessem a confiar nesses julgamentos.

O que isso significa para pacientes e médicos

Por enquanto, a mensagem é clara: IA de uso geral pode perceber padrões em vídeos de crise e está melhorando gradualmente, mas continua longe de ser confiável como ferramenta diagnóstica autônoma. Os sistemas ainda deixam passar muitas crises epilépticas, têm dificuldade com eventos sutis e ainda não sabem quando podem estar errando. Os autores argumentam que versões futuras precisarão de treinamento em coleções muito maiores de vídeos médicos de alta qualidade rotulados por especialistas, melhores formas de expressar incerteza e integração mais próxima com históricos dos pacientes e registros de ondas cerebrais. Em vez de substituir neurologistas, essas ferramentas provavelmente farão parte de uma abordagem mais ampla e centrada no humano, em que smartphones, especialistas e IA cuidadosamente projetada trabalham juntos para acelerar e aprimorar o diagnóstico de crises.

Citação: Patel, A., Vallamchetla, S.K., Safa, A. et al. Diagnostic accuracy of multimodal large language models in differentiating epileptic from functional seizures in smartphone recorded videos. Sci Rep 16, 11719 (2026). https://doi.org/10.1038/s41598-026-46333-z

Palavras-chave: epilepsia, vídeos de convulsão, inteligência artificial, modelos de linguagem de grande porte, diagnóstico médico