Clear Sky Science · sv

YOLO-Starfish: fiskobjektdetektering lär sig komplexa undervattensdrag

Varför det är så svårt att upptäcka fisk under vatten

Från klimatförändringar till överfiske är det avgörande att förstå vad som händer under vattenytan. Forskare och fiskeförvaltare förlitar sig i allt större utsträckning på undervattenskameror för att räkna och identifiera fiskar, men de bilder som samlas in är ofta grumliga, blå‑gröna i tonen och fyllda med överlappande djur. Att manuellt granska tusentals timmars video är både långsamt och felbenäget. Denna artikel presenterar YOLO‑Starfish, ett kompakt artificiellt intelligenssystem utformat för att hjälpa undervattsrobotar och kameror att automatiskt hitta fisk i dessa svåra förhållanden, tillsammans med en ny, rikt detaljerad bilddatabas med sötvattensfiskar.

Undervattensvärlden genom en kameras ögon

Undervattensobjektdetektering är inte bara vanlig bildanalys med lite vatten tillsatt. Ljuset beter sig väldigt annorlunda i floder och sjöar: röda våglängder försvinner snabbt, partiklar sprider ljus i många riktningar, och sikten kan gå från klart till grumligt på bara några meter. Fiskarna själva lägger till ytterligare svårigheter. Olika arter kan se mycket lika ut, individer av samma art kan variera från små juveniler till stora vuxna, och de överlappar ofta, gömmer sig bland växter eller simmar in och ut ur skuggor. Många befintliga AI‑metoder har tränats på relativt rena, välbelysta bilder och ser sällan sådana röriga scener, så de får problem när de används i fält.

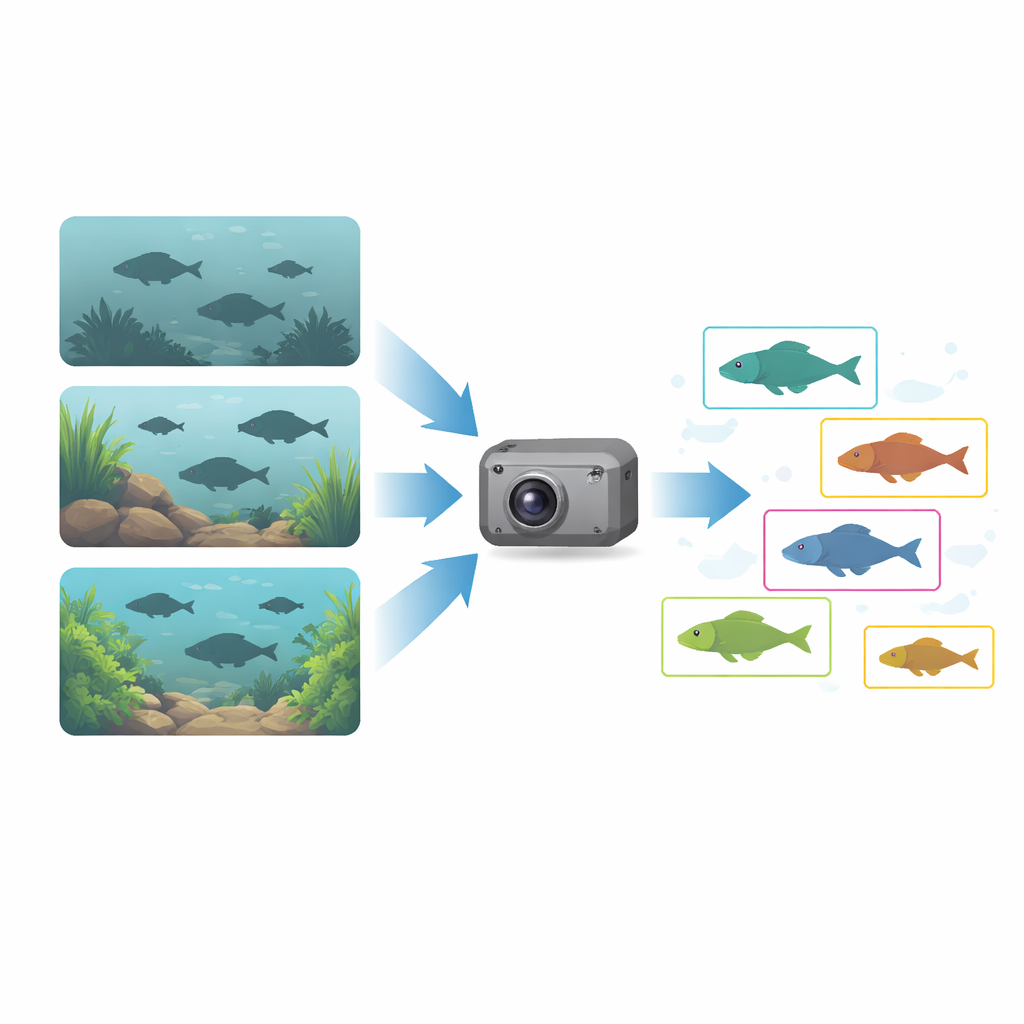

Att bygga en realistisk fotosamling av fisk

För att åtgärda denna lucka samlade författarna först Underwater Freshwater Fish Dataset (UFFD), en stor samling verklighetsnära undervattensbilder. De hämtade offentliga videor från olika sötvattensmiljöer, extraherade bildrutor automatiskt med jämna intervall och valde sedan noggrant ut och märkte högkvalitativa bilder. Istället för att fokusera på bara några kända karparter bestämde de sig för att märka varje igenkännbar fisk, och slutade med 19 kategorier, inklusive en klass för ”okänd fisk” för individer som inte kunde identifieras med säkerhet. Den slutliga datamängden innehåller 18 594 bilder (16 904 unika), och täcker ett brett spektrum av vattensklarhet, ljusförhållanden, kameradistanser och fiskstorlekar. Viktigt är att artfördelningen följer ett ”long‑tailed” mönster: ett fåtal arter är vanliga medan många är sällsynta—precis som i verkliga ekosystem.

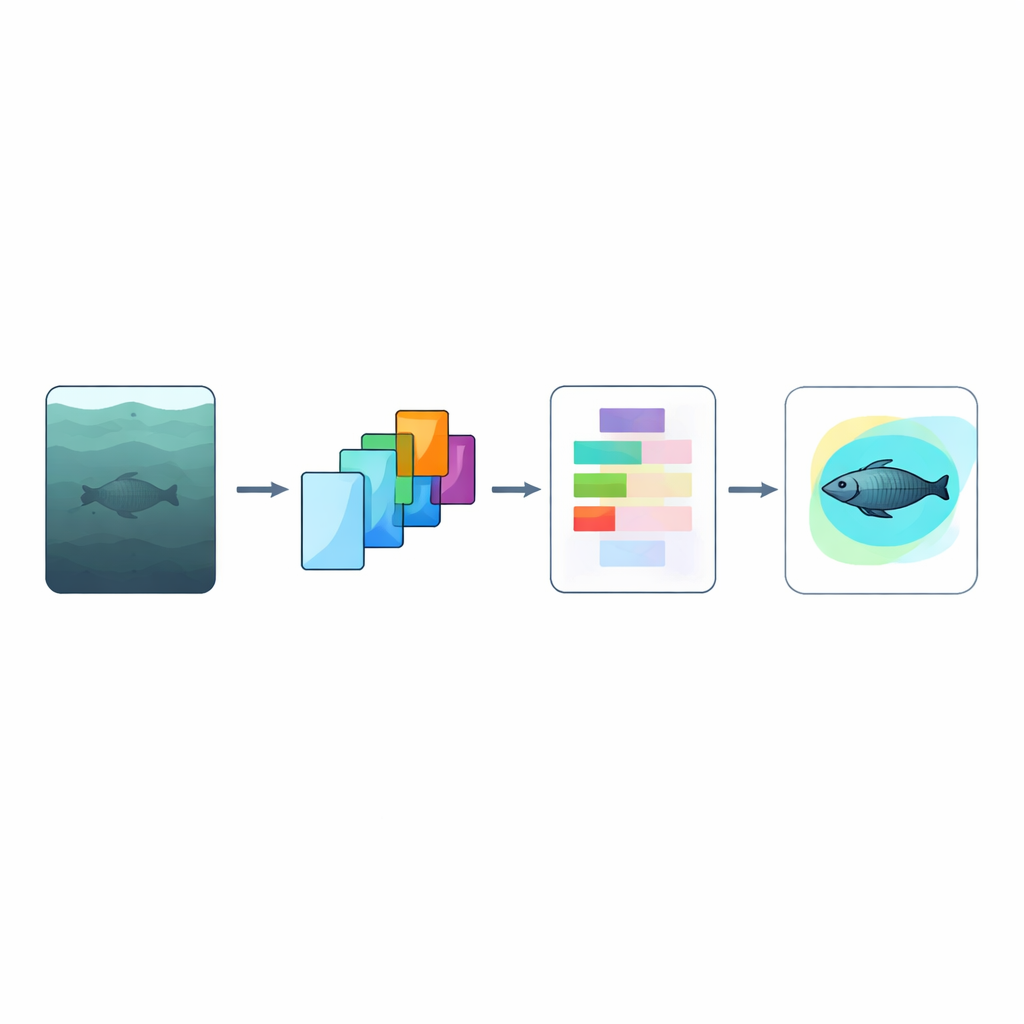

En smartare metod för att läsa degraderade bilder

Ovanpå denna datamängd byggde teamet YOLO‑Starfish, en förbättrad version av den populära realtidsdetektorn YOLOv8. Två nyckelidéer driver uppgraderingen. För det första ändrar C2Star‑modulen hur nätverket kombinerar interna funktioner. Istället för att helt enkelt addera mönster multiplicerar den dem elementvis i en så kallad ”star‑operation”. Detta speglar hur ljus faktiskt försvagas när det färdas genom vatten, där signaler skalas snarare än bara begravs i brus. Matematiskt gör denna multiplikation det möjligt för nätverket att representera mer komplexa kombinationer av former och färger utan att bli skrymmande, vilket är viktigt för batteridrivna undervattsrobotar med begränsad beräkningskraft.

Låta nätverket avgöra vad som verkligen betyder något

Den andra innovationen, Attention‑Driven Enhancement Module (ADEM), fokuserar på vilken information som är pålitlig i varje bild. Eftersom vatten ofta tar bort vissa färgkanaler—speciellt rött—kan den vanliga praktiken att behandla varje färg lika vilseleda en detektor. ADEM komprimerar all färgkanalsinformation till ett enda vägledande värde som uppskattar hur tillförlitliga kanalerna är överlag. Den kombinerar sedan denna globala signal med spatial uppmärksamhet, som framhäver specifika regioner i bilden, och använder en enkel regel att ”ta det maximala” istället för en direkt summa. I scener där färgledtrådar är starka lutar modellen mer mot kanalinformation; när färgerna är utspädda förlitar den sig mer på spatiala mönster som former och kanter. Den resulterande uppmärksamhetskartan används slutligen för att förstärka eller dämpa funktioner över bilden på ett flexibelt, datadrivet sätt.

Hur bra fungerar YOLO‑Starfish?

Författarna testade YOLO‑Starfish på tre benchmarks: deras nya UFFD‑dataset, en befintlig undervattensdatabas (RUOD) och den vida använda allmänna samlingen COCO2017. På alla tre förbättrade tillsatsen av C2Star och ADEM detektionsresultaten jämfört med baslinje‑YOLOv8, ofta med flera procentenheter, samtidigt som antalet modellparametrar och beräkningar något minskade. Vinsterna var särskilt märkbara i svåra fall i UFFD, såsom sällsynta ”tail”‑arter med få träningsexempel och den samlande ”okänd fisk”‑kategorin, vilket tyder på bättre generalisering till nya eller tvetydiga utseenden. På COCO2017 stod sig YOLO‑Starfish också väl mot andra toppmoderna små modeller, vilket visar att förbättringarna är allmänt användbara och inte begränsade till undervattensbilder.

Vad detta betyder för övervakning av vatten

I grunden visar studien att genomtänkt AI‑design kan överbrygga klyftan mellan rena laboratoriebilder och den röriga, färgförvanskade världen under ytan. Genom att para en realistisk sötvattensdatabas med fysikaliskt inspirerad funktionsbearbetning (C2Star) och adaptiv uppmärksamhet (ADEM) levererar YOLO‑Starfish mer exakt fiskdetektion utan att kräva tung hårdvara. För ekologer, fiskeförvaltare och robotikingenjörer kan den här typen av verktyg göra långsiktig, storskalig övervakning av vattenliv mycket mer praktisk och erbjuda en klarare, automatiserad bild av undervattensmiljöer och hur de förändras över tid.

Citering: Gong, R., Xu, J., Zheng, Z. et al. YOLO-Starfish: fish object detection learning complex underwater features. Sci Rep 16, 13964 (2026). https://doi.org/10.1038/s41598-026-44187-z

Nyckelord: undervattensfiskdetektion, datorseende, djuplärande, vattenekologi, robotisk övervakning