Clear Sky Science · pl

YOLO-Starfish: wykrywanie ryb z uczeniem się złożonych cech podwodnych

Dlaczego wykrywanie ryb pod wodą jest tak trudne

Od zmian klimatu po przełowienie — zrozumienie tego, co dzieje się pod powierzchnią wody, ma kluczowe znaczenie. Naukowcy i zarządcy rybołówstwa coraz częściej polegają na kamerach podwodnych do liczenia i identyfikacji ryb, jednak zebrane obrazy są często mętne, zabarwione na niebiesko‑zielono i pełne zachodzących na siebie osobników. Ręczne przeglądanie tysięcy godzin wideo jest powolne i podatne na błędy. W artykule przedstawiono YOLO‑Starfish, kompaktowy system sztucznej inteligencji zaprojektowany, by pomagać robotom podwodnym i kamerom automatycznie znajdować ryby w tych trudnych warunkach, oraz nowy, bogato opisany zbiór obrazów słodkowodnych ryb.

Świat pod wodą oczami kamery

Wykrywanie obiektów pod wodą to nie jest tylko zwykła analiza obrazu z dodatkiem wody. Światło zachowuje się inaczej w rzekach i jeziorach: czerwone długości fal szybko znikają, cząstki rozpraszają światło w wielu kierunkach, a widoczność może zmieniać się z przejrzystej na mętną w ciągu kilku metrów. Same ryby dokładają kolejną trudność. Różne gatunki mogą wyglądać bardzo podobnie, osobniki tego samego gatunku mogą mieć rozmiary od maleńkich młodych do dużych dorosłych, często zachodzą na siebie, chowają się między roślinami lub pływają w i poza cieniami. Wiele istniejących podejść AI było trenowanych na stosunkowo czystych, dobrze oświetlonych obrazach i rzadko trafia na takie złożone sceny, dlatego mają problemy po wdrożeniu w naturze.

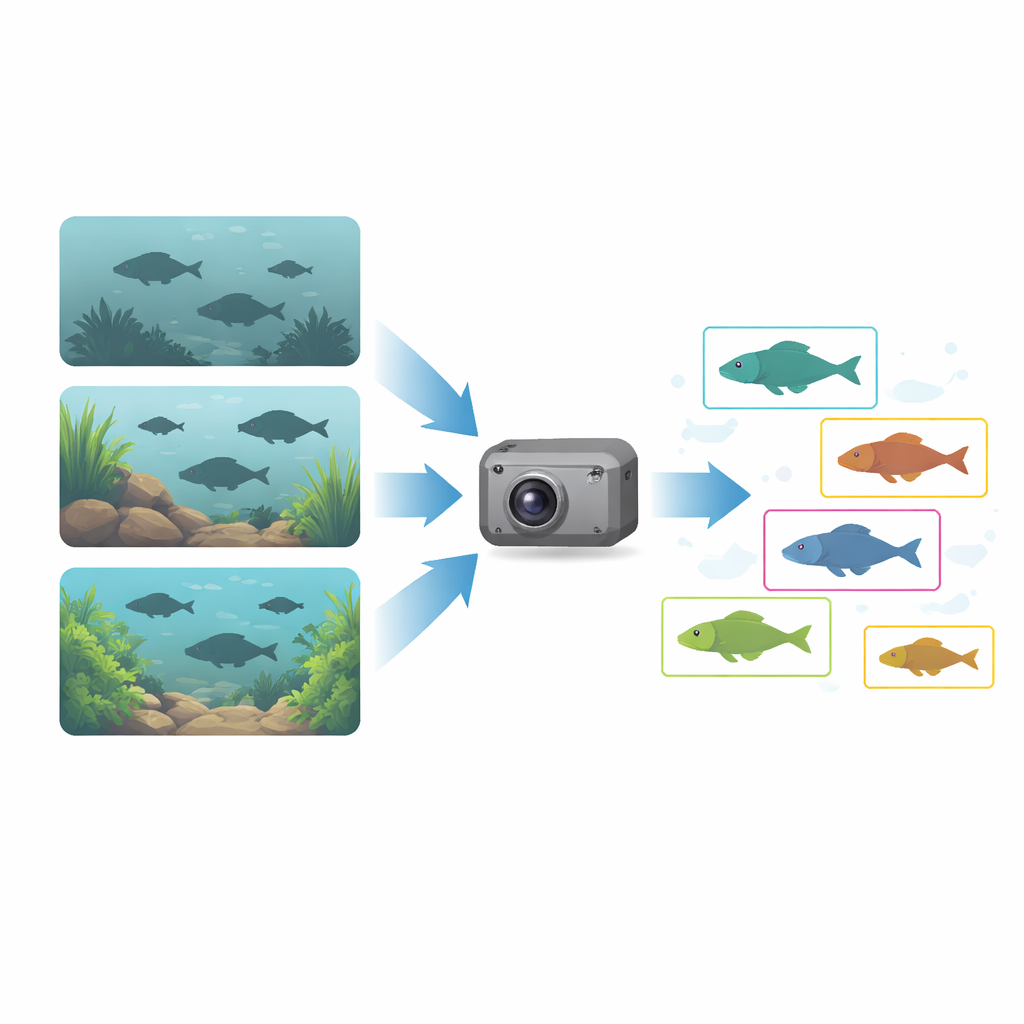

Budowanie realistycznej kolekcji zdjęć ryb

Aby wypełnić tę lukę, autorzy najpierw zebrali Underwater Freshwater Fish Dataset (UFFD), dużą kolekcję obrazów podwodnych z prawdziwego świata. Wykorzystali publiczne nagrania z różnych siedlisk słodkowodnych, automatycznie wyciągali klatki w regularnych odstępach, a następnie starannie wybierali i oznaczali obrazy o wysokiej jakości. Zamiast skupiać się jedynie na kilku znanych gatunkach karpi, postanowili oznaczyć każdą rozpoznawalną rybę, kończąc na 19 kategoriach, w tym klasie „nieznana ryba” dla okazów, których nie dało się pewnie zidentyfikować. Końcowy zbiór zawiera 18 594 obrazów (16 904 unikalne), obejmując szeroki zakres przejrzystości wody, warunków oświetleniowych, odległości kamery i rozmiarów ryb. Co ważne, liczebność gatunków wykazuje wzorzec „długiego ogona”: kilka gatunków jest powszechnych, podczas gdy wiele jest rzadkich — podobnie jak w rzeczywistych ekosystemach.

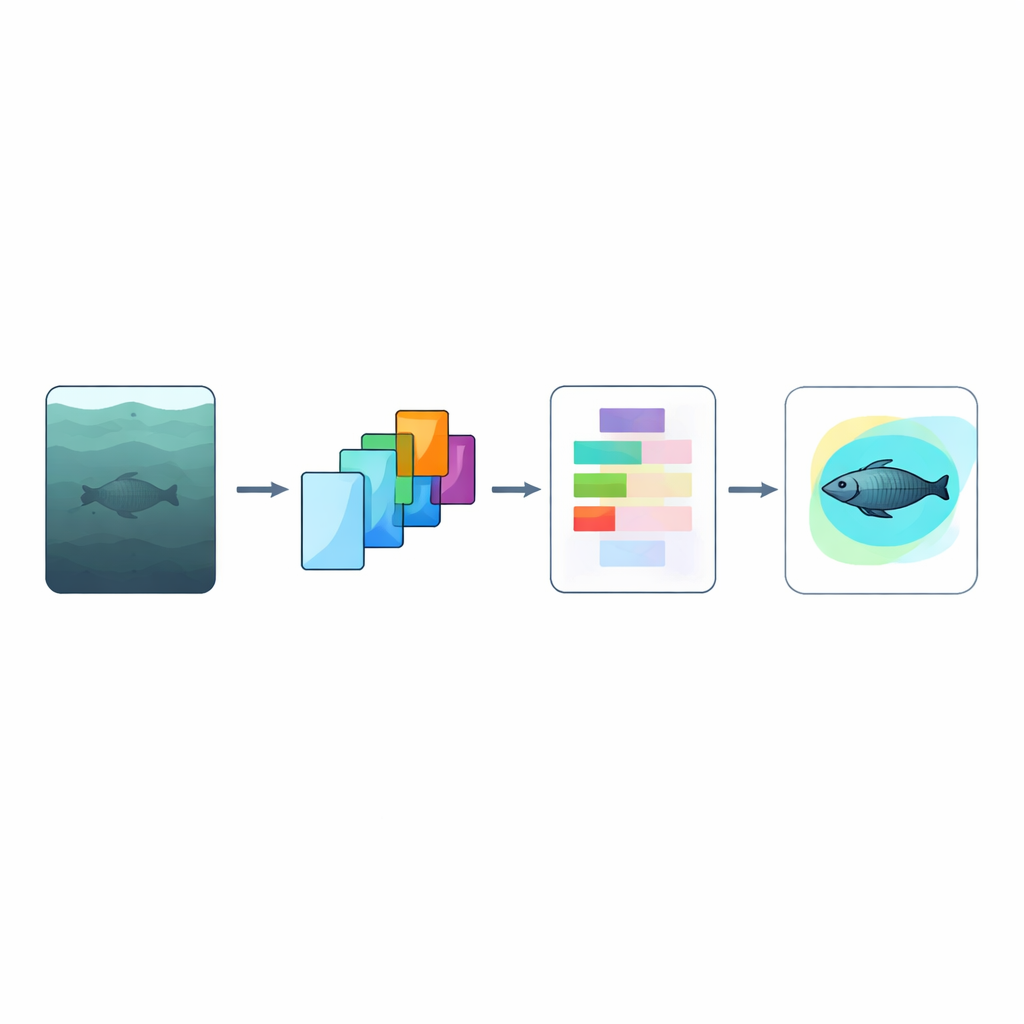

Inteligentniejsze podejście do zdegradowanych obrazów

Na bazie tego zbioru zespół zbudował YOLO‑Starfish, ulepszoną wersję popularnego detektora w czasie rzeczywistym YOLOv8. Dwie kluczowe idee napędzają tę modernizację. Po pierwsze, moduł C2Star zmienia sposób, w jaki sieć łączy wewnętrzne cechy. Zamiast po prostu dodawać wzorce, mnoży je element po elemencie w tzw. „operacji gwiazdy”. To odzwierciedla, jak światło faktycznie jest osłabiane w trakcie podróży przez wodę, gdzie sygnały są skalowane, a nie tylko zagłuszane szumem. Matematycznie to mnożenie pozwala sieci reprezentować bardziej złożone kombinacje kształtów i kolorów bez zwiększania rozmiarów modelu, co jest istotne dla zasilanych bateryjnie robotów podwodnych o ograniczonej mocy obliczeniowej.

Pozwolić sieci zdecydować, co naprawdę ma znaczenie

Drugą innowacją jest Attention‑Driven Enhancement Module (ADEM), skupiający się na tym, które informacje są godne zaufania w każdym obrazie. Ponieważ woda często pozbawia niektóre kanały kolorów — zwłaszcza czerwony — zwykła praktyka traktowania wszystkich kanałów jednakowo może wprowadzać detektor w błąd. ADEM kompresuje informację ze wszystkich kanałów kolorów do jednej wartości sterującej, która ocenia ogólną wiarygodność tych kanałów. Następnie łączy ten sygnał globalny z uwagą przestrzenną, która wyróżnia konkretne obszary na obrazie, używając prostej zasady „weź maksimum” zamiast zwykłego sumowania. W scenach, w których wskazówki kolorystyczne są silne, model bardziej polega na informacji z kanałów; gdy kolory są wypłowiałe, opiera się bardziej na wzorcach przestrzennych, takich jak kształty i krawędzie. Powstała mapa uwagi jest ostatecznie używana do wzmocnienia lub stłumienia cech w całym obrazie w elastyczny, oparty na danych sposób.

Jak dobrze działa YOLO‑Starfish?

Autorzy przetestowali YOLO‑Starfish na trzech benchmarkach: ich nowym zbiorze UFFD, istniejącym zbiorze podwodnym (RUOD) oraz szeroko stosowanym ogólnego przeznaczenia zbiorem COCO2017. We wszystkich trzech dodanie C2Star i ADEM poprawiło wyniki detekcji względem bazowego YOLOv8, często o kilka punktów procentowych, przy jednoczesnym nieznacznym zmniejszeniu liczby parametrów modelu i obliczeń. Zyski były szczególnie zauważalne w trudnych przypadkach w UFFD, takich jak rzadkie gatunki z „ogonem” z niewieloma przykładami treningowymi oraz kategoria „nieznana ryba”, co sugeruje lepszą uogólnialność na nowe lub niejednoznaczne wyglądy. Na COCO2017 YOLO‑Starfish także radził sobie dobrze w porównaniu z innymi nowoczesnymi małymi modelami, wykazując, że ulepszenia są szeroko użyteczne, a nie ograniczone do obrazów podwodnych.

Co to oznacza dla obserwacji wód

W istocie badanie pokazuje, że przemyślane projektowanie AI może zniwelować przepaść między czystymi obrazami laboratoryjnymi a chaotycznym, zniekształconym kolorystycznie światem pod powierzchnią. Łącząc realistyczny zbiór zdjęć słodkowodnych ryb z cechami inspirowanymi fizyką (C2Star) i adaptacyjną uwagą (ADEM), YOLO‑Starfish dostarcza dokładniejsze wykrywanie ryb bez potrzeby ciężkiego sprzętu. Dla ekologów, zarządców rybołówstwa i robotyków takie narzędzie może uczynić długoterminowy, szeroko zakrojony monitoring życia wodnego znacznie bardziej praktycznym, oferując czytelniejszy, zautomatyzowany obraz ekosystemów podwodnych i ich zmian w czasie.

Cytowanie: Gong, R., Xu, J., Zheng, Z. et al. YOLO-Starfish: fish object detection learning complex underwater features. Sci Rep 16, 13964 (2026). https://doi.org/10.1038/s41598-026-44187-z

Słowa kluczowe: wykrywanie ryb pod wodą, widzenie komputerowe, uczenie głębokie, ekologia wodna, monitoring robotyczny