Clear Sky Science · pt

YOLO-Starfish: detecção de objetos peixes aprendendo características complexas embaixo d’água

Por que detectar peixes debaixo d’água é tão difícil

De mudanças climáticas à sobrepesca, entender o que acontece abaixo da superfície da água é essencial. Cientistas e gestores pesqueiros cada vez mais dependem de câmeras subaquáticas para contar e identificar peixes, mas as imagens que coletam costumam ser turvas, com tonalidade azul‑esverdeada e cheias de animais sobrepostos. Revisar manualmente milhares de horas de vídeo é lento e sujeito a erros. Este artigo apresenta o YOLO‑Starfish, um sistema de inteligência artificial compacto projetado para ajudar robôs e câmeras subaquáticas a encontrar peixes automaticamente nessas condições difíceis, junto com um novo conjunto de imagens de água doce rico em detalhes.

O mundo subaquático pelos olhos de uma câmera

A detecção de objetos subaquáticos não é apenas uma análise de imagem comum com um pouco de água adicionada. A luz se comporta de maneira muito diferente em rios e lagos: comprimentos de onda vermelhos desaparecem rapidamente, partículas espalham a luz em muitas direções e a visibilidade pode mudar de clara para turva em poucos metros. Os próprios peixes adicionam outra camada de dificuldade. Espécies diferentes podem parecer muito semelhantes, indivíduos da mesma espécie podem variar de juvenis minúsculos a adultos grandes, e eles frequentemente se sobrepõem, se escondem entre plantas ou nadam dentro e fora de sombras. Muitas abordagens de IA existentes foram treinadas em imagens relativamente limpas e bem iluminadas e raramente veem cenas tão confusas, por isso têm dificuldade quando são usadas em campo.

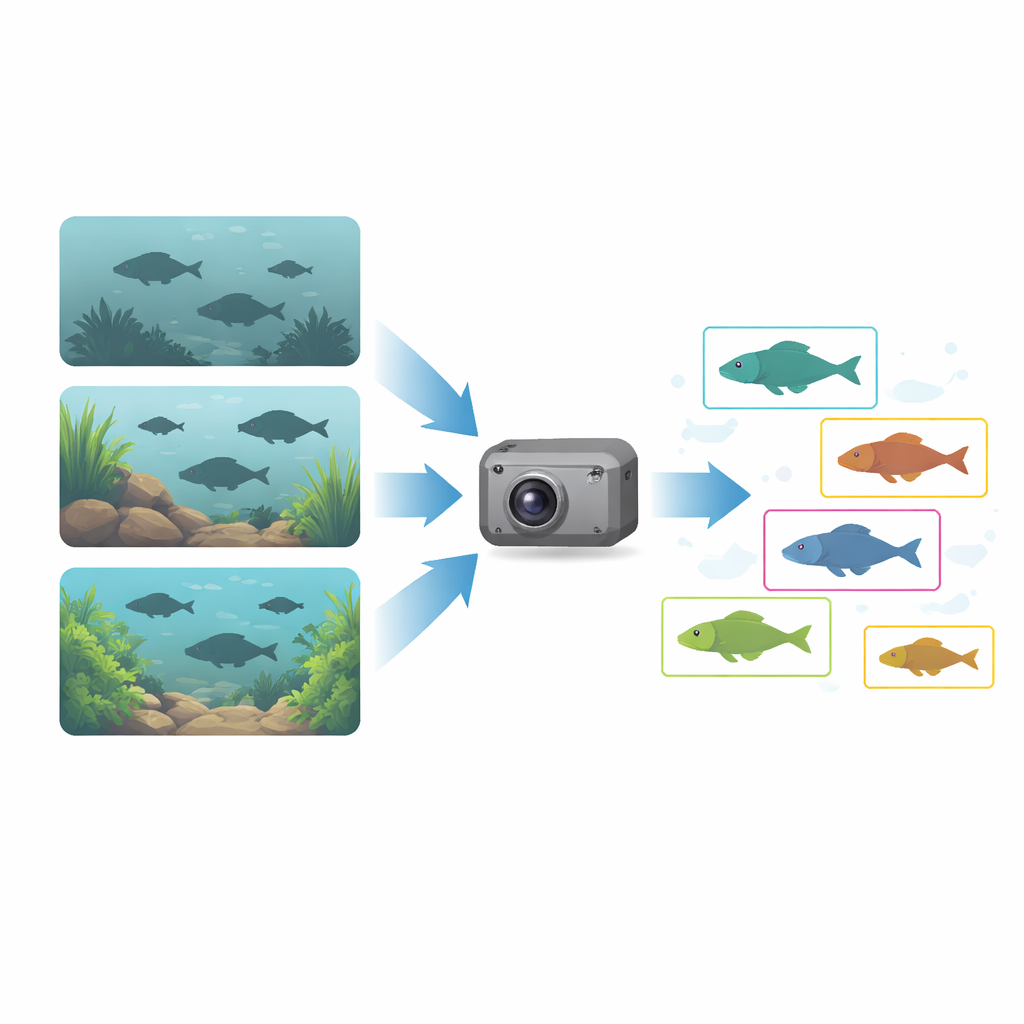

Construindo uma coleção realista de fotos de peixes

Para enfrentar essa lacuna, os autores primeiro reuniram o Underwater Freshwater Fish Dataset (UFFD), uma grande coleção de imagens subaquáticas do mundo real. Eles coletaram vídeos públicos de habitats de água doce diversos, extraíram quadros automaticamente em intervalos regulares e então selecionaram e rotularam cuidadosamente imagens de alta qualidade. Em vez de focar em apenas algumas espécies de carpas famosas, decidiram rotular todo peixe reconhecível, terminando com 19 categorias, incluindo uma classe “peixe desconhecido” para indivíduos que não puderam ser identificados com confiança. O conjunto final contém 18.594 imagens (16.904 únicas), cobrindo uma ampla variedade de clareza da água, condições de iluminação, distâncias da câmera e tamanhos de peixes. Importante: a contagem de espécies segue um padrão "longa cauda": poucas espécies são comuns, enquanto muitas são raras — muito parecido com ecossistemas reais.

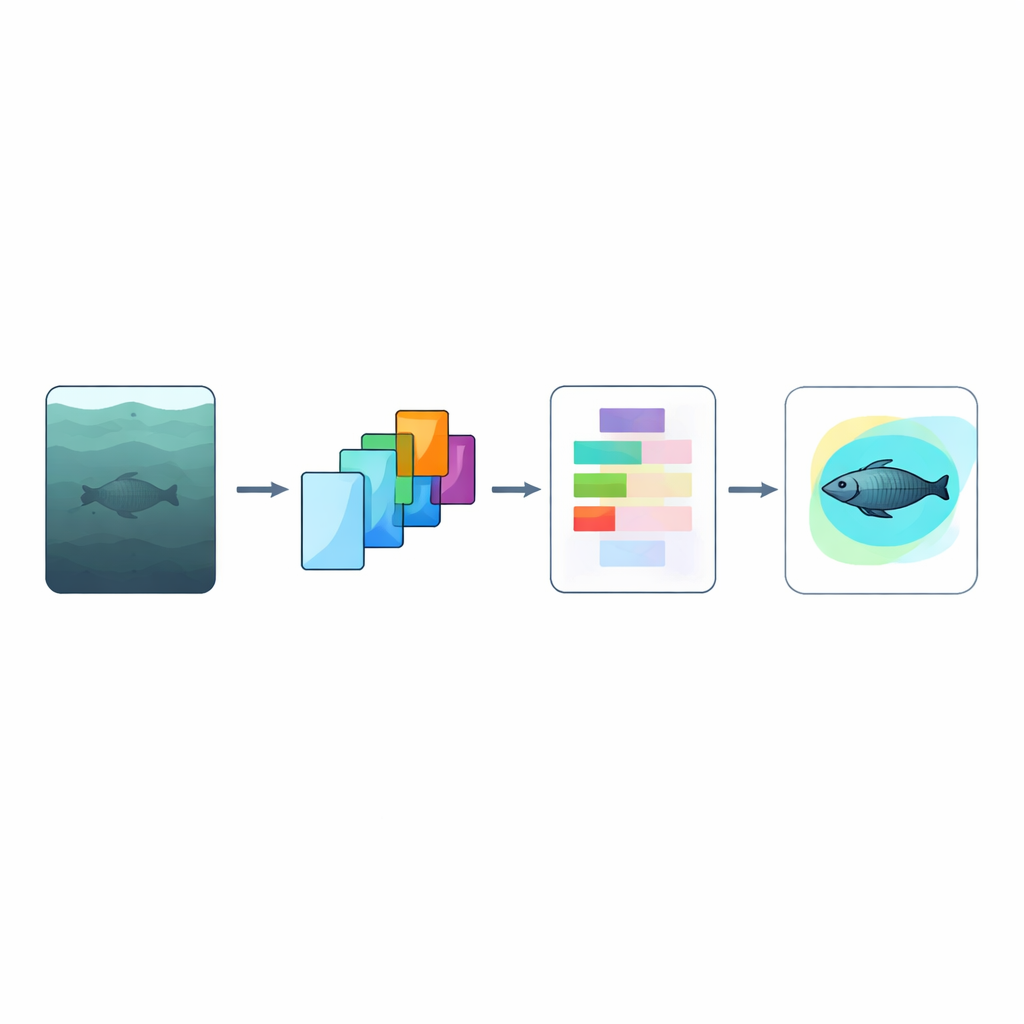

Uma maneira mais inteligente de interpretar imagens degradadas

Sobre esse conjunto de dados, a equipe construiu o YOLO‑Starfish, uma versão aprimorada do popular detector em tempo real YOLOv8. Duas ideias principais orientam a melhoria. Primeiro, o módulo C2Star altera como a rede combina características internas. Em vez de simplesmente somar padrões, ele os multiplica elemento a elemento em uma chamada "operação estrela". Isso reflete como a luz é efetivamente atenuada ao viajar pela água, onde sinais são escalados em vez de apenas soterrados por ruído. Matematicamente, essa multiplicação permite à rede representar combinações mais complexas de formas e cores sem ficar volumosa, o que é vital para robôs subaquáticos alimentados por bateria com poder de computação limitado.

Deixar a rede decidir o que realmente importa

A segunda inovação, o Módulo de Realce Orientado por Atenção (ADEM), concentra‑se em quais informações são confiáveis em cada imagem. Como a água frequentemente elimina alguns canais de cor — especialmente o vermelho — a prática usual de tratar cada cor igualmente pode confundir um detector. O ADEM comprime toda a informação dos canais de cor em um único valor orientador que estima quão confiáveis esses canais são no geral. Em seguida, ele combina esse indicativo global com atenção espacial, que destaca regiões específicas na imagem, usando uma regra simples de "pegar o máximo" em vez de uma soma direta. Em cenas onde as pistas de cor são fortes, o modelo confia mais nas informações de canal; quando as cores estão lavadas, ele recorre mais a padrões espaciais como formas e contornos. O mapa de atenção resultante é então usado para reforçar ou suprimir características pela imagem de forma flexível e orientada por dados.

Quão bem o YOLO‑Starfish funciona?

Os autores testaram o YOLO‑Starfish em três benchmarks: seu novo conjunto UFFD, um conjunto subaquático existente (RUOD) e a coleção de propósito geral amplamente usada COCO2017. Em todos os três, adicionar C2Star e ADEM melhorou as pontuações de detecção em relação ao YOLOv8 básico, frequentemente por vários pontos percentuais, enquanto reduziu ligeiramente o número de parâmetros do modelo e o cálculo. Os ganhos foram especialmente notáveis em casos difíceis do UFFD, como espécies raras de "cauda" com poucos exemplos de treinamento e a categoria genérica "peixe desconhecido", sugerindo melhor generalização para aparências novas ou ambíguas. No COCO2017, o YOLO‑Starfish também se saiu bem frente a outros modelos pequenos de ponta, mostrando que as melhorias são amplamente úteis e não limitadas a imagens subaquáticas.

O que isso significa para a observação da água

Em essência, o estudo mostra que IA projetada com critério pode reduzir a lacuna entre imagens limpas de laboratório e o mundo bagunçado e com cores distorcidas abaixo da superfície. Ao emparelhar um conjunto de dados realista de peixes de água doce com processamento de características inspirado na física (C2Star) e atenção adaptativa (ADEM), o YOLO‑Starfish oferece detecção de peixes mais precisa sem exigir hardware pesado. Para ecologistas, gestores de pesca e roboticistas, esse tipo de ferramenta pode tornar o monitoramento de longo prazo e em grande escala da vida aquática muito mais viável, oferecendo uma visão automatizada e mais clara dos ecossistemas subaquáticos e de como eles mudam ao longo do tempo.

Citação: Gong, R., Xu, J., Zheng, Z. et al. YOLO-Starfish: fish object detection learning complex underwater features. Sci Rep 16, 13964 (2026). https://doi.org/10.1038/s41598-026-44187-z

Palavras-chave: detecção de peixes subaquática, visão computacional, aprendizado profundo, ecologia aquática, monitoramento robótico