Clear Sky Science · nl

YOLO-Starfish: visobjectdetectie die complexe onderwaterkenmerken leert

Waarom het zo moeilijk is om vissen onder water te zien

Van klimaatverandering tot overbevissing: begrijpen wat er onder het wateroppervlak gebeurt is cruciaal. Wetenschappers en visserijbeheerders vertrouwen steeds vaker op onderwatercamera’s om vissen te tellen en te identificeren, maar de beelden zijn vaak troebel, blauwgroen getint en vol overlappende dieren. Het handmatig bekijken van duizenden uren video is traag en foutgevoelig. Dit artikel introduceert YOLO‑Starfish, een compact kunstmatig‑intelligentiesysteem dat onderwaterrobots en camera’s helpt vissen automatisch te vinden in deze lastige omstandigheden, plus een nieuwe, zeer gedetailleerde afbeeldingsdataset van zoetwatervissen.

De onderwaterwereld door de ogen van een camera

Onderwaterobjectdetectie is niet gewoon reguliere beeldanalyse met een scheutje water erbij. Licht gedraagt zich heel anders in rivieren en meren: rode golflengten verdwijnen snel, deeltjes verstrooien licht in vele richtingen en de zichtbaarheid kan binnen meters van helder naar troebel veranderen. Vissen zelf vormen een extra moeilijkheid. Verschillende soorten kunnen erg op elkaar lijken, vissen van dezelfde soort variëren van kleine jongen tot grote adulten, en ze overlappen vaak, verbergen zich tussen planten of zwemmen in en uit schaduw. Veel bestaande AI‑benaderingen zijn getraind op relatief schone, goed verlichte beelden en zien zelden zulke rommelige scènes, waardoor ze moeite hebben zodra ze in het veld worden ingezet.

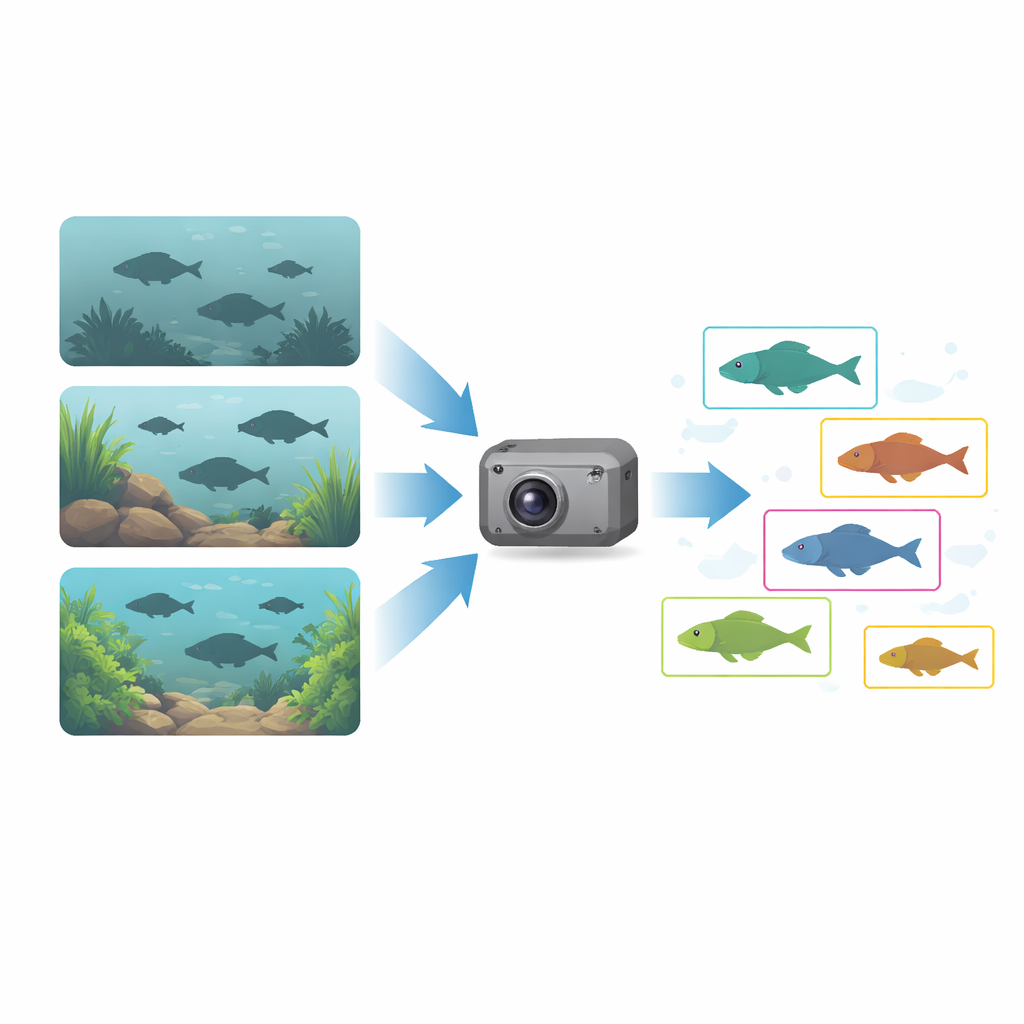

Een realistische fotocollectie van vissen opbouwen

Om deze kloof te dichten stelden de auteurs eerst de Underwater Freshwater Fish Dataset (UFFD) samen, een grote verzameling onderwaterbeelden uit echte situaties. Ze verzamelden openbare video’s uit diverse zoetwaterhabitats, pakten automatisch frames met regelmatige tussenpozen en selecteerden en labelden vervolgens zorgvuldig hoogwaardige beelden. In plaats van zich te concentreren op een paar bekende karpersoorten, besloten ze elke herkenbare vis te labelen, resulterend in 19 categorieën, inclusief een “onbekende vis” klasse voor individuen die niet met vertrouwen konden worden geïdentificeerd. De uiteindelijke dataset bevat 18.594 afbeeldingen (16.904 unieke), met een breed scala aan waterhelderheid, lichtomstandigheden, camerafafstanden en vissengroottes. Belangrijk is dat de soortaantallen een ‘long‑tailed’ patroon volgen: enkele soorten zijn algemeen, terwijl veel soorten zeldzaam zijn—net als in echte ecosystemen.

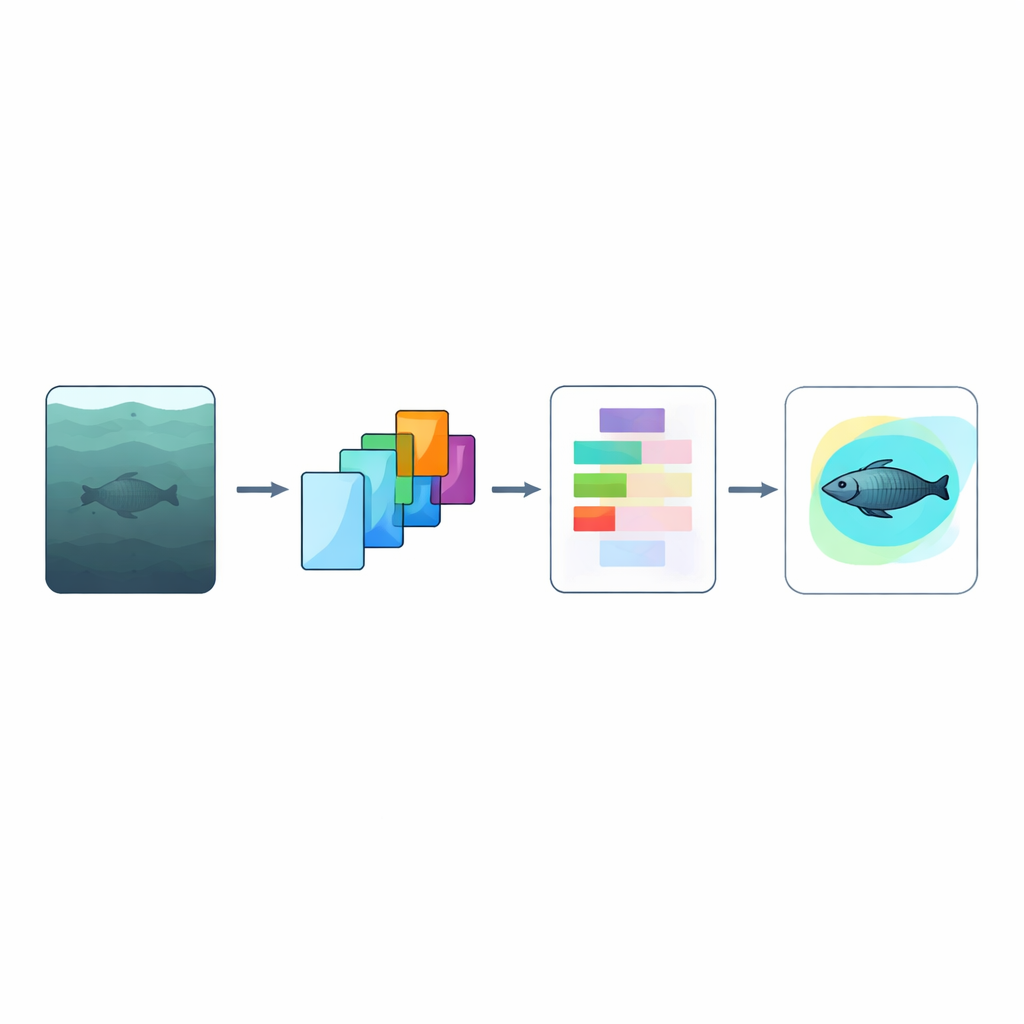

Een slimmere manier om aangetaste beelden te lezen

Bovenop deze dataset bouwde het team YOLO‑Starfish, een verbeterde versie van de populaire realtimedetector YOLOv8. Twee sleutelideeën drijven de upgrade. Ten eerste verandert de C2Star‑module hoe het netwerk interne kenmerken combineert. In plaats van patronen simpelweg op te tellen, vermenigvuldigt het ze elementgewijs in een zogenoemde “star‑operatie”. Dit weerspiegelt hoe licht daadwerkelijk verzwakt tijdens het reizen door water, waar signalen worden geschaald in plaats van alleen verstoord. Wiskundig maakt deze vermenigvuldiging het het netwerk mogelijk complexere combinaties van vormen en kleuren te representeren zonder omvangrijk te worden, wat essentieel is voor batterijgevoede onderwaterrobots met beperkte rekencapaciteit.

Het netwerk laten bepalen wat echt belangrijk is

De tweede innovatie, de Attention‑Driven Enhancement Module (ADEM), richt zich op welke informatie in elk beeld betrouwbaar is. Omdat water vaak sommige kleurkanalen wegneemt—vooral rood—kan de gebruikelijke praktijk om elke kleur gelijk te behandelen een detector misleiden. ADEM comprimeert alle kleurkanaalinformatie tot één leidende waarde die inschat hoe betrouwbaar die kanalen in het algemeen zijn. Het combineert dit globale signaal vervolgens met ruimtelijke aandacht, die specifieke regio’s in het beeld benadrukt, en gebruikt een eenvoudige ‘neem de maximaalwaarde’ regel in plaats van een rechte optelsom. In scènes waar kleuraanwijzingen sterk zijn, leunt het model meer op kanaalinformatie; wanneer kleuren weggevaagd zijn, vertrouwt het meer op ruimtelijke patronen zoals vormen en randen. De resulterende aandachtkaart wordt tenslotte gebruikt om kenmerken over het beeld heen flexibel te versterken of te onderdrukken op een datagedreven manier.

Hoe goed werkt YOLO‑Starfish?

De auteurs testten YOLO‑Starfish op drie benchmarks: hun nieuwe UFFD‑dataset, een bestaande onderwaterdataset (RUOD) en de veelgebruikte algemene COCO2017‑verzameling. Op alle drie verbeterden het toevoegen van C2Star en ADEM de detectiescores ten opzichte van de basislijn YOLOv8, vaak met enkele procentpunten, terwijl het aantal modelparameters en de rekentijd licht afnamen. De winst was vooral opvallend bij moeilijke gevallen in UFFD, zoals zeldzame ‘staart’‑soorten met weinig trainingsvoorbeelden en de vang‑het‑helemaal ‘onbekende vis’ categorie, wat wijst op betere generalisatie naar nieuwe of ambigu uitziende exemplaren. Op COCO2017 kon YOLO‑Starfish zich ook meten met andere state‑of‑the‑art kleine modellen, wat laat zien dat de verbeteringen breed bruikbaar zijn en niet beperkt tot onderwaterbeelden.

Wat betekent dit voor het observeren van wateren

In wezen toont de studie aan dat doordacht ontworpen AI de kloof kan overbruggen tussen schone laboratoriumbeelden en de rommelige, kleurvervormde wereld onder de oppervlakte. Door een realistische zoetwatervissendataset te combineren met fysiek geïnspireerde feature‑verwerking (C2Star) en adaptieve aandacht (ADEM), levert YOLO‑Starfish nauwkeurigere visdetectie zonder zwaar hardwareverbruik. Voor ecologen, visserijbeheerders en roboticus‑ontwerpers kan dit soort hulpmiddel langdurige, grootschalige monitoring van aquatisch leven veel praktischer maken, en een helderder, geautomatiseerd beeld bieden van onderwaterecosystemen en hoe die in de loop van de tijd veranderen.

Bronvermelding: Gong, R., Xu, J., Zheng, Z. et al. YOLO-Starfish: fish object detection learning complex underwater features. Sci Rep 16, 13964 (2026). https://doi.org/10.1038/s41598-026-44187-z

Trefwoorden: onderwater visdetectie, computer vision, deep learning, aquatische ecologie, robotisch toezicht