Clear Sky Science · de

YOLO-Starfish: Fisch‑Objekterkennung lernt komplexe Unterwasser‑Merkmale

Warum das Erkennen von Fischen unter Wasser so schwierig ist

Von Klimawandel bis Überfischung: Zu verstehen, was unter der Wasseroberfläche geschieht, ist entscheidend. Wissenschaftler und Fischereimanager verlassen sich zunehmend auf Unterwasserkameras, um Fische zu zählen und zu identifizieren, doch die Bilder sind oft trüb, blau‑grün getönt und voller sich überlappender Tiere. Tausende Stunden Video manuell zu sichten ist langsam und fehleranfällig. Diese Arbeit stellt YOLO‑Starfish vor, ein kompaktes KI‑System, das Unterwasserrobotern und Kameras helfen soll, Fische in diesen schwierigen Bedingungen automatisch zu finden, sowie einen neuen, reichhaltig annotierten Bilddatensatz von Süßwasserfischen.

Die Unterwasserwelt durch die Augen einer Kamera

Unterwasser‑Objekterkennung ist nicht einfach normale Bildanalyse mit einem Spritzer Wasser. Licht verhält sich in Flüssen und Seen völlig anders: Rote Wellenlängen verschwinden schnell, Partikel streuen das Licht in viele Richtungen, und die Sichtweite kann sich innerhalb weniger Meter von klar zu trüb ändern. Fische selbst erschweren die Aufgabe zusätzlich. Verschiedene Arten können sehr ähnlich aussehen, Exemplare derselben Art reichen von winzigen Jungtieren bis zu großen Erwachsenen, und sie überlappen sich häufig, verstecken sich in Pflanzen oder schwimmen in und aus Schatten. Viele bestehende KI‑Methoden wurden an relativ sauberen, gut beleuchteten Bildern trainiert und sehen solche chaotischen Szenen selten, sodass sie in freier Wildbahn versagen.

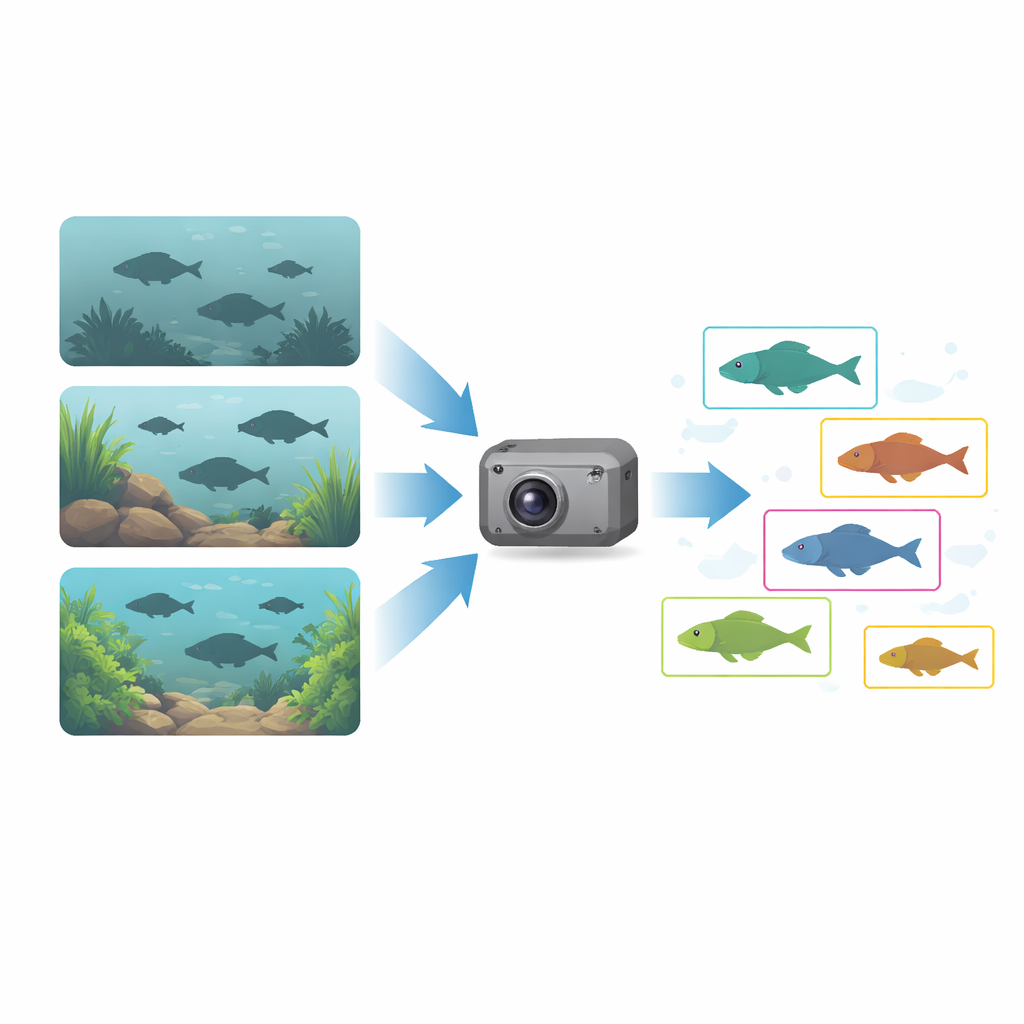

Aufbau einer realistischen Fischfotokollektion

Um diese Lücke zu schließen, stellten die Autoren zunächst das Underwater Freshwater Fish Dataset (UFFD) zusammen, eine große Sammlung realer Unterwasserbilder. Sie sammelten öffentliche Videos aus unterschiedlichen Süßwasserhabitaten, extrahierten automatisch regelmäßig Frames und wählten dann mühsam hochwertige Bilder aus und annotierten sie. Statt sich nur auf einige bekannte Karpfenarten zu konzentrieren, entschieden sie sich, jede erkennbare Fischart zu markieren und landeten bei 19 Kategorien, einschließlich einer Klasse „unbekannter Fisch“ für Individuen, die nicht eindeutig bestimmt werden konnten. Der finale Datensatz enthält 18.594 Bilder (16.904 eindeutige) und deckt eine große Bandbreite an Wassertrübheit, Lichtverhältnissen, Kameradistanzen und Fischgrößen ab. Wichtig ist, dass die Artenhäufigkeiten einem „long‑tailed“-Muster folgen: Einige Arten sind häufig, viele sind selten — ganz wie in realen Ökosystemen.

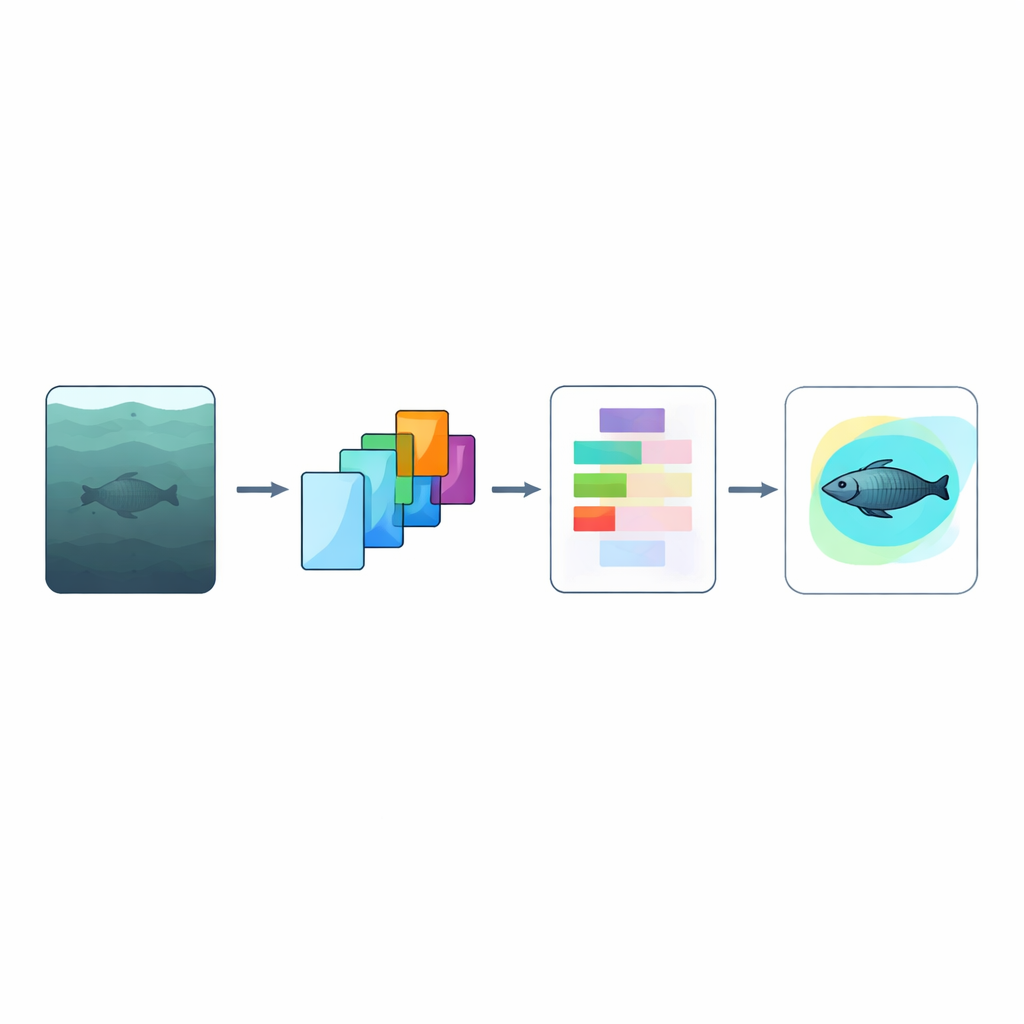

Eine klügere Methode, degradierte Bilder zu lesen

Auf diesem Datensatz baut das Team YOLO‑Starfish auf, eine verbesserte Version des verbreiteten Echtzeitdetektors YOLOv8. Zwei zentrale Ideen treiben das Upgrade. Erstens verändert das C2Star‑Modul, wie das Netzwerk interne Merkmale kombiniert. Statt Muster einfach zu addieren, multipliziert es sie Element für Element in einer sogenannten „Stern‑Operation“. Das spiegelt wider, wie Licht tatsächlich beim Durchgang durch Wasser abgeschwächt wird, wobei Signale skaliert werden, statt nur im Rauschen zu verschwinden. Mathematisch erlaubt diese Multiplikation dem Netzwerk, komplexere Kombinationen von Formen und Farben darzustellen, ohne unnötig groß zu werden — wichtig für batteriegetriebene Unterwasserroboter mit begrenzter Rechenleistung.

Dem Netzwerk überlassen, was wirklich zählt

Die zweite Innovation, das Attention‑Driven Enhancement Module (ADEM), konzentriert sich darauf, welche Informationen in jedem Bild vertrauenswürdig sind. Weil Wasser oft einige Farbkanäle — insbesondere Rot — auslöscht, kann die übliche Praxis, alle Farben gleich zu behandeln, einen Detektor in die Irre führen. ADEM komprimiert die Informationen aller Farbkanäle zu einem einzigen Leitwert, der abschätzt, wie zuverlässig diese Kanäle insgesamt sind. Dieser globale Hinweis wird dann mit räumlicher Aufmerksamkeit kombiniert, die bestimmte Bildregionen hervorhebt, wobei eine einfache „Nimm das Maximum“-Regel statt einer einfachen Summe verwendet wird. In Szenen mit starken Farbhinweisen stützt sich das Modell stärker auf Kanalinformationen; sind die Farben ausgewaschen, verlässt es sich mehr auf räumliche Muster wie Formen und Kanten. Die resultierende Aufmerksamkeitskarte wird schließlich genutzt, um Merkmale im Bild flexibel datengetrieben zu verstärken oder zu dämpfen.

Wie gut funktioniert YOLO‑Starfish?

Die Autoren testeten YOLO‑Starfish auf drei Benchmarks: ihrem neuen UFFD‑Datensatz, einem bestehenden Unterwasserdatensatz (RUOD) und der weit verbreiteten allgemeinen COCO2017‑Sammlung. Auf allen drei verbesserte die Ergänzung durch C2Star und ADEM die Detektionswerte gegenüber dem Baseline‑YOLOv8, oft um mehrere Prozentpunkte, während die Anzahl der Modellparameter und die Rechenlast leicht reduziert wurden. Die Gewinne waren besonders bemerkenswert bei schwierigen Fällen in UFFD, wie seltenen „Schwanz“-Arten mit wenigen Trainingsbeispielen und der Auffangkategorie „unbekannter Fisch“, was auf eine bessere Generalisierung auf neue oder mehrdeutige Erscheinungen hindeutet. Auf COCO2017 hielt sich YOLO‑Starfish auch gegenüber anderen state‑of‑the‑art‑kleinen Modellen wacker, was zeigt, dass die Verbesserungen breit nützlich sind und sich nicht nur auf Unterwasserbilder beschränken.

Was das für die Beobachtung des Wassers bedeutet

Im Kern zeigt die Studie, dass durchdacht gestaltete KI die Lücke zwischen sauberen Laborbildern und der chaotischen, farbverzerrten Welt unter der Oberfläche überbrücken kann. Durch die Kombination eines realistischen Süßwasser‑Fischdatensatzes mit physikalisch inspirierten Merkmalverarbeitungen (C2Star) und adaptiver Aufmerksamkeit (ADEM) liefert YOLO‑Starfish genauere Fischdetektion, ohne schwere Hardware zu verlangen. Für Ökologen, Fischereimanager und Robotiker könnte ein solches Werkzeug Langzeit‑ und großmaßstäbliche Überwachungen aquatischen Lebens deutlich praktikabler machen und eine klarere, automatisierte Sicht auf Unterwasserökosysteme und ihre Veränderungen im Laufe der Zeit bieten.

Zitation: Gong, R., Xu, J., Zheng, Z. et al. YOLO-Starfish: fish object detection learning complex underwater features. Sci Rep 16, 13964 (2026). https://doi.org/10.1038/s41598-026-44187-z

Schlüsselwörter: Unterwasser‑Fischerkennung, Computer Vision, Tiefes Lernen, aquatische Ökologie, robotische Überwachung