Clear Sky Science · sv

En fuzzy‑TD3 hybrid förstärkningsinlärningsram för robust spårningsstyrning av Mitsubishi RV‑2AJ‑robotarmen

Smartare robotarmar för stökiga verkliga uppgifter

Industriella robotarmar är utmärkta på att upprepa samma rörelse om och om igen, men de kan halka när uppgiften eller miljön förändras även marginellt. Denna artikel presenterar ett nytt sätt att ge en vanlig fabrikslik robotarm stabiliteten hos en traditionell regulator och anpassningsförmågan hos artificiell intelligens samtidigt. Målet är enkelt men krävande: få armen att följa komplexa 3D‑banor precist, även när dess last ändras eller den utsätts för stötar och störningar, utan att behöva en perfekt matematisk modell av maskinen.

Varför exakt rörelse är svårt för robotar

Moderna robotarmar, som den 5‑ledade Mitsubishi RV‑2AJ som studeras här, är komplicerade mekaniska system. Deras leder påverkar varandra, rörelserna är starkt icke‑linjära och i verkliga fabriker måste de klara friktion, vibrationer, sensornos och okända laster. Klassiska styrmetoder, som PID‑regulatorer, är lätta att ställa in och används allmänt, men de får det svårt när roboten rör sig snabbt, bär olika föremål eller utsätts för oväntade krafter. Å andra sidan kan djup förstärkningsinlärning i princip lära utmärkta styrpolicyer genom trial‑and‑error, men i praktiken kan inlärningen gå långsamt, beteendet vara oförutsägbart i början och metoden blir ofta en ”svart låda” som ingenjörer har svårt att tolka eller lita på.

Att blanda mänskliga regler med maskininlärning

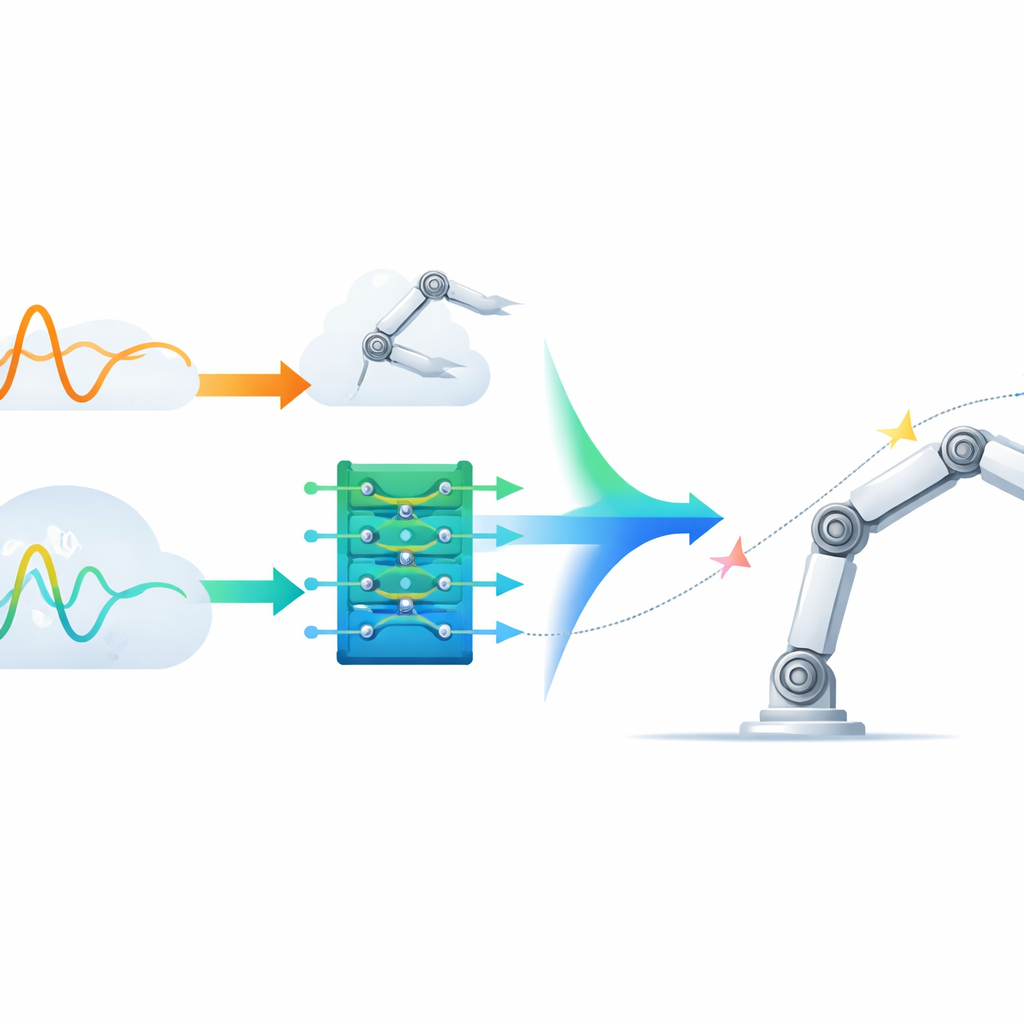

För att överbrygga denna klyfta föreslår författaren en hybridregulator som parar ihop ett fuzzy‑logiksystem—som kodar expertregler på ett tolkbart sätt—med en kraftfull förstärkningsinlärningsmetod kallad TD3. I denna konstruktion bevakar den fuzzy delen hur långt varje led avviker från sitt mål och hur snabbt detta fel förändras. Den applicerar sedan omedelbara korrigerande vridmoment enligt en kompakt uppsättning ”om–så”‑regler, ungefär som en erfaren operatör skulle göra. Detta ger ett stabilt, förståeligt basbeteende. Samtidigt lär TD3‑agenten sig, genom upprepade simuleringar, hur den ska lägga till ett mindre ”residualt” vridmoment som finjusterar rörelsen och kompenserar för svårmodellera effekter som icke‑linjär friktion eller bestående förändringar i last. De två vridmomentssignalerna summeras enkelt vid varje led, så roboten drivs alltid av ett partnerskap mellan explicita regler och inlärd anpassning.

En digital testbänk för krävande banor

Hybridregulatorn tränas och testas i en detaljerad virtuell replika av Mitsubishi‑armen byggd med multikropps‑simuleringsverktyg. Denna miljö återger armens styva länkar, ledgränser och sensorimperfektioner, vilket låter inlärningsalgoritmen utforska säkert samtidigt som den möter realistisk fysik. Forskarna utmanar regulatorn med krävande 3D‑trajektorier—N‑formade, helix‑ och spiralbanor—som kräver mjuk, koordinerad rörelse i alla leder. De injicerar också osäkerhet genom att ändra länkarnas massor och tröghetsmoment och genom att lägga till plötsliga vridmomentspulser som efterliknar stötar eller yttre knuffar. Inom denna uppställning säkerställer fuzzy‑komponenten att armen inte beter sig vilt, medan TD3‑agenten gradvis förbättrar prestationen genom att maximera en belöningssignal som värdesätter noggrannhet, jämnhet och energieffektivitet.

Hur hybriden slår sina rivaler

Över alla testade banor presterar den hybridiska fuzzy‑TD3‑regulatorn bättre än både en ren TD3‑regulator och en tidigare hybrid som kombinerade TD3 med en standard PID. Felmått som ackumulerar avvikelse över tid visar minskningar på cirka 28–50% jämfört med enbart TD3 och ungefär 15–29% jämfört med PID‑baserade hybriden. Även när robotens fysikaliska parametrar störs och externa störningar appliceras behåller den nya regulatorn sin fördel, och minskar fel med omkring 23–34% versus TD3 och 11–17% versus PID‑TD3. Ytterligare analyser visar att inlärningsprocessen konvergerar smidigt, det övergripande beteendet är numeriskt stabilt och att fuzzy‑reglerna aktiveras i intuitiva mönster—mjuka, frekventa korrigeringar under normal rörelse och starkare, mer sällsynta ingripanden när armen driver långt från målet.

Att balansera precision och energianvändning

Studien visar också att regulatorn kan ställas in för att byta bort lite precision mot märkbara energibesparingar. Genom att justera en enda vikt i belöningsfunktionen lär sig algoritmen att minska genomsnittligt ledvridmoment med mer än 20% samtidigt som spårningsfelet bara ökar marginellt. Denna justerbarhet innebär att samma styrschema kan anpassas till uppgifter där effektivitet är viktigare än mikroskopisk noggrannhet, eller vice versa, utan att hela systemet måste ritas om.

Vad detta betyder för framtida robotar

I vardagstermer visar detta arbete ett lovande recept för mer pålitliga och begripbara robotarmar: låt en tydlig uppsättning människoläsbara regler hantera snabba korrigeringar och säkerhet, medan en inlärningsalgoritm diskret förfinar prestationen över tid. Resultatet är en regulator som spårar intrikata banor mer exakt, stålar av störningar, använder energi mer klokt och förblir förklarlig för ingenjörer. Sådana hybriddesigner kan hjälpa till att ta avancerad AI‑driven styrning ur laboratoriet och in i verkliga fabriker, lager och servicerobotar, där tillförlitlighet och transparens är lika viktiga som ren intelligens.

Citering: Hazem, Z.B. A fuzzy-TD3 hybrid reinforcement learning framework for robust trajectory tracking of the Mitsubishi RV-2AJ robotic arm. Sci Rep 16, 12269 (2026). https://doi.org/10.1038/s41598-026-42615-8

Nyckelord: manipulatorkontroll, förstärkningsinlärning, fuzzylogik, trajektoriespårning, robust automatisering