Clear Sky Science · fr

Un cadre d’apprentissage par renforcement hybride flou-TD3 pour le suivi de trajectoire robuste du bras robotique Mitsubishi RV-2AJ

Des bras robotisés plus intelligents pour des tâches réelles et imprévisibles

Les bras robotisés industriels excellent à répéter le même mouvement indéfiniment, mais ils peuvent échouer dès que la tâche ou l’environnement change légèrement. Cet article présente une nouvelle approche pour doter un bras robotique de type industriel d’une stabilité comparable à celle d’un contrôle traditionnel tout en lui apportant l’adaptabilité de l’intelligence artificielle. L’objectif est simple mais exigeant : faire suivre au bras des trajectoires 3D complexes avec précision, même lorsque sa charge varie ou qu’il subit des perturbations, sans nécessiter un modèle mathématique parfait de la machine.

Pourquoi le mouvement précis est difficile pour les robots

Les bras modernes, comme le robot à 5 articulations Mitsubishi RV-2AJ étudié ici, sont des systèmes mécaniques complexes. Leurs articulations s’influencent mutuellement, leur dynamique est fortement non linéaire et, en milieu industriel, ils doivent composer avec le frottement, les vibrations, le bruit des capteurs et des charges inconnues. Les méthodes de contrôle classiques, telles que les régulateurs PID, sont faciles à régler et largement utilisées, mais elles peinent lorsque le robot se déplace rapidement, transporte des objets différents ou subit des forces inattendues. À l’inverse, l’apprentissage profond par renforcement peut en principe apprendre d’excellentes politiques de contrôle par essai‑erreur, mais en pratique il peut apprendre lentement, se comporter de façon erratique au départ et rester souvent une « boîte noire » difficile à interpréter ou à approuver par les ingénieurs.

Méler règles humaines et apprentissage machine

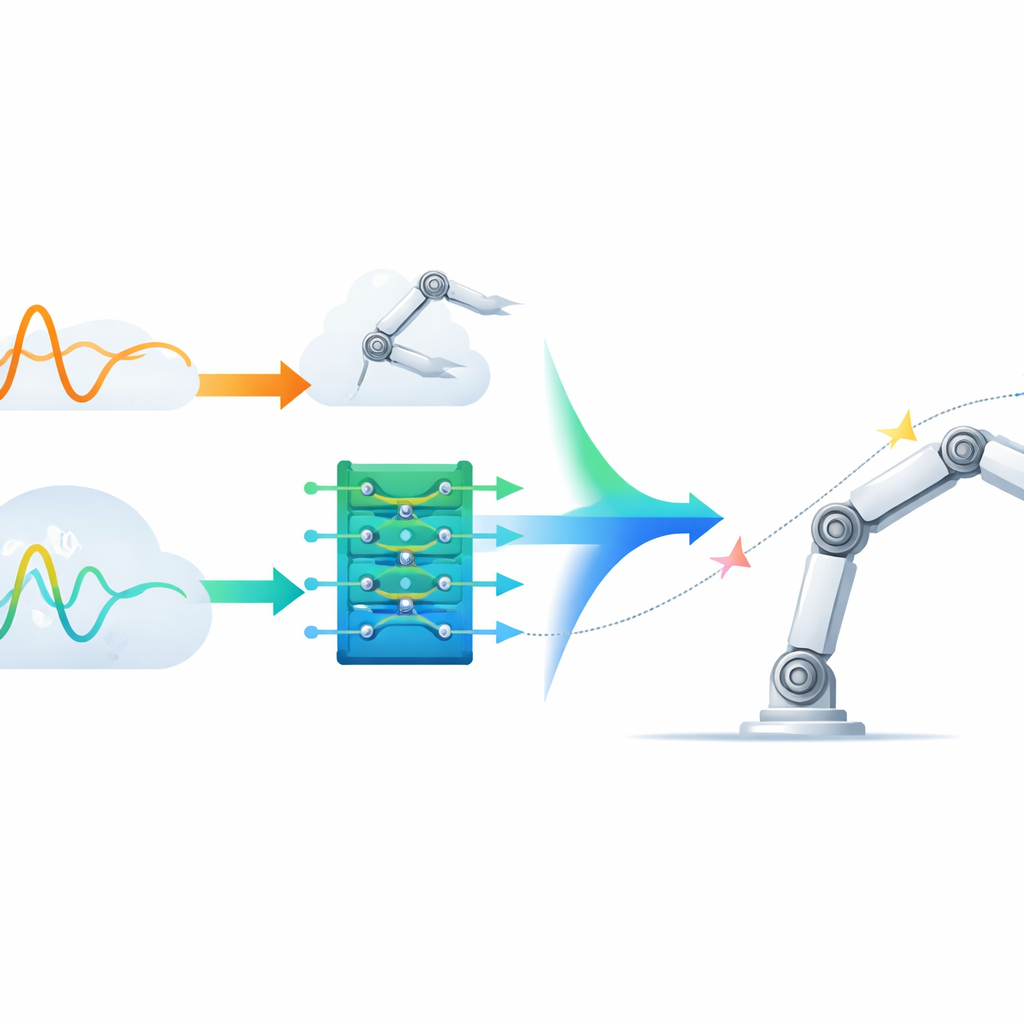

Pour combler ce fossé, l’auteur propose un contrôleur hybride associant un système de logique floue — qui encode des règles d’expert de manière interprétable — à une méthode d’apprentissage par renforcement puissante appelée TD3. Dans ce schéma, la partie floue surveille l’écart de chaque articulation par rapport à sa consigne et la vitesse de variation de cette erreur. Elle applique ensuite des couples correctifs immédiats selon un ensemble compact de règles « si–alors », à la manière d’un opérateur expérimenté. Cela fournit un comportement de base stable et compréhensible. Parallèlement, l’agent TD3 apprend, via des simulations répétées, à ajouter un petit couple « résiduel » qui affine le mouvement en compensant des effets difficiles à modéliser, comme un frottement non linéaire ou des variations persistantes de la charge transportée. Les deux signaux de couple sont simplement sommés sur chaque articulation, de sorte que le robot est toujours piloté par un partenariat entre règles explicites et adaptation apprise.

Un banc d’essai numérique pour trajectoires exigeantes

Le contrôleur hybride est entraîné et évalué dans une réplique virtuelle détaillée du bras Mitsubishi, construite avec des outils de simulation multibody. Cet environnement reproduit les liaisons rigides, les limites des articulations et les imperfections des capteurs, permettant à l’algorithme d’apprentissage d’explorer en toute sécurité tout en affrontant une physique réaliste. Les chercheurs mettent le contrôleur au défi avec des trajectoires 3D exigeantes — formes en N, trajectoires hélicoïdales et spirales — qui nécessitent un mouvement fluide et coordonné de toutes les articulations. Ils introduisent aussi de l’incertitude en modifiant les masses et les inerties des éléments et en ajoutant des impulsions de couple soudaines simulant des chocs ou des poussées externes. Dans ce cadre, la composante floue évite des comportements erratiques du bras, tandis que l’agent TD3 améliore progressivement la performance en maximisant une récompense qui valorise la précision, la fluidité et l’efficacité énergétique.

Comment l’hybride surpasse ses rivaux

Sur l’ensemble des trajectoires testées, le contrôleur hybride flou‑TD3 surpasse à la fois un contrôleur TD3 pur et un hybride antérieur combinant TD3 avec un PID classique. Les mesures d’erreur cumulées montrent des réductions d’environ 28–50 % par rapport au TD3 seul et d’environ 15–29 % par rapport à l’hybride basé sur PID. Même lorsque les paramètres physiques du robot sont perturbés et que des disturbances externes sont appliquées, le nouveau contrôleur conserve son avantage, réduisant les erreurs d’environ 23–34 % par rapport à TD3 et de 11–17 % par rapport à PID‑TD3. Des analyses additionnelles montrent que le processus d’apprentissage converge de façon régulière, que le comportement global est numériquement stable, et que les règles floues s’activent selon des schémas intuitifs — corrections douces et fréquentes en régime normal et interventions plus fortes et plus rares lorsque le bras s’écarte fortement de sa cible.

Équilibrer précision et consommation d’énergie

L’étude montre également que le contrôleur peut être réglé pour sacrifier un peu de précision au profit d’économies d’énergie significatives. En ajustant un seul poids dans la fonction de récompense, l’algorithme apprend à réduire le couple moyen aux articulations de plus de 20 % tout en n’augmentant que légèrement l’erreur de suivi. Cette possibilité d’ajustement signifie que le même schéma de commande peut être adapté aux tâches où l’efficacité prime sur la précision microscopique, ou inversement, sans repenser entièrement le système.

Ce que cela implique pour les robots de demain

Concrètement, ce travail propose une recette prometteuse pour des bras robotisés plus fiables et plus compréhensibles : laisser un ensemble clair de règles lisibles par l’humain gérer les corrections rapides et la sécurité, tandis qu’un algorithme d’apprentissage affine discrètement la performance au fil du temps. Le résultat est un contrôleur qui suit des trajectoires complexes avec plus de précision, résiste mieux aux perturbations, utilise l’énergie plus intelligemment et reste explicable pour les ingénieurs. De tels designs hybrides pourraient aider à faire sortir les commandes avancées pilotées par l’IA des laboratoires pour les amener dans les usines, entrepôts et robots de service réels, où la fiabilité et la transparence sont aussi importantes que l’intelligence brute.

Citation: Hazem, Z.B. A fuzzy-TD3 hybrid reinforcement learning framework for robust trajectory tracking of the Mitsubishi RV-2AJ robotic arm. Sci Rep 16, 12269 (2026). https://doi.org/10.1038/s41598-026-42615-8

Mots-clés: commande de bras robotique, apprentissage par renforcement, logique floue, suivi de trajectoire, automatisation robuste