Clear Sky Science · pt

Uma estrutura híbrida fuzzy‑TD3 de aprendizado por reforço para rastreamento robusto de trajetória do braço robótico Mitsubishi RV-2AJ

Braços robóticos mais inteligentes para trabalhos reais e desordenados

Braços robóticos industriais são excelentes em repetir o mesmo movimento indefinidamente, mas podem vacilar quando a tarefa ou o ambiente mudam mesmo que ligeiramente. Este artigo apresenta uma nova maneira de dotar um braço robótico estilo fábrica com a estabilidade de um controlador tradicional e a adaptabilidade da inteligência artificial ao mesmo tempo. O objetivo é simples, porém exigente: fazer o braço seguir trajetórias 3D complexas com precisão, mesmo quando sua carga varia ou ele é empurrado e perturbado, sem exigir um modelo matemático perfeito da máquina.

Por que o movimento preciso é difícil para robôs

Braços robóticos modernos, como o de 5 articulações Mitsubishi RV‑2AJ estudado aqui, são sistemas mecânicos complicados. Suas juntas se influenciam mutuamente, o movimento é altamente não linear e, em fábricas reais, eles têm de lidar com atrito, vibração, ruído dos sensores e cargas desconhecidas. Métodos clássicos de controle, como controladores PID, são fáceis de ajustar e amplamente usados, mas têm dificuldades quando o robô se move rápido, carrega objetos diferentes ou encontra forças inesperadas. Por outro lado, o aprendizado profundo por reforço pode em princípio aprender políticas de controle excelentes por tentativa e erro, mas na prática pode aprender lentamente, comportar‑se de forma errática no início e frequentemente ser uma “caixa preta” que engenheiros acham difícil de interpretar ou confiar.

Misturando regras humanas com aprendizado de máquina

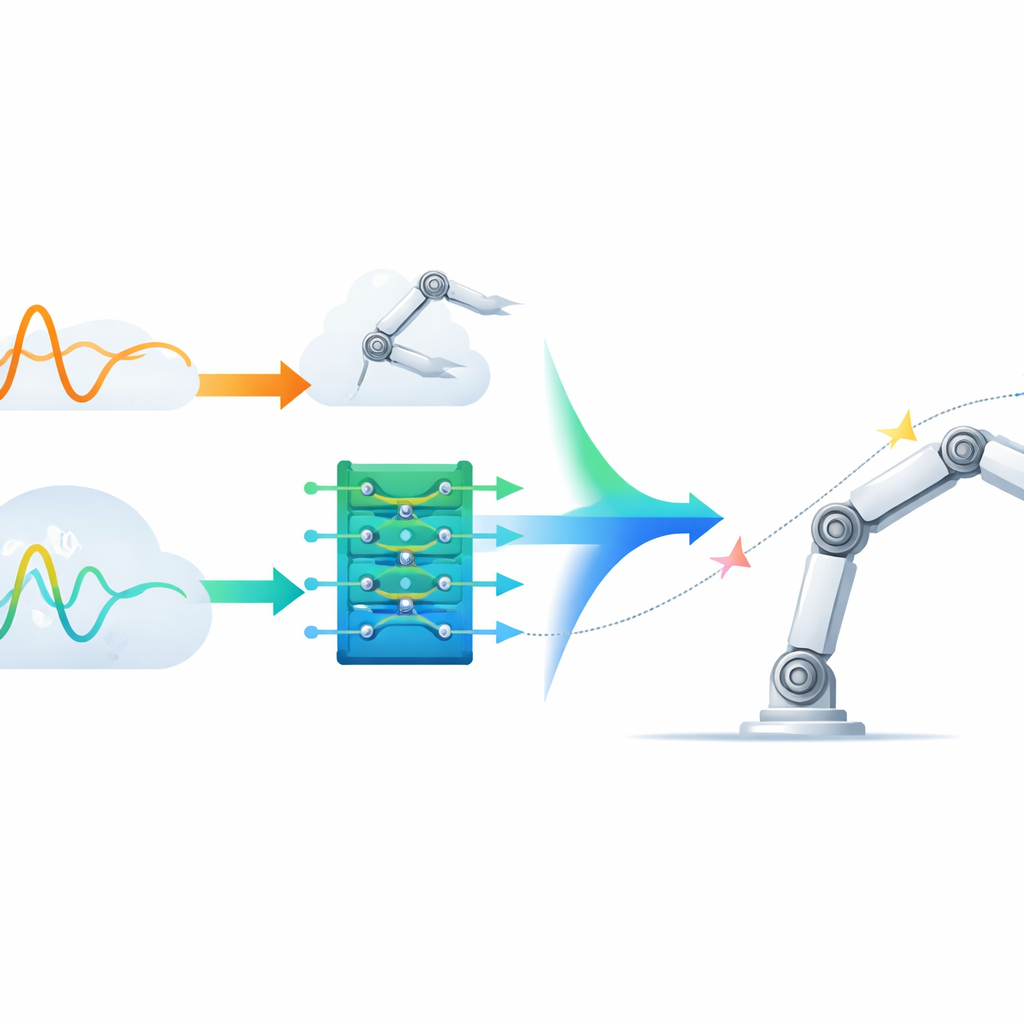

Para fechar essa lacuna, o autor propõe um controlador híbrido que emparelha um sistema de lógica fuzzy — que codifica regras de especialista de forma interpretável — com um poderoso método de aprendizado por reforço chamado TD3. Nesse projeto, a parte fuzzy observa o quanto cada junta se afasta de seu alvo e quão rapidamente esse erro está mudando. Em seguida aplica torques corretivos imediatos de acordo com um conjunto compacto de regras “se–então”, muito parecido com o que um operador experiente faria. Isso fornece um comportamento de referência estável e compreensível. Ao mesmo tempo, o agente TD3 aprende, por meio de simulação repetida, como adicionar um torque “residual” menor que ajusta finamente o movimento, compensando efeitos difíceis de modelar como atrito não linear ou alterações persistentes na massa transportada. Os dois sinais de torque são simplesmente somados em cada junta, de modo que o robô é sempre conduzido por uma parceria entre regras explícitas e adaptação aprendida.

Um banco de testes digital para trajetórias exigentes

O controlador híbrido é treinado e avaliado em uma réplica virtual detalhada do braço Mitsubishi construída com ferramentas de simulação multibody. Esse ambiente reproduz os elos rígidos do braço, limites das juntas e imperfeições dos sensores, permitindo que o algoritmo de aprendizado explore com segurança enquanto encara física realista. Os pesquisadores desafiam o controlador com trajetórias 3D exigentes — em forma de N, helicoidais e em espiral — que requerem movimento suave e coordenado de todas as juntas. Eles também injetam incerteza alterando massas e inercias dos elos e adicionando pulsos de torque súbitos que imitam impactos ou empurrões externos. Nesse cenário, o componente de lógica fuzzy garante que o braço não se comporte de forma descontrolada, enquanto o agente TD3 melhora gradualmente o desempenho ao maximizar um sinal de recompensa que valoriza precisão, suavidade e eficiência energética.

Como o híbrido supera seus rivais

Em todas as trajetórias testadas, o controlador híbrido fuzzy‑TD3 supera tanto um controlador TD3 puro quanto um híbrido anterior que combinava TD3 com um controlador PID padrão. Medidas de erro que acumulam a divergência ao longo do tempo mostram reduções na ordem de 28–50% em comparação com apenas TD3 e cerca de 15–29% em comparação com o híbrido baseado em PID. Mesmo quando os parâmetros físicos do robô são perturbados e distúrbios externos são aplicados, o novo controlador mantém sua vantagem, reduzindo erros em aproximadamente 23–34% versus TD3 e 11–17% versus PID‑TD3. Análises adicionais revelam que o processo de aprendizado converge de forma suave, o comportamento geral é numericamente estável e as regras fuzzy ativam padrões intuitivos — correções suaves e frequentes durante o movimento normal e intervenções mais fortes e raras quando o braço se afasta muito do alvo.

Equilibrando precisão e consumo de energia

O estudo também mostra que o controlador pode ser ajustado para trocar um pouco de precisão por economia de energia perceptível. Ao ajustar um único peso na função de recompensa, o algoritmo aprende a reduzir o torque médio das juntas em mais de 20% enquanto aumenta apenas ligeiramente o erro de rastreamento. Essa capacidade de ajuste significa que o mesmo esquema de controle pode ser adaptado a tarefas nas quais eficiência importa mais do que precisão microscópica, ou vice‑versa, sem redesenhar todo o sistema.

O que isso significa para robôs futuros

Em termos práticos, este trabalho demonstra uma receita promissora para braços robóticos mais confiáveis e compreensíveis: deixe um conjunto claro de regras legíveis por humanos lidar com correções rápidas e segurança, enquanto um algoritmo de aprendizado refina silenciosamente o desempenho ao longo do tempo. O resultado é um controlador que segue trajetórias intrincadas com mais precisão, tolera perturbações, usa energia de maneira mais eficiente e permanece explicável para os engenheiros. Projetos híbridos como esse podem ajudar a levar controle avançado guiado por IA para fora do laboratório e para fábricas, armazéns e robôs de serviço reais, onde confiabilidade e transparência são tão importantes quanto a inteligência bruta.

Citação: Hazem, Z.B. A fuzzy-TD3 hybrid reinforcement learning framework for robust trajectory tracking of the Mitsubishi RV-2AJ robotic arm. Sci Rep 16, 12269 (2026). https://doi.org/10.1038/s41598-026-42615-8

Palavras-chave: controle de braço robótico, aprendizado por reforço, lógica fuzzy, rastreamento de trajetória, automação robusta