Clear Sky Science · es

Un marco híbrido difuso-TD3 de aprendizaje por refuerzo para un seguimiento de trayectoria robusto del brazo robótico Mitsubishi RV-2AJ

Brazos robóticos más inteligentes para trabajos reales desordenados

Los brazos robóticos industriales son fantásticos para repetir el mismo movimiento una y otra vez, pero pueden fallar cuando la tarea o el entorno cambian aunque sea ligeramente. Este artículo presenta una nueva forma de dotar a un brazo robótico de estilo industrial común de la estabilidad de un controlador tradicional y de la adaptabilidad de la inteligencia artificial al mismo tiempo. El objetivo es simple pero exigente: hacer que el brazo siga con precisión trayectorias 3D complejas, incluso cuando su carga varía o es empujado y perturbado, sin necesitar un modelo matemático perfecto de la máquina.

Por qué el movimiento preciso es difícil para los robots

Los brazos robóticos modernos, como el de 5 articulaciones Mitsubishi RV‑2AJ estudiado aquí, son sistemas mecánicos complejos. Sus articulaciones se influyen entre sí, su movimiento es altamente no lineal y en fábricas reales deben lidiar con fricción, vibraciones, ruido de sensores y cargas desconocidas. Los métodos clásicos de control, como los controladores PID, son fáciles de ajustar y están muy extendidos, pero se esfuerzan cuando el robot se mueve rápido, transporta objetos distintos o sufre fuerzas inesperadas. Por otro lado, el aprendizaje profundo por refuerzo puede en principio aprender políticas de control excelentes mediante prueba y error, pero en la práctica puede aprender despacio, comportarse de forma errática al principio y suele ser una “caja negra” que los ingenieros encuentran difícil de interpretar o confiar.

Combinando reglas humanas con aprendizaje automático

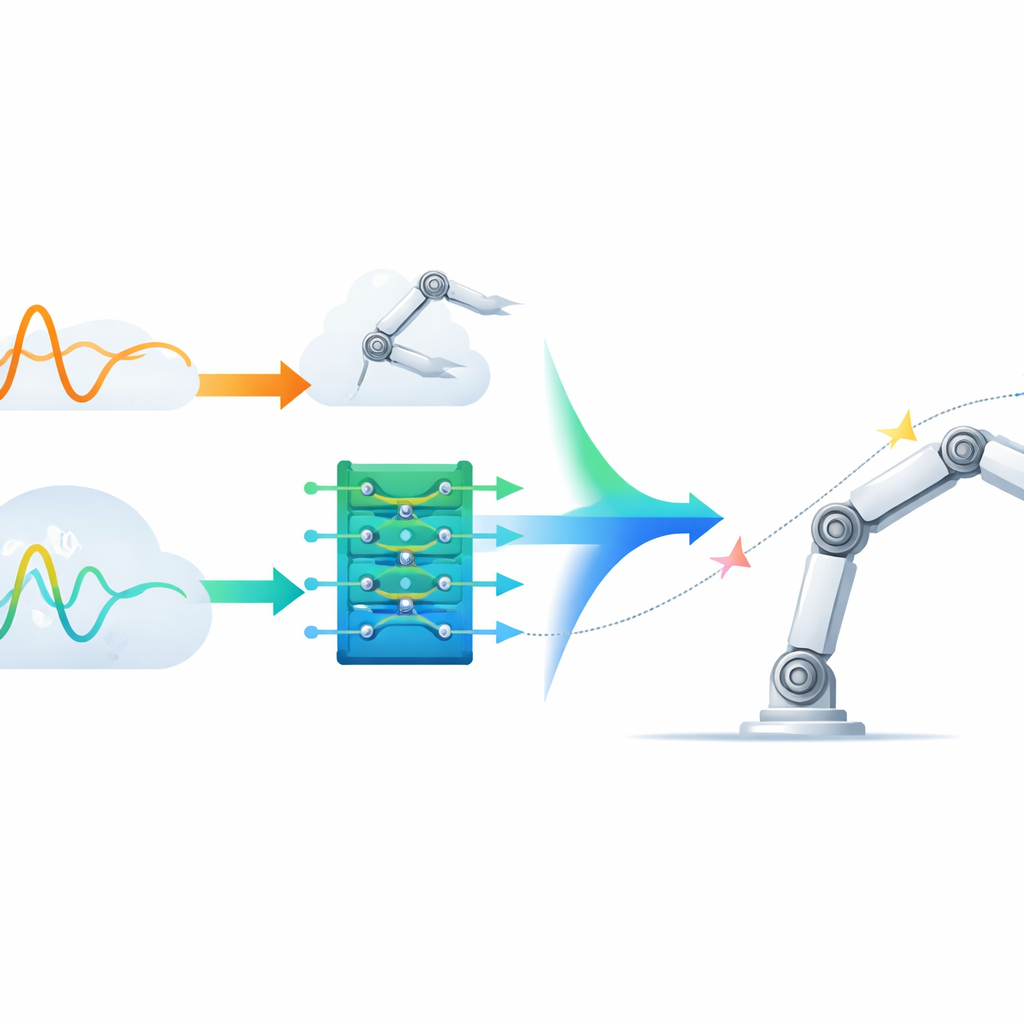

Para salvar esta brecha, el autor propone un controlador híbrido que empareja un sistema de lógica difusa —que codifica reglas de experto de forma interpretable— con un potente método de aprendizaje por refuerzo llamado TD3. En este diseño, la parte difusa observa cuánto se desvía cada articulación de su objetivo y con qué rapidez cambia ese error. Luego aplica pares correctivos inmediatos según un conjunto compacto de reglas “si‑entonces”, muy parecido a lo que haría un operador experimentado. Esto proporciona un comportamiento base estable y comprensible. Al mismo tiempo, el agente TD3 aprende, mediante simulación repetida, cómo añadir un pequeño par “residual” que afina el movimiento, compensando efectos difíciles de modelar como fricción no lineal o cambios persistentes en la carga transportada. Las dos señales de par se suman en cada articulación, de modo que el robot siempre es guiado por una asociación entre reglas explícitas y adaptación aprendida.

Un banco de pruebas digital para trayectorias exigentes

El controlador híbrido se entrena y evalúa en una réplica virtual detallada del brazo Mitsubishi construida con herramientas de simulación multibody. Este entorno reproduce los eslabones rígidos del brazo, los límites de las articulaciones y las imperfecciones de los sensores, lo que permite al algoritmo de aprendizaje explorar con seguridad y a la vez enfrentarse a una física realista. Los investigadores ponen a prueba el controlador con trayectorias 3D exigentes —trayectorias en forma de N, helicoidales y en espiral— que requieren un movimiento suave y coordinado de todas las articulaciones. También inyectan incertidumbre alterando las masas e inercias de los eslabones y añadiendo pulsos de par repentinos que simulan impactos o empujes externos. Dentro de este montaje, el componente de lógica difusa asegura que el brazo no se comporte de forma descontrolada, mientras que el agente TD3 mejora gradualmente el desempeño maximizando una señal de recompensa que valora la precisión, la suavidad y la eficiencia energética.

Cómo el híbrido supera a sus rivales

En todas las trayectorias probadas, el controlador híbrido difuso‑TD3 supera tanto a un controlador TD3 puro como a un híbrido previo que combinaba TD3 con un controlador PID estándar. Las medidas de error que acumulan la desviación a lo largo del tiempo muestran reducciones del orden del 28–50% frente a TD3 solo y aproximadamente 15–29% frente al híbrido basado en PID. Incluso cuando se perturban los parámetros físicos del robot y se aplican perturbaciones externas, el nuevo controlador mantiene su ventaja, reduciendo los errores en torno al 23–34% frente a TD3 y 11–17% frente a PID‑TD3. Análisis adicionales revelan que el proceso de aprendizaje converge de forma suave, el comportamiento global es numéricamente estable y las reglas difusas se activan en patrones intuitivos: correcciones suaves y frecuentes durante el movimiento normal y actuaciones más fuertes y esporádicas cuando el brazo se desvía mucho de su objetivo.

Equilibrando precisión y consumo de energía

El estudio también muestra que el controlador puede sintonizarse para intercambiar algo de precisión por ahorros energéticos notables. Ajustando un único peso en la función de recompensa, el algoritmo aprende a reducir el par medio en las articulaciones en más del 20% mientras que solo aumenta ligeramente el error de seguimiento. Esta capacidad de ajuste significa que el mismo esquema de control puede adaptarse a tareas donde la eficiencia importa más que la precisión microscópica, o viceversa, sin rediseñar todo el sistema.

Qué supone esto para los robots del futuro

En términos cotidianos, este trabajo demuestra una receta prometedora para brazos robóticos más fiables y comprensibles: dejar que un conjunto claro de reglas legibles por humanos gestione correcciones rápidas y seguridad, mientras que un algoritmo de aprendizaje refina silenciosamente el rendimiento con el tiempo. El resultado es un controlador que sigue trayectorias intrincadas con mayor precisión, resiste perturbaciones, usa la energía de forma más inteligente y sigue siendo explicable para los ingenieros. Tales diseños híbridos podrían ayudar a llevar el control avanzado impulsado por IA fuera del laboratorio y hacia fábricas reales, almacenes y robots de servicio, donde la fiabilidad y la transparencia son tan importantes como la inteligencia bruta.

Cita: Hazem, Z.B. A fuzzy-TD3 hybrid reinforcement learning framework for robust trajectory tracking of the Mitsubishi RV-2AJ robotic arm. Sci Rep 16, 12269 (2026). https://doi.org/10.1038/s41598-026-42615-8

Palabras clave: control de brazo robótico, aprendizaje por refuerzo, lógica difusa, seguimiento de trayectoria, automatización robusta