Clear Sky Science · de

Ein Fuzzy‑TD3‑Hybrid‑Reinforcement‑Learning‑Rahmen für robustes Trajektorientracking des Mitsubishi RV‑2AJ Roboterarms

Intelligentere Roboterarme für unordentliche Aufgaben in der realen Welt

Industrielle Roboterarme sind hervorragend darin, dieselbe Bewegung immer wieder präzise auszuführen, können aber ins Straucheln geraten, wenn sich Aufgabe oder Umgebung auch nur leicht ändern. Dieses Paper stellt eine neue Methode vor, um einem gebräuchlichen Fabrikroboterarm die Stabilität eines traditionellen Reglers und gleichzeitig die Anpassungsfähigkeit künstlicher Intelligenz zu verleihen. Das Ziel ist einfach, aber anspruchsvoll: den Arm komplexen 3D‑Bahnen präzise folgen zu lassen, selbst wenn sich seine Last ändert oder er gestoßen und gestört wird, ohne ein perfektes mathematisches Modell der Maschine zu benötigen.

Warum präzise Bewegungen für Roboter schwierig sind

Moderne Roboterarme, wie der hier untersuchte 5‑gelenkige Mitsubishi RV‑2AJ, sind komplexe mechanische Systeme. Ihre Gelenke beeinflussen einander, ihre Bewegung ist hochgradig nichtlinear, und in realen Fabriken müssen sie mit Reibung, Vibrationen, Sensorsausfällen und unbekannten Nutzlasten zurechtkommen. Klassische Regelungsverfahren, etwa PID‑Regler, sind leicht einstellbar und weit verbreitet, haben aber Probleme, wenn der Roboter schnell bewegt wird, unterschiedliche Objekte trägt oder unerwarteten Kräften ausgesetzt ist. Andererseits kann Deep Reinforcement Learning prinzipiell exzellente Steuerstrategien durch Trial‑and‑Error erlernen, in der Praxis lernt es jedoch oft langsam, verhält sich anfangs unberechenbar und bleibt häufig eine „Black Box“, der Ingenieure nur schwer vertrauen oder die sie interpretieren können.

Menschliche Regeln mit maschinellem Lernen verbinden

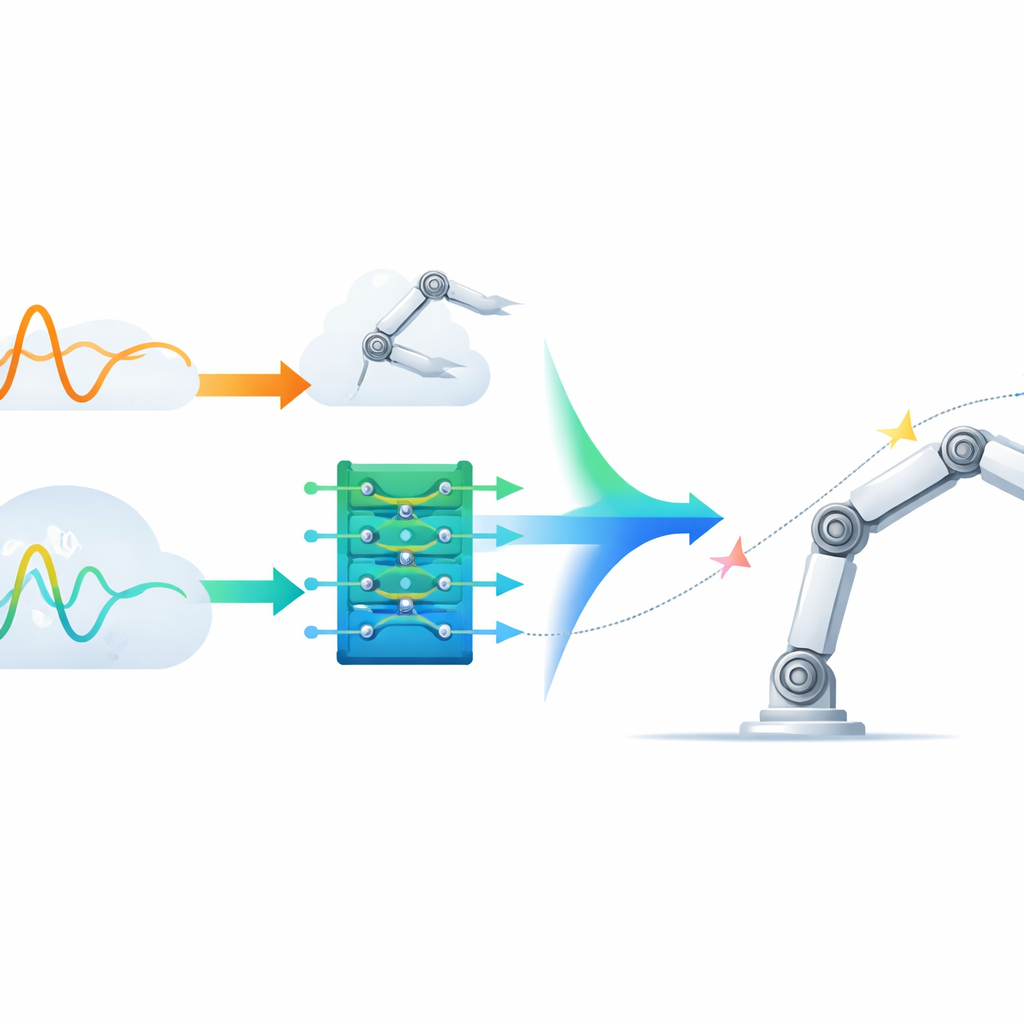

Um diese Lücke zu schließen, schlägt der Autor einen Hybridregler vor, der ein Fuzzy‑Logik‑System — das Expertenwissen in interpretierbarer Form kodiert — mit einer leistungsfähigen Reinforcement‑Learning‑Methode namens TD3 kombiniert. In diesem Entwurf beobachtet der Fuzzy‑Anteil, wie weit jedes Gelenk vom Sollwert abweicht und wie schnell sich dieser Fehler ändert. Er wendet dann unmittelbare korrigierende Drehmomente gemäß einer kompakten Menge von „Wenn‑Dann“-Regeln an, ähnlich wie ein erfahrener Bediener. Das liefert ein stabiles, verständliches Ausgangsverhalten. Parallel dazu lernt der TD3‑Agent durch wiederholte Simulationen, wie er ein kleineres „Residual“‑Drehmoment hinzufügt, das die Bewegung feinabstimmt und schwer zu modellierende Effekte wie nichtlineare Reibung oder dauerhafte Laständerungen kompensiert. Die beiden Drehmomentsignale werden an jedem Gelenk einfach addiert, sodass der Roboter stets durch eine Partnerschaft aus expliziten Regeln und gelerntem Anpassungsverhalten angetrieben wird.

Eine digitale Prüfbank für anspruchsvolle Bahnen

Der Hybridregler wird in einer detaillierten virtuellen Nachbildung des Mitsubishi‑Arms trainiert und getestet, die mit Multibody‑Simulationswerkzeugen erstellt wurde. Diese Umgebung bildet die starren Verbindungen, Gelenkbegrenzungen und Sensorunzulänglichkeiten des Arms nach und erlaubt dem Lernalgorithmus, sicher zu erkunden, während er realistische Physik erfährt. Die Forschenden stellen den Regler vor fordernde 3D‑Trajektorien — N‑förmige, helikale und spiralförmige Bahnen — die eine glatte, koordinierte Bewegung aller Gelenke verlangen. Außerdem wird Unsicherheit eingeführt, indem Massen und Trägheiten der Glieder verändert und plötzliche Drehmomentstöße hinzugefügt werden, die Stöße oder äußere Schubkräfte nachahmen. In diesem Aufbau sorgt die Fuzzy‑Logik‑Komponente dafür, dass der Arm sich nicht unkontrolliert verhält, während der TD3‑Agent schrittweise die Leistung verbessert, indem er ein Belohnungssignal maximiert, das Genauigkeit, Gleichmäßigkeit und Energieeffizienz wertschätzt.

Wie der Hybrid seine Rivalen übertrifft

Über alle getesteten Bahnen hinweg übertrifft der fuzzy‑TD3‑Hybridregler sowohl einen reinen TD3‑Regler als auch einen früheren Hybrid, der TD3 mit einem klassischen PID‑Regler kombinierte. Fehlermaße, die Abweichungen über die Zeit aufsummieren, zeigen Reduktionen von etwa 28–50 % im Vergleich zu reinem TD3 und ungefähr 15–29 % im Vergleich zum PID‑basierten Hybrid. Selbst wenn die physikalischen Parameter des Roboters gestört werden und externe Störungen auftreten, behält der neue Regler seinen Vorsprung und reduziert die Fehler um etwa 23–34 % gegenüber TD3 und 11–17 % gegenüber PID‑TD3. Weitere Analysen zeigen, dass der Lernprozess glatt konvergiert, das Gesamtsystem numerisch stabil ist und die Fuzzy‑Regeln in intuitiven Mustern aktiviert werden — sanfte, häufige Korrekturen bei normaler Bewegung und stärkere, seltenere Eingriffe, wenn der Arm weit vom Sollwert abweicht.

Balance zwischen Präzision und Energieverbrauch

Die Studie zeigt außerdem, dass der Regler so abgestimmt werden kann, dass ein wenig Präzision gegen spürbare Energieeinsparungen getauscht wird. Durch Anpassung eines einzelnen Gewichts in der Belohnungsfunktion lernt der Algorithmus, das durchschnittliche Gelenkdrehmoment um mehr als 20 % zu reduzieren, während der Trackingfehler nur geringfügig ansteigt. Diese Einstellbarkeit bedeutet, dass dasselbe Steuerungsschema an Aufgaben angepasst werden kann, bei denen Effizienz wichtiger ist als mikroskopische Genauigkeit oder umgekehrt, ohne das gesamte System neu entwerfen zu müssen.

Was das für zukünftige Roboter bedeutet

Anschaulich zeigt diese Arbeit ein vielversprechendes Rezept für zuverlässigere und besser erklärbare Roboterarme: Lassen Sie eine klare Menge menschenlesbarer Regeln schnelle Korrekturen und Sicherheit übernehmen, während ein Lernalgorithmus im Hintergrund die Leistung über die Zeit verfeinert. Das Ergebnis ist ein Regler, der komplizierte Bahnen genauer verfolgt, Störungen besser toleriert, Energie effizienter nutzt und für Ingenieure erklärbar bleibt. Solche Hybriddesigns könnten dazu beitragen, fortschrittliche, KI‑gesteuerte Regelungen aus dem Labor in echte Fabriken, Lager und Serviceroboter zu bringen, wo Zuverlässigkeit und Transparenz ebenso wichtig sind wie rohe Intelligenz.

Zitation: Hazem, Z.B. A fuzzy-TD3 hybrid reinforcement learning framework for robust trajectory tracking of the Mitsubishi RV-2AJ robotic arm. Sci Rep 16, 12269 (2026). https://doi.org/10.1038/s41598-026-42615-8

Schlüsselwörter: Roboterarmsteuerung, Reinforcement Learning, Fuzzy‑Logik, Trajektorienverfolgung, robuste Automatisierung