Clear Sky Science · pt

MM FD ConvFormer rede multimodal deformável sensível à frequência para classificação robusta de tumores cerebrais

Por que interpretar exames cerebrais com mais inteligência importa

Os tumores cerebrais estão entre os diagnósticos médicos mais temidos, e os médicos frequentemente confiam em imagens de ressonância magnética (RM) para detectá‑los e caracterizá‑los. Mas a leitura dessas imagens é difícil e demorada, e mesmo especialistas experientes podem discordar. Este estudo apresenta um novo sistema de inteligência artificial (IA), chamado MM‑FD‑ConvFormer, projetado para ajudar a classificar tumores cerebrais em imagens de RM com mais precisão, maior confiabilidade e de modo que os médicos consigam interpretar melhor suas decisões.

Vendo tumores por mais de um ângulo

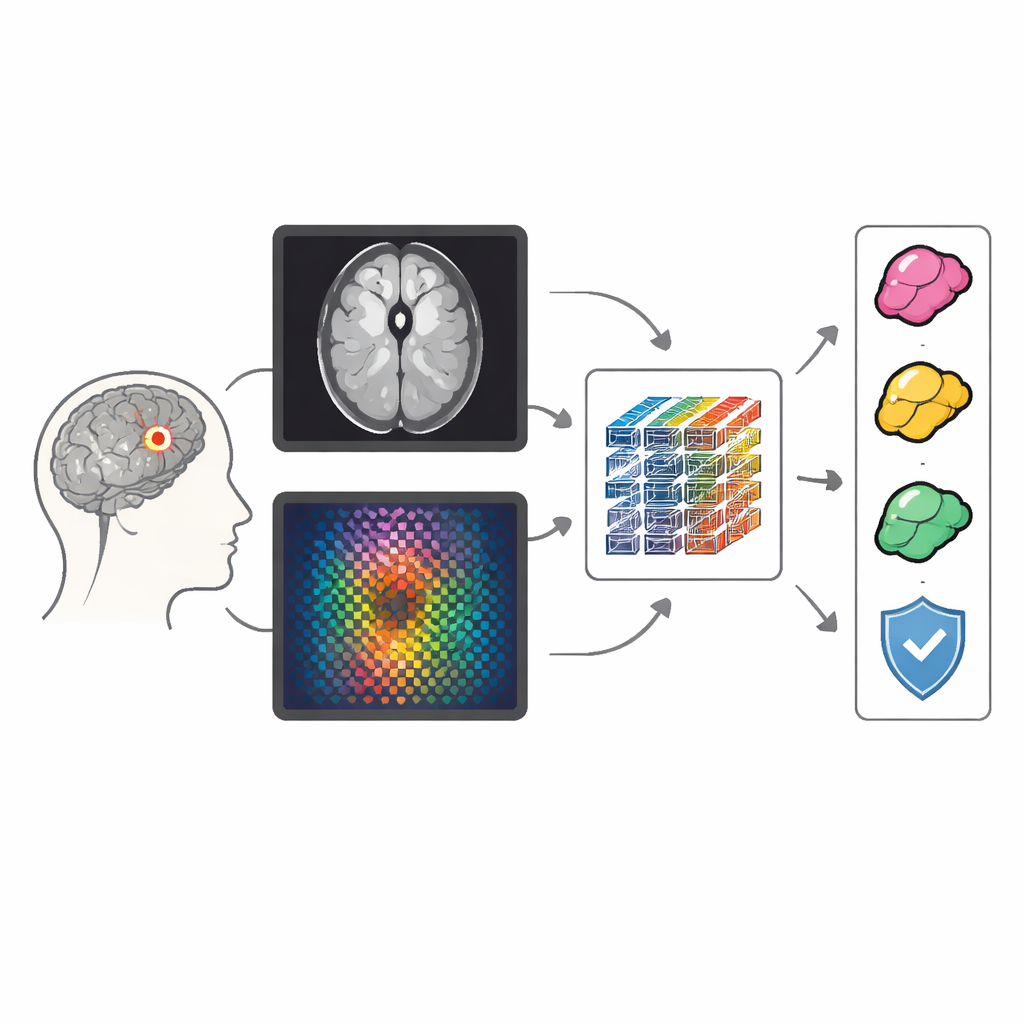

A maioria dos sistemas computacionais existentes analisa as RM de forma direta: examinam a imagem visual na tela, focando em formas, brilho e contornos. O MM‑FD‑ConvFormer vai além, tratando a mesma varredura como duas visões diferentes e complementares. Uma visão é a imagem espacial familiar do cérebro; a outra é uma visão de frequência criada por transformadas matemáticas que realçam texturas sutis e mudanças rápidas na intensidade. Ao combinar ambas as visões, o modelo captura melhor diferenças finas entre tumor e tecido saudável, especialmente em casos em que as bordas do tumor estão desfocadas ou a aparência varia entre aparelhos ou hospitais.

Um caminho em camadas do exame à decisão

O sistema processa cada fatia de RM por meio de duas vias paralelas. Na primeira, uma rede convolucional moderna (uma versão refinada de um motor clássico de análise de imagens) aprende padrões de anatomia e formato tumoral. Na segunda, uma rede mais leve analisa a versão baseada em frequência da mesma fatia, que enfatiza pistas de textura e contorno. Essas duas correntes são então reunidas e refinadas por um módulo transformer, um tipo de arquitetura de IA originalmente desenvolvida para linguagem e agora amplamente usada em visão por conseguir conectar regiões afastadas de uma imagem e entender um contexto mais amplo, como a posição do tumor dentro do cérebro.

Adaptando‑se a formas tumorais irregulares

Muitos tumores, particularmente os gliomas agressivos, não têm contornos limpos e arredondados. Mecanismos de atenção tradicionais olham para posições fixas em uma grade, o que pode perder ou borrar essas estruturas irregulares. O MM‑FD‑ConvFormer introduz um bloco de atenção cross‑modal deformável que permite ao modelo "curvar" seu foco para seguir a forma real do tumor. Importante: esse bloco baseia seus ajustes em uma mistura de informações espaciais e de frequência, de modo que estrutura e textura guiam conjuntamente onde o modelo olha. Esse desenho melhora a sensibilidade ao longo de bordas complexas e ajuda a alinhar o que os dois ramos aprenderam, tornando a representação final fundida mais informativa para a classificação.

Provando confiabilidade em diversos hospitais

Para testar se o sistema se manteria em condições realistas, os autores o treinaram em coleções públicas de RM amplamente usadas no Kaggle e Figshare e depois o avaliaram em conjuntos de dados clínicos separados, incluindo BraTS 2020/2021 e a coleção REMBRANDT. O MM‑FD‑ConvFormer superou concorrentes fortes baseados em convolução, transformer e híbridos em medidas padrão como acurácia, F1 e área sob a curva ROC. Ele alcançou cerca de 99,8% de acurácia para distinguir exames com tumor de normais e manteve alto desempenho quando avaliado em conjuntos não vistos coletados com diferentes aparelhos e protocolos. O modelo também estima sua própria incerteza usando passagens repetidas ligeiramente aleatorizadas, o que pode sinalizar casos limítrofes nos quais o julgamento de um especialista humano é especialmente importante.

Tornando as decisões da IA visíveis aos clínicos

Além dos números brutos, os autores se concentraram em saber se os radiologistas poderiam entender e confiar nas decisões do modelo. Eles usaram técnicas de mapas de calor como Grad‑CAM e SHAP para mostrar quais partes da imagem e qual fluxo de características (espacial ou de frequência) impulsionou cada previsão. Essas explicações visuais se alinharam bem com regiões e limites tumorais conhecidos, alcançando forte sobreposição com máscaras desenhadas por especialistas, mesmo que o sistema tenha sido treinado apenas para classificação, não segmentação. O ramo de frequência contribuiu mais em dados desafiadores, com artefatos ou oriundos de diferentes locais, confirmando que a abordagem de dupla visão não é apenas um truque matemático, mas realmente útil na prática.

O que isso significa para pacientes e médicos

Em termos simples, o MM‑FD‑ConvFormer é um assistente de IA que observa as RM cerebrais de duas maneiras complementares, segue com flexibilidade a forma real do tumor e pode explicar onde está "olhando" ao tomar uma decisão. Em vários conjuntos de dados, foi mais preciso e mais robusto a variações entre aparelhos e hospitais do que métodos anteriores, ao mesmo tempo em que oferece justificativa visual mais clara para suas decisões e um senso embutido de quando pode estar errado. Se validado adicionalmente em ambientes clínicos e estendido para exames 3D completos, esse tipo de tecnologia poderia apoiar uma detecção mais precoce e consistente de tumores e ajudar radiologistas e neurologistas a ajustar tratamentos com maior confiança.

Citação: Arockia Selvarathinam, A.X., Lilhore, U.K., Alroobaea, R. et al. MM FD ConvFormer multimodal frequency aware deformable CNN transformer network for robust brain tumor classification. Sci Rep 16, 12669 (2026). https://doi.org/10.1038/s41598-026-43616-3

Palavras-chave: tumor cerebral RM, IA em imagens médicas, modelos de deep learning, classificação de tumores, interpretabilidade de modelos