Clear Sky Science · fr

MM FD ConvFormer réseau transformeur CNN déformable multimodal conscient des fréquences pour une classification robuste des tumeurs cérébrales

Pourquoi une lecture plus intelligente des scanners cérébraux compte

Les tumeurs cérébrales font partie des diagnostics médicaux les plus redoutés, et les médecins s'appuient souvent sur les images IRM pour les détecter et les caractériser. Mais l'interprétation de ces images est difficile et chronophage, et même des spécialistes expérimentés peuvent diverger. Cette étude présente un nouveau système d'intelligence artificielle (IA), appelé MM‑FD‑ConvFormer, conçu pour aider à classer les tumeurs cérébrales à partir d'IRM de façon plus précise, plus fiable et de manière plus interprétable pour les cliniciens.

Voir les tumeurs sous plusieurs angles

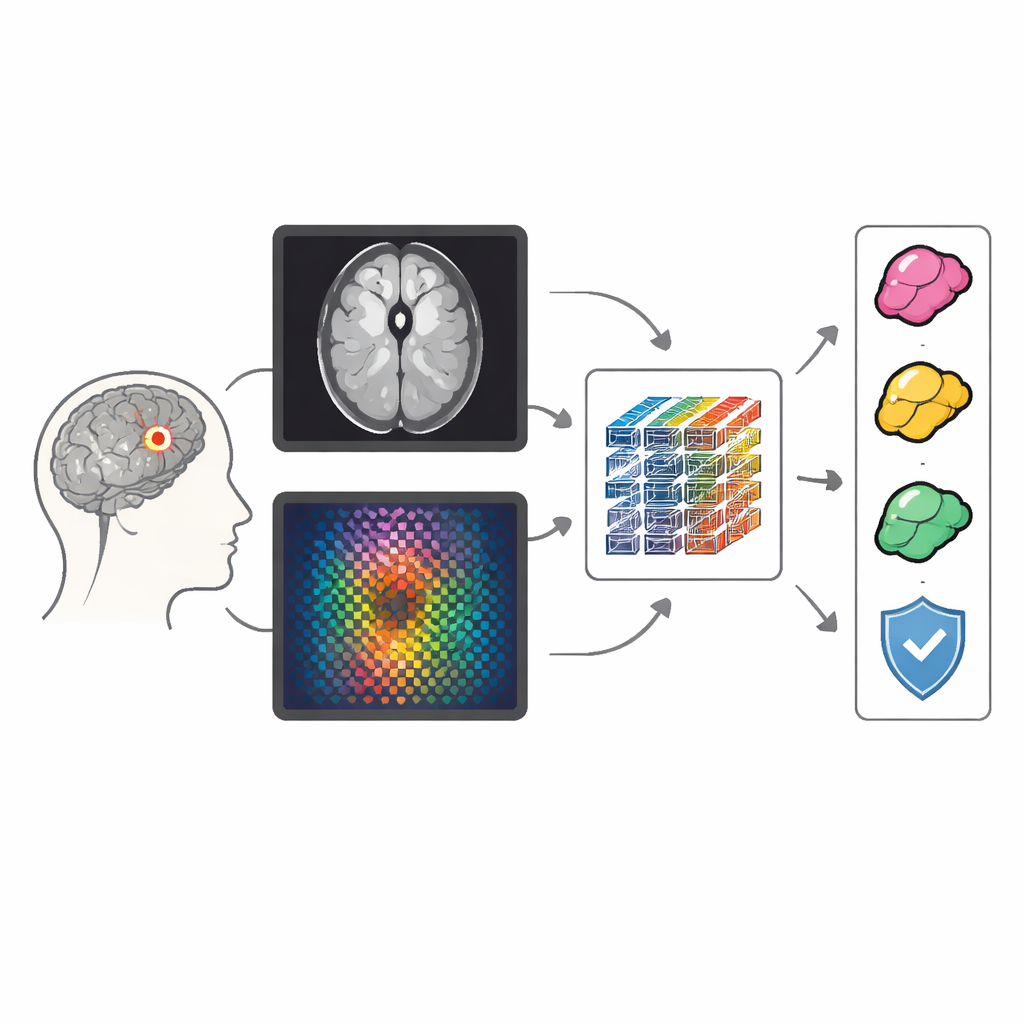

La plupart des systèmes informatiques existants analysent les IRM de façon directe : ils étudient l'image telle qu'elle apparaît à l'écran, en se concentrant sur les formes, la luminosité et les contours. MM‑FD‑ConvFormer va plus loin en considérant la même coupe comme deux vues différentes mais complémentaires. Une vue est l'image spatiale familière du cerveau ; l'autre est une vue en fréquence obtenue par des transformées mathématiques qui mettent en évidence des textures subtiles et des variations d'intensité rapides. En combinant ces deux vues, le modèle peut mieux capturer des différences fines entre tumeur et tissu sain, surtout lorsque les bords de la tumeur sont flous ou que l'apparence varie d'un appareil ou d'un hôpital à l'autre.

Un parcours en couches de la coupe à la décision

Le système traite chaque coupe IRM via deux voies parallèles. Dans la première, un réseau convolutionnel moderne (une version affinée d'un moteur classique d'analyse d'image) apprend les motifs anatomiques et la forme des tumeurs. Dans la seconde, un réseau plus léger analyse la version en fréquence de la même coupe, qui met l'accent sur les indices de texture et de frontière. Ces deux flux sont ensuite réunis et affinés par un module transformeur, un type d'architecture IA initialement développé pour le langage mais largement utilisé en vision parce qu'il peut relier des régions éloignées d'une image et comprendre un contexte plus large, par exemple l'emplacement d'une tumeur dans le cerveau.

S'adapter aux formes tumorales irrégulières

Beaucoup de tumeurs, en particulier les gliomes agressifs, n'ont pas de contours réguliers et ronds. Les mécanismes d'attention traditionnels en IA regardent des positions fixes sur une grille, ce qui peut manquer ou estomper ces structures irrégulières. MM‑FD‑ConvFormer introduit un bloc d'attention croisée déformable qui permet au modèle de « courber » sa focalisation pour suivre la forme réelle de la tumeur. Important, ce bloc base ses ajustements sur un mélange d'informations spatiales et fréquentielles, de sorte que la structure et la texture guident conjointement le pointage du modèle. Ce dispositif améliore la sensibilité le long de frontières complexes et aide à aligner ce que les deux branches ont appris, rendant la représentation finale fusionnée plus informative pour la classification.

Démontrer la fiabilité à travers des hôpitaux divers

Pour vérifier si ce système tient dans des conditions réalistes, les auteurs l'ont entraîné sur des collections IRM publiques largement utilisées issues de Kaggle et Figshare puis l'ont évalué sur des jeux de données cliniques séparés, notamment BraTS 2020/2021 et la collection REMBRANDT. MM‑FD‑ConvFormer a surpassé des concurrents convolutionnels, transformeurs et hybrides robustes selon des mesures standard comme la précision, le score F1 et l'aire sous la courbe ROC. Il a atteint environ 99,8 % de précision pour distinguer coupes tumorales et normales et a maintenu de bonnes performances lorsqu'il a été évalué sur des jeux de données non vus, collectés avec différents scanners et protocoles. Le modèle estime également sa propre incertitude en effectuant des passages répétés légèrement aléatoires, ce qui peut signaler des cas limites où le jugement d'un expert humain est particulièrement important.

Rendre les décisions de l'IA visibles aux cliniciens

Au‑delà des chiffres purs, les auteurs se sont intéressés à savoir si les radiologues pouvaient comprendre et faire confiance aux décisions du modèle. Ils ont utilisé des techniques de cartographie de chaleur telles que Grad‑CAM et SHAP pour montrer quelles parties de l'image et quel flux de caractéristiques (spatial ou fréquentiel) ont motivé chaque prédiction. Ces explications visuelles se sont bien alignées sur les régions et les frontières tumorales connues, obtenant une forte recoupement avec les masques dessinés par des experts, même si le système n'a été entraîné que pour la classification et non pour la segmentation. La branche fréquentielle a contribué davantage dans les données difficiles, chargées d'artefacts ou provenant de sites différents, confirmant que l'approche à double vue n'est pas qu'un artifice mathématique mais réellement utile en pratique.

Ce que cela signifie pour les patients et les médecins

En termes simples, MM‑FD‑ConvFormer est un assistant IA qui analyse les IRM cérébrales de deux manières complémentaires, suit de façon flexible la véritable forme tumorale et peut expliquer où il « regarde » lorsqu'il prend une décision. Sur plusieurs jeux de données, il s'est montré plus précis et plus robuste aux changements de scanners et d'hôpitaux que les méthodes précédentes, tout en fournissant de meilleures justifications visuelles pour ses décisions et un indicateur intégré quand il pourrait se tromper. Si ce type de technologie est validé plus avant en milieu clinique et étendu aux examens 3D complets, il pourrait faciliter une détection des tumeurs plus précoce et plus cohérente et aider radiologues et neurologues à adapter les traitements avec davantage de confiance.

Citation: Arockia Selvarathinam, A.X., Lilhore, U.K., Alroobaea, R. et al. MM FD ConvFormer multimodal frequency aware deformable CNN transformer network for robust brain tumor classification. Sci Rep 16, 12669 (2026). https://doi.org/10.1038/s41598-026-43616-3

Mots-clés: IRM de tumeur cérébrale, IA pour l'imagerie médicale, modèles d'apprentissage profond, classification des tumeurs, interprétabilité des modèles