Clear Sky Science · it

MM FD ConvFormer rete transformer CNN deformabile multimodale sensibile alle frequenze per classificazione robusta dei tumori cerebrali

Perché è importante leggere meglio le immagini cerebrali

I tumori cerebrali sono tra le diagnosi mediche più temute e i medici spesso si affidano alle risonanze magnetiche per individuarli e caratterizzarli. Tuttavia, interpretare queste immagini è difficile e richiede tempo, e persino specialisti esperti possono non essere sempre d’accordo. Questo studio presenta un nuovo sistema di intelligenza artificiale (IA), chiamato MM‑FD‑ConvFormer, progettato per aiutare a classificare i tumori cerebrali dalle risonanze in modo più accurato, più affidabile e con risultati più interpretabili per i medici.

Vedere i tumori da più angolazioni

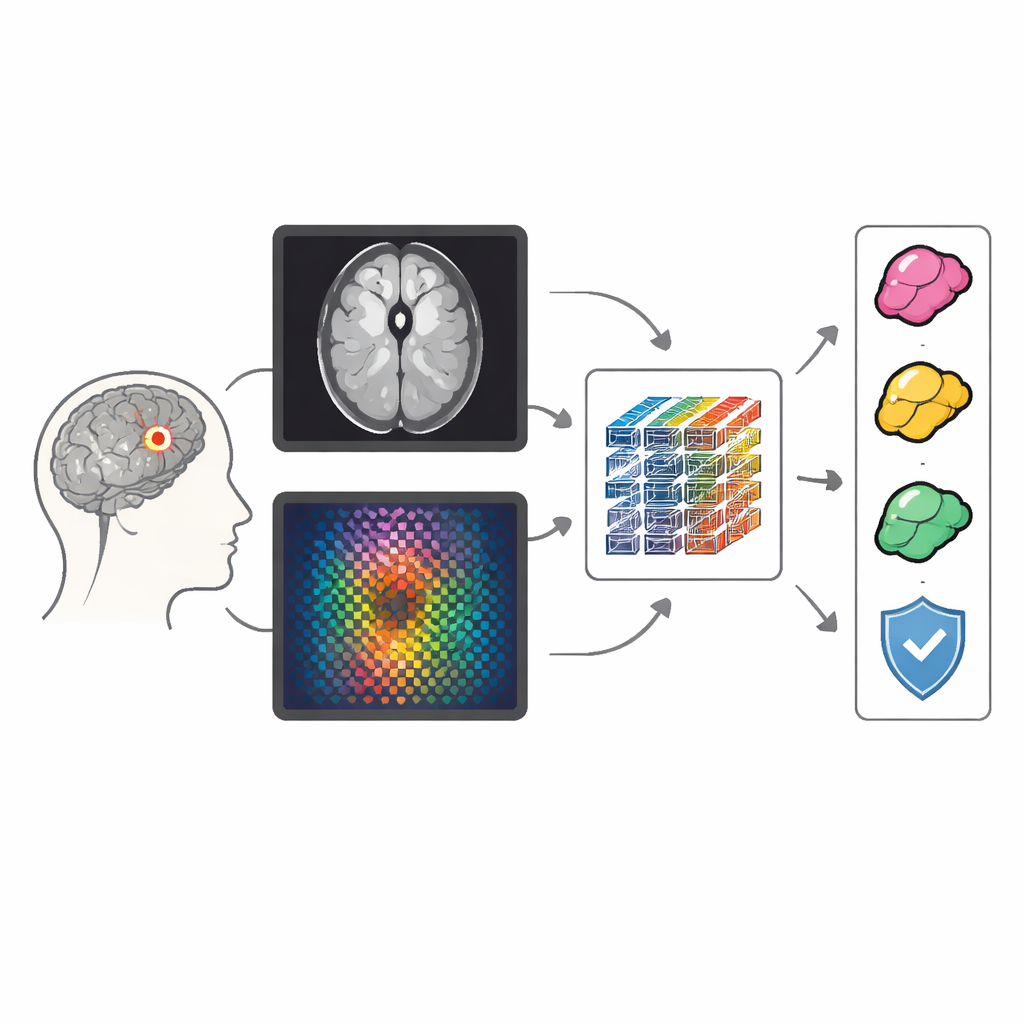

La maggior parte dei sistemi informatici attuali analizza le risonanze in modo diretto: osserva l’immagine visualizzata a schermo concentrandosi su forme, luminosità e contorni. MM‑FD‑ConvFormer va oltre, trattando la stessa scansione come due viste diverse ma complementari. Una vista è l’immagine spaziale familiare del cervello; l’altra è una vista in frequenza ottenuta tramite trasformate matematiche che evidenziano texture sottili e rapidi cambiamenti di intensità. Combinando entrambe le viste, il modello può catturare meglio le differenze fini tra tumore e tessuto sano, soprattutto nei casi in cui i bordi del tumore sono sfumati o l’aspetto varia tra diversi scanner o ospedali.

Un percorso stratificato dalla scansione alla decisione

Il sistema elabora ogni fetta di risonanza attraverso due percorsi paralleli. Nel primo, una rete convoluzionale moderna (una versione raffinata di un motore classico di analisi delle immagini) apprende pattern anatomici e la forma del tumore. Nel secondo, una rete più leggera analizza la versione basata su frequenza della stessa fetta, che mette in risalto indizi di texture e di bordo. Questi due flussi vengono poi uniti e raffinati da un modulo transformer, un’architettura di IA sviluppata inizialmente per il linguaggio ma ora ampiamente usata in visione perché può connettere regioni distanti di un’immagine e comprendere un contesto più ampio, per esempio la posizione del tumore all’interno del cervello.

Adattarsi alle forme irregolari dei tumori

Molti tumori, in particolare i gliomi aggressivi, non hanno contorni regolari e arrotondati. I meccanismi di attenzione tradizionali in IA osservano posizioni su una griglia fissa, che possono perdere o sfocare queste strutture irregolari. MM‑FD‑ConvFormer introduce un blocco di attenzione cross‑modal deformabile che permette al modello di “flettere” il proprio focus per seguire la forma reale del tumore. Fondamentale è che questo blocco basi i suoi aggiustamenti su una combinazione di informazioni spaziali e in frequenza, così struttura e texture guidano insieme dove il modello guarda. Questa progettazione migliora la sensibilità lungo bordi complessi e aiuta ad allineare ciò che i due rami hanno appreso, rendendo la rappresentazione fusa finale più informativa per la classificazione.

Dimostrare affidabilità attraverso ospedali diversi

Per verificare se il sistema reggesse in condizioni realistiche, gli autori lo hanno addestrato su collezioni pubbliche di risonanze ampiamente usate da Kaggle e Figshare e lo hanno poi valutato su dataset clinicamente orientati separati, inclusi BraTS 2020/2021 e la raccolta REMBRANDT. MM‑FD‑ConvFormer ha superato forti concorrenti convoluzionali, transformer e ibridi su misure standard come accuratezza, F1 score e area sotto la curva ROC. Ha raggiunto circa il 99,8% di accuratezza nel distinguere scansioni con tumore da quelle normali e ha mantenuto alte prestazioni quando valutato su dataset non visti raccolti con scanner e protocolli diversi. Il modello stima anche la propria incertezza usando passaggi ripetuti lievemente randomizzati, il che può segnalare i casi borderline dove il giudizio di un esperto umano è particolarmente importante.

Rendere le decisioni dell’IA visibili ai clinici

Oltre ai numeri grezzi, gli autori si sono concentrati sul fatto che i radiologi potessero comprendere e fidarsi delle decisioni del modello. Hanno utilizzato tecniche di mappe di calore come Grad‑CAM e SHAP per mostrare quali parti dell’immagine e quale flusso di caratteristiche (spaziale o in frequenza) hanno guidato ogni previsione. Queste spiegazioni visive si sono allineate bene con le regioni e i confini tumorali noti, ottenendo un forte sovrapporsi con le maschere disegnate dagli esperti nonostante il sistema sia stato addestrato solo per la classificazione e non per la segmentazione. Il ramo in frequenza ha contribuito maggiormente nei casi difficili, con artefatti o dati provenienti da diversi siti, confermando che l’approccio a doppia vista non è solo un trucco matematico ma è realmente utile nella pratica.

Cosa significa per pazienti e medici

In termini semplici, MM‑FD‑ConvFormer è un assistente IA che osserva le risonanze cerebrali in due modi complementari, segue con flessibilità la vera forma del tumore e può spiegare dove sta “guardando” quando prende una decisione. Su più dataset si è dimostrato più accurato e più robusto ai cambiamenti di scanner e ospedali rispetto ai metodi precedenti, offrendo al contempo giustificazioni visive migliori per le sue decisioni e un senso integrato di quando potrebbe sbagliare. Se validato ulteriormente in contesti clinici ed esteso a scansioni 3D complete, questo tipo di tecnologia potrebbe supportare una rilevazione dei tumori più precoce e coerente e aiutare radiologi e neurologi a personalizzare i trattamenti con maggiore fiducia.

Citazione: Arockia Selvarathinam, A.X., Lilhore, U.K., Alroobaea, R. et al. MM FD ConvFormer multimodal frequency aware deformable CNN transformer network for robust brain tumor classification. Sci Rep 16, 12669 (2026). https://doi.org/10.1038/s41598-026-43616-3

Parole chiave: risonanza magnetica tumore cerebrale, IA per imaging medico, modelli di deep learning, classificazione dei tumori, interpretabilità dei modelli