Clear Sky Science · de

MM FD ConvFormer multimodales frequenzsensitives deformierbares CNN‑Transformer‑Netzwerk zur robusten Klassifikation von Hirntumoren

Warum intelligenteres Lesen von Hirnscans wichtig ist

Hirntumoren gehören zu den gefürchtetsten medizinischen Diagnosen, und Ärztinnen und Ärzte verlassen sich häufig auf MRT‑Aufnahmen, um sie zu erkennen und zu charakterisieren. Das Lesen dieser Bilder ist jedoch schwierig und zeitaufwendig, und selbst erfahrene Spezialisten können zu unterschiedlichen Einschätzungen kommen. Diese Studie stellt ein neues System der künstlichen Intelligenz (KI) vor, genannt MM‑FD‑ConvFormer, das helfen soll, Hirntumoren in MRT‑Aufnahmen genauer, verlässlicher und für Ärztinnen und Ärzte besser interpretierbar zu klassifizieren.

Tumoren aus mehr als einem Blickwinkel sehen

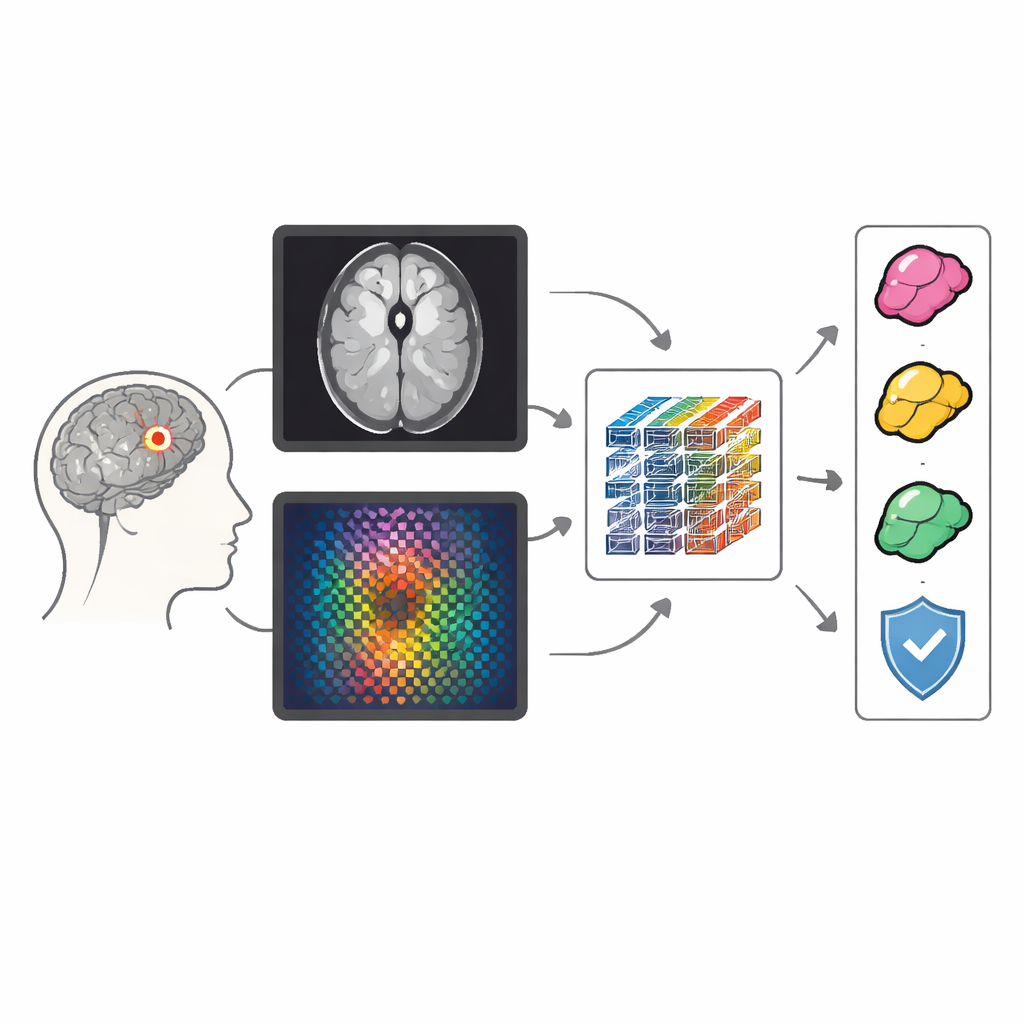

Die meisten bestehenden Computersysteme betrachten MRT‑Scans auf eine einfache Art: Sie analysieren das Bild, das auf dem Bildschirm zu sehen ist, und konzentrieren sich auf Formen, Helligkeit und Kanten. MM‑FD‑ConvFormer geht weiter, indem es dieselbe Aufnahme als zwei unterschiedliche, aber komplementäre Ansichten behandelt. Die eine Ansicht ist das vertraute räumliche Bild des Gehirns; die andere ist eine Frequenzansicht, die durch mathematische Transformationen erzeugt wird und subtile Texturen sowie schnelle Intensitätsänderungen hervorhebt. Durch die Kombination beider Ansichten kann das Modell feine Unterschiede zwischen Tumor und gesundem Gewebe besser erfassen, insbesondere in Fällen mit unscharfen Tumorrändern oder wenn das Erscheinungsbild zwischen Scannern oder Krankenhäusern variiert.

Ein geschichteter Weg vom Scan zur Entscheidung

Das System verarbeitet jede MRT‑Schicht über zwei parallele Pfade. Im ersten lernt ein modernes Faltungsnetzwerk (eine verfeinerte Form eines klassischen Bildanalyse‑Motors) Muster von Anatomie und Tumorform. Im zweiten analysiert ein leichteres Netzwerk die frequenzbasierte Version derselben Schicht, die Textur‑ und Randhinweise betont. Diese beiden Ströme werden anschließend zusammengeführt und durch ein Transformer‑Modul verfeinert, eine KI‑Architektur, die ursprünglich für Sprache entwickelt wurde, heute aber in der Bildverarbeitung weit verbreitet ist, weil sie entfernte Bereiche eines Bildes verbinden und breiteren Kontext verstehen kann, etwa wo sich ein Tumor im Gehirn befindet.

Anpassung an unregelmäßige Tumorformen

Viele Tumoren, insbesondere aggressive Gliome, haben keine sauberen, runden Konturen. Traditionelle Aufmerksamkeitsmechanismen in KI betrachten feste Gitterpositionen, wodurch diese unregelmäßigen Strukturen übersehen oder verwischt werden können. MM‑FD‑ConvFormer führt einen deformierbaren, modalübergreifenden Aufmerksamkeitsblock ein, der es dem Modell erlaubt, seinen Fokus „zu biegen“, um der tatsächlichen Tumorform zu folgen. Entscheidend ist, dass diese Anpassungen auf einer Mischung aus räumlichen und Frequenzinformationen beruhen, sodass Struktur und Textur gemeinsam steuern, wohin das Modell schaut. Dieses Design verbessert die Sensitivität entlang komplexer Ränder und hilft, das zu harmonisieren, was die beiden Zweige gelernt haben, sodass die abschließend verschmolzene Darstellung informativer für die Klassifikation wird.

Verlässlichkeit über unterschiedliche Kliniken hinweg nachweisen

Um zu prüfen, ob das System unter realistischen Bedingungen standhält, trainierten die Autoren es an weit verbreiteten öffentlichen MRT‑Sammlungen von Kaggle und Figshare und evaluierten es anschließend an separaten, klinisch orientierten Datensätzen, darunter BraTS 2020/2021 und die REMBRANDT‑Sammlung. MM‑FD‑ConvFormer übertraf starke konkurrierende Faltungs‑, Transformer‑ und Hybridmodelle bei Standardmaßen wie Genauigkeit, F1‑Wert und Fläche unter der ROC‑Kurve. Es erreichte etwa 99,8 % Genauigkeit bei der Unterscheidung von tumor‑ versus normalen Aufnahmen und hielt eine hohe Leistungsfähigkeit, wenn es auf ungesehene Datensätze angewendet wurde, die mit unterschiedlichen Scannern und Protokollen erhoben wurden. Das Modell schätzt außerdem seine eigene Unsicherheit mittels wiederholter, leicht zufällig variierter Durchläufe, was Grenzfälle markieren kann, bei denen das Urteil eines menschlichen Experten besonders wichtig ist.

Künstliche Entscheidungen für Klinikpersonal sichtbar machen

Über nackte Zahlen hinaus legten die Autoren Wert darauf, ob Radiologinnen und Radiologen die Entscheidungen des Modells verstehen und ihnen vertrauen können. Sie verwendeten Heat‑Map‑Techniken wie Grad‑CAM und SHAP, um zu zeigen, welche Bildteile und welcher Merkmalsstrom (räumlich oder frequenzbasiert) jede Vorhersage beeinflussten. Diese visuellen Erklärungen stimmten gut mit bekannten Tumorregionen und ‑grenzen überein und zeigten starke Überlappung mit von Experten gezeichneten Masken, obwohl das System nur für Klassifikation und nicht für Segmentierung trainiert worden war. Der Frequenzzweig trug insbesondere bei herausfordernden, artefaktbehafteten oder standortübergreifenden Daten stärker bei, was bestätigt, dass der Dual‑View‑Ansatz kein rein mathematischer Trick ist, sondern in der Praxis tatsächlich nützlich ist.

Was das für Patientinnen, Patienten und Ärztinnen bzw. Ärzte bedeutet

Kurz gesagt ist MM‑FD‑ConvFormer ein KI‑Assistent, der Hirn‑MRT‑Aufnahmen auf zwei komplementäre Weisen betrachtet, flexibel der tatsächlichen Tumorform folgt und zeigen kann, wohin er „schaut“, wenn er eine Entscheidung trifft. In mehreren Datensätzen war er genauer und robuster gegenüber Veränderungen in Scannern und Krankenhäusern als frühere Methoden und bot zugleich bessere visuelle Begründungen für seine Entscheidungen sowie ein eingebautes Gefühl dafür, wann er sich irren könnte. Wenn diese Technologie weiter klinisch validiert und auf vollständige 3D‑Scans ausgedehnt wird, könnte sie frühere, konsistentere Tumorerkennung unterstützen und Radiologinnen, Radiologen sowie Neurologinnen und Neurologen helfen, Behandlungen mit größerer Zuversicht zu planen.

Zitation: Arockia Selvarathinam, A.X., Lilhore, U.K., Alroobaea, R. et al. MM FD ConvFormer multimodal frequency aware deformable CNN transformer network for robust brain tumor classification. Sci Rep 16, 12669 (2026). https://doi.org/10.1038/s41598-026-43616-3

Schlüsselwörter: Hirntumor MRT, medizinische Bildgebung KI, Deep‑Learning‑Modelle, Tumorklassifikation, Modellinterpretierbarkeit