Clear Sky Science · es

MM FD ConvFormer red transformadora deformable multimodal sensible a la frecuencia para clasificación robusta de tumores cerebrales

Por qué importa leer mejor las exploraciones cerebrales

Los tumores cerebrales están entre los diagnósticos médicos más temidos, y los médicos a menudo se apoyan en resonancias magnéticas (MRI) para detectarlos y caracterizarlos. Pero interpretar estas imágenes es difícil y consume tiempo, y hasta especialistas experimentados pueden discrepar. Este estudio presenta un nuevo sistema de inteligencia artificial (IA), llamado MM‑FD‑ConvFormer, diseñado para ayudar a clasificar tumores cerebrales a partir de resonancias con mayor precisión, mayor fiabilidad y de una manera que los clínicos puedan interpretar mejor.

Ver los tumores desde más de un ángulo

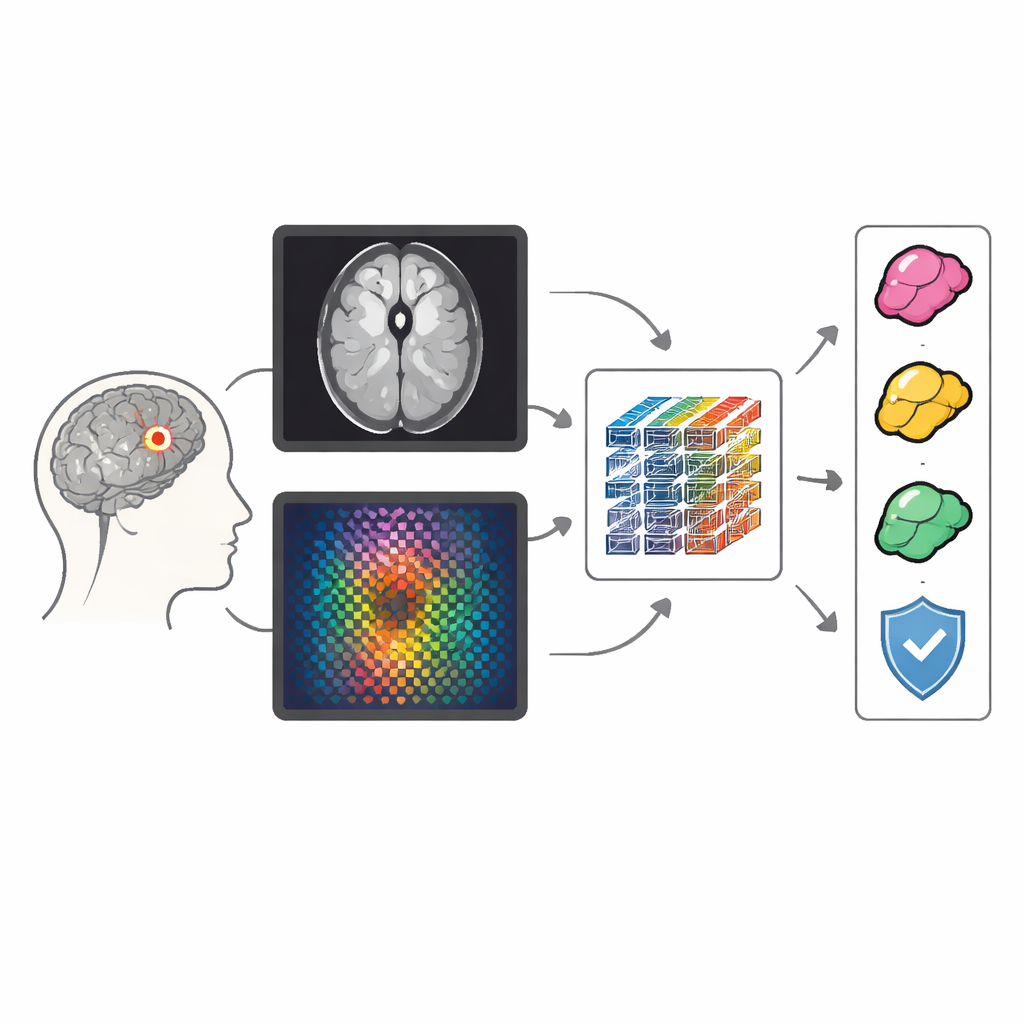

La mayoría de los sistemas informáticos existentes analizan las resonancias de forma directa: examinan la imagen espacial que vemos en la pantalla, concentrándose en formas, intensidad y bordes. MM‑FD‑ConvFormer va más allá al tratar la misma exploración como dos vistas diferentes pero complementarias. Una vista es la imagen espacial familiar del cerebro; la otra es una vista en el dominio de la frecuencia creada mediante transformadas matemáticas que resaltan texturas sutiles y cambios rápidos en la intensidad. Al combinar ambas vistas, el modelo puede captar mejor diferencias finas entre tumor y tejido sano, sobre todo en casos donde los bordes del tumor son borrosos o la apariencia varía entre diferentes escáneres u hospitales.

Un camino por capas desde la exploración hasta la decisión

El sistema procesa cada corte de la MRI mediante dos vías paralelas. En la primera, una red convolucional moderna (una versión refinada de un motor clásico de análisis de imágenes) aprende patrones de anatomía y de la forma del tumor. En la segunda, una red más ligera analiza la versión basada en frecuencia del mismo corte, que enfatiza pistas de textura y de límites. Estas dos corrientes se fusionan y refinan mediante un módulo transformer, un tipo de arquitectura de IA desarrollado originalmente para lenguaje pero ahora muy usado en visión porque puede conectar regiones distantes de una imagen y entender un contexto más amplio, por ejemplo dónde se sitúa un tumor dentro del cerebro.

Adaptarse a formas tumorales irregulares

Muchos tumores, especialmente los gliomas agresivos, no tienen contornos limpios y redondeados. Los mecanismos de atención tradicionales en IA observan ubicaciones fijas en una rejilla, lo que puede pasar por alto o difuminar estas estructuras irregulares. MM‑FD‑ConvFormer introduce un bloque de atención deformable cruzada entre modalidades que permite al modelo “doblar” su foco para seguir la forma real del tumor. De forma crucial, este bloque basa sus ajustes en una mezcla de información espacial y de frecuencia, de modo que la estructura y la textura guían conjuntamente dónde mira el modelo. Este diseño mejora la sensibilidad a lo largo de bordes complejos y ayuda a alinear lo aprendido por las dos ramas, haciendo que la representación final fusionada sea más informativa para la clasificación.

Demostrar fiabilidad en hospitales diversos

Para evaluar si el sistema se mantiene en condiciones realistas, los autores lo entrenaron con colecciones públicas de MRI muy usadas en Kaggle y Figshare y luego lo probaron en conjuntos de datos clínicos separados, incluidos BraTS 2020/2021 y la colección REMBRANDT. MM‑FD‑ConvFormer superó a competidores fuertes basados en convoluciones, transformers e híbridos en medidas estándar como precisión, puntuación F1 y área bajo la curva ROC. Alcanzó aproximadamente un 99,8 % de precisión para distinguir exploraciones con tumor de las normales y mantuvo un alto rendimiento al evaluarse en conjuntos no vistos y recopilados con distintos escáneres y protocolos. El modelo también estima su propia incertidumbre mediante pasadas repetidas y ligeramente aleatorizadas, lo que puede señalar casos límite donde el juicio de un experto humano es especialmente importante.

Hacer visibles las decisiones de la IA para los clínicos

Más allá de los números, los autores se centraron en si los radiólogos podían comprender y confiar en las decisiones del modelo. Usaron técnicas de mapas de calor como Grad‑CAM y SHAP para mostrar qué partes de la imagen y qué flujo de características (espacial o de frecuencia) impulsaron cada predicción. Estas explicaciones visuales se alinearon bien con regiones y límites tumorales conocidos, logrando una fuerte superposición con las máscaras dibujadas por expertos aunque el sistema se entrenó solo para clasificación y no para segmentación. La rama de frecuencia aportó más en datos difíciles, con muchos artefactos o procedentes de distintos centros, confirmando que el enfoque de doble vista no es solo un truco matemático sino realmente útil en la práctica.

Qué significa esto para pacientes y médicos

En términos sencillos, MM‑FD‑ConvFormer es un asistente de IA que examina resonancias cerebrales de dos maneras complementarias, sigue de forma flexible la forma real del tumor y puede explicar dónde está “mirando” cuando toma una decisión. En varios conjuntos de datos, fue más preciso y más robusto frente a cambios de escáneres y hospitales que métodos previos, además de ofrecer mejores justificaciones visuales para sus decisiones y una sensación incorporada de cuándo podría estar equivocado. Si se valida más en entornos clínicos y se extiende a exploraciones 3D completas, este tipo de tecnología podría apoyar una detección de tumores más temprana y consistente y ayudar a radiólogos y neurólogos a personalizar el tratamiento con mayor confianza.

Cita: Arockia Selvarathinam, A.X., Lilhore, U.K., Alroobaea, R. et al. MM FD ConvFormer multimodal frequency aware deformable CNN transformer network for robust brain tumor classification. Sci Rep 16, 12669 (2026). https://doi.org/10.1038/s41598-026-43616-3

Palabras clave: tumor cerebral MRI, IA en imagen médica, modelos de aprendizaje profundo, clasificación de tumores, interpretabilidad del modelo