Clear Sky Science · pt

Reconstrução de super-resolução de imagens de sensoriamento remoto baseada em redes adversariais generativas

Visões mais nítidas do nosso planeta em mudança

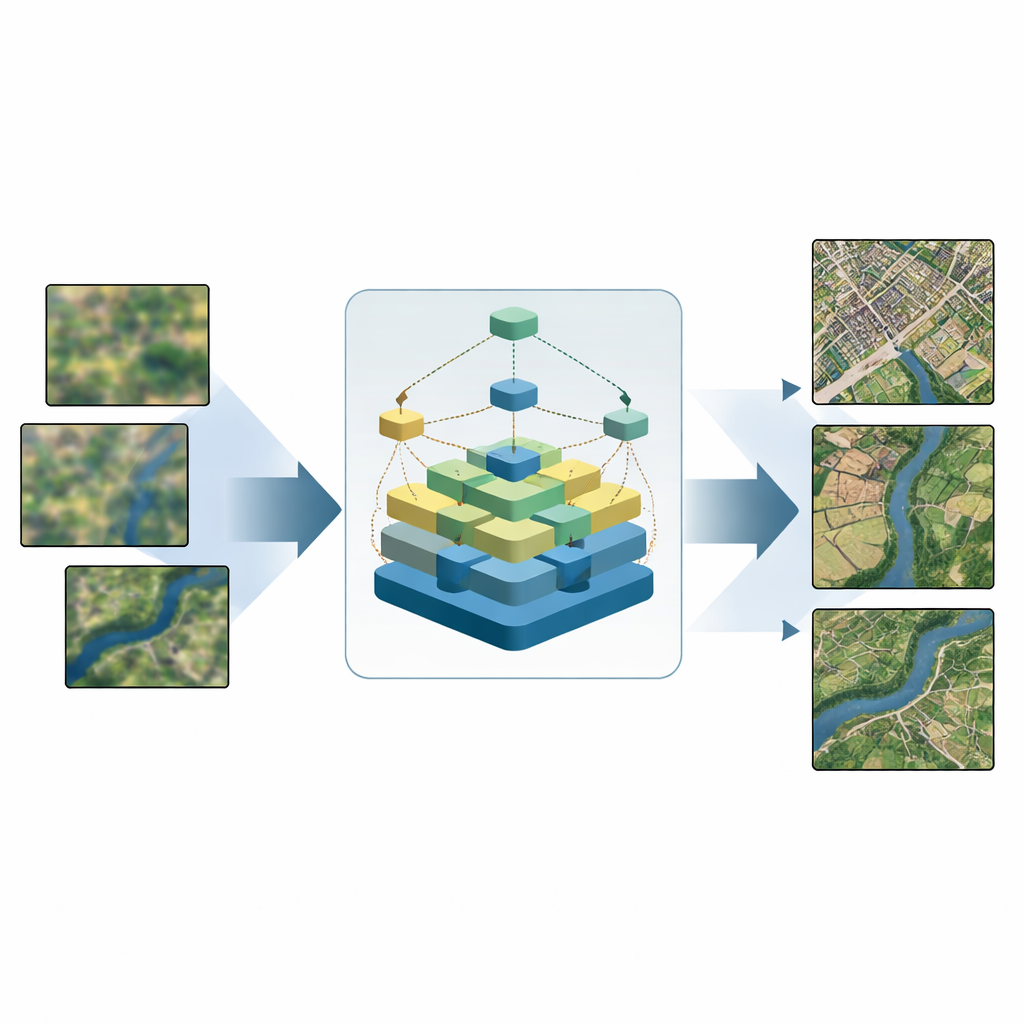

Toda viagem, satélites capturam vastos mosaicos da Terra que orientam o crescimento urbano, resposta a desastres, agricultura e proteção ambiental. Ainda assim, muitas dessas imagens são mais borradas do que gostaríamos: linhas finas de estradas desaparecem, contornos de edifícios se esvaem e pequenos detalhes somem. Este estudo apresenta um novo método de visão computacional, chamado SDGAN, que transforma imagens de satélite grosseiras em vistas mais nítidas e detalhadas enquanto usa menos poder computacional — tornando mapas nítidos e oportunos mais práticos para uso no mundo real.

Por que as imagens de satélite ficam borradas

Satélites modernos orbitam bem acima da Terra e precisam enxergar através de uma atmosfera agitada, tudo isso operando dentro de limites rígidos de tamanho, energia e custo. Como resultado, muitas imagens brutas de sensoriamento remoto têm resolução limitada: pequenas casas se fundem em blocos de cor, rios estreitos perdem a forma e texturas de áreas agrícolas ficam indistintas. Truques tradicionais de nitidez — como simples zoom e interpolação — podem ampliar imagens, mas não conseguem inventar detalhes convincentes. Métodos mais avançados baseados em aprendizado ajudam, mas frequentemente criam artefatos estranhos, falham em cenas com tipos de terreno mistos ou exigem poder computacional demais para dispositivos como drones e laptops de campo.

Uma maneira inteligente de recuperar detalhes perdidos

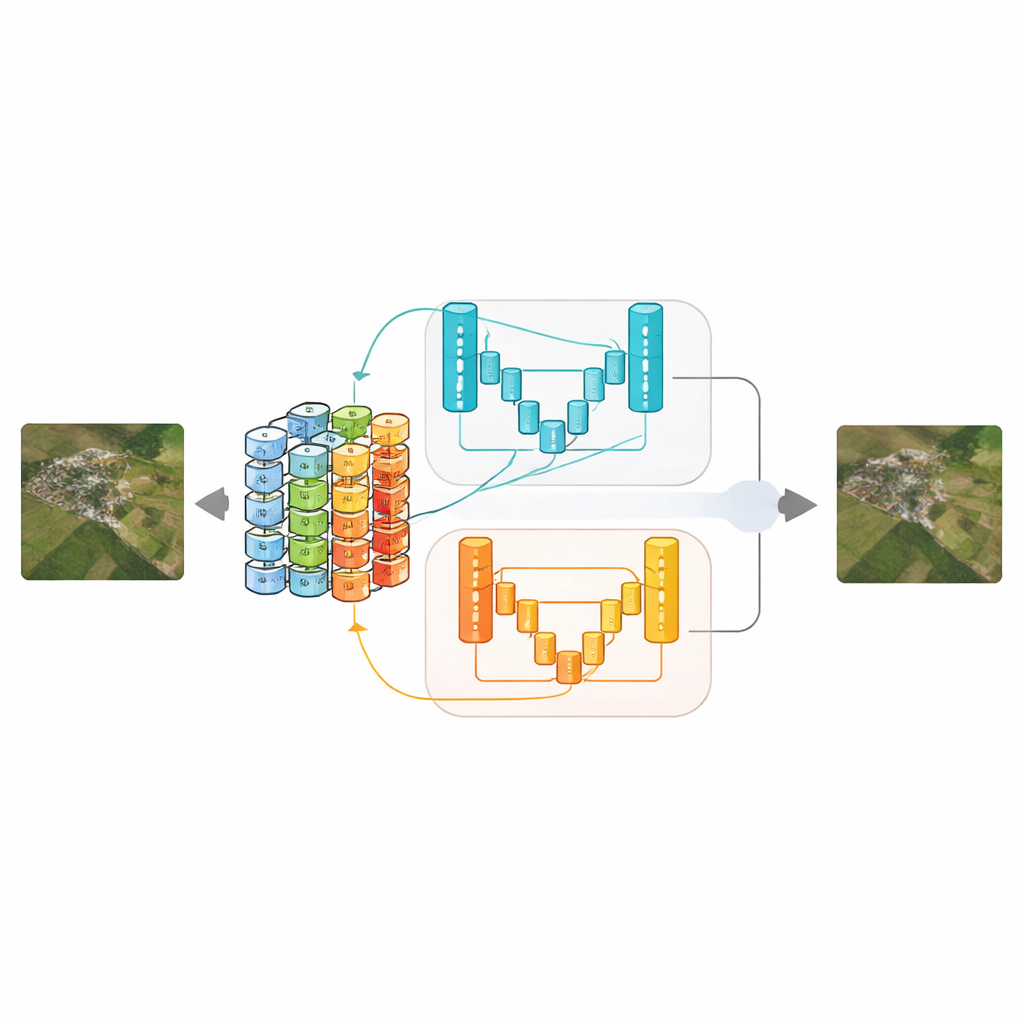

Os autores abordam esse problema com o SDGAN, uma estrutura de “super-resolução” que aprende a reconstruir estruturas finas a partir de imagens de satélite de baixa resolução. No cerne está um novo bloco construtivo chamado bloco residual super-denso. Em vez de passar informação visual diretamente por uma pilha de camadas, esse projeto organiza muitas unidades de processamento pequenas em uma grade e as conecta em múltiplas direções — incluindo diagonais. Essa rede de conexões permite que padrões básicos de camadas iniciais e padrões mais ricos de camadas profundas interajam de forma mais eficaz. Na prática, isso ajuda a rede a recuperar arestas e texturas nítidas, como estradas que se cruzam ou limites irregulares de campos, mantendo o modelo relativamente compacto e eficiente.

Dois críticos mantêm a rede honesta

Para julgar se as imagens aprimoradas parecem realistas, o SDGAN usa não um, mas dois discriminadores baseados em um design em forma de U simplificado com mecanismos de atenção. Um discriminador examina imagens em tamanho real e se concentra em detalhes minuciosos, como faixas de pista ou contornos de edifícios. O outro analisa versões redimensionadas e foca na disposição geral — os sistemas fluviais são contínuos, os quadros urbanos e padrões agrícolas fazem sentido à primeira vista? Ao treinar o gerador contra ambos os críticos simultaneamente, o sistema aprende a produzir imagens que são ao mesmo tempo localmente nítidas e globalmente coerentes, reduzindo problemas comuns como texturas com aparência artificial ou estruturas de grande escala quebradas.

Testando o método

A equipe testou o SDGAN em três coleções amplamente usadas de sensoriamento remoto: UCMerced-LandUse, WHU-RS19 e AID, que juntas cobrem dezenas de tipos de cena, de aeroportos e portos a florestas e áreas residenciais. Eles compararam seu método com redes convolucionais clássicas, abordagens generativas líderes como SRGAN e Real-ESRGAN, e modelos especializados recentes. Ao longo de diferentes fatores de zoom, o SDGAN geralmente entregou a melhor combinação de nitidez, similaridade estrutural e naturalidade percebida, segundo tanto pontuações numéricas quanto inspeção visual. Importante, fez isso reduzindo o tempo médio de processamento em até cerca de 22% em comparação com um método forte anterior, mostrando que maior clareza não precisa vir com um custo computacional pesado.

Imagens mais claras, decisões melhores

Para não especialistas, a conclusão chave é que o SDGAN oferece uma maneira de tornar a imagem de satélite mais clara e mais confiável. Ao preservar cuidadosamente arestas, texturas e padrões de grande escala, produz imagens mais fáceis de interpretar por analistas e sistemas automatizados — seja para detectar deslizamentos, mapear uso do solo ou rastrear águas de enchentes. Como o método é relativamente leve, também é mais adequado a dispositivos com poder computacional limitado, como drones usados em levantamentos de emergência. Os autores sugerem que trabalhos futuros poderiam estender o SDGAN para lidar com degradações de imagem mais severas, tipos adicionais de sensor como radar ou câmeras térmicas, e prontas ligações a tarefas a jusante, aproximando-nos de vistas em alta fidelidade e quase em tempo real do nosso planeta dinâmico.

Citação: Wang, L., Liu, L., Yu, Q. et al. Generative adversarial network-based super-resolution reconstruction of remote sensing images. Sci Rep 16, 11971 (2026). https://doi.org/10.1038/s41598-026-41832-5

Palavras-chave: sensoriamento remoto, super-resolução de imagem, imagens de satélite, aprendizado profundo, redes adversariais generativas