Clear Sky Science · de

Super-Resolution-Rekonstruktion von Fernerkundungsbildern auf Basis generativer gegnerischer Netze

Scharfere Ansichten unseres sich verändernden Planeten

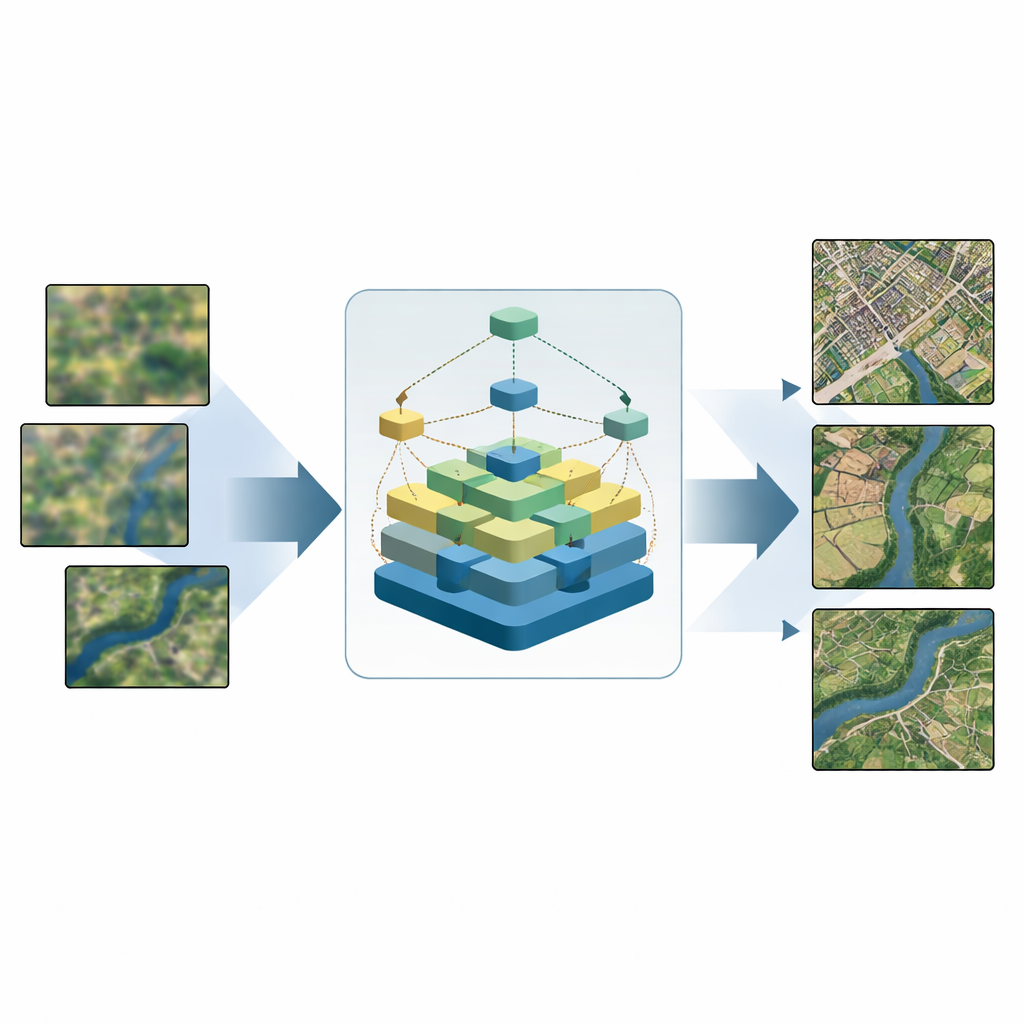

Täglich erfassen Satelliten umfassende Mosaike der Erde, die Stadtentwicklung, Katastrophenhilfe, Landwirtschaft und Umweltschutz steuern. Viele dieser Bilder sind jedoch unschärfer, als wir es gern hätten: feine Straßenlinien verblassen, Gebäudekanten verwischen und kleine Merkmale gehen verloren. Diese Studie stellt eine neue Computer-Vision-Methode vor, genannt SDGAN, die grobe Satellitenaufnahmen in klarere, detailreichere Ansichten verwandelt und dabei weniger Rechenleistung benötigt — sodass scharfe, aktuelle Karten für den praktischen Einsatz realistischer werden.

Warum Satellitenbilder unscharf werden

Moderne Satelliten kreisen weit über der Erde und müssen durch eine turbulente Atmosphäre blicken, während sie zugleich strenge Beschränkungen bei Größe, Energieverbrauch und Kosten einhalten. Infolgedessen haben viele Rohbilder der Fernerkundung eine begrenzte Auflösung: kleine Häuser verschmelzen zu Farbflächen, schmale Flüsse verlieren ihre Form und Ackerflächen wirken ohne Textur. Traditionelle Aufschärftricks — etwa einfaches Hochrechnen und Interpolation — können Bilder vergrößern, aber keine glaubwürdigen Details erschaffen. Fortschrittlichere lernbasierte Methoden helfen zwar, erzeugen jedoch oft seltsame Artefakte, versagen bei Szenen mit gemischten Landnutzungen oder verlangen zu viel Rechenleistung für Geräte wie Drohnen und Feld-Laptops.

Ein intelligenter Ansatz zur Wiederherstellung verlorener Details

Die Autoren gehen dieses Problem mit SDGAN an, einem Super-Resolution-Framework, das lernt, feine Strukturen aus niedrig aufgelösten Satellitenbildern zu rekonstruieren. Im Kern steht ein neuer Baustein, der super-dichte Residualblock genannt wird. Anstatt visuelle Informationen einfach durch einen Stapel von Schichten zu leiten, ordnet dieses Design viele kleine Verarbeitungseinheiten in einem Gitter an und verbindet sie in mehreren Richtungen — inklusive Diagonalen. Dieses Netz von Verbindungen lässt grundlegende Muster aus frühen Schichten und reichhaltigere Muster aus tieferen Schichten effektiver miteinander interagieren. In der Praxis hilft das dem Netzwerk, scharfe Kanten und Texturen wiederherzustellen, etwa sich kreuzende Straßen oder unregelmäßige Feldgrenzen, während das Modell relativ kompakt und effizient bleibt.

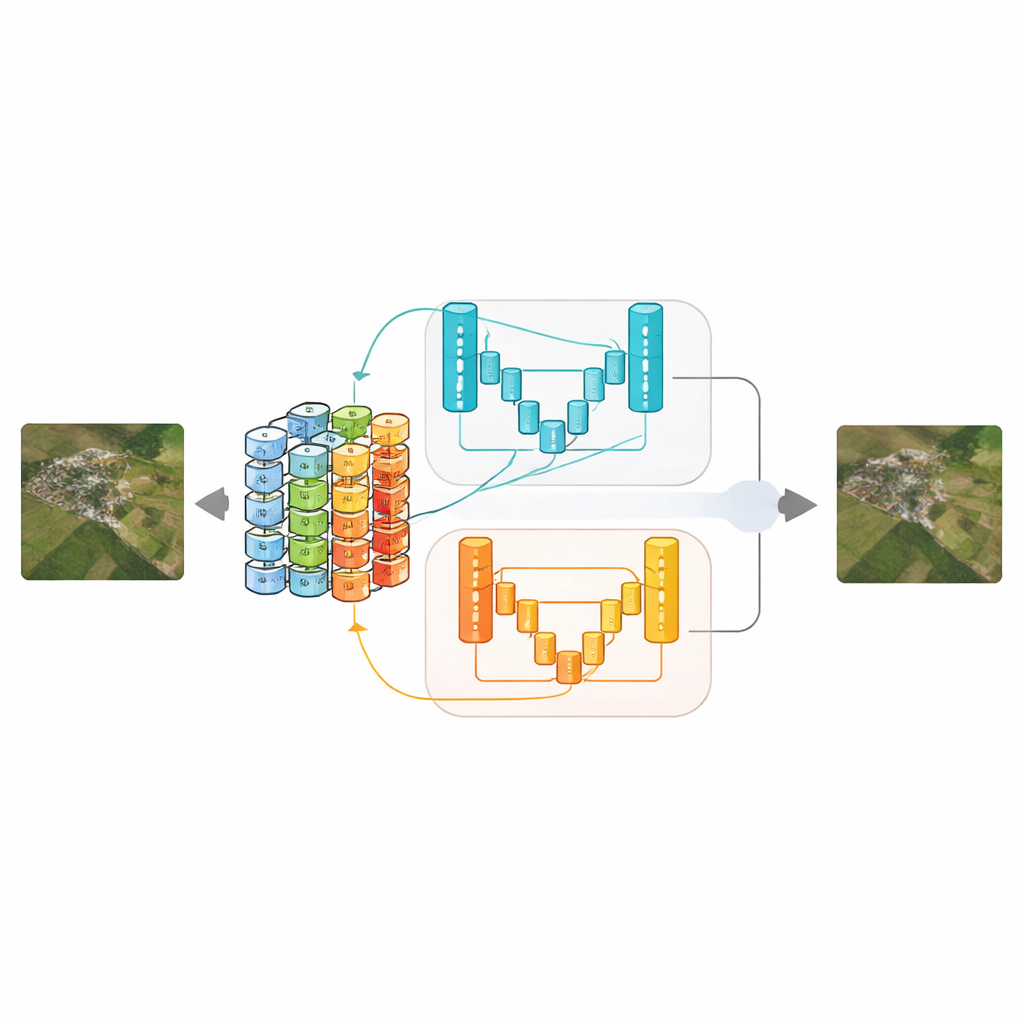

Zwei Kritiker halten das Netzwerk ehrlich

Um zu beurteilen, ob die geschärften Bilder realistisch wirken, verwendet SDGAN nicht einen, sondern zwei „Discriminator“-Netzwerke, basierend auf einem gestrafften U-förmigen Design mit Aufmerksamkeitsmechanismen. Ein Discriminator untersucht Bilder in voller Größe und konzentriert sich auf winzige Details wie Rollbahnstreifen oder Gebäudeumrisse. Der andere betrachtet herunterskalierte Versionen und fokussiert auf das Gesamtbild — sind Flusssysteme durchgängig, ergeben Stadtblöcke und Ackerstrukturen auf einen Blick Sinn? Indem der Generator gleichzeitig gegen beide Kritiker trainiert wird, lernt das System, Bilder zu erzeugen, die sowohl lokal scharf als auch global kohärent sind, wodurch typische Probleme wie unechte Texturen oder zerstörte großräumige Strukturen reduziert werden.

Die Methode auf die Probe gestellt

Das Team testete SDGAN an drei weithin genutzten Fernerkundungs-Sammlungen: UCMerced-LandUse, WHU-RS19 und AID, die zusammen Dutzende von Szenentypen abdecken — von Flughäfen und Häfen bis zu Wäldern und Wohngebieten. Sie verglichen ihre Methode mit klassischen Faltungsnetzwerken, führenden generativen Ansätzen wie SRGAN und Real-ESRGAN sowie jüngeren spezialisierten Modellen. Bei verschiedenen Vergrößerungsfaktoren lieferte SDGAN allgemein die beste Kombination aus Schärfe, struktureller Ähnlichkeit und wahrgenommener Natürlichkeit, gemessen sowohl an numerischen Werten als auch an visueller Begutachtung. Wichtig ist, dass es dies bei einer Verringerung der durchschnittlichen Verarbeitungszeit um bis zu etwa 22 Prozent gegenüber einer starken Vorläufermethode erreichte — ein Hinweis darauf, dass größere Klarheit nicht zwangsläufig mit hohem Rechenaufwand einhergehen muss.

Klarere Bilder, bessere Entscheidungen

Für Nichtfachleute ist die zentrale Erkenntnis: SDGAN bietet einen Weg, Satellitenbilder sowohl klarer als auch vertrauenswürdiger zu machen. Durch das behutsame Bewahren von Kanten, Texturen und großräumigen Mustern entstehen Bilder, die für Analysten und automatisierte Systeme leichter zu interpretieren sind — sei es beim Aufspüren von Erdrutschen, der Kartierung von Landnutzung oder der Verfolgung von Überschwemmungen. Da die Methode relativ ressourcenschonend ist, eignet sie sich besser für Geräte mit begrenzter Rechenleistung, wie etwa bei Notfalleinsätzen eingesetzte Drohnen. Die Autoren schlagen vor, SDGAN in Zukunft auf stärkere Bildverschlechterungen, zusätzliche Sensortypen wie Radar- oder Wärmebildkameras und direkte Anbindungen an nachgelagerte Aufgaben auszuweiten, um uns näher an Echtzeit- und hochauflösende Ansichten unseres dynamischen Planeten zu bringen.

Zitation: Wang, L., Liu, L., Yu, Q. et al. Generative adversarial network-based super-resolution reconstruction of remote sensing images. Sci Rep 16, 11971 (2026). https://doi.org/10.1038/s41598-026-41832-5

Schlüsselwörter: Fernerkundung, Bild-Superauflösung, Satellitenbilder, Tiefes Lernen, generative gegnerische Netze