Clear Sky Science · pl

Rekonstrukcja superrozdzielczości obrazów teledetekcyjnych oparta na generacyjnych sieciach adversarialnych

Bardziej wyraźne obrazy naszej zmieniającej się planety

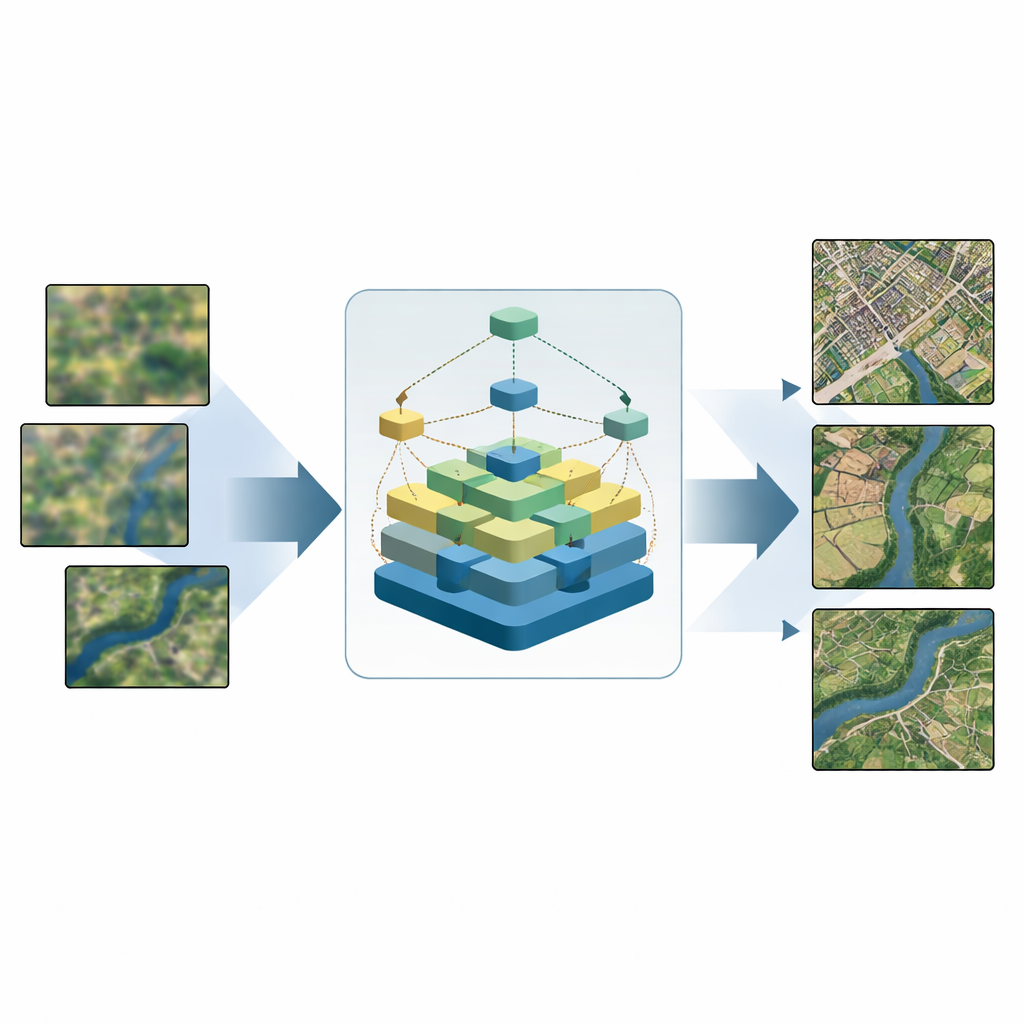

Codziennie satelity rejestrują obszerne mozaiki Ziemi, które wspomagają rozwój miast, reagowanie na katastrofy, rolnictwo i ochronę środowiska. Wielu z tych obrazów jest jednak mniej ostrych, niż byśmy chcieli: drobne linie dróg bledną, krawędzie budynków się rozmywają, a małe obiekty znikają. W tym badaniu przedstawiono nową metodę widzenia komputerowego, nazwaną SDGAN, która zamienia surowe satelitarne zdjęcia w wyraźniejsze, bardziej szczegółowe obrazy, przy mniejszym zużyciu mocy obliczeniowej — co czyni tworzenie ostrzejszych, aktualnych map bardziej praktycznym w zastosowaniach rzeczywistych.

Dlaczego obrazy satelitarne są niewyraźne

Współczesne satelity krążą wysoko nad Ziemią i muszą patrzeć przez niestabilną atmosferę, działając jednocześnie w ramach rygorystycznych ograniczeń rozmiaru, mocy i kosztów. W efekcie wiele surowych obrazów teledetekcyjnych ma ograniczoną rozdzielczość: małe domy łączą się w plamy kolorów, wąskie rzeki tracą kształt, a tekstury pól stają się nieokreślone. Tradycyjne sztuczki wyostrzające — takie jak proste powiększenie czy interpolacja — potrafią zwiększyć rozmiar obrazów, ale nie są w stanie wymyślić przekonujących detali. Bardziej zaawansowane metody oparte na uczeniu pomagają, lecz często generują nienaturalne artefakty, zawodzą na scenach z mieszanym typem pokrycia terenu lub wymagają zbyt dużej mocy obliczeniowej dla urządzeń takich jak drony czy laptopy terenowe.

Sprytny sposób odzyskiwania utraconych detali

Autorzy rozwiązują ten problem za pomocą SDGAN, ramki „super-rozdzielczości”, która uczy się odtwarzać drobne struktury z obrazów o niskiej rozdzielczości. W jej centrum znajduje się nowy element konstrukcyjny zwany super-gęstym blokiem resztkowym. Zamiast przesyłać informacje wizualne prostoliniowo przez stos warstw, ten projekt rozmieszcza wiele niewielkich jednostek przetwarzających w siatce i łączy je w wielu kierunkach — w tym po przekątnych. Ta sieć połączeń pozwala podstawowym wzorom z wczesnych warstw i bogatszym wzorom z głębszych warstw efektywniej wchodzić ze sobą w interakcję. W praktyce pomaga to sieci odzyskać ostre krawędzie i tekstury, takie jak przecinające się drogi czy nieregularne granice pól, przy jednoczesnym zachowaniu stosunkowo kompaktowego i wydajnego modelu.

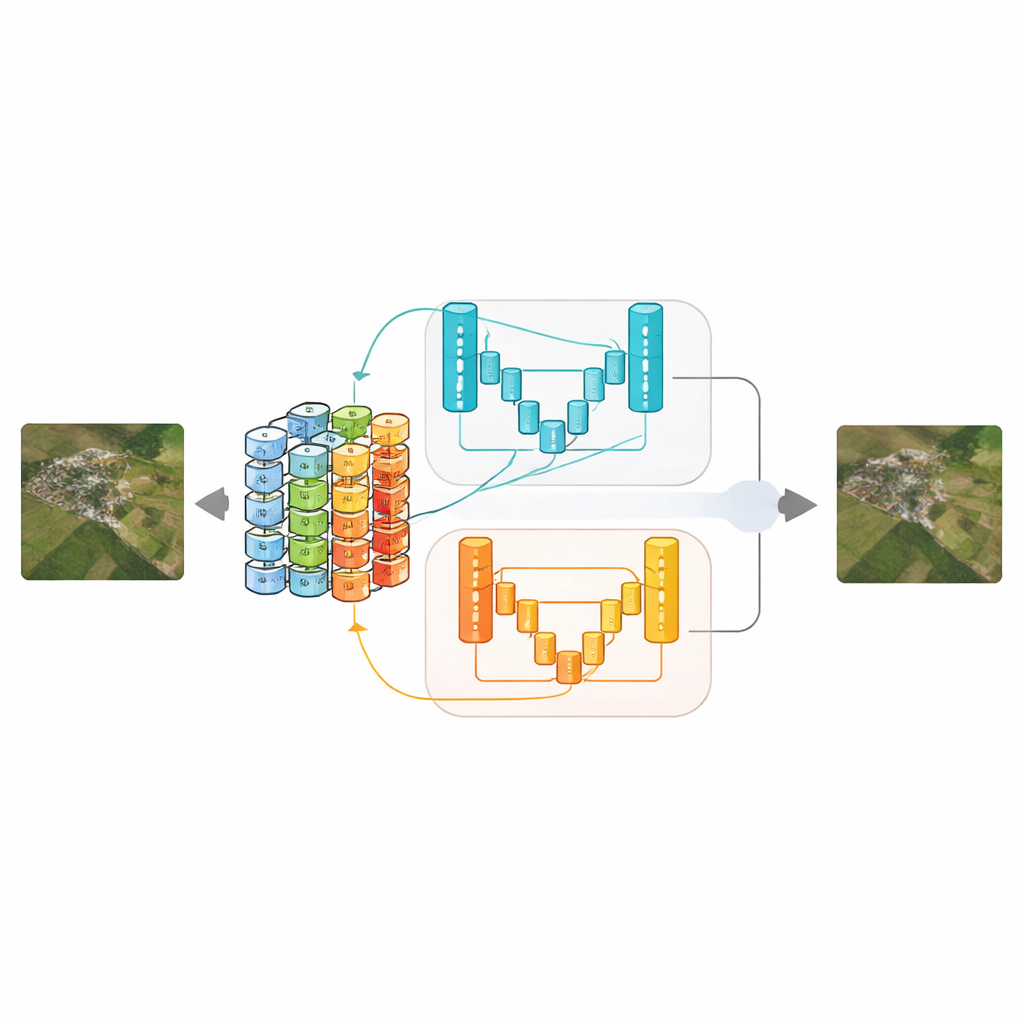

Dwaj krytycy pilnują uczciwości sieci

Aby ocenić, czy wyostrzone obrazy wyglądają realistycznie, SDGAN wykorzystuje nie jeden, lecz dwa sieci „dyskryminatorów” oparte na uproszczonym, odwróconym układzie typu U z mechanizmami uwagi. Jeden dyskryminator analizuje obrazy w pełnym rozmiarze i koncentruje się na bardzo drobnych detalach, takich jak pasy na pasie startowym czy kontury budynków. Drugi patrzy na wersje downsample’owane i skupia się na ogólnym układzie — czy systemy rzeczne są ciągłe, czy bloki miejskie i wzory pól rolne wyglądają sensownie na pierwszy rzut oka? Trenując generator przeciwko obu krytykom jednocześnie, system uczy się tworzyć obrazy będące zarówno lokalnie ostre, jak i globalnie spójne, zmniejszając powszechne problemy, takie jak sztuczne tekstury czy zniszczone struktury na dużą skalę.

Testy metody

Zespół przetestował SDGAN na trzech powszechnie używanych zbiorach teledetekcyjnych: UCMerced-LandUse, WHU-RS19 i AID, które łącznie obejmują dziesiątki typów scen — od lotnisk i portów po lasy i obszary mieszkalne. Porównali swoją metodę z klasycznymi sieciami konwolucyjnymi, wiodącymi podejściami generatywnymi, takimi jak SRGAN i Real-ESRGAN, oraz z nowszymi modelami specjalistycznymi. W różnych skalach powiększenia SDGAN zazwyczaj dostarczał najlepsze połączenie ostrości, podobieństwa strukturalnego i subiektywnego naturalnego wyglądu, według zarówno wyników numerycznych, jak i inspekcji wzrokowej. Co ważne, osiągał to przy skróceniu średniego czasu przetwarzania nawet o około 22 procent w porównaniu z silną wcześniejszą metodą, pokazując, że większa klarowność nie musi iść w parze z dużymi wymaganiami obliczeniowymi.

Wyraźniejsze obrazy, lepsze decyzje

Dla osób nietechnicznych kluczowy wniosek jest taki, że SDGAN oferuje sposób na uzyskanie obrazów satelitarnych jednocześnie bardziej wyraźnych i bardziej wiarygodnych. Poprzez staranne zachowanie krawędzi, tekstur i wzorców na dużą skalę daje obrazy, które łatwiej interpretują analitycy i systemy automatyczne — czy to wykrywając osuwiska, mapując wykorzystanie gruntów, czy śledząc wody powodziowe. Ponieważ metoda jest stosunkowo lekka, lepiej nadaje się też do urządzeń o ograniczonej mocy obliczeniowej, takich jak drony używane w pilnych rekonesansach. Autorzy sugerują, że przyszłe prace mogą rozszerzyć SDGAN o obsługę silniejszych degradacji obrazu, dodatkowych typów sensorów, takich jak radar czy kamery termalne, oraz bezpośrednich powiązań z zadaniami docelowymi, przybliżając nas do widoków wysokiej jakości w czasie zbliżonym do rzeczywistego naszej dynamicznej planety.

Cytowanie: Wang, L., Liu, L., Yu, Q. et al. Generative adversarial network-based super-resolution reconstruction of remote sensing images. Sci Rep 16, 11971 (2026). https://doi.org/10.1038/s41598-026-41832-5

Słowa kluczowe: teledetekcja, superrozdzielczość obrazu, obrazy satelitarne, uczenie głębokie, generacyjne sieci adversarialne