Clear Sky Science · es

Reconstrucción de superresolución de imágenes de teledetección basada en redes adversarias generativas

Vistas más nítidas de nuestro planeta cambiante

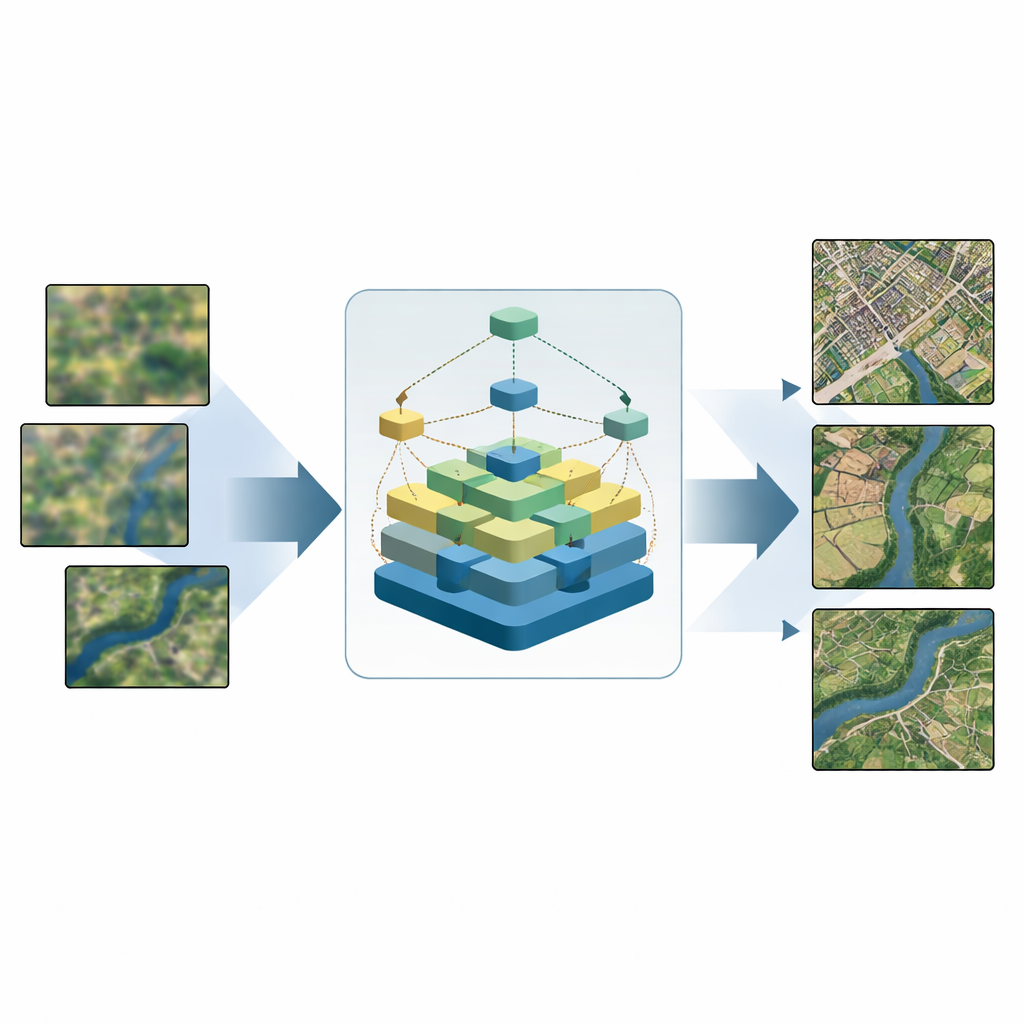

Cada día, los satélites capturan vastos mosaicos de la Tierra que guían el crecimiento urbano, la respuesta a desastres, la agricultura y la protección ambiental. Sin embargo, muchas de estas imágenes son más borrosas de lo deseable: las líneas finas de las carreteras se desvanecen, los bordes de los edificios se difuminan y las pequeñas características desaparecen. Este estudio presenta un nuevo método de visión por computador, llamado SDGAN, que transforma imágenes satelitales toscas en vistas más claras y detalladas mientras usa menos potencia de cálculo —haciendo que mapas nítidos y puntuales sean más prácticos para su uso real.

Por qué las imágenes satelitales quedan borrosas

Los satélites modernos orbitan muy por encima de la Tierra y deben mirar a través de una atmósfera inestable, todo ello mientras operan dentro de límites estrictos de tamaño, energía y coste. Como resultado, muchas imágenes crudas de teledetección tienen resolución limitada: las casas pequeñas se funden en bloques de color, los ríos estrechos pierden su forma y las texturas agrícolas se vuelven indistintas. Los trucos tradicionales de mejora —como el zoom simple y la interpolación— pueden ampliar las imágenes pero no pueden inventar detalles creíbles. Métodos más avanzados basados en aprendizaje ayudan, pero a menudo crean artefactos extraños, fallan en escenas de tipos de terreno mezclados o exigen demasiada potencia de cálculo para dispositivos como drones y portátiles de campo.

Una forma inteligente de recuperar detalle perdido

Los autores abordan este problema con SDGAN, un marco de “superresolución” que aprende a reconstruir estructuras finas a partir de imágenes satelitales de baja resolución. En su núcleo está un nuevo bloque constructivo llamado bloque residual super-denso. En lugar de pasar la información visual directamente a través de una pila de capas, este diseño organiza muchas unidades pequeñas de procesamiento en una rejilla y las conecta en múltiples direcciones —incluidas las diagonales. Esta red de conexiones permite que los patrones básicos de capas tempranas y los patrones más ricos de capas profundas interactúen de forma más eficaz. En la práctica, esto ayuda a la red a recuperar bordes y texturas nítidas, como carreteras que se cruzan o límites irregulares de parcelas, manteniendo el modelo relativamente compacto y eficiente.

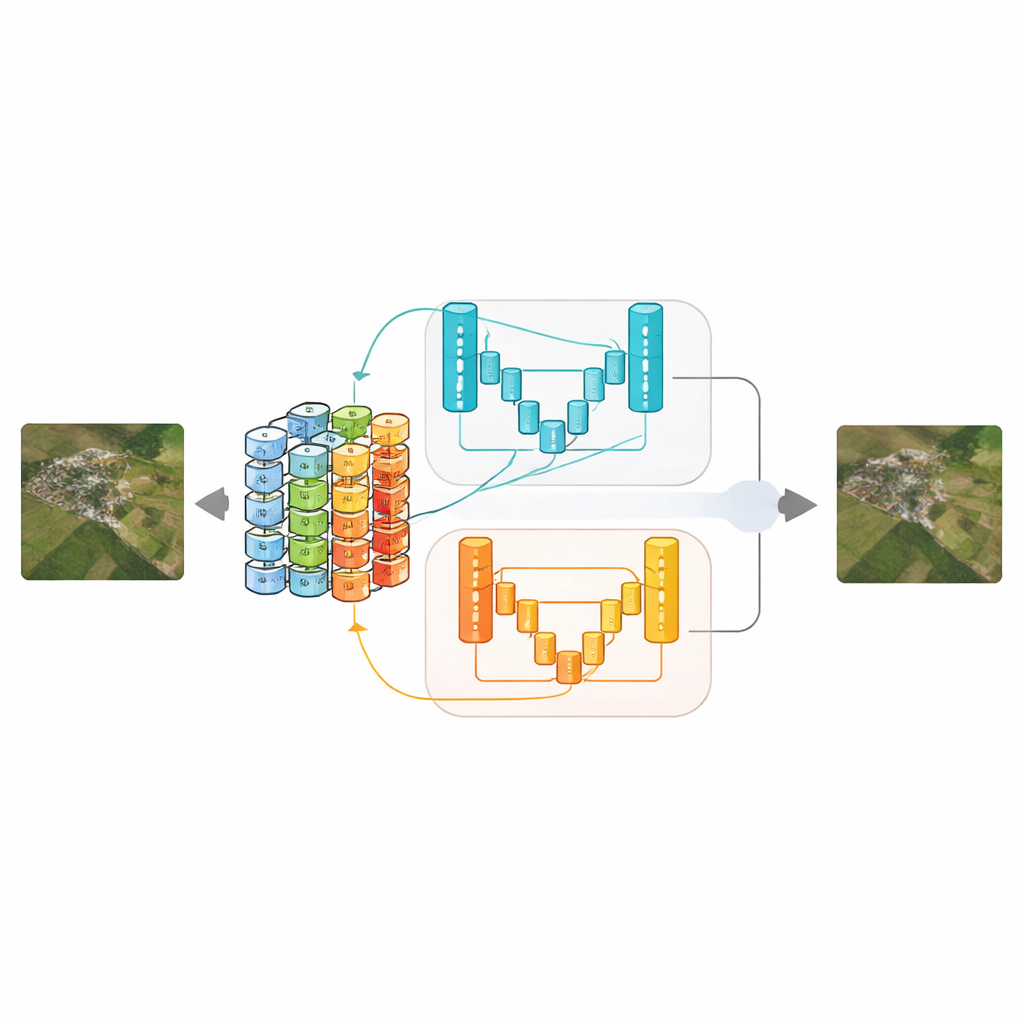

Dos críticos mantienen la red honesta

Para evaluar si las imágenes mejoradas parecen realistas, SDGAN utiliza no uno sino dos redes “discriminadoras” basadas en un diseño en forma de U simplificado con mecanismos de atención. Un discriminador examina imágenes a tamaño completo y se concentra en detalles minúsculos, como las franjas de una pista o el contorno de un edificio. El otro observa versiones reducidas y se centra en la disposición general: ¿son continuos los sistemas fluviales?, ¿tienen sentido de un vistazo los bloques urbanos y los patrones agrícolas? Al entrenar el generador frente a ambos críticos a la vez, el sistema aprende a producir imágenes que son localmente nítidas y globalmente coherentes, reduciendo problemas comunes como texturas que parecen falsas o estructuras a gran escala rotas.

Poniendo el método a prueba

El equipo probó SDGAN en tres colecciones de teledetección ampliamente usadas: UCMerced-LandUse, WHU-RS19 y AID, que en conjunto cubren docenas de tipos de escena desde aeropuertos y puertos hasta bosques y zonas residenciales. Compararon su método con redes convolucionales clásicas, enfoques generativos líderes como SRGAN y Real-ESRGAN, y modelos especializados recientes. A través de distintos factores de aumento, SDGAN ofreció generalmente la mejor combinación de nitidez, similitud estructural y naturalidad percibida, según puntuaciones numéricas y la inspección visual. De forma importante, lo hizo reduciendo el tiempo de procesamiento medio hasta en torno a un 22% comparado con un método previo potente, demostrando que una mayor claridad no tiene por qué implicar una factura computacional elevada.

Imágenes más claras, mejores decisiones

Para el público no especialista, la conclusión clave es que SDGAN ofrece una forma de hacer que la imagen satelital sea tanto más clara como más fiable. Al preservar cuidadosamente bordes, texturas y patrones a gran escala, produce imágenes que son más fáciles de interpretar para analistas y sistemas automatizados —ya sea para detectar deslizamientos, mapear el uso del suelo o seguir aguas de inundación. Dado que el método es relativamente ligero, también se adapta mejor a dispositivos con potencia de cálculo limitada, como drones empleados en inspecciones de emergencia. Los autores sugieren que trabajos futuros podrían ampliar SDGAN para manejar degradaciones de imagen más severas, tipos de sensores adicionales como radar o cámaras térmicas, y enlaces directos a tareas posteriores, acercándonos a vistas en tiempo real y de alta fidelidad de nuestro planeta dinámico.

Cita: Wang, L., Liu, L., Yu, Q. et al. Generative adversarial network-based super-resolution reconstruction of remote sensing images. Sci Rep 16, 11971 (2026). https://doi.org/10.1038/s41598-026-41832-5

Palabras clave: teledetección, superresolución de imágenes, imágenes satelitales, aprendizaje profundo, redes generativas adversarias