Clear Sky Science · pl

Wyjaśnialne ramy wieloagentowego uczenia ze wzmocnieniem dla bezpiecznej i adaptacyjnej komunikacji w rojach UAV w sieciach FANET

Mądrzejsze zespoły dronów na trudne sytuacje

Wyobraź sobie zespół dronów pędzących w rejon pożaru, zalania lub na akcję poszukiwawczo-ratowniczą. Muszą natychmiast wymieniać informacje, omijać atakujących próbujących zagłuszyć lub zmylić systemy i jednocześnie potrafić wyjaśnić operatorom, dlaczego wybrały jedną trasę zamiast innej. W artykule przedstawiono nowe podejście, które ma uczynić takie roje dronów bezpieczniejszymi i bardziej przejrzystymi, aby można im było zaufać w sytuacjach zagrażających życiu.

Dlaczego roje dronów potrzebują czegoś więcej niż szybkiego Wi‑Fi

Drony w roju nie tylko latają; ciągle się komunikują, przekazując mapy, odczyty czujników i alarmy między sobą. Taki powietrzny system ad hoc, zwany siecią FANET, jest szybki i elastyczny, ale też kruchy. Sygnały przemieszczają się w otwartej przestrzeni, drony szybko się poruszają i brak jest centralnej stacji kontrolnej. To czyni sieć łatwym celem dla ataków cyfrowych, takich jak zagłuszanie sygnału, podszywanie się pod tożsamości czy ciche zrzucanie pakietów. Istniejące narzędzia bezpieczeństwa często opierają się na wolnych, scentralizowanych serwerach lub nieprzezroczystych algorytmach „czarnej skrzynki”, co jest ryzykowne, gdy stawką są życie, mienie lub krytyczna infrastruktura.

Nauka i decyzje podejmowane przez każdy dron

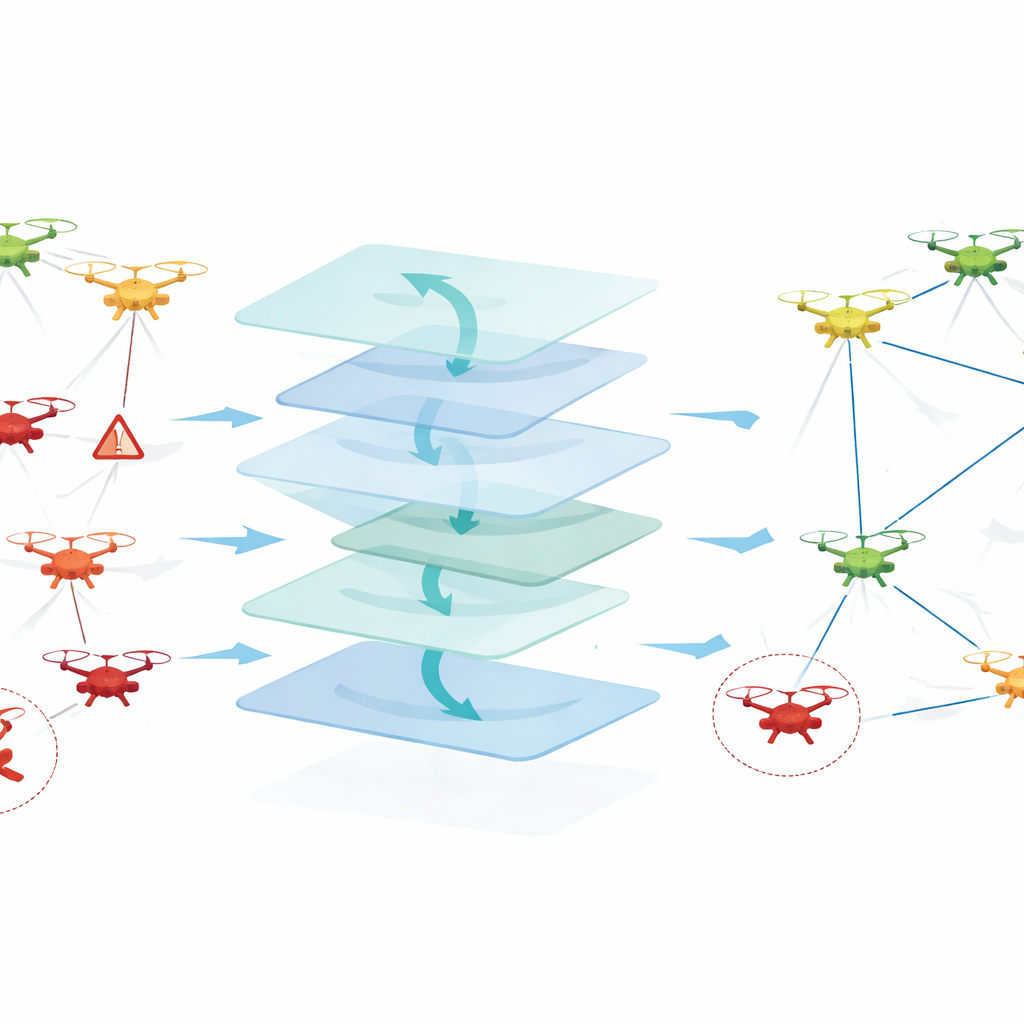

Autorzy proponują Wyjaśnialne Wieloagentowe Ramy Uczenia ze Wzmocnieniem — EMARL‑XAI — które zamienia każdy dron w agenta uczącego się. Zamiast działać według sztywnych reguł, każdy dron obserwuje swoje położenie, jakość sygnału, poziom baterii oraz wiarygodność sąsiadów. Korzystając ze współpracującej metody uczenia, rój stopniowo odkrywa, które ścieżki komunikacyjne dostarczają wiadomości niezawodnie, omijają podejrzane drony i oszczędzają energię. Decyzje typu „kto powinien przekazać ten pakiet dalej?” wyłaniają się z doświadczenia, zamiast być zakodowane na stałe. Co ważne, nie ma pojedynczego węzła nadrzędnego: drony uczą się i działają zdecentralizowanie, co lepiej pasuje do szybko zmieniającego się, wrogiego powietrznego środowiska.

Wykrywanie złych aktorów i utrzymanie łączności

Bezpieczeństwo jest wbudowane bezpośrednio w sposób, w jaki rój się uczy. Każdy dron utrzymuje bieżącą „estymę zaufania” wobec pobliskich dronów, opartą na tym, czy przekazują pakiety, zachowują się konsekwentnie, lub wykazują cechy ataku, takie jak zrzucanie większości pakietów czy zachowywanie się jak wiele fałszywych tożsamości naraz. Oceny zaufania wpływają na przyszłe wybory: niezawodni sąsiedzi są faworyzowani jako przekaźniki, podczas gdy podejrzani są stopniowo omijani i de facto izolowani. Ramy testowano przeciwko szeregowi realistycznych zagrożeń — zagłuszaniu, podszywaniu się pod tożsamość, atakom Sybil i blackhole — w szczegółowej symulacji łączącej symulator sieci (dla łączy radiowych i interferencji) z symulatorem lotu dronów (dla ruchu w przestrzeni 2D i 3D).

Uczynienie decyzji dronów zrozumiałymi

Ponad samą wydajność, system zaprojektowano tak, by potrafił się wyjaśnić. Moduł wyjaśnialności wykorzystuje dobrze znane narzędzia współczesnej sztucznej inteligencji, by pokazać, które czynniki najbardziej wpłynęły na decyzję. Na przykład metoda SHAP klasyfikuje wejścia takie jak zaufanie czy siła sygnału według ich wpływu na wybraną trasę, podczas gdy LIME tworzy proste lokalne modele „co‑jeśli” wokół konkretnych decyzji. Wizualne mapy uwagi podkreślają wzory w niedawnym zachowaniu, na których skupił się system uczący. Razem te widoki pozwalają operatorom zobaczyć, na przykład, że dron ominął pewnego sąsiada głównie dlatego, że jego wcześniejsze zachowanie przy przekazywaniu wyglądało podejrzanie, a nie z powodu chwilowego spadku siły sygnału. To przekształca splot obliczeń sieci neuronowych w śledzalną opowieść.

Jak nowe podejście sprawdza się w wirtualnym niebie

Badacze skonfrontowali EMARL‑XAI z klasycznymi metodami trasowania i bardziej konwencjonalnymi systemami opartymi na uczeniu. W symulowanych misjach z udziałem do 75 dronów i przy do 30% z nich zachowujących się złośliwie, nowe ramy dostarczają większy udział dostarczonych pakietów, skracają opóźnienia i utrzymują relatywnie niski odsetek błędnych oskarżeń uczciwych dronów. Uczą się też stabilnych strategii szybciej niż podobny system wieloagentowy bez mechanizmu zaufania lub wyjaśnień i zużywają mniej energii na udane dostarczenie niż tradycyjne schematy. Gdy autorzy systematycznie usuwają elementy projektu, wydajność spada: usunięcie zaufania drastycznie zwiększa błędy w rozpoznawaniu złośliwych, podczas gdy usunięcie narzędzi wyjaśnialności w niewielkim stopniu wpływa na dokładność, lecz powoduje spadek zaufania u ludzkich oceniających.

Co to oznacza dla rzeczywistych misji dronów

Dla osoby niebędącej specjalistą główne wnioski są takie, że ta praca przybliża roje dronów do bycia godnymi zaufania współpracownikami, a nie tajemniczymi, wrażliwymi urządzeniami. EMARL‑XAI pokazuje, jak drony mogą samodzielnie uczyć się bezpiecznego trasowania wiadomości przez zmienne, wrogie środowisko, pozostawiając jednocześnie czytelny, zrozumiały dla człowieka zapis powodów swoich działań. Choć badanie opiera się na symulacjach i wymaga jeszcze testów na rzeczywistym sprzęcie, wyznacza drogę do flot dronów, które są nie tylko mądrzejsze i bezpieczniejsze, lecz także rozliczalne — co jest niezbędnym krokiem, jeśli oczekujemy, że będą pomagać w zarządzaniu katastrofami, monitorować miasta czy chronić infrastrukturę krytyczną.

Cytowanie: Alkahtani, H.K., Galiya, Y., Akbayan, B. et al. Explainable multi agent reinforcement learning framework for secure and adaptive communication in UAV swarm based fanets. Sci Rep 16, 11830 (2026). https://doi.org/10.1038/s41598-026-39366-x

Słowa kluczowe: Rój UAV, bezpieczna komunikacja, wieloagentowe uczenie ze wzmocnieniem, wyjaśnialna sztuczna inteligencja, bezpieczeństwo sieci bezprzewodowych