Clear Sky Science · es

Marco explicable de aprendizaje por refuerzo multiagente para comunicaciones seguras y adaptativas en enjambres de UAV en FANETs

Equipos de drones más inteligentes para situaciones difíciles

Imagínese un equipo de drones entrando en un incendio forestal, una zona inundada o una misión de búsqueda y rescate. Deben compartir información al instante, sortear atacantes que intentan bloquear o engañar las comunicaciones y, además, explicar a los operadores humanos por qué eligieron una ruta u otra. Este artículo presenta una nueva forma de hacer que esos enjambres de drones sean a la vez más seguros y más comprensibles, para que las personas puedan confiar en ellos en situaciones de vida o muerte.

Por qué los enjambres de drones necesitan algo más que Wi‑Fi rápido

Los drones en un enjambre no solo vuelan; se comunican constantemente, retransmitiendo mapas, lecturas de sensores y alertas unos a otros. Este tipo de red aérea, llamada red ad hoc de vuelo (FANET), es rápida y flexible pero también frágil. Las señales viajan por el aire abierto, los drones se mueven con rapidez y no existe una torre central que lo controle. Eso convierte la red en un objetivo fácil para ataques digitales como el bloqueo de señales, la suplantación de identidad o la eliminación silenciosa de mensajes. Las herramientas de seguridad existentes a menudo dependen de servidores centralizados lentos o de algoritmos opacos de “caja negra”, lo cual resulta arriesgado cuando están en juego vidas, bienes o infraestructuras críticas.

Enseñar a cada drone a aprender y decidir

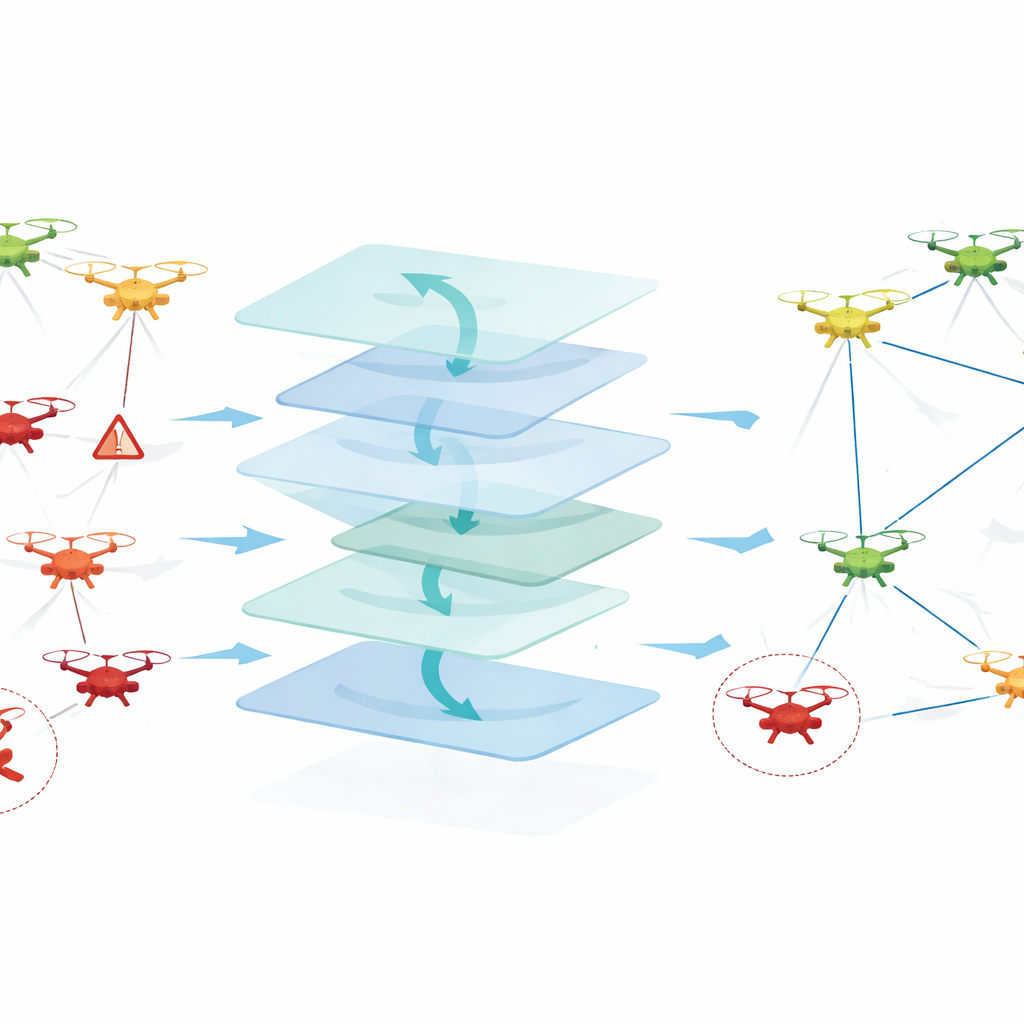

Los autores proponen un marco explicable de aprendizaje por refuerzo multiagente —EMARL‑XAI— que transforma a cada drone en un agente que aprende. En lugar de seguir reglas fijas, cada drone observa su posición, la calidad de la señal, el nivel de batería y cuán confiables parecen sus vecinos. Usando un método de aprendizaje cooperativo, el enjambre descubre gradualmente qué rutas de comunicación entregan mensajes con fiabilidad, evitan drones sospechosos y conservan energía. Decisiones como “¿quién debe reenviar este paquete a continuación?” emergen de la experiencia en lugar de estar codificadas rígidamente. De forma crucial, no existe un nodo maestro único: los drones aprenden y actúan de manera descentralizada, lo que se adapta mejor a cielos cambiantes y hostiles.

Detectar actores maliciosos y mantenerse conectados

La seguridad está tejida directamente en la forma en que el enjambre aprende. Cada drone mantiene una “estimación de confianza” continua de los drones cercanos, basada en si reenvían mensajes, se comportan de forma coherente o muestran señales de ataque, como descartar la mayoría de los paquetes o actuar como muchas identidades falsas a la vez. Estas puntuaciones de confianza influyen en las decisiones futuras: los vecinos fiables son preferidos como relés, mientras que los sospechosos se evitan gradualmente y quedan efectivamente aislados. El marco se prueba frente a una variedad de amenazas realistas —interferencias (jamming), suplantación de identidad, ataques Sybil y agujeros negros— dentro de una simulación detallada que acopla un simulador de red (para enlaces de radio e interferencias) con un simulador de vuelo de drones (para el movimiento en espacio 2D y 3D).

Hacer comprensibles las decisiones de los drones

Más allá del rendimiento bruto, el sistema está diseñado para explicarse a sí mismo. El módulo de explicabilidad utiliza herramientas reconocidas de la IA moderna para mostrar qué factores influyeron más en una decisión. Por ejemplo, un método llamado SHAP ordena entradas como la confianza o la intensidad de la señal según su impacto en una ruta elegida, mientras que otro, LIME, construye modelos locales simples de “qué pasaría si” alrededor de decisiones específicas. Mapas de atención visual resaltan qué patrones en comportamientos recientes focalizó el sistema de aprendizaje. En conjunto, estas vistas permiten a los operadores humanos ver, por ejemplo, que un drone evitó a cierto vecino principalmente porque su comportamiento de reenvío pasado parecía sospechoso, y no por una caída momentánea de la señal. Esto convierte un entramado de cálculos de redes neuronales en una historia trazable.

Cómo rinde el nuevo enfoque en cielos virtuales

Los investigadores comparan EMARL‑XAI con métodos de enrutamiento clásicos y con sistemas basados en aprendizaje más convencionales. En misiones simuladas con hasta 75 drones y hasta un 30% de ellos comportándose de forma maliciosa, el nuevo marco entrega una mayor proporción de paquetes, reduce retrasos y mantiene relativamente baja la tasa de acusaciones erróneas contra drones honestos. También aprende estrategias estables más rápido que un sistema multiagente similar sin confianza ni explicaciones, y utiliza menos energía por entrega exitosa que los esquemas tradicionales. Cuando los autores eliminan sistemáticamente partes del diseño, el rendimiento cae: suprimir la confianza aumenta bruscamente los errores sobre quién es malicioso, mientras que quitar las herramientas de explicabilidad deja la precisión mayormente intacta pero hace que la confianza de los evaluadores humanos se desplome.

Qué significa esto para misiones reales de drones

Para un lector no especialista, la idea principal es que este trabajo acerca los enjambres de drones a ser compañeros de confianza en lugar de dispositivos misteriosos y frágiles. EMARL‑XAI muestra cómo los drones pueden aprender por sí mismos a enrutar mensajes de forma segura a través de un entorno cambiante y hostil, dejando además un rastro claro y legible que explique por qué actuaron como lo hicieron. Aunque el estudio se basa en simulaciones y aún debe probarse en hardware real, esboza un camino hacia flotas de drones que no solo sean más inteligentes y seguras, sino también responsables: un paso esencial si esperamos que ayuden a gestionar desastres, monitorizar ciudades o proteger infraestructuras críticas.

Cita: Alkahtani, H.K., Galiya, Y., Akbayan, B. et al. Explainable multi agent reinforcement learning framework for secure and adaptive communication in UAV swarm based fanets. Sci Rep 16, 11830 (2026). https://doi.org/10.1038/s41598-026-39366-x

Palabras clave: enjambre de UAV, comunicación segura, aprendizaje por refuerzo multiagente, IA explicable, seguridad de redes inalámbricas