Clear Sky Science · it

Framework spiegabile di apprendimento per rinforzo multi-agente per comunicazioni sicure e adattive negli sciami di UAV basati su FANET

Squadre di droni più intelligenti per situazioni critiche

Immaginate una squadra di droni che si precipita in un incendio boschivo, in una zona allagata o in una missione di ricerca e soccorso. Devono condividere informazioni all’istante, evitare attaccanti che cercano di disturbare o ingannarli e, allo stesso tempo, spiegare agli operatori umani perché hanno scelto una rotta piuttosto che un’altra. Questo articolo presenta un nuovo modo per rendere tali sciami di droni sia più sicuri sia più comprensibili, così che le persone possano fidarsi di loro in situazioni di vita o di morte.

Perché gli sciami di droni hanno bisogno di più del semplice Wi‑Fi veloce

I droni in uno sciame non si limitano a volare; comunicano costantemente, trasmettendo mappe, letture dai sensori e allarmi l’uno all’altro. Questo tipo di rete aerea, chiamata flying ad hoc network, è veloce e flessibile ma anche fragile. I segnali viaggiano in aria aperta, i droni si muovono rapidamente e non esiste una torre centrale che controlli il tutto. Ciò rende la rete un bersaglio facile per attacchi digitali come il jamming, la falsificazione di identità o l’eliminazione silenziosa dei messaggi. Gli strumenti di sicurezza esistenti spesso dipendono da server centralizzati lenti o da algoritmi opachi a “scatola nera”, il che è rischioso quando sono in gioco vite umane, beni o infrastrutture critiche.

Insegnare a ogni drone a imparare e decidere

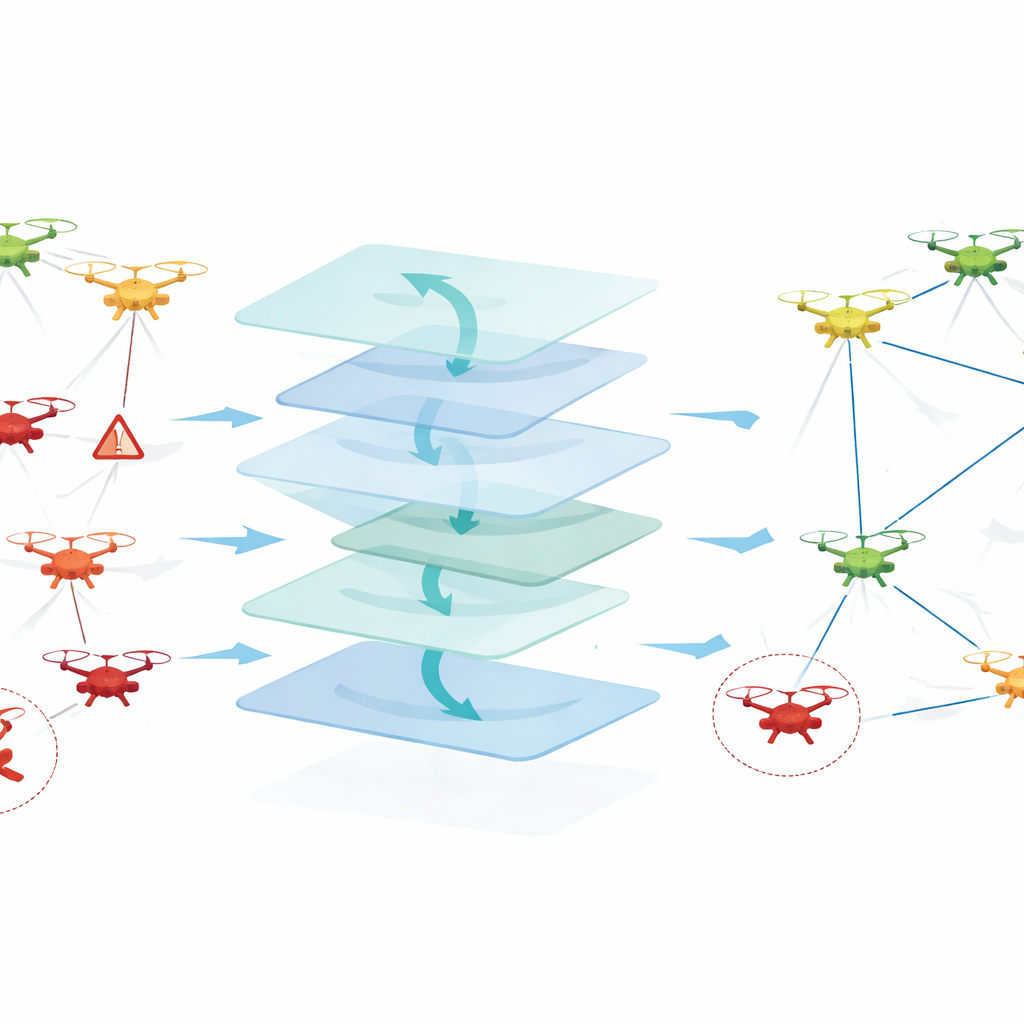

Gli autori propongono un framework spiegabile di apprendimento per rinforzo multi‑agente—EMARL‑XAI—che trasforma ogni drone in un agente che impara. Invece di seguire regole fisse, ogni drone osserva la propria posizione, la qualità del segnale, il livello della batteria e quanto i vicini sembrano affidabili. Utilizzando un metodo di apprendimento cooperativo, lo sciame scopre gradualmente quali percorsi di comunicazione recapitano i messaggi in modo affidabile, evitano droni sospetti e risparmiano energia. Decisioni come “chi dovrebbe inoltrare questo pacchetto dopo?” emergono dall’esperienza anziché essere codificate a priori. Fondamentale è l’assenza di un nodo master unico: i droni apprendono e agiscono in modo decentralizzato, più adatto a cieli ostili e in rapido cambiamento.

Individuare attori ostili e mantenere la connettività

La sicurezza è intrecciata direttamente nel modo in cui lo sciame apprende. Ogni drone mantiene una “stima di fiducia” aggiornata dei droni vicini, basata sul fatto che inoltrino i messaggi, si comportino in modo coerente o mostrino segnali di attacco, come l’eliminazione della maggior parte dei pacchetti o comportamenti da identità multiple false. Questi punteggi di fiducia influenzano le scelte future: i vicini affidabili sono favoriti come relay, mentre quelli sospetti vengono progressivamente aggirati e di fatto isolati. Il framework è testato contro una serie di minacce realistiche—jamming, spoofing di identità, attacchi Sybil e blackhole—all’interno di una simulazione dettagliata che accoppia un simulatore di rete (per collegamenti radio e interferenze) con un simulatore di volo per droni (per il movimento in spazio 2D e 3D).

Rendere comprensibili le scelte dei droni

Oltre alle prestazioni grezze, il sistema è progettato per spiegarsi. Il modulo di spiegabilità utilizza strumenti consolidati dell’IA moderna per mostrare quali fattori hanno influenzato maggiormente una decisione. Per esempio, un metodo chiamato SHAP classifica gli input come fiducia o intensità del segnale in base al loro impatto su una rotta scelta, mentre un altro, LIME, costruisce semplici modelli locali di “what‑if” intorno a decisioni specifiche. Mappe di attenzione visiva evidenziano quali pattern nel comportamento recente il sistema di apprendimento ha preso in considerazione. Queste viste combinate permettono agli operatori umani di vedere, ad esempio, che un drone ha evitato un certo vicino principalmente perché il suo comportamento passato nell’inoltrare pacchetti risultava sospetto, e non a causa di un calo momentaneo del segnale. Questo trasforma un groviglio di calcoli di reti neurali in una narrazione tracciabile.

Come si comporta il nuovo approccio nei cieli virtuali

I ricercatori confrontano EMARL‑XAI con metodi di instradamento classici e con sistemi di apprendimento più convenzionali. In missioni simulate con fino a 75 droni e con fino al 30% di essi comportarsi in modo malevolo, il nuovo framework consegna una quota maggiore di pacchetti, riduce i ritardi e mantiene relativamente bassa la percentuale di false accuse verso droni onesti. Impara inoltre strategie stabili più rapidamente rispetto a un sistema multi‑agente simile privo di fiducia o spiegabilità, e usa meno energia per consegna riuscita rispetto agli schemi tradizionali. Quando gli autori rimuovono sistematicamente parti del progetto, le prestazioni peggiorano: eliminare la fiducia aumenta drasticamente gli errori nel classificare chi è malevolo, mentre togliere gli strumenti di spiegabilità lascia in gran parte intatta l’accuratezza ma provoca un crollo della fiducia degli valutatori umani.

Cosa significa per le missioni di droni nel mondo reale

Per un non specialista, la conclusione principale è che questo lavoro avvicina gli sciami di droni al ruolo di compagni di squadra affidabili piuttosto che a dispositivi misteriosi e fragili. EMARL‑XAI mostra come i droni possano imparare autonomamente a instradare i messaggi in modo sicuro attraverso un ambiente ostile e mutevole, lasciando al contempo una traccia chiara e leggibile di perché hanno agito in un certo modo. Sebbene lo studio si basi su simulazioni e necessiti ancora di test su hardware reale, delinea una strada verso flotte di droni non solo più intelligenti e sicure, ma anche responsabili—un passo essenziale se ci aspettiamo che aiutino a gestire disastri, monitorare città o proteggere infrastrutture critiche.

Citazione: Alkahtani, H.K., Galiya, Y., Akbayan, B. et al. Explainable multi agent reinforcement learning framework for secure and adaptive communication in UAV swarm based fanets. Sci Rep 16, 11830 (2026). https://doi.org/10.1038/s41598-026-39366-x

Parole chiave: Sciame di UAV, comunicazione sicura, apprendimento per rinforzo multi-agente, IA spiegabile, sicurezza delle reti wireless