Clear Sky Science · de

Erklärbares Multi‑Agenten‑Reinforcement‑Learning‑Framework für sichere und adaptive Kommunikation in UAV‑Schwärmen basierenden FANETs

Intelligentere Drohnenteams für schwierige Einsätze

Stellen Sie sich ein Team von Drohnen vor, das in einen Waldbrand, eine Überflutungszone oder eine Such‑und‑Rettungsmission eilt. Sie müssen Informationen sofort teilen, Angreifern ausweichen, die versuchen, sie zu stören oder zu täuschen, und gleichzeitig den menschlichen Bedienern erklären können, warum sie eine Route einer anderen vorgezogen haben. Dieses Papier stellt einen neuen Ansatz vor, um solche Drohnenschwärme sowohl sicherer als auch verständlicher zu machen, damit man ihnen in lebenswichtigen Situationen vertrauen kann.

Warum Drohnenschwärme mehr brauchen als schnelles WLAN

Drohnen in einem Schwarm fliegen nicht nur; sie kommunizieren ständig und übermitteln Karten, Sensordaten und Warnungen untereinander. Dieses luftgestützte Netzwerk, genannt Flying Ad Hoc Network (FANET), ist schnell und flexibel, aber auch verwundbar. Signale reisen durch die freie Luft, Drohnen bewegen sich schnell, und es gibt keinen zentralen Turm, der alles steuert. Das macht das Netzwerk zu einem leichten Ziel für digitale Angriffe wie Störsender, Identitätsfälschung oder das stille Verwerfen von Nachrichten. Bestehende Sicherheitswerkzeuge sind oft auf langsame, zentralisierte Server oder undurchsichtige ‚Black‑Box‘‑Algorithmen angewiesen – riskant, wenn Menschenleben, Eigentum oder kritische Infrastruktur auf dem Spiel stehen.

Jeder Drohne beibringen zu lernen und zu entscheiden

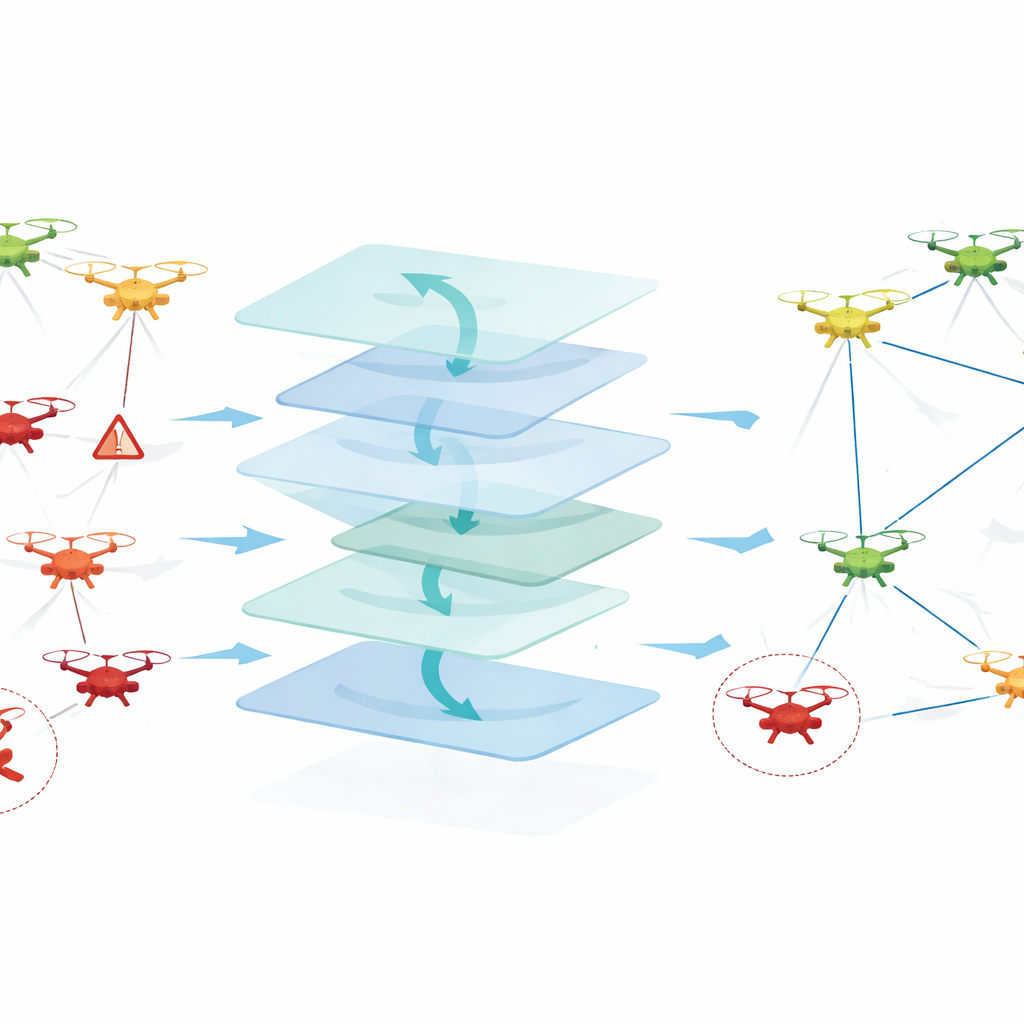

Die Autorinnen und Autoren schlagen ein erklärbares Multi‑Agenten‑Reinforcement‑Learning‑Framework—EMARL‑XAI—vor, das jede Drohne zu einem lernenden Agenten macht. Statt festen Regeln zu folgen, beobachtet jede Drohne ihre Position, Signalqualität, Akkustand und wie vertrauenswürdig die Nachbarn erscheinen. Mithilfe einer kooperativen Lernmethode entdeckt der Schwarm nach und nach, welche Kommunikationswege Nachrichten zuverlässig übertragen, welche Drohnen verdächtig sind und wie Energie gespart werden kann. Entscheidungen wie „Wer soll dieses Paket als Nächstes weiterleiten?“ entstehen aus Erfahrung statt aus starrer Codierung. Wichtig ist: Es gibt keinen einzelnen Master‑Knoten; die Drohnen lernen und handeln dezentral, was besser zu schnell wechselnden, feindlichen Lagen passt.

Schädliche Akteure erkennen und verbunden bleiben

Sicherheit ist direkt in den Lernprozess des Schwarms eingebettet. Jede Drohne führt eine laufende „Vertrauenswert‑Schätzung“ der benachbarten Drohnen, basierend darauf, ob sie Nachrichten weiterleiten, sich konsistent verhalten oder Anzeichen eines Angriffs zeigen—etwa das Verwerfen vieler Pakete oder das Auftreten vieler gefälschter Identitäten gleichzeitig. Diese Vertrauenswerte beeinflussen künftige Entscheidungen: Zuverlässige Nachbarn werden als Relais bevorzugt, während Verdächtige nach und nach umgangen und effektiv isoliert werden. Das Framework wird gegen eine Reihe realistischer Bedrohungen getestet—Stören (Jamming), Identitätsspoofing, Sybil‑Angriffe und Blackholes—innerhalb einer detaillierten Simulation, die einen Netzwerksimulator (für Funkverbindungen und Interferenzen) mit einem Flug‑Simulator für Drohnen (Bewegung in 2D und 3D) koppelt.

Die Entscheidungen der Drohnen verständlich machen

Über die reine Leistung hinaus ist das System so konzipiert, dass es sich selbst erklären kann. Das Erklärbarkeitsmodul nutzt bekannte Werkzeuge aus der modernen KI, um zu zeigen, welche Faktoren eine Entscheidung am stärksten beeinflusst haben. Beispielsweise ordnet eine Methode namens SHAP Eingaben wie Vertrauen oder Signalstärke nach ihrem Einfluss auf eine gewählte Route, während eine andere, LIME, einfache lokale „Was‑wäre‑wenn“‑Modelle um konkrete Entscheidungen herum aufbaut. Visuelle Aufmerksamkeitskarten heben Muster im jüngsten Verhalten hervor, auf die das Lernsystem geachtet hat. Zusammengenommen ermöglichen diese Darstellungen menschlichen Bedienern zu sehen, dass eine Drohne einen bestimmten Nachbarn hauptsächlich mied, weil dessen vergangenes Weiterleitungsverhalten verdächtig wirkte und nicht wegen eines kurzzeitigen Einbruchs der Signalstärke. So verwandelt sich ein Geflecht neuronaler Netzberechnungen in eine nachvollziehbare Geschichte.

Wie sich der neue Ansatz in virtuellen Lufträumen schlägt

Die Forschenden stellen EMARL‑XAI klassischen Routing‑Methoden und konventionelleren lernbasierten Systemen gegenüber. In simulierten Einsätzen mit bis zu 75 Drohnen und bis zu 30 % davon mit böswilligem Verhalten liefert das neue Framework einen höheren Anteil zugestellter Pakete, verringert Verzögerungen und hält die Rate falsch beschuldigter ehrlicher Drohnen vergleichsweise niedrig. Es lernt außerdem stabilere Strategien schneller als ein ähnliches Multi‑Agenten‑Lernsystem ohne Vertrauen oder Erklärbarkeit und verbraucht pro erfolgreicher Lieferung weniger Energie als traditionelle Schemata. Entfernt man systematisch Teile des Designs, sinkt die Leistung: Ohne Vertrauensmechanismus steigen Fehler bei der Einschätzung, wer böswillig ist, stark an, während das Entfernen der Erklärwerkzeuge die Genauigkeit größtenteils unberührt lässt, aber das Vertrauen menschlicher Bewerter stark fallen lässt.

Was das für reale Drohneneinsätze bedeutet

Für Nicht‑Fachleute ist die wichtigste Erkenntnis, dass diese Arbeit Drohnenschwärme eher zu vertrauenswürdigen Teammitgliedern macht statt zu mysteriösen, fragilen Geräten. EMARL‑XAI zeigt, wie Drohnen eigenständig lernen können, Nachrichten sicher durch eine sich verändernde, feindliche Umgebung zu routen, und dabei zugleich eine klare, für Menschen lesbare Spur hinterlassen, warum sie so gehandelt haben. Obwohl die Studie auf Simulationen basiert und noch auf echter Hardware getestet werden muss, skizziert sie einen Weg zu Drohnenflotten, die nicht nur klüger und sicherer, sondern auch rechenschaftspflichtig sind—ein wesentlicher Schritt, wenn sie bei Katastrophenmanagement, Stadtüberwachung oder dem Schutz kritischer Infrastruktur helfen sollen.

Zitation: Alkahtani, H.K., Galiya, Y., Akbayan, B. et al. Explainable multi agent reinforcement learning framework for secure and adaptive communication in UAV swarm based fanets. Sci Rep 16, 11830 (2026). https://doi.org/10.1038/s41598-026-39366-x

Schlüsselwörter: UAV‑Schwarm, sichere Kommunikation, Multi‑Agenten Reinforcement Learning, erklärbare KI, Drahtlosnetzwerk‑Sicherheit