Clear Sky Science · fr

Cadre explicable d’apprentissage par renforcement multi‑agent pour une communication sécurisée et adaptative dans un essaim d’UAV pour FANETs

Des équipes de drones plus intelligentes pour des situations difficiles

Imaginez une équipe de drones intervenant dans un incendie de forêt, une zone inondée ou lors d’une mission de recherche et de sauvetage. Ils doivent partager des informations instantanément, éviter des attaquants qui tentent de brouiller ou de tromper leurs communications, et en même temps expliquer aux opérateurs humains pourquoi ils ont choisi telle trajectoire plutôt qu’une autre. Cet article présente une nouvelle méthode pour rendre ces essaims de drones à la fois plus sûrs et plus compréhensibles, afin que l’on puisse leur faire confiance dans des situations de vie ou de mort.

Pourquoi les essaims de drones ont besoin de plus que du Wi‑Fi rapide

Les drones d’un essaim ne font pas que voler ; ils communiquent en continu, relayant cartes, relevés de capteurs et alertes les uns aux autres. Ce type de réseau aéroporté, appelé réseau ad hoc volant (FANET), est rapide et flexible mais aussi fragile. Les signaux voyagent dans l’air libre, les drones se déplacent rapidement et il n’y a pas de tour centrale de contrôle. Cela rend le réseau une cible facile pour des attaques numériques telles que le brouillage des signaux, l’usurpation d’identité ou l’élimination silencieuse de messages. Les outils de sécurité existants reposent souvent sur des serveurs centralisés lents ou des algorithmes opaques (« boîte noire »), ce qui est risqué lorsque des vies, des biens ou des infrastructures critiques sont en jeu.

Apprendre et décider pour chaque drone

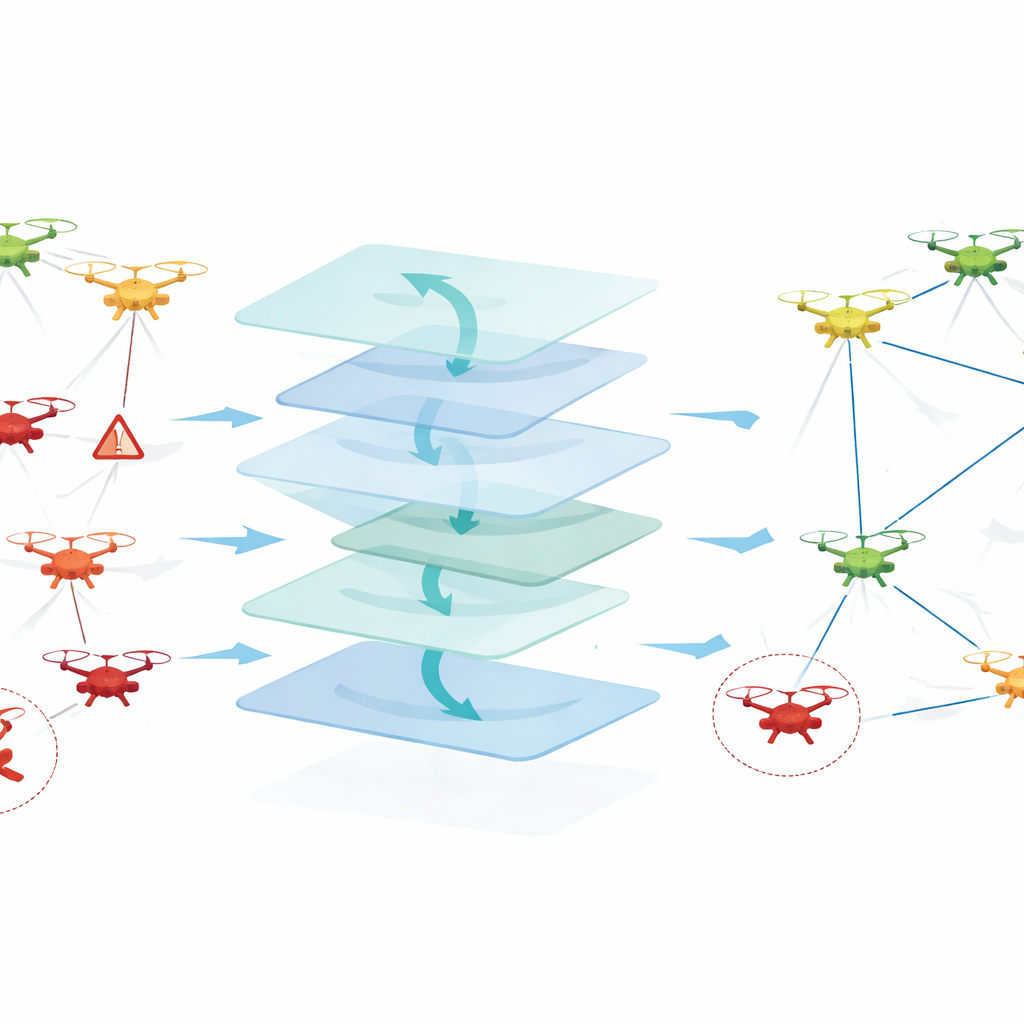

Les auteurs proposent un cadre explicable d’apprentissage par renforcement multi‑agent — EMARL‑XAI — qui transforme chaque drone en agent apprenant. Plutôt que d’appliquer des règles fixes, chaque drone observe sa position, la qualité du signal, le niveau de batterie et la fiabilité apparente de ses voisins. En utilisant une méthode d’apprentissage coopératif, l’essaim découvre progressivement quels chemins de communication livrent les messages de manière fiable, évitent les drones suspects et économisent l’énergie. Des décisions comme « qui doit relayer ce paquet ensuite ? » émergent de l’expérience plutôt que d’être codées en dur. Surtout, il n’y a pas de nœud maître unique : les drones apprennent et agissent de façon décentralisée, ce qui convient mieux à des cieux rapides et hostiles.

Repérer les acteurs malveillants et rester connecté

La sécurité est intégrée directement dans la façon dont l’essaim apprend. Chaque drone maintient une « estimation de confiance » continue des drones proches, fondée sur leur comportement de relais, leur cohérence ou des signes d’attaque, comme la suppression de la plupart des paquets ou l’apparition de nombreuses identités factices simultanément. Ces scores de confiance influencent les choix futurs : les voisins fiables sont favorisés comme relais, tandis que les éléments suspects sont progressivement contournés et effectivement isolés. Le cadre est testé contre une gamme de menaces réalistes — brouillage, usurpation d’identité, attaques Sybil et trous noirs — au sein d’une simulation détaillée qui couple un simulateur de réseau (pour les liaisons radio et les interférences) avec un simulateur de vol de drones (pour les déplacements en 2D et 3D).

Rendre compréhensibles les choix des drones

Au‑delà des performances brutes, le système est conçu pour s’expliquer. Le module d’explicabilité utilise des outils bien établis de l’IA moderne pour montrer quels facteurs ont le plus influencé une décision. Par exemple, une méthode appelée SHAP classe des entrées telles que la confiance ou la puissance du signal selon leur impact sur un itinéraire choisi, tandis qu’une autre, LIME, construit de simples modèles locaux de type « et si » autour de décisions spécifiques. Des cartes d’attention visuelle mettent en évidence les motifs de comportement récent sur lesquels le système d’apprentissage s’est focalisé. Ensemble, ces vues permettent aux opérateurs humains de voir, par exemple, qu’un drone a évité un certain voisin principalement parce que son comportement passé de relais paraissait suspect, et non à cause d’une baisse momentanée de la qualité du signal. Cela transforme un enchevêtrement de calculs de réseaux neuronaux en une histoire traçable.

Performance de la nouvelle approche dans des cieux virtuels

Les chercheurs confrontent EMARL‑XAI à des méthodes de routage classiques et à des systèmes d’apprentissage plus conventionnels. Dans des missions simulées avec jusqu’à 75 drones et jusqu’à 30 % d’entre eux se comportant de manière malveillante, le nouveau cadre fournit une part plus élevée de paquets livrés, réduit les délais et maintient un taux d’accusation erronée des drones honnêtes relativement bas. Il apprend aussi des stratégies stables plus rapidement qu’un système multi‑agent similaire dépourvu de confiance ou d’outils d’explicabilité, et consomme moins d’énergie par livraison réussie que les schémas traditionnels. Lorsque les auteurs suppriment systématiquement des parties du dispositif, les performances chutent : retirer la confiance augmente fortement les erreurs d’identification des malveillants, tandis que supprimer les outils d’explicabilité laisse l’exactitude globalement intacte mais fait chuter la confiance des évaluateurs humains.

Ce que cela signifie pour les missions réelles de drones

Pour un non‑spécialiste, l’essentiel est que ce travail rapproche les essaims de drones du statut de coéquipiers dignes de confiance, plutôt que d’appareils mystérieux et fragiles. EMARL‑XAI montre comment des drones peuvent apprendre par eux‑mêmes à acheminer des messages en toute sécurité dans un environnement mouvant et hostile, tout en laissant une trace claire et lisible expliquant leurs actions. Bien que l’étude repose sur des simulations et doive encore être testée sur du matériel réel, elle trace une voie vers des flottes de drones non seulement plus intelligentes et plus sûres, mais aussi responsables — une étape essentielle si l’on attend d’elles qu’elles aident à gérer des catastrophes, surveiller des villes ou protéger des infrastructures critiques.

Citation: Alkahtani, H.K., Galiya, Y., Akbayan, B. et al. Explainable multi agent reinforcement learning framework for secure and adaptive communication in UAV swarm based fanets. Sci Rep 16, 11830 (2026). https://doi.org/10.1038/s41598-026-39366-x

Mots-clés: Essaim d’UAV, communication sécurisée, apprentissage par renforcement multi‑agent, IA explicable, sécurité des réseaux sans fil