Clear Sky Science · nl

GPT-4o voor geautomatiseerde bepaling van vervolgonderzoeken op basis van radiologierapporten uit de klinische routine

Waarom slimere follow-upscans ertoe doen

Wanneer een patiënt een CT- of MRI-scan krijgt, eindigt het verhaal niet bij de beelden. Radiologen moeten ook bepalen of en wanneer vervolgscans nodig zijn om tumoren te volgen, verdachte plekken te controleren of te bevestigen dat een behandeling werkt. Deze keuzes kunnen het verschil betekenen tussen het vroegtijdig opsporen van ziekte en het blootstellen van patiënten aan onnodige straling, kosten en onrust. Deze studie stelde een actuele vraag: kan een moderne kunstmatige-intelligentiesystemen, GPT-4o, helpen deze follow-upbeslissingen te standaardiseren zodat patiënten consistente, richtlijngebaseerde zorg krijgen?

Het probleem van tegenstrijdige adviezen

Vakverenigingen publiceren gedetailleerde aanbevelingen over wanneer en hoe beeldvorming herhaald moet worden voor veel vormen van kanker en bij incidentele bevindingen. In de dagelijkse praktijk zijn radiologen het echter vaak oneens over follow-up. Sommige artsen bestellen snel herhalingsscans; anderen zijn voorzichtiger. Eerder onderzoek heeft aangetoond dat de kans dat verdere beeldvorming wordt aanbevolen bijna zeven keer kan verschillen tussen radiologen die naar vergelijkbare gevallen kijken. Veel voorgestelde plannen komen niet volledig overeen met gepubliceerde richtlijnen, waardoor sommige patiënten meer scans ondergaan dan nodig is, terwijl anderen tijdige controles missen. Dit ongelijkmatige beeld stimuleert de ontwikkeling van instrumenten die de praktijk voorzichtig in de richting van meer consistente, op bewijs gebaseerde beslissingen kunnen sturen.

Opzet van de studie

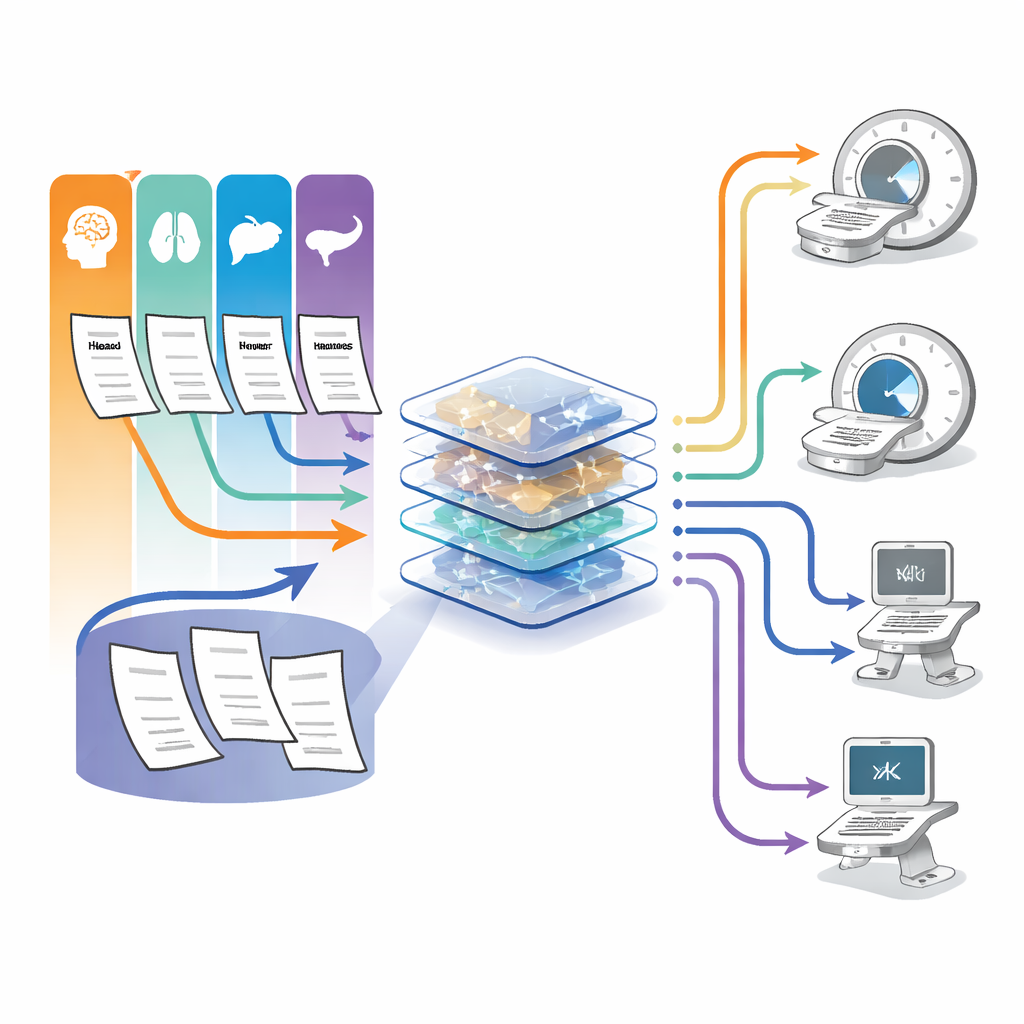

De onderzoekers testten GPT-4o, een groot taalmodel dat is ontworpen om tekst te begrijpen en te genereren, op 100 echte radiologiegevallen uit twee Duitse ziekenhuizen. Alle gevallen betroffen volwassenen die CT- of MRI-onderzoek ondergingen voor kankergerelateerde vragen in vier belangrijke regio’s: hoofd-hals, lever, long en alvleesklier. Voor elk geval kreeg het model het volledige schriftelijke rapport, inclusief medische voorgeschiedenis, bevindingen van de scan en de conclusie van de radioloog. GPT-4o kreeg één opdracht: op basis van deze informatie het exacte vervolgbeeldvormingsonderzoek (zoals CT of MRI) en de timing van de volgende scan voorstellen. Voor elk geval beantwoordden een radiologiearts in opleiding en een ervaren geregistreerd radioloog dezelfde vraag.

De kwaliteit meten aan de hand van richtlijnen

Om die aanbevelingen te beoordelen vergeleken twee senior-radiologen, die niet wisten van wie de suggesties afkomstig waren, alle antwoorden met de belangrijkste internationale richtlijnen van kanker- en radiologieverenigingen. Ze beoordeelden elk voorstel op vier punten: of alle relevante bevindingen die follow-up vereisten werden gedekt, of de gekozen beeldvormingstechniek passend was, hoe nauwkeurig de voorgestelde timing was, en een algemene kwaliteitscore op een schaal van vijf punten. In wezen vroegen de experts zich af: houdt dit plan de patiënt veilig, volgt het de regels en voorkomt het onnodige scans?

Hoe de AI het deed ten opzichte van mensen

Over alle 100 gevallen scoorde GPT-4o in algemene follow-upkwaliteit gelijk aan de ervaren radioloog en beter dan de arts in opleiding. De mediane globale kwaliteitscore van het model was 4 van de 5, nagenoeg hetzelfde als de expert en duidelijk beter dan de trainee. GPT-4o had de timing volledig of deels correct in 96% van de gevallen, beter dan de arts in opleiding (75%) en iets beter dan de expert (90%). Het produceerde ook de minste potentieel schadelijke timingfouten. Het model dekte alle bevindingen die follow-up nodig hadden in 92% van de gevallen, vergelijkbaar met de arts in opleiding en in deze specifieke maat maat duidelijk beter dan de expert. Bij de keuze van het juiste type scan presteerde GPT-4o bijna gelijk aan beide menselijke beoordelaars. De sterkste prestaties waren bij long-, lever- en alvleesklierbeeldvorming, waar richtlijntrajecten bijzonder goed gestandaardiseerd zijn; de prestaties waren iets lager, voor alle beoordelaars, in het complexere hoofd-halsgebied.

Wat dit kan betekenen voor toekomstige zorg

De studie suggereert dat GPT-4o kan fungeren als een betrouwbare assistent voor beslissingen over vervolgbeeldvorming, op ongeveer het niveau van een ervaren radioloog en beter dan een opleider op veel terreinen. Gebruikt als een hulpmiddel voor besluitvorming en niet als vervanging, kan zo’n systeem helpen onnodige scans te verminderen, vertragingen in essentiële follow-up te verkorten en de werkdruk in drukbezette radiologieafdelingen te verlichten, terwijl de praktijk dichter bij vastgestelde richtlijnen blijft. De auteurs benadrukken echter dat menselijke experts de leiding moeten houden: het model kan nog steeds rapporten verkeerd interpreteren, de interne werking is ondoorzichtig, en de studie omvatte slechts 100 kankergerelateerde gevallen uit twee centra. Grotere, prospectieve onderzoeken en veilige, lokaal gehoste implementaties zullen nodig zijn voordat dergelijke hulpmiddelen veilig in de dagelijkse klinische workflows kunnen worden geïntegreerd.

Bronvermelding: Kaya, K., Müller, L., Persigehl, T. et al. GPT-4o for Automated Determination of Follow-up Examinations Based on Radiology Reports from Clinical Routine. Sci Rep 16, 12587 (2026). https://doi.org/10.1038/s41598-026-40317-9

Trefwoorden: radiologische follow-up, grote taalmodellen, medische besluitvorming ondersteuning, oncologische beeldvorming, GPT-4o