Clear Sky Science · de

GPT-4o zur automatisierten Bestimmung von Nachuntersuchungen basierend auf Radiologieberichten aus der klinischen Routine

Warum intelligentere Nachuntersuchungen wichtig sind

Wenn ein Patient eine CT- oder MRT-Untersuchung erhält, endet die Geschichte nicht mit den Bildern. Radiologen müssen auch entscheiden, ob und wann Folgeuntersuchungen nötig sind, um Tumore zu überwachen, verdächtige Befunde zu kontrollieren oder zu bestätigen, dass eine Behandlung wirkt. Diese Entscheidungen können den Unterschied ausmachen zwischen dem frühzeitigen Erkennen einer Erkrankung und der unnötigen Belastung von Patienten durch Strahlenexposition, Kosten und Ängste. Die Studie stellte eine aktuelle Frage: Kann ein modernes KI-System, GPT-4o, helfen, diese Nachuntersuchungsentscheidungen zu standardisieren, sodass Patientinnen und Patienten eine einheitliche, richtlinienbasierte Versorgung erhalten?

Das Problem widersprüchlicher Empfehlungen

Fachgesellschaften veröffentlichen detaillierte Empfehlungen dazu, wann und wie Bildgebung bei vielen Krebserkrankungen und Zufallsbefunden wiederholt werden sollte. Im Alltag jedoch stimmen Radiologen häufig nicht überein. Einige veranlassen schnell eine Wiederholungsuntersuchung; andere sind zurückhaltender. Frühere Untersuchungen zeigten, dass die Wahrscheinlichkeit, weitere Bildgebung zu empfehlen, bei ähnlichen Fällen zwischen Radiologen nahezu siebenfach variieren kann. Viele vorgeschlagene Pläne stimmen nicht vollständig mit den veröffentlichten Leitlinien überein, wodurch einige Patienten mehr Untersuchungen erhalten als nötig, während andere rechtzeitige Kontrollen verpassen. Dieses uneinheitliche Bild motiviert die Entwicklung von Werkzeugen, die die Praxis sanft in Richtung konsistenter, evidenzbasierter Entscheidungen lenken können.

Wie die Studie aufgebaut war

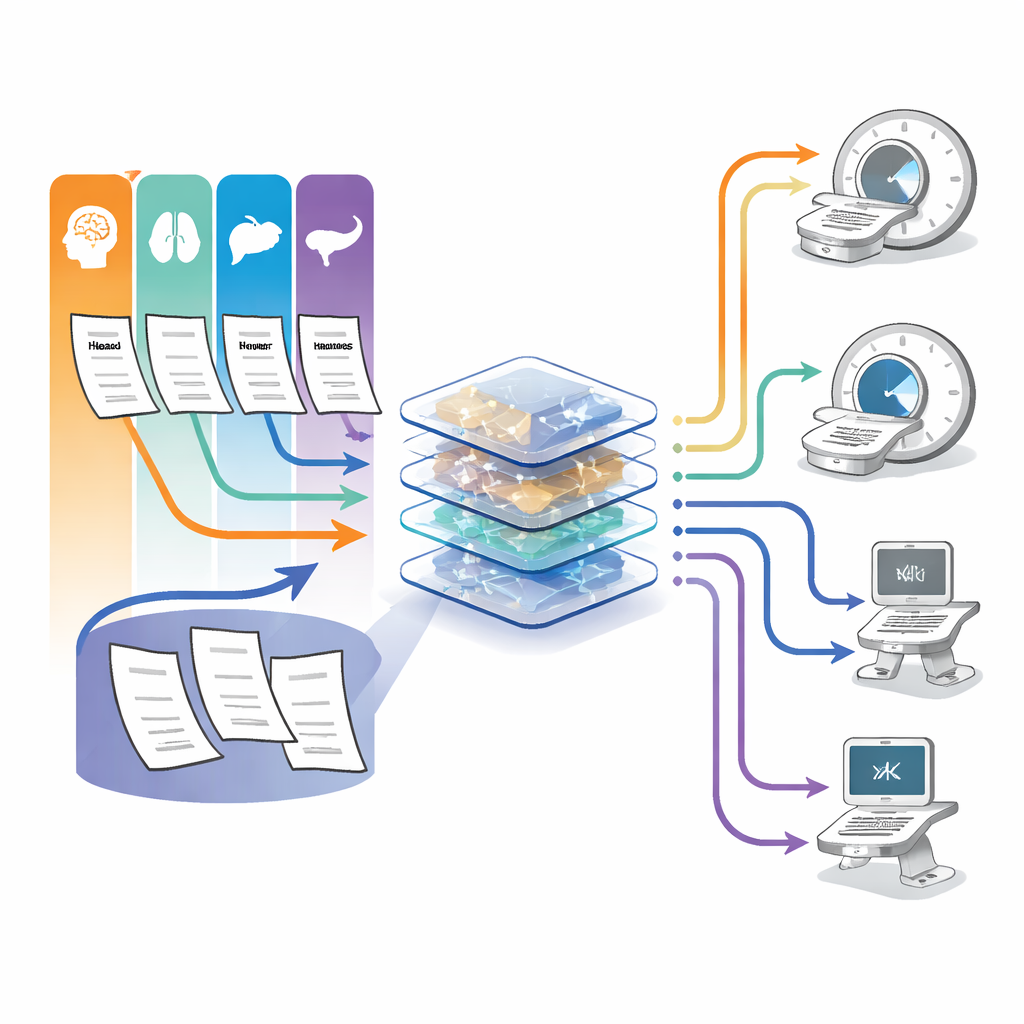

Die Forschenden testeten GPT-4o, ein großes Sprachmodell zum Verstehen und Erzeugen von Text, an 100 realen Radiologiefällen aus zwei deutschen Krankenhäusern. Alle Fälle betrafen erwachsene Patientinnen und Patienten, die CT- oder MRT-Untersuchungen wegen krebsbezogener Fragestellungen in vier zentralen Regionen erhielten: Kopf-Hals, Leber, Lunge und Pankreas. Für jeden Fall erhielt das Modell den vollständigen schriftlichen Befund, einschließlich Anamnese, Befunden und der Schlussfolgerung des Radiologen. GPT-4o hatte eine Aufgabe: Auf Basis dieser Informationen die genaue Follow-up-Bildgebung (z. B. CT oder MRT) und das Timing der nächsten Untersuchung vorzuschlagen. Ein Radiologieassistent und ein erfahrener, fachärztlich zertifizierter Radiologe beantworteten dieselbe Frage für jeden Fall.

Qualitätsmessung anhand von Leitlinien

Um diese Empfehlungen zu bewerten, verglichen zwei leitende Radiologen, die nicht wussten, von wem die Vorschläge stammten, alle Antworten mit wichtigen internationalen Leitlinien von Krebs- und Radiologiegesellschaften. Sie bewerteten jeden Vorschlag in vier Bereichen: ob alle relevanten Befunde, die eine Nachuntersuchung erforderten, abgedeckt waren, ob die gewählte Bildgebungsmodalität angemessen war, wie genau das vorgeschlagene Timing war und eine Gesamtbewertung auf einer fünfstufigen Skala. Effektiv fragten die Expertinnen und Experten: Hält dieser Plan die Patientensicherheit aufrecht, befolgt er die Regeln und vermeidet er unnötige Untersuchungen?

Wie sich die KI im Vergleich zu Menschen schlug

Über alle 100 Fälle hinweg erreichte GPT-4o eine Gesamtqualität der Follow-up-Empfehlungen, die mit der des erfahrenen Radiologen vergleichbar war und den Assistenzarzt übertraf. Der mediane globale Qualitätswert des Modells lag bei 4 von 5, praktisch identisch mit dem Experten und signifikant besser als beim Assistenzarzt. GPT-4o lag in 96 % der Fälle beim Timing ganz oder teilweise richtig und übertraf damit den Assistenzarzt (75 %) sowie leicht den Experten (90 %). Es produzierte zudem die wenigsten potenziell schädlichen Timingfehler. Das Modell berücksichtigte alle Befunde, die eine Nachuntersuchung benötigten, in 92 % der Fälle, ähnlich dem Assistenzarzt und in dieser speziellen Messgröße deutlich besser als der Experte. Bei der Wahl des richtigen Untersuchungsverfahrens war GPT-4o nahezu gleichauf mit beiden menschlichen Lesern. Stärkere Leistungen zeigte das Modell insbesondere bei Lungen-, Leber- und Pankreasbildgebung, wo Leitlinienwege besonders gut standardisiert sind; die Leistung war für alle Leser in der komplexeren Kopf-Hals-Region etwas geringer.

Was das für die künftige Versorgung bedeuten könnte

Die Studie legt nahe, dass GPT-4o als verlässlicher Assistent für Entscheidungen zur Nachuntersuchungsbildgebung fungieren kann, in etwa auf dem Niveau eines erfahrenen Radiologen und in vielerlei Hinsicht besser als ein Assistenzarzt. Als Entscheidungsunterstützungswerkzeug statt als Ersatz eingesetzt, könnte ein solches System dazu beitragen, unnötige Untersuchungen zu reduzieren, Verzögerungen bei wichtigen Follow-ups zu verringern und die Arbeitsbelastung in überlasteten Radiologieabteilungen zu mindern, während die Praxis näher an etablierten Leitlinien bleibt. Die Autorinnen und Autoren betonen jedoch, dass menschliche Expertinnen und Experten die Verantwortung behalten müssen: Das Modell kann weiterhin Befunde falsch interpretieren, seine inneren Entscheidungswege sind undurchsichtig, und die Studie umfasste nur 100 krebsspezifische Fälle aus zwei Zentren. Größere, prospektive Studien und sichere, lokal gehostete Implementierungen werden nötig sein, bevor solche Werkzeuge sicher in den klinischen Alltag integriert werden können.

Zitation: Kaya, K., Müller, L., Persigehl, T. et al. GPT-4o for Automated Determination of Follow-up Examinations Based on Radiology Reports from Clinical Routine. Sci Rep 16, 12587 (2026). https://doi.org/10.1038/s41598-026-40317-9

Schlüsselwörter: Radiologie Nachsorge, große Sprachmodelle, medizinische Entscheidungsunterstützung, onkologische Bildgebung, GPT-4o