Clear Sky Science · fr

GPT-4o pour la détermination automatisée des examens de suivi à partir des comptes rendus de radiologie de la pratique clinique

Pourquoi des examens de suivi plus intelligents comptent

Lorsqu’un patient passe un scanner ou une IRM, l’histoire ne s’arrête pas aux images. Les radiologues doivent aussi décider si et quand des examens de suivi sont nécessaires pour suivre des tumeurs, contrôler des foyers suspects ou confirmer l’efficacité d’un traitement. Ces choix peuvent faire la différence entre détecter une maladie tôt et exposer les patients à des radiations, des coûts et de l’anxiété inutiles. Cette étude pose une question d’actualité : un système d’intelligence artificielle moderne, GPT-4o, peut‑il aider à standardiser ces décisions de suivi afin que les patients reçoivent des soins cohérents et conformes aux recommandations ?

Le problème des messages contradictoires

Les sociétés professionnelles publient des recommandations détaillées sur le moment et la manière de répéter les examens pour de nombreux cancers et découvertes fortuites. Pourtant, dans la pratique quotidienne, les radiologues sont souvent en désaccord sur le suivi. Certains prescrivent rapidement des examens répétés ; d’autres sont plus prudents. Des travaux antérieurs ont montré que la probabilité de recommander des examens complémentaires peut varier d’un facteur proche de sept entre radiologues confrontés à des cas similaires. De nombreux plans proposés ne correspondent pas pleinement aux recommandations publiées, entraînant certaines personnes vers des examens excessifs tandis que d’autres peuvent manquer des contrôles opportuns. Ce paysage inégal motive le développement d’outils pouvant orienter délicatement la pratique vers des décisions plus constantes et fondées sur les preuves.

Comment l’étude a été organisée

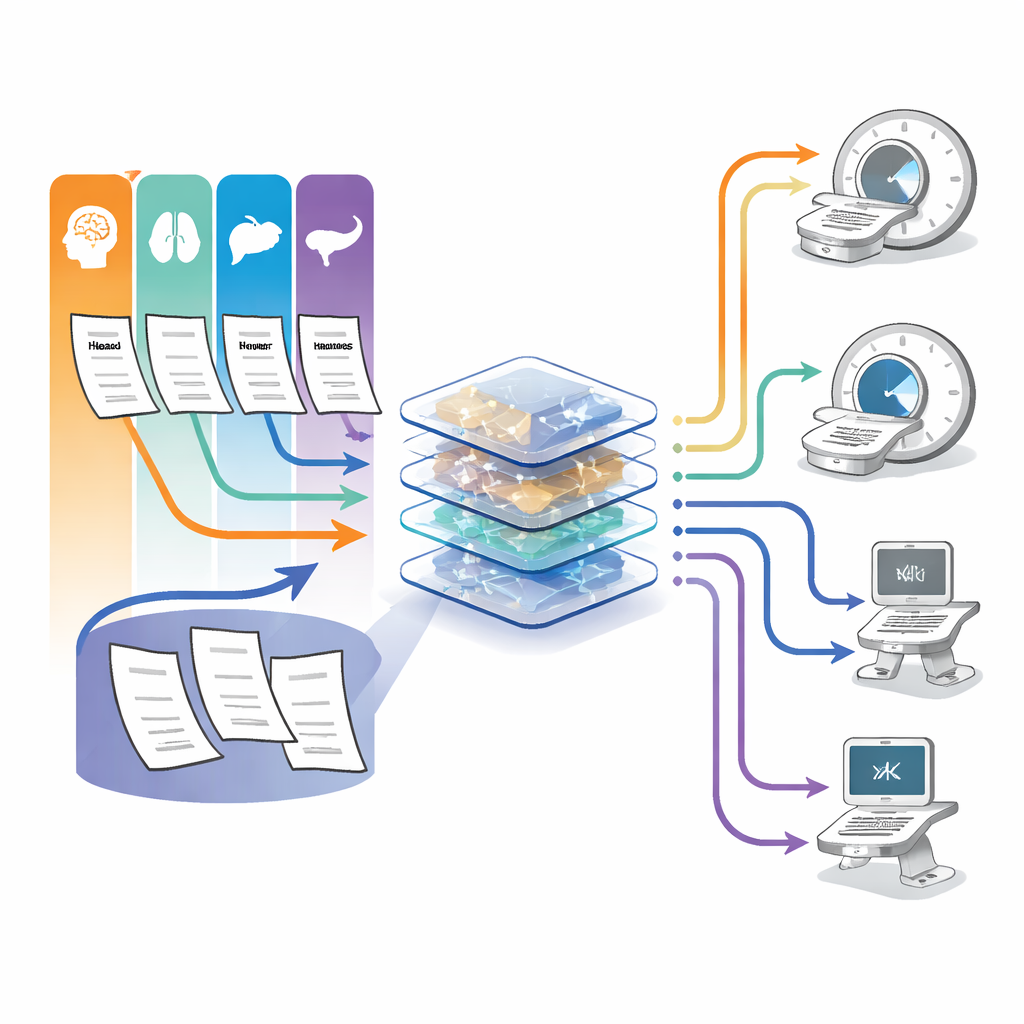

Les chercheurs ont testé GPT-4o, un grand modèle de langage conçu pour comprendre et générer du texte, sur 100 cas réels de radiologie issus de deux hôpitaux allemands. Tous les cas concernaient des adultes ayant subi un scanner ou une IRM pour des questions liées au cancer dans quatre régions clés : tête et cou, foie, poumon et pancréas. Pour chaque cas, le modèle a reçu le rapport écrit complet, incluant l’anamnèse, les constatations de l’examen et la conclusion du radiologue. GPT-4o a reçu une mission unique : proposer, à partir de ces informations, la méthode d’imagerie de suivi exacte (par exemple scanner ou IRM) et le délai du prochain examen. Un médecin radiologue en formation et un radiologue expérimenté, diplômé et certifié, ont répondu à la même question pour chaque cas.

Évaluer la qualité par rapport aux recommandations

Pour juger ces recommandations, deux radiologues seniors, qui ignoraient l’origine des propositions, ont comparé toutes les réponses aux principales directives internationales émanant de sociétés en oncologie et en radiologie. Ils ont noté chaque proposition selon quatre axes : si toutes les constatations pertinentes nécessitant un suivi étaient couvertes, si la technique d’imagerie choisie était appropriée, la justesse du délai suggéré, et une note globale de qualité sur une échelle de cinq points. En substance, les experts demandaient : ce plan préserve‑t‑il la sécurité du patient, respecte‑t‑il les règles et évite‑t‑il des examens inutiles ?

Comment l’IA se compare aux humains

Sur l’ensemble des 100 cas, la qualité globale des propositions de suivi de GPT-4o a égalé celle du radiologue expérimenté et a surpassé celle du résident. La note médiane de qualité globale du modèle était de 4 sur 5, essentiellement identique à celle de l’expert et significativement meilleure que celle du stagiaire. GPT-4o a obtenu le bon délai, totalement ou partiellement, dans 96 % des cas, dépassant le résident (75 %) et devançant légèrement l’expert (90 %). Il a aussi produit le moins d’erreurs de timing potentiellement dangereuses. Le modèle a couvert toutes les constatations nécessitant un suivi dans 92 % des cas, proche du résident et nettement meilleur que l’expert sur cette mesure spécifique. Pour le choix du type d’examen, GPT-4o a performé quasi au même niveau que les deux lecteurs humains. Ses points forts étaient l’imagerie du poumon, du foie et du pancréas, où les voies de suivi sont particulièrement bien standardisées ; les performances étaient un peu plus faibles, pour tous les lecteurs, dans la région plus complexe de la tête et du cou.

Ce que cela pourrait signifier pour les soins futurs

L’étude suggère que GPT-4o peut agir comme un assistant fiable pour les décisions d’imagerie de suivi, opérant à peu près au niveau d’un radiologue expérimenté et supérieur à un stagiaire sur de nombreux points. Utilisé comme outil d’aide à la décision plutôt que comme substitut, un tel système pourrait contribuer à réduire les examens inutiles, raccourcir les délais pour des suivis essentiels et alléger la charge des services de radiologie, tout en rapprochant la pratique des recommandations établies. Cependant, les auteurs soulignent que les experts humains doivent rester maîtres de la décision : le modèle peut encore mal interpréter des comptes rendus, son fonctionnement interne reste opaque, et l’étude n’a porté que sur 100 cas liés au cancer provenant de deux centres. Des essais prospectifs plus vastes et des déploiements sécurisés et hébergés localement seront nécessaires avant que de tels outils puissent être intégrés en toute sécurité dans les flux de travail cliniques quotidiens.

Citation: Kaya, K., Müller, L., Persigehl, T. et al. GPT-4o for Automated Determination of Follow-up Examinations Based on Radiology Reports from Clinical Routine. Sci Rep 16, 12587 (2026). https://doi.org/10.1038/s41598-026-40317-9

Mots-clés: suivi en radiologie, grands modèles de langage, aide à la décision médicale, imagerie oncologique, GPT-4o