Clear Sky Science · it

GPT-4o per la determinazione automatizzata degli esami di follow-up basata sui referti radiologici della routine clinica

Perché i controlli successivi più intelligenti sono importanti

Quando un paziente esegue una TC o una risonanza magnetica, la storia non finisce con le immagini. I radiologi devono anche decidere se e quando sono necessari esami di follow-up per monitorare tumori, verificare reperti sospetti o confermare l’efficacia di una terapia. Queste scelte possono fare la differenza tra individuare la malattia precocemente e esporre i pazienti a radiazioni, costi e ansia non necessari. Questo studio pone una domanda attuale: può un moderno sistema di intelligenza artificiale, GPT-4o, aiutare a standardizzare queste decisioni di follow-up affinché i pazienti ricevano cure coerenti e conformi alle linee guida?

Il problema dei messaggi contrastanti

Le società professionali pubblicano raccomandazioni dettagliate su quando e come ripetere gli accertamenti per molti tumori e reperti incidentali. Eppure nella pratica quotidiana i radiologi spesso non sono concordi sui follow-up. Alcuni sono solleciti nel prescrivere esami di controllo; altri sono più cauti. Studi precedenti hanno dimostrato che la probabilità di raccomandare ulteriori indagini può variare quasi di sette volte tra radiologi che esaminano casi simili. Molti piani suggeriti non corrispondono pienamente alle linee guida pubblicate, portando alcuni pazienti a eseguire più esami del necessario, mentre altri possono perdere controlli tempestivi. Questo panorama disomogeneo motiva lo sviluppo di strumenti che possano orientare la pratica verso decisioni più coerenti e basate sulle evidenze.

Come è stato progettato lo studio

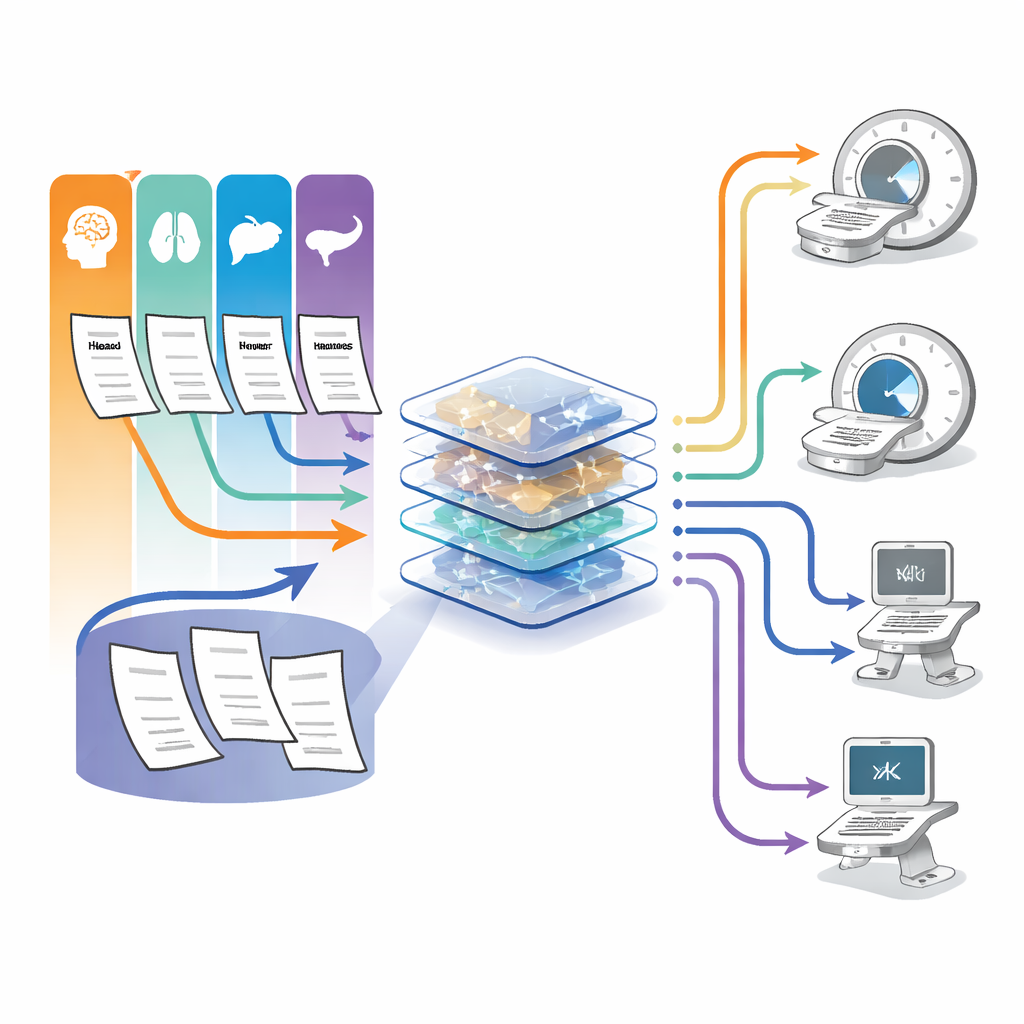

I ricercatori hanno testato GPT-4o, un grande modello linguistico progettato per comprendere e generare testo, su 100 casi radiologici reali provenienti da due ospedali tedeschi. Tutti i casi riguardavano adulti sottoposti a TC o risonanza per questioni legate al cancro in quattro aree chiave: testa e collo, fegato, polmone e pancreas. Per ogni caso il modello ha ricevuto il referto completo, inclusa l’anamnesi, i reperti dell’esame e la conclusione del radiologo. A GPT-4o è stato chiesto un compito: sulla base di queste informazioni proporre il metodo di imaging esatto per il follow-up (ad es. TC o RM) e la tempistica del prossimo controllo. Un medico radiologo in formazione e un radiologo esperto e certificato hanno risposto alla stessa domanda per ogni caso.

Valutare la qualità rispetto alle linee guida

Per giudicare queste raccomandazioni, due radiologi senior, che non sapevano da chi provenissero le proposte, hanno confrontato tutte le risposte con le principali linee guida internazionali di società oncologiche e radiologiche. Hanno valutato ogni proposta su quattro aspetti: se tutti i reperti rilevanti che richiedevano follow-up fossero coperti, se la tecnica di imaging scelta fosse appropriata, quanto fosse accurata la tempistica suggerita e un punteggio di qualità complessivo su una scala a cinque punti. In sostanza gli esperti si chiedevano: questo piano mantiene il paziente al sicuro, segue le regole ed evita esami non necessari?

Come l’IA si è confrontata con gli esseri umani

Su tutti i 100 casi, la qualità complessiva del follow-up proposta da GPT-4o è risultata pari a quella del radiologo esperto e superiore rispetto al medico in formazione. Il punteggio mediano di qualità globale del modello era 4 su 5, sostanzialmente lo stesso dell’esperto e significativamente migliore rispetto al tirocinante. GPT-4o ha indicato la tempistica corretta, totalmente o parzialmente, nel 96% dei casi, superando il tirocinante (75%) e superando leggermente l’esperto (90%). Ha inoltre prodotto il minor numero di errori di tempistica potenzialmente dannosi. Il modello ha considerato tutti i reperti che necessitavano di follow-up nel 92% dei casi, in modo simile al tirocinante e chiaramente migliore rispetto all’esperto in questa specifica misura. Nella scelta del tipo di esame, GPT-4o si è comportato quasi alla pari con entrambi i lettori umani. I suoi punti di forza sono stati l’imaging di polmone, fegato e pancreas, dove i percorsi guidati dalle linee guida sono particolarmente ben standardizzati; le prestazioni sono risultate un po’ inferiori, per tutti i lettori, nella più complessa regione testa e collo.

Quali implicazioni per le cure future

Lo studio suggerisce che GPT-4o può agire come assistente affidabile per le decisioni sul follow-up radiologico, operando a un livello simile a quello di un radiologo esperto e migliore di un tirocinante su molti aspetti. Utilizzato come strumento di supporto decisionale e non come sostituto, un sistema del genere potrebbe contribuire a ridurre esami non necessari, ridurre i ritardi nei follow-up essenziali e alleviare il carico di lavoro dei reparti di radiologia, mantenendo al contempo la pratica più aderente alle linee guida. Tuttavia, gli autori sottolineano che gli esperti umani devono rimanere responsabili: il modello può ancora interpretare erroneamente i referti, il suo funzionamento interno è opaco e lo studio ha coinvolto solo 100 casi oncologici provenienti da due centri. Saranno necessari studi prospettici più ampi e implementazioni sicure ospitate localmente prima che tali strumenti possano essere integrati in modo sicuro nei flussi di lavoro clinici di tutti i giorni.

Citazione: Kaya, K., Müller, L., Persigehl, T. et al. GPT-4o for Automated Determination of Follow-up Examinations Based on Radiology Reports from Clinical Routine. Sci Rep 16, 12587 (2026). https://doi.org/10.1038/s41598-026-40317-9

Parole chiave: follow-up in radiologia, modelli linguistici di grandi dimensioni, supporto decisionale medico, imaging oncologico, GPT-4o