Clear Sky Science · es

Bootstrap entre individuos calibrado por varianza para neurociencia con muestras pequeñas

Por qué importa hacer más con menos datos

Muchos experimentos modernos sobre cerebro y comportamiento trabajan con solo un puñado de animales o personas, aun cuando cada sujeto aporta cientos de medidas. Este desequilibrio—pocos individuos, muchas repeticiones—dificulta sorprendentemente obtener conclusiones fiables. El artículo presenta una forma nueva de reciclar y reequilibrar esos datos para que los investigadores puedan obtener respuestas de confianza sin necesitar siempre más sujetos, algo crucial cuando los experimentos son costosos, complicados o plantean sensibilidades éticas.

El reto de grupos reducidos y mediciones ruidosas

La neurociencia, la psicología, la biomecánica y campos afines suelen estudiar solo un pequeño número de participantes, pero registran muchas respuestas repetidas de cada uno. Los análisis tradicionales suelen condensar esas repeticiones en una sola media por sujeto, dejando solo unos pocos puntos de datos que representen todo el experimento. Eso hace que las estimaciones sean inestables, aumenta la probabilidad de pasar por alto efectos reales y contribuye a hallazgos irreproducibles. Los trucos estándar de remuestreo—como barajar repetidamente los datos para medir la incertidumbre—también tienen dificultades aquí: un enfoque popular tiende a ser demasiado optimista, dando intervalos de confianza demasiado estrechos, mientras que otro juega a lo seguro y produce intervalos tan amplios que efectos sutiles pero reales se pierden en el ruido.

Una nueva forma de mezclar y combinar información

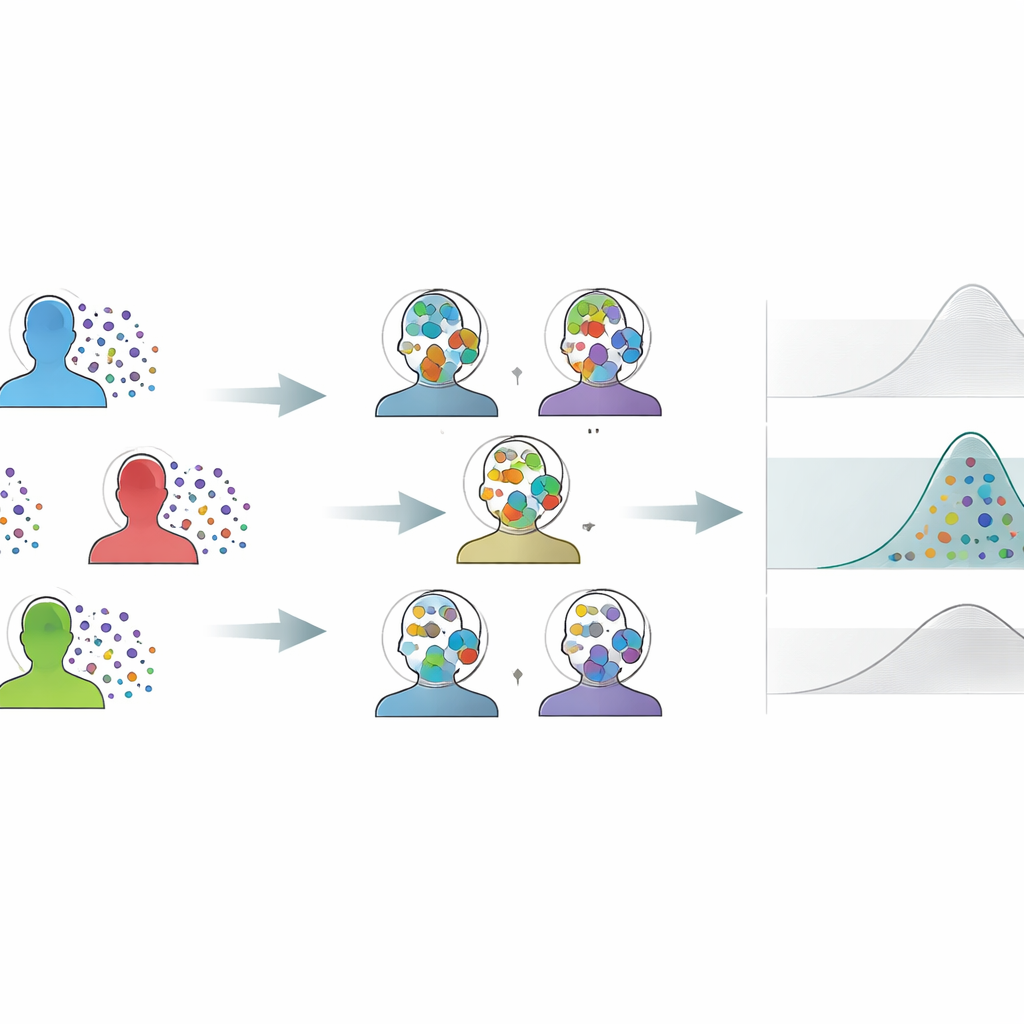

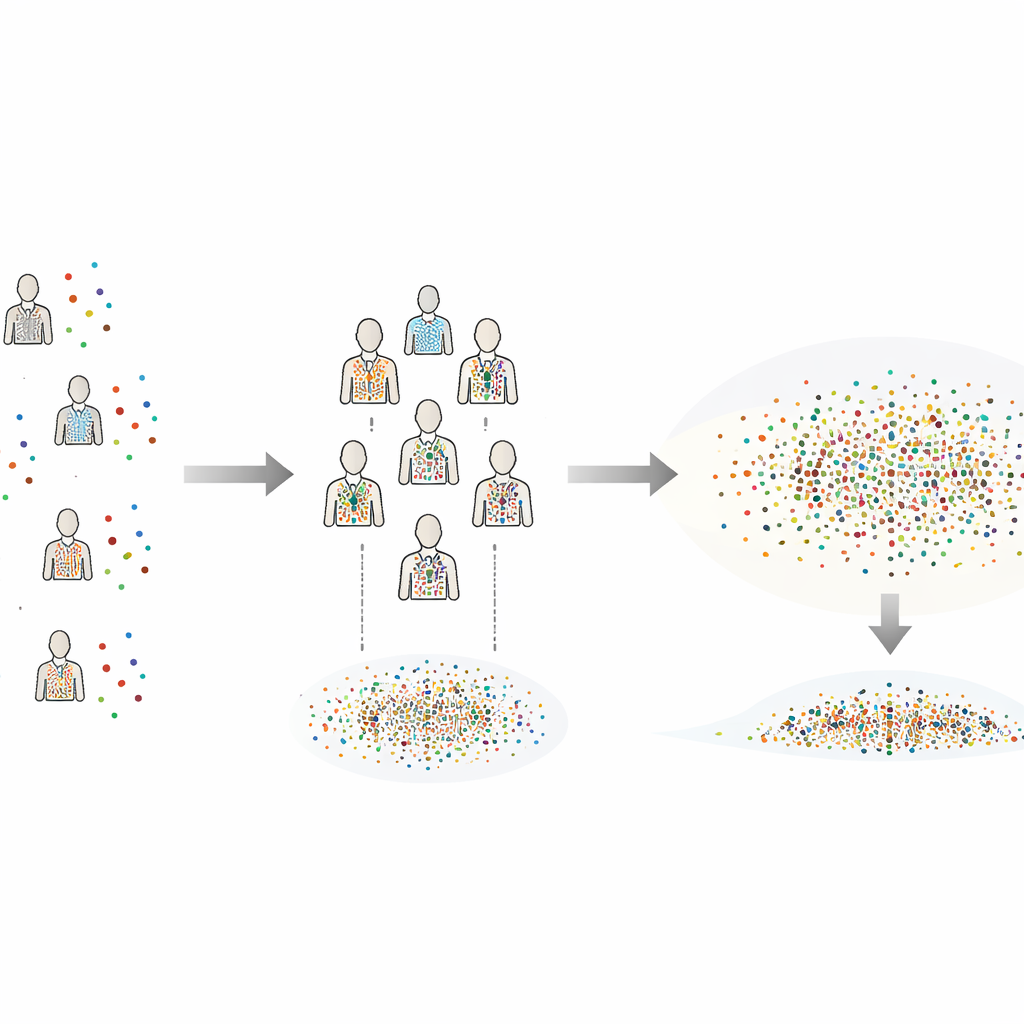

El autor propone el Bootstrap Cruzado entre Individuos calibrado por Varianza (CIB-VC) como solución práctica. En lugar de remuestrear en aislamiento los ensayos de cada sujeto, el método crea “individuos sintéticos” combinando ensayos únicos extraídos de cada sujeto. Cada individuo sintético es una instantánea mezclada del grupo entero, lo que suaviza la discreción incómoda que surge cuando solo hay unos pocos individuos reales para barajar. Sin embargo, esta mezcla normalmente reduciría las diferencias aparentes entre sujetos. Para compensarlo, CIB-VC añade un paso de calibración que amplía la variabilidad de estos individuos sintéticos para que coincida con la variación real observada entre los sujetos reales. El resultado final es un conjunto de intervalos de incertidumbre que reflejan correctamente cuánto difieren los individuos en la práctica, aprovechando al mismo tiempo los ricos datos a nivel de ensayo.

Poniendo el método a prueba

Para ver si CIB-VC funciona en la práctica, el estudio utiliza simulaciones a gran escala que imitan tipos comunes de datos científicos: distribuciones en forma de campana, colas pesadas con valores extremos ocasionales y distribuciones fuertemente sesgadas como los tiempos de reacción o tasas de disparo. El método también se somete a condiciones desajustadas que ocurren frecuentemente en laboratorios reales, como deriva lenta en el tiempo o sujetos registrados con distintos niveles de ruido. A lo largo de estos escenarios, CIB-VC ofrece de forma consistente intervalos de confianza que incluyen el valor verdadero aproximadamente el 95 por ciento de las veces—exactamente lo que están diseñados para hacer. En contraste, un método estándar suele fallar, especialmente cuando los datos están sesgados y muestran asimetría, produciendo intervalos engañosamente estrechos que casi nunca contienen la verdad. El otro método estándar se comporta como un árbitro cauteloso: rara vez se equivoca, pero con frecuencia es tan conservador que sus intervalos se acercan a todo el espacio plausible.

De las simulaciones a animales reales

El método se aplica luego a un experimento clásico de neurociencia con muestras pequeñas: una tarea de seguimiento realizada por cinco peces eléctricos débiles. Cada pez completó múltiples ensayos bajo diferentes condiciones de iluminación, y la pregunta fue cómo el nivel de luz afectaba al rendimiento en el seguimiento. Con los mismos datos, CIB-VC y un método conservador estándar coincidieron en el efecto medio, pero CIB-VC produjo intervalos de confianza aproximadamente un 23 por ciento más estrechos sin aumentar el sesgo ni las falsas alarmas. Esto significa que los investigadores pueden precisar el tamaño del efecto con más exactitud sin testar más animales. Comprobaciones adicionales mostraron que las estimaciones del método se estabilizan rápidamente a medida que se generan más individuos sintéticos, y que parámetros razonables se pueden manejar fácilmente en un ordenador de sobremesa.

Qué implica esto para estudios futuros

Para lectores no especializados en estadística, el mensaje principal es que la reutilización inteligente de datos existentes puede ayudar a equilibrar la ética, el coste y el rigor científico. CIB-VC ofrece una manera de convertir muchas mediciones ruidosas y repetidas de pocos individuos en afirmaciones poblacionales fiables, manteniendo bajo control los falsos positivos. Evita la falsa sensación de certeza que provocan intervalos demasiado estrechos, pero también escapa al pesimismo de enfoques que exigen muestras mucho mayores. Dado que los estudios pequeños y especializados siguen siendo la norma en muchas áreas de la investigación sobre cerebro y comportamiento, herramientas como CIB-VC ofrecen una vía práctica hacia una ciencia más reproducible sin requerir siempre más sujetos.

Cita: Uyanik, I. Variance-calibrated cross-individual bootstrapping for small-sample neuroscience. Sci Rep 16, 14502 (2026). https://doi.org/10.1038/s41598-026-44126-y

Palabras clave: neurociencia con muestras pequeñas, remuestreo bootstrap, datos jerárquicos, potencia estadística, reproducibilidad